Classifier-guided Gradient Modulation for Enhanced Multimodal Learning

作者: Zirun Guo, Tao Jin, Jingyuan Chen, Zhou Zhao

分类: cs.LG, cs.CL, cs.CV

发布日期: 2024-11-03

备注: Accepted at NeurIPS 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出分类器引导的梯度调制(CGGM)方法,用于增强多模态学习中的模态平衡。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 梯度调制 模态平衡 分类器引导 深度学习

📋 核心要点

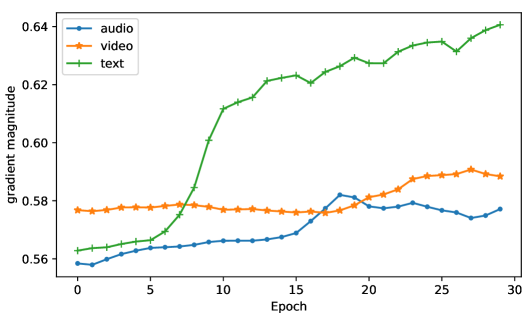

- 多模态学习中,模型易过度依赖单一模态,导致其他模态信息利用不足,影响整体性能。

- 提出CGGM方法,通过分类器引导,同时调制梯度的幅度和方向,实现模态间的平衡学习。

- 在多个数据集和任务上的实验表明,CGGM显著优于现有方法,验证了其有效性和通用性。

📝 摘要(中文)

近年来,多模态学习发展迅速。然而,在多模态训练过程中,模型往往倾向于依赖于单一模态,因为这样可以更快地学习,从而导致其他模态的利用不足。现有的平衡训练过程的方法通常在损失函数、优化器和模态数量上存在一些局限性,并且只考虑调节梯度的幅度,而忽略了梯度的方向。为了解决这些问题,本文提出了一种新的方法,即分类器引导的梯度调制(CGGM),以平衡多模态学习,同时考虑梯度的幅度和方向。我们在四个多模态数据集(UPMC-Food 101、CMU-MOSI、IEMOCAP和BraTS 2021)上进行了广泛的实验,涵盖了分类、回归和分割任务。结果表明,CGGM始终优于所有基线和其他最先进的方法,证明了其有效性和通用性。代码已开源。

🔬 方法详解

问题定义:多模态学习模型在训练时容易出现模态依赖问题,即模型过度依赖某个模态的信息,而忽略其他模态的信息,导致模型性能受限。现有的方法通常只关注梯度的幅度调整,而忽略了梯度的方向,或者在损失函数、优化器和模态数量上存在局限性。

核心思路:CGGM的核心思路是利用分类器提供的指导信息,同时调整梯度的幅度和方向,从而平衡不同模态的学习过程。通过分类器判断每个模态的重要性,并根据重要性调整梯度,使得模型能够充分利用所有模态的信息。

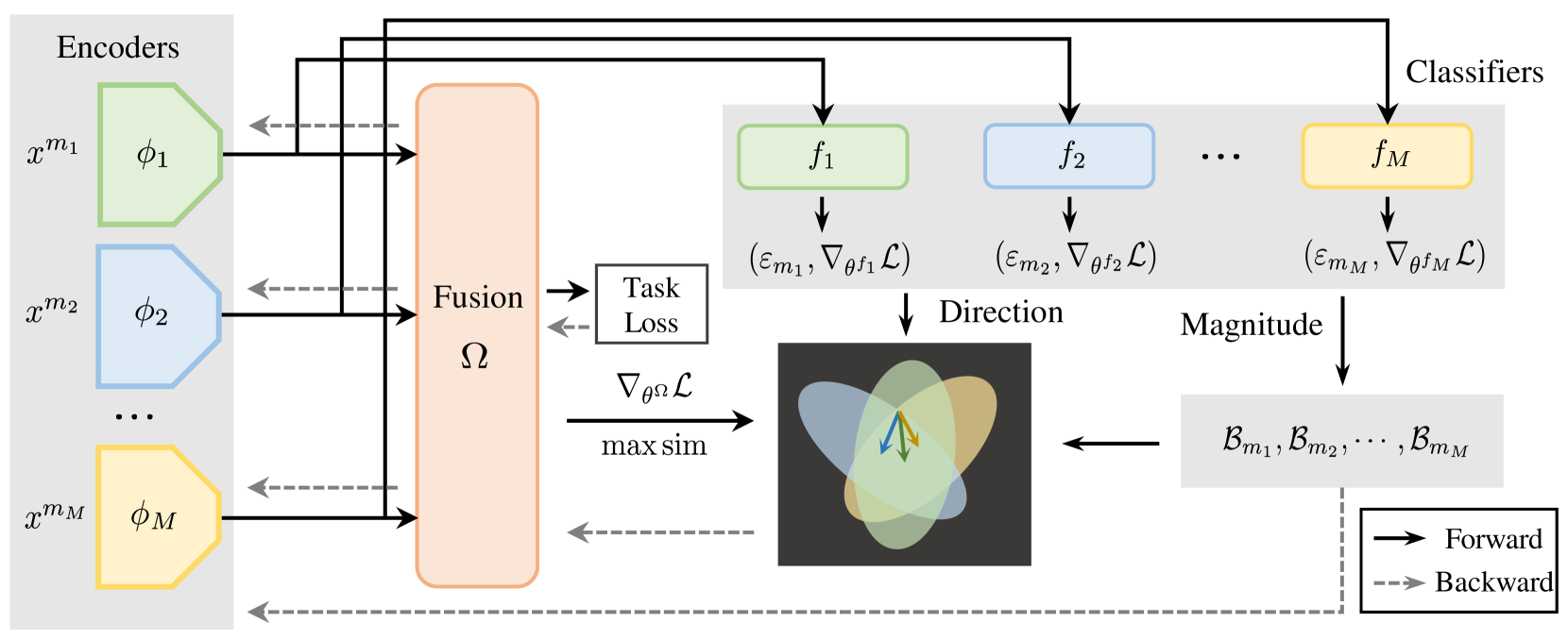

技术框架:CGGM的整体框架包括以下几个主要模块:1) 多模态特征提取模块,用于提取不同模态的特征;2) 分类器模块,用于预测每个模态的重要性;3) 梯度调制模块,用于根据分类器的输出调整梯度;4) 损失函数模块,用于计算模型的损失。整个流程是,首先提取多模态特征,然后通过分类器预测每个模态的重要性,接着根据重要性调整梯度,最后计算损失并更新模型参数。

关键创新:CGGM的关键创新在于同时考虑了梯度的幅度和方向,并利用分类器提供的指导信息进行梯度调制。与现有方法相比,CGGM能够更有效地平衡不同模态的学习过程,从而提高模型的性能。现有方法通常只关注梯度的幅度调整,而忽略了梯度的方向,或者没有利用分类器提供的指导信息。

关键设计:CGGM的关键设计包括:1) 分类器的选择,可以使用任何分类器,例如线性分类器或神经网络;2) 梯度调制策略,可以使用不同的策略来调整梯度的幅度和方向,例如加权平均或梯度裁剪;3) 损失函数的选择,可以使用任何损失函数,例如交叉熵损失或均方误差损失。具体的参数设置需要根据具体任务进行调整。论文中使用了交叉熵损失函数和Adam优化器。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CGGM在UPMC-Food 101、CMU-MOSI、IEMOCAP和BraTS 2021四个多模态数据集上均优于现有方法。例如,在CMU-MOSI数据集上,CGGM相比于基线方法取得了显著的性能提升。这些结果证明了CGGM的有效性和通用性。

🎯 应用场景

CGGM方法可广泛应用于多模态学习领域,例如图像和文本的联合分类、语音和视频的情感识别、医学图像分割等。该方法能够有效提升多模态模型的性能,具有重要的实际应用价值,并有望推动多模态学习的进一步发展。

📄 摘要(原文)

Multimodal learning has developed very fast in recent years. However, during the multimodal training process, the model tends to rely on only one modality based on which it could learn faster, thus leading to inadequate use of other modalities. Existing methods to balance the training process always have some limitations on the loss functions, optimizers and the number of modalities and only consider modulating the magnitude of the gradients while ignoring the directions of the gradients. To solve these problems, in this paper, we present a novel method to balance multimodal learning with Classifier-Guided Gradient Modulation (CGGM), considering both the magnitude and directions of the gradients. We conduct extensive experiments on four multimodal datasets: UPMC-Food 101, CMU-MOSI, IEMOCAP and BraTS 2021, covering classification, regression and segmentation tasks. The results show that CGGM outperforms all the baselines and other state-of-the-art methods consistently, demonstrating its effectiveness and versatility. Our code is available at https://github.com/zrguo/CGGM.