Keep on Swimming: Real Attackers Only Need Partial Knowledge of a Multi-Model System

作者: Julian Collado, Kevin Stangl

分类: cs.LG, cs.AI, cs.CR, cs.CV, cs.MA

发布日期: 2024-10-30

备注: 11 pages, 2 figures

💡 一句话要点

针对多模型系统的部分知识对抗攻击方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对抗攻击 多模型系统 黑盒攻击 部分知识 代理模型 鲁棒性 深度学习安全

📋 核心要点

- 现有对抗攻击方法难以有效攻击由多个模型组成的复杂系统,尤其是在仅有部分模型信息的情况下。

- 该论文提出一种新的对抗攻击方法,仅需最终黑盒模型的代理模型即可实现对整个多模型系统的攻击。

- 实验表明,该方法在攻击成功率和扰动幅度上均优于现有技术,尤其是在图像处理流水线上。

📝 摘要(中文)

现有的机器学习方法通常使用多个模型或agent架构的组合来解决任务。当使用对抗攻击针对这种组合系统时,训练端到端的代理模型或系统每个组件的代理模型在计算上或信息上可能是不可行的。本文提出了一种对抗攻击方法,该方法仅需最终黑盒模型的代理模型,并且初始模型应用的转换可能会使对抗扰动失效。现有方法通过将第一个模型/转换的多个副本应用于输入,然后通过平均梯度或学习两个阶段的代理模型来重用标准对抗攻击来处理这个问题。据我们所知,这是第一个专门为这种威胁模型设计的攻击,与现有技术相比,我们的方法具有更高的攻击成功率(80% vs 25%)和更小的扰动(MSE,小9.4%)。我们的实验侧重于监督图像流水线,但我们相信该攻击将推广到其他多模型设置[例如,开源/闭源基础模型的混合],或agent系统。

🔬 方法详解

问题定义:论文旨在解决在仅有部分模型知识的情况下,如何有效地攻击由多个模型组成的系统。现有方法,如训练端到端代理模型或为每个组件训练代理模型,在计算资源和信息获取上存在困难。此外,初始模型的转换可能会削弱后续对抗扰动的效果,使得攻击难以成功。

核心思路:该论文的核心思路是,即使只知道最终黑盒模型的代理模型,也能通过精心设计的对抗攻击方法,绕过初始模型的转换,有效地攻击整个多模型系统。这种方法避免了训练复杂的代理模型,降低了攻击成本。

技术框架:该攻击方法主要针对一种特定的多模型系统架构,即输入首先经过一系列初始模型/转换,然后输入到最终的黑盒模型。攻击者只拥有最终黑盒模型的代理模型。攻击流程包括:首先,利用最终黑盒模型的代理模型生成对抗样本;然后,考虑初始模型的转换对对抗扰动的影响,并进行相应的调整,以确保对抗样本在经过初始模型后仍然有效。

关键创新:该论文的关键创新在于提出了一种专门针对部分知识下的多模型系统对抗攻击方法。与现有方法相比,该方法不需要完整的模型信息,降低了攻击成本,并且能够有效地绕过初始模型的转换,提高攻击成功率。

关键设计:论文中没有详细说明具体的参数设置、损失函数或网络结构,但强调了对抗扰动的调整策略,以应对初始模型的转换。具体而言,可能涉及到对对抗扰动的梯度进行修改,或者使用特定的优化算法来生成更鲁棒的对抗样本。这些细节需要在阅读论文原文后才能进一步了解。

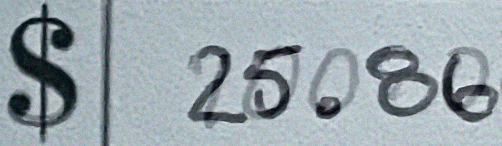

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在攻击成功率上显著优于现有技术(80% vs 25%),并且生成的对抗扰动更小(MSE降低9.4%)。这些结果表明,该方法在部分知识条件下,能够更有效地攻击多模型系统,并且对原始输入的影响更小,更具有隐蔽性。

🎯 应用场景

该研究成果可应用于评估和增强多模型系统的安全性,例如在自动驾驶、医疗诊断等领域,这些系统通常由多个模型组成。通过模拟部分知识攻击,可以发现系统的潜在漏洞,并采取相应的防御措施,提高系统的鲁棒性和可靠性。此外,该方法也可用于评估开源/闭源模型混合系统的安全性。

📄 摘要(原文)

Recent approaches in machine learning often solve a task using a composition of multiple models or agentic architectures. When targeting a composed system with adversarial attacks, it might not be computationally or informationally feasible to train an end-to-end proxy model or a proxy model for every component of the system. We introduce a method to craft an adversarial attack against the overall multi-model system when we only have a proxy model for the final black-box model, and when the transformation applied by the initial models can make the adversarial perturbations ineffective. Current methods handle this by applying many copies of the first model/transformation to an input and then re-use a standard adversarial attack by averaging gradients, or learning a proxy model for both stages. To our knowledge, this is the first attack specifically designed for this threat model and our method has a substantially higher attack success rate (80% vs 25%) and contains 9.4% smaller perturbations (MSE) compared to prior state-of-the-art methods. Our experiments focus on a supervised image pipeline, but we are confident the attack will generalize to other multi-model settings [e.g. a mix of open/closed source foundation models], or agentic systems