Matryoshka Pilot: Learning to Drive Black-Box LLMs with LLMs

作者: Changhao Li, Yuchen Zhuang, Rushi Qiang, Haotian Sun, Hanjun Dai, Chao Zhang, Bo Dai

分类: cs.LG, cs.AI, cs.CL

发布日期: 2024-10-28 (更新: 2025-11-13)

备注: Accepted by NeurIPS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出Matryoshka Pilot,利用轻量级LLM控制器驱动黑盒LLM,提升复杂任务处理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 黑盒LLM LLM控制器 提示工程 多轮生成 强化学习

📋 核心要点

- 黑盒LLM虽然具有强大的生成能力,但其不透明性阻碍了推理、规划和个性化等能力的进一步发展。

- M-Pilot通过训练一个轻量级的白盒LLM控制器,以提示的方式指导黑盒LLM,实现对黑盒LLM输出的控制和优化。

- 实验表明,M-Pilot能够有效提升黑盒LLM在复杂、长程任务中的性能,实现可控的多轮生成和自我改进。

📝 摘要(中文)

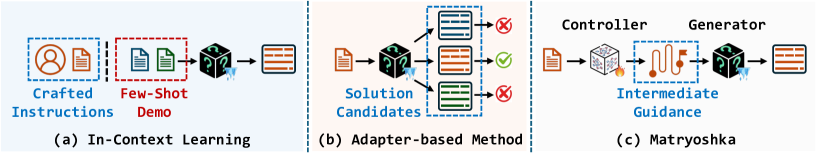

本文提出Matryoshka Pilot (M-Pilot),一个轻量级的白盒LLM控制器,用于指导大规模黑盒LLM生成器,通过将复杂任务分解为一系列中间输出来实现。具体而言,我们将黑盒LLM视为环境,M-Pilot作为策略,通过提示提供中间指导来驱动黑盒LLM。M-Pilot经过训练,可以在迭代交互过程中调整黑盒LLM的输出,使其与偏好对齐,从而实现可控的多轮生成和自我改进,以优化中间指导。在各种任务上的实验评估表明,该方法有效地增强了黑盒LLM在复杂、长程任务中的能力。代码已公开。

🔬 方法详解

问题定义:现有方法通常需要访问模型参数并进行额外的训练才能增强LLM的能力,这对于黑盒LLM来说是不可行的。因此,需要一种方法能够在不访问模型参数的情况下,提升黑盒LLM在复杂任务中的表现。

核心思路:将黑盒LLM视为一个环境,通过训练一个轻量级的白盒LLM控制器(M-Pilot)来控制和引导黑盒LLM的输出。M-Pilot通过提供中间指导(提示)来驱动黑盒LLM,使其逐步完成复杂任务。

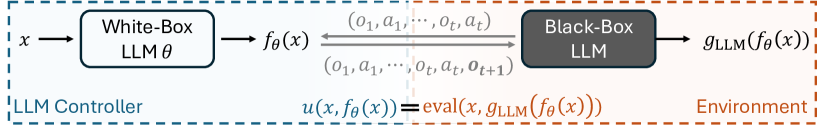

技术框架:M-Pilot框架包含两个主要部分:黑盒LLM环境和白盒LLM控制器。M-Pilot作为策略,接收任务描述和黑盒LLM的当前输出,生成中间指导(提示),发送给黑盒LLM。黑盒LLM根据提示生成新的输出,反馈给M-Pilot。这个过程迭代进行,直到任务完成。M-Pilot通过强化学习或监督学习进行训练,目标是使黑盒LLM的输出与期望的偏好对齐。

关键创新:M-Pilot的关键创新在于它提供了一种在不访问模型参数的情况下,通过外部控制器来增强和控制黑盒LLM能力的方法。与传统的微调方法相比,M-Pilot更加灵活,可以应用于各种黑盒LLM,并且可以实现可控的多轮生成和自我改进。

关键设计:M-Pilot的设计包括以下关键方面:1) 提示的设计:如何设计有效的提示,以引导黑盒LLM生成期望的输出。2) 训练方法:如何训练M-Pilot,使其能够生成有效的提示。可以使用强化学习,奖励与期望输出的相似度;也可以使用监督学习,通过专家数据进行训练。3) 迭代策略:如何确定迭代的次数和停止条件,以平衡性能和效率。

🖼️ 关键图片

📊 实验亮点

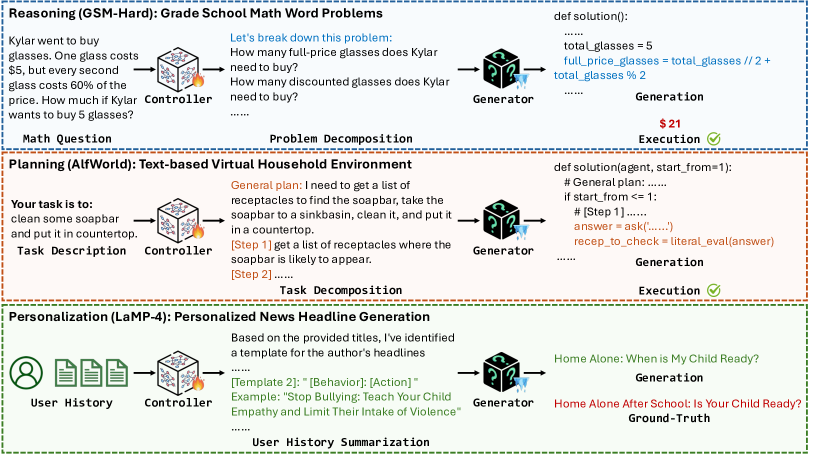

论文在多个任务上进行了实验评估,证明了M-Pilot能够有效提升黑盒LLM在复杂任务中的性能。例如,在长程对话任务中,M-Pilot能够显著提高对话的连贯性和信息量。与直接使用黑盒LLM相比,M-Pilot能够更好地完成需要多步推理和规划的任务,展现出更强的泛化能力。

🎯 应用场景

M-Pilot具有广泛的应用前景,例如可以用于智能对话系统,通过控制黑盒LLM的生成过程,提高对话的质量和一致性。还可以应用于自动化报告生成、代码生成等领域,通过分解复杂任务并提供中间指导,提高生成结果的准确性和可控性。此外,M-Pilot还可以用于个性化推荐系统,根据用户的偏好调整黑盒LLM的输出,提供更加个性化的服务。

📄 摘要(原文)

Despite the impressive generative abilities of black-box large language models (LLMs), their inherent opacity hinders further advancements in capabilities such as reasoning, planning, and personalization. Existing works aim to enhance LLM capabilities via domain-specific adaptation, which require additional training on accessible model parameters, an infeasible option for black-box LLMs. To address this challenge, we introduce Matryoshka Pilot (M-Pilot), a lightweight white-box LLM controller that guides a large-scale black-box LLM generator by decomposing complex tasks into a series of intermediate outputs. Specifically, we consider the black-box LLM as an environment, with M-Pilot serving as a policy to provide intermediate guidance through prompts for driving the black-box LLM. M-Pilot is trained to pivot the outputs of the black-box LLM aligning with preferences during iterative interaction, which enables controllable multi-turn generation and self-improvement in optimizing intermediate guidance. Empirical evaluations on diverse tasks demonstrate that our method effectively enhances the capabilities of black-box LLMs in complex, long-horizon tasks. Our code is publicly available at: https://github.com/lichangh20/Matryoshka.