Enhancing Battery Storage Energy Arbitrage with Deep Reinforcement Learning and Time-Series Forecasting

作者: Manuel Sage, Joshua Campbell, Yaoyao Fiona Zhao

分类: cs.LG, cs.AI, cs.OS, eess.SY

发布日期: 2024-10-25

备注: Accepted for publication at the 18th ASME International Conference on Energy Sustainability

💡 一句话要点

结合深度强化学习与时间序列预测,提升电池储能套利收益

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 时间序列预测 能源套利 电池储能 电力市场

📋 核心要点

- 电力价格的波动性给电池储能套利带来挑战,传统方法难以有效应对价格的不确定性。

- 论文提出结合深度强化学习(DRL)和时间序列预测,利用预测信息辅助DRL智能体进行决策。

- 实验结果表明,结合多个时间序列预测器,DQN的累积奖励提升了60%,验证了该方法的有效性。

📝 摘要(中文)

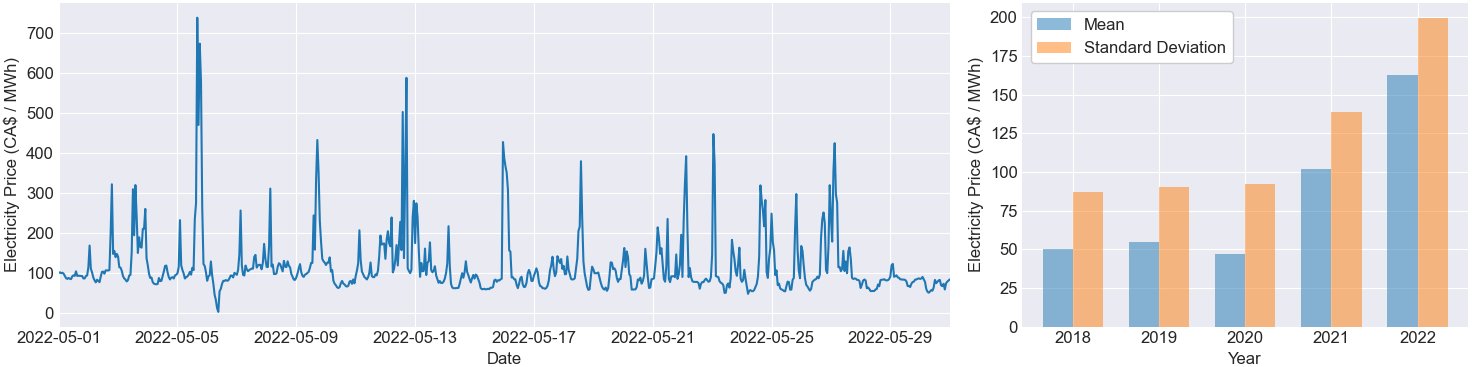

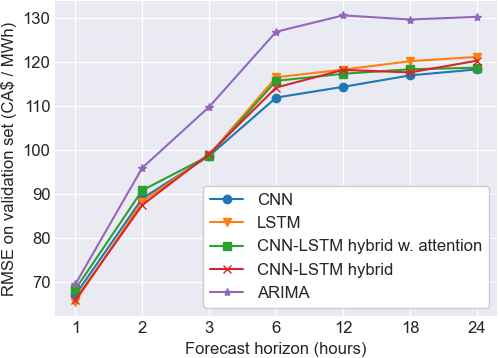

能源套利是电池运营商最有利可图的收入来源之一,通过在不同价格时买卖电力来产生收益。由于电力价格固有的不确定性,预测这些收益具有挑战性。近年来,深度强化学习(DRL)作为一种有前途的工具出现,它能够通过对大量历史数据进行训练来应对不确定性。然而,在无法获得未来电力价格的情况下,DRL智能体只能对当前观察到的价格做出反应,而无法学习规划电池调度。因此,在本研究中,我们将DRL与深度学习中的时间序列预测方法相结合,以提高能源套利的性能。我们使用来自加拿大艾伯塔省的价格数据进行案例研究,该数据以不规则的价格峰值和高度非平稳性为特征。即使部署由卷积层、循环层和注意力模块组成的先进深度学习模型,也很难预测这些数据。我们的结果表明,即使预测不完美,DRL驱动的电池控制能源套利仍然可以从中受益,但前提是多个预测范围的预测器相结合。通过对未来24小时窗口的多个预测进行分组,与没有预测的实验相比,深度Q网络(DQN)的累积奖励增加了60%。我们假设,尽管存在缺陷,但多个预测器通过“多数投票”原则传递了关于电力价格未来发展的有用信息,使DRL智能体能够学习更有利可图的控制策略。

🔬 方法详解

问题定义:论文旨在解决电池储能能源套利中,由于电力价格的随机性和不可预测性,导致传统方法难以制定最优电池调度策略,从而影响套利收益的问题。现有方法主要依赖于对历史数据的统计分析或简单的预测模型,无法有效应对电力市场中频繁出现的价格尖峰和非平稳性。

核心思路:论文的核心思路是将深度强化学习(DRL)与时间序列预测相结合。DRL负责根据当前状态(包括历史价格和预测价格)制定电池调度策略,而时间序列预测模型则负责预测未来的电力价格。通过将预测信息融入DRL的决策过程,智能体可以更好地规划电池的充放电行为,从而提高套利收益。

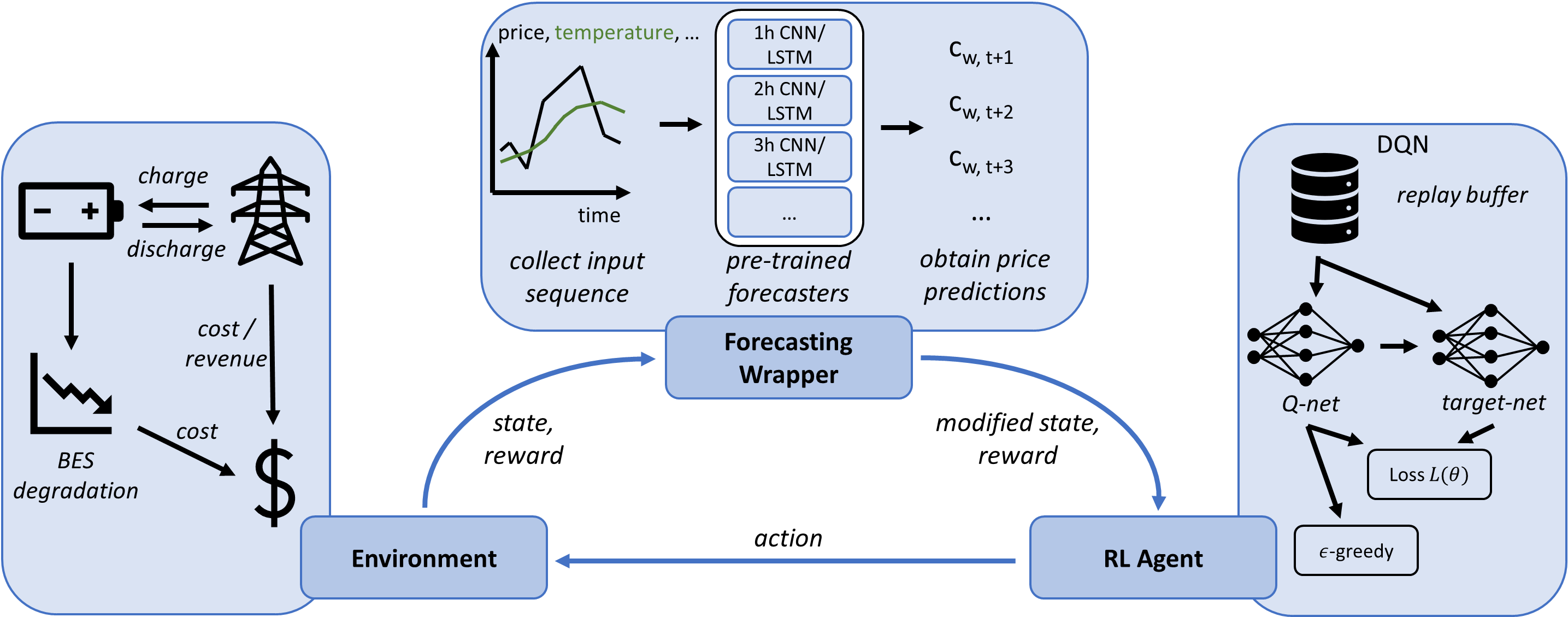

技术框架:整体框架包含两个主要模块:时间序列预测模块和DRL控制模块。时间序列预测模块使用深度学习模型(包括卷积层、循环层和注意力机制)预测未来一段时间内的电力价格。DRL控制模块使用深度Q网络(DQN),以当前电力价格和预测价格作为输入,输出电池的充放电动作。DQN通过与环境交互,不断学习和优化电池调度策略。

关键创新:论文的关键创新在于将时间序列预测与DRL相结合,并提出使用多个不同预测范围的预测器,通过“多数投票”原则,提高预测信息的可靠性。这种方法允许DRL智能体利用不完美的预测信息,从而更好地规划电池调度。

关键设计:论文使用了深度Q网络(DQN)作为DRL智能体,并设计了合适的奖励函数,以最大化套利收益。时间序列预测模型采用了包含卷积层、循环层和注意力机制的深度学习架构。实验中,作者尝试了不同的预测范围,并发现结合多个预测范围的预测器可以显著提高性能。具体参数设置和网络结构细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在加拿大艾伯塔省的电力市场数据上,结合多个时间序列预测器后,深度Q网络(DQN)的累积奖励相比于没有预测信息的基线方法提升了60%。这表明即使预测不完美,利用预测信息仍然可以显著提高电池储能套利的收益。

🎯 应用场景

该研究成果可应用于电池储能系统的优化控制,提高能源套利收益。通过更智能的电池调度策略,可以降低电力系统的运行成本,提高可再生能源的利用率,并为电网提供更稳定的电力供应。该方法具有广泛的应用前景,尤其是在电力市场自由化程度较高的地区。

📄 摘要(原文)

Energy arbitrage is one of the most profitable sources of income for battery operators, generating revenues by buying and selling electricity at different prices. Forecasting these revenues is challenging due to the inherent uncertainty of electricity prices. Deep reinforcement learning (DRL) emerged in recent years as a promising tool, able to cope with uncertainty by training on large quantities of historical data. However, without access to future electricity prices, DRL agents can only react to the currently observed price and not learn to plan battery dispatch. Therefore, in this study, we combine DRL with time-series forecasting methods from deep learning to enhance the performance on energy arbitrage. We conduct a case study using price data from Alberta, Canada that is characterized by irregular price spikes and highly non-stationary. This data is challenging to forecast even when state-of-the-art deep learning models consisting of convolutional layers, recurrent layers, and attention modules are deployed. Our results show that energy arbitrage with DRL-enabled battery control still significantly benefits from these imperfect predictions, but only if predictors for several horizons are combined. Grouping multiple predictions for the next 24-hour window, accumulated rewards increased by 60% for deep Q-networks (DQN) compared to the experiments without forecasts. We hypothesize that multiple predictors, despite their imperfections, convey useful information regarding the future development of electricity prices through a "majority vote" principle, enabling the DRL agent to learn more profitable control policies.