Reinforcement Learning for Dynamic Memory Allocation

作者: Arisrei Lim, Abhiram Maddukuri

分类: cs.LG, cs.OS

发布日期: 2024-10-20 (更新: 2025-10-08)

💡 一句话要点

提出基于强化学习的动态内存分配方法,提升资源管理效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 动态内存分配 资源管理 内存碎片 自适应算法

📋 核心要点

- 传统动态内存分配算法难以适应变化的环境,导致内存碎片和效率降低。

- 利用强化学习,智能体通过与系统交互学习,优化内存管理策略,提升适应性。

- 实验表明,强化学习智能体在对抗性请求模式下,性能超越传统算法。

📝 摘要(中文)

近年来,强化学习(RL)日益普及,并被应用于广泛的任务中。强化学习已在系统资源管理问题中展现出有效性。本文旨在扩展强化学习在资源管理问题上的应用,探索动态内存分配管理这一新领域。动态内存分配是强化学习的理想应用场景,因为现有的首次适应、最佳适应和最差适应等算法无法适应不断变化的环境,可能导致碎片化和次优效率。本文提出了一个框架,其中强化学习智能体通过与系统的持续交互学习,以改进内存管理策略。我们通过各种实验,使用高级和低级动作空间,并考察不同的内存分配模式来评估我们的方法。结果表明,强化学习可以成功训练智能体,使其能够匹配甚至超越传统的分配策略,尤其是在以对抗性请求模式为特征的环境中。我们还探索了历史感知策略的潜力,该策略利用先前的分配请求来增强分配器处理复杂请求模式的能力。总的来说,我们发现强化学习为开发更具适应性和效率的内存分配策略提供了一条有希望的途径,有可能克服硬编码分配算法的局限性。

🔬 方法详解

问题定义:动态内存分配旨在高效地管理计算机内存资源,现有算法(如首次适应、最佳适应、最差适应)在面对动态变化的环境和复杂的请求模式时,容易产生内存碎片,导致资源利用率降低。论文旨在寻找一种能够自适应学习并优化内存分配策略的方法,以克服传统算法的局限性。

核心思路:论文的核心思路是将动态内存分配问题建模为一个强化学习任务。通过让智能体与内存分配环境进行交互,智能体可以学习到在不同状态下采取何种分配策略能够最大化长期奖励,从而实现更高效的内存管理。这种方法的核心优势在于其自适应性,能够根据实际的请求模式动态调整分配策略。

技术框架:该框架包含一个强化学习智能体和一个内存分配环境。智能体观察当前内存状态(例如,已分配内存块的大小和位置,可用内存块的大小和位置)以及新的内存分配请求,然后根据其策略选择一个分配动作(例如,选择哪个空闲块进行分配)。环境执行该动作,并返回一个奖励信号,该奖励信号反映了分配的效率和碎片化程度。智能体根据奖励信号更新其策略,从而不断学习优化分配策略。

关键创新:该论文的关键创新在于将强化学习应用于动态内存分配这一经典问题,并探索了不同动作空间(高级和低级)和历史感知策略。历史感知策略允许智能体利用先前的分配请求信息,从而更好地预测未来的请求模式,并做出更明智的分配决策。

关键设计:论文探索了不同的奖励函数设计,以鼓励高效的内存利用和减少碎片化。同时,论文还研究了不同的强化学习算法,例如Q-learning和策略梯度方法,以及不同的神经网络结构,用于表示智能体的策略。此外,论文还考虑了不同的内存分配模式,包括随机请求模式和对抗性请求模式,以评估智能体在不同环境下的性能。

🖼️ 关键图片

📊 实验亮点

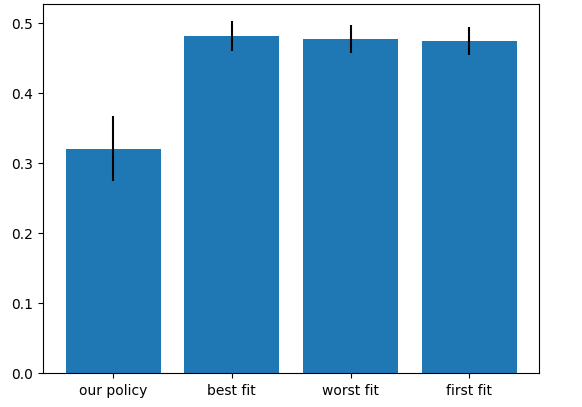

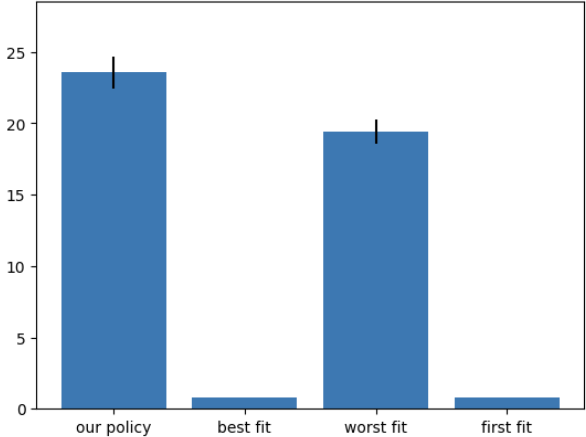

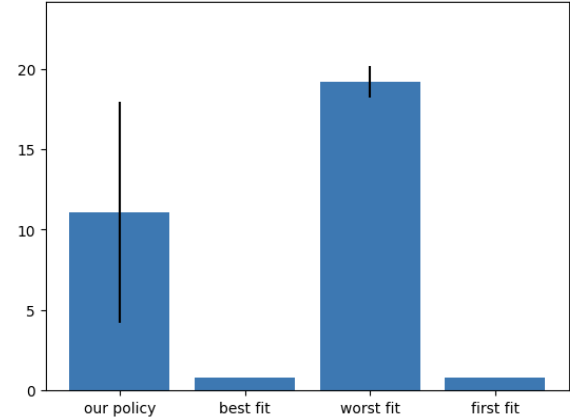

实验结果表明,基于强化学习的动态内存分配智能体在多种内存分配模式下,能够匹配甚至超越传统的分配策略。尤其是在对抗性请求模式下,强化学习智能体表现出更强的适应性和鲁棒性,能够有效减少内存碎片,提高内存利用率。具体性能提升幅度未知,但论文强调了在特定环境下的显著优势。

🎯 应用场景

该研究成果可应用于各种需要动态内存分配的系统,例如操作系统、嵌入式系统、数据库管理系统和高性能计算环境。通过采用基于强化学习的动态内存分配策略,可以显著提高内存利用率,减少内存碎片,从而提升系统整体性能和稳定性。未来,该技术有望在资源受限的边缘设备和云计算平台中发挥重要作用。

📄 摘要(原文)

In recent years, reinforcement learning (RL) has gained popularity and has been applied to a wide range of tasks. One such popular domain where RL has been effective is resource management problems in systems. We look to extend work on RL for resource management problems by considering the novel domain of dynamic memory allocation management. We consider dynamic memory allocation to be a suitable domain for RL since current algorithms like first-fit, best-fit, and worst-fit can fail to adapt to changing conditions and can lead to fragmentation and suboptimal efficiency. In this paper, we present a framework in which an RL agent continuously learns from interactions with the system to improve memory management tactics. We evaluate our approach through various experiments using high-level and low-level action spaces and examine different memory allocation patterns. Our results show that RL can successfully train agents that can match and surpass traditional allocation strategies, particularly in environments characterized by adversarial request patterns. We also explore the potential of history-aware policies that leverage previous allocation requests to enhance the allocator's ability to handle complex request patterns. Overall, we find that RL offers a promising avenue for developing more adaptive and efficient memory allocation strategies, potentially overcoming limitations of hardcoded allocation algorithms.