Hierarchical Reinforced Trader (HRT): A Bi-Level Approach for Optimizing Stock Selection and Execution

作者: Zijie Zhao, Roy E. Welsch

分类: q-fin.TR, cs.CE, cs.LG

发布日期: 2024-10-19

💡 一句话要点

提出HRT双层强化学习交易框架,优化股票选择与执行,提升夏普比率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 分层强化学习 股票交易 深度强化学习 近端策略优化 深度确定性策略梯度

📋 核心要点

- 现有基于DRL的股票交易方法面临维度灾难、交易惯性和投资组合多样性不足等挑战。

- HRT采用双层分层强化学习框架,利用高级控制器进行股票选择,低级控制器优化交易执行。

- 实验结果表明,HRT在牛市和熊市中均优于传统DRL模型和S&P 500指数,实现了更高的夏普比率。

📝 摘要(中文)

本文提出了一种名为分层强化交易者(HRT)的新型交易策略,该策略采用双层分层强化学习框架,旨在解决自动股票交易中深度强化学习(DRL)面临的挑战,包括维度灾难、交易行为惯性和投资组合多样性不足。HRT集成了一个基于近端策略优化(PPO)的高级控制器(HLC)用于战略性股票选择,以及一个基于深度确定性策略梯度(DDPG)的低级控制器(LLC),负责优化交易执行以提高投资组合价值。实证分析表明,在牛市和熊市条件下,HRT代理相比于独立的DRL模型和标准普尔500指数基准,实现了更高且为正的夏普比率。这一进展不仅强调了将分层结构融入DRL策略的有效性,还缓解了上述挑战,为在复杂市场中设计更具盈利性和鲁棒性的交易算法铺平了道路。

🔬 方法详解

问题定义:论文旨在解决使用深度强化学习进行股票交易时遇到的维度灾难、交易行为惯性和投资组合多样性不足的问题。现有的DRL方法在处理大量股票时,状态空间和动作空间会急剧增大,导致训练困难。同时,DRL模型容易产生频繁且小幅度的交易,增加了交易成本,并且难以实现有效的投资组合多样化。

核心思路:论文的核心思路是将股票交易过程分解为两个层次:战略性的股票选择和战术性的交易执行。通过分层强化学习,分别优化这两个层次的决策,从而降低问题的复杂度,提高交易效率和收益。高级控制器负责选择具有潜力的股票,低级控制器负责在选定的股票上进行具体的交易操作。

技术框架:HRT框架包含两个主要模块:高层控制器(HLC)和低层控制器(LLC)。HLC基于PPO算法,负责从所有可交易的股票中选择一个子集。LLC基于DDPG算法,负责在HLC选择的股票上执行具体的买入和卖出操作。HLC的输出作为LLC的输入,指导LLC的交易行为。整个框架通过强化学习不断优化HLC和LLC的策略,以最大化投资组合的价值。

关键创新:HRT的关键创新在于引入了分层强化学习结构来解决股票交易问题。与传统的单层DRL方法相比,HRT能够更好地处理高维状态空间和动作空间,降低了训练难度,提高了交易效率。此外,HRT通过分离股票选择和交易执行,能够更好地控制交易频率和投资组合多样性。

关键设计:HLC使用PPO算法,其目标是选择能够最大化投资组合收益的股票子集。LLC使用DDPG算法,其目标是在给定的股票上执行最优的交易策略。HLC的奖励函数基于投资组合的收益,LLC的奖励函数基于交易执行的收益。HLC和LLC的网络结构都采用了多层感知机(MLP)。具体的参数设置(如学习率、折扣因子等)未知。

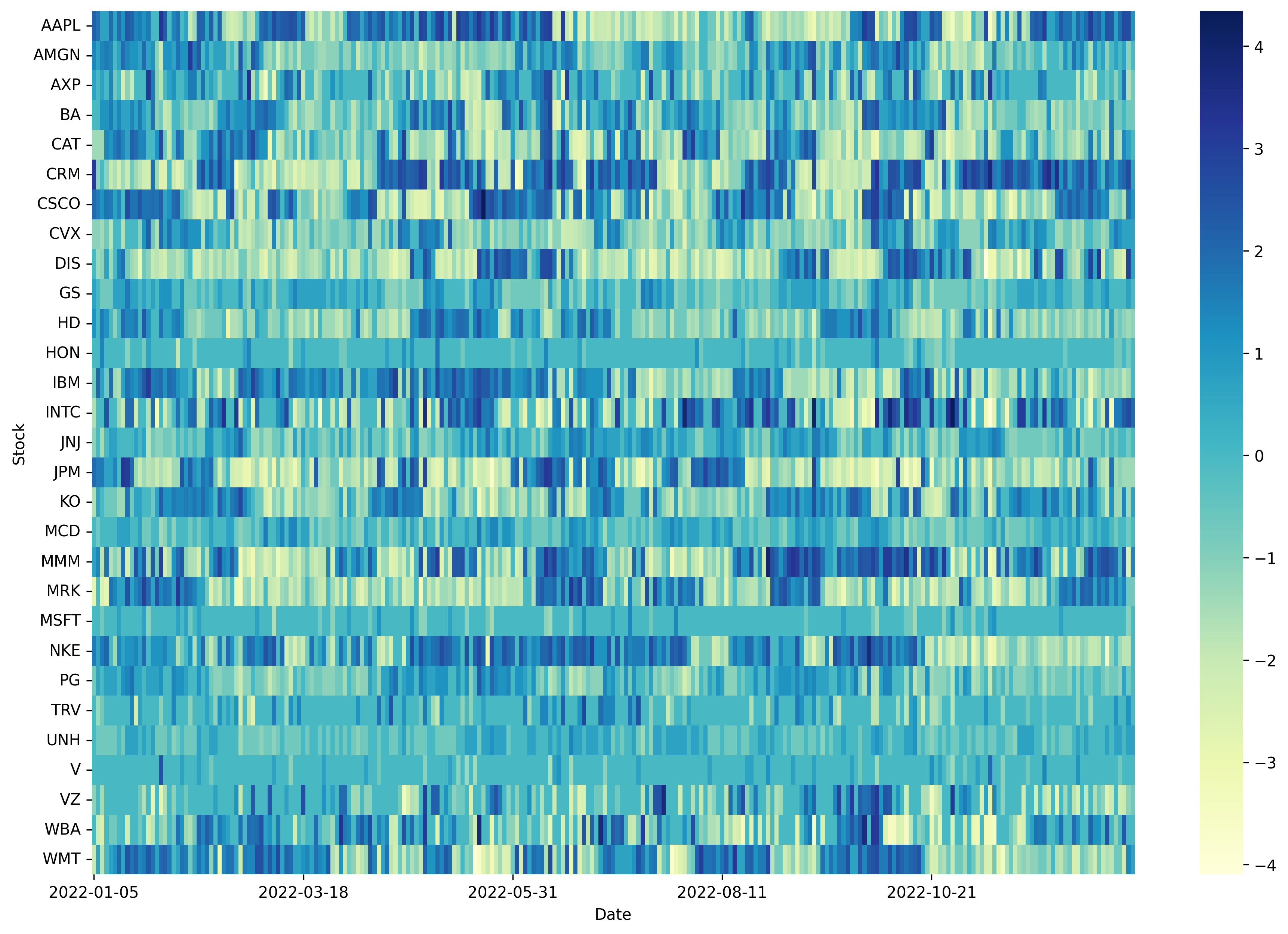

🖼️ 关键图片

📊 实验亮点

实验结果表明,HRT在牛市和熊市中均优于传统的DRL模型和S&P 500指数。具体而言,HRT实现了更高的夏普比率,表明其在风险调整后的收益方面表现更佳。在某些测试场景下,HRT的夏普比率比基线模型提高了显著幅度,证明了其有效性。

🎯 应用场景

HRT具有广泛的应用前景,可应用于自动化股票交易、量化投资、智能投顾等领域。该研究成果有助于开发更智能、更高效的交易算法,降低交易成本,提高投资收益,并为投资者提供更个性化的投资建议。未来,该方法还可以扩展到其他金融市场,如期货、外汇等。

📄 摘要(原文)

Leveraging Deep Reinforcement Learning (DRL) in automated stock trading has shown promising results, yet its application faces significant challenges, including the curse of dimensionality, inertia in trading actions, and insufficient portfolio diversification. Addressing these challenges, we introduce the Hierarchical Reinforced Trader (HRT), a novel trading strategy employing a bi-level Hierarchical Reinforcement Learning framework. The HRT integrates a Proximal Policy Optimization (PPO)-based High-Level Controller (HLC) for strategic stock selection with a Deep Deterministic Policy Gradient (DDPG)-based Low-Level Controller (LLC) tasked with optimizing trade executions to enhance portfolio value. In our empirical analysis, comparing the HRT agent with standalone DRL models and the S&P 500 benchmark during both bullish and bearish market conditions, we achieve a positive and higher Sharpe ratio. This advancement not only underscores the efficacy of incorporating hierarchical structures into DRL strategies but also mitigates the aforementioned challenges, paving the way for designing more profitable and robust trading algorithms in complex markets.