Think Beyond Size: Adaptive Prompting for More Effective Reasoning

作者: Kamesh R

分类: cs.LG, cs.CL

发布日期: 2024-10-10 (更新: 2024-11-29)

备注: Submitted to ICLR 2025. This is a preprint version. Future revisions will include additional evaluations and refinements

💡 一句话要点

提出自适应Prompting,提升LLM在复杂推理任务上的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自适应Prompting 大型语言模型 复杂推理 思维链 迭代推理 中间验证 自我纠正

📋 核心要点

- 现有CoT等方法依赖静态Prompting模板,无法适应任务复杂性和推理错误。

- 提出自适应Prompting框架,动态调整Prompt结构和验证机制,增强推理能力。

- 实验表明,该方法在多种推理任务上显著提升性能,小模型可媲美GPT-4。

📝 摘要(中文)

预训练的大型语言模型(LLM)作为少样本学习器,在各种自然语言处理(NLP)任务中得到越来越广泛的应用。诸如思维链(CoT)Prompting等最新技术,通过引入逐步分解,显著提升了多步推理能力,并在复杂的推理基准测试中取得了最先进的结果。然而,这些方法通常依赖于静态的Prompting模板,无法适应任务的复杂性或推理过程中的错误。本文提出了一种自适应Prompting框架,该框架是动态和迭代的,旨在通过实时调整Prompt结构和验证机制来增强推理能力。实验结果表明,自适应Prompting显著提高了在各种推理基准测试中的性能,包括算术推理(GSM8K、MultiArith)、逻辑推理和常识任务,与静态Prompting基线相比,实现了显著的准确率提升。通过集成引导式Prompt、中间验证和自我纠正步骤,我们的方法使较小的模型能够与较大的模型(如GPT-4)实现具有竞争力的性能,同时保持计算效率。该框架无需微调或特定于任务的训练数据即可实现这一点,突出了迭代推理方法的未开发潜力。

🔬 方法详解

问题定义:现有的大型语言模型在复杂推理任务中,通常采用静态的Prompting策略,例如思维链(CoT)。这些静态Prompting方法无法根据任务的难度或推理过程中的错误进行调整,导致性能受限。尤其是在需要多步推理的任务中,一步出错可能导致全局错误,而静态Prompting无法有效纠正这些错误。

核心思路:本文的核心思路是引入动态和迭代的Prompting机制,使模型能够根据当前的推理状态和中间结果,自适应地调整Prompt结构。通过实时反馈和验证,模型可以识别并纠正推理过程中的错误,从而提高整体的推理准确性。这种自适应性使得模型能够更好地应对不同复杂度的任务,并充分利用自身的推理能力。

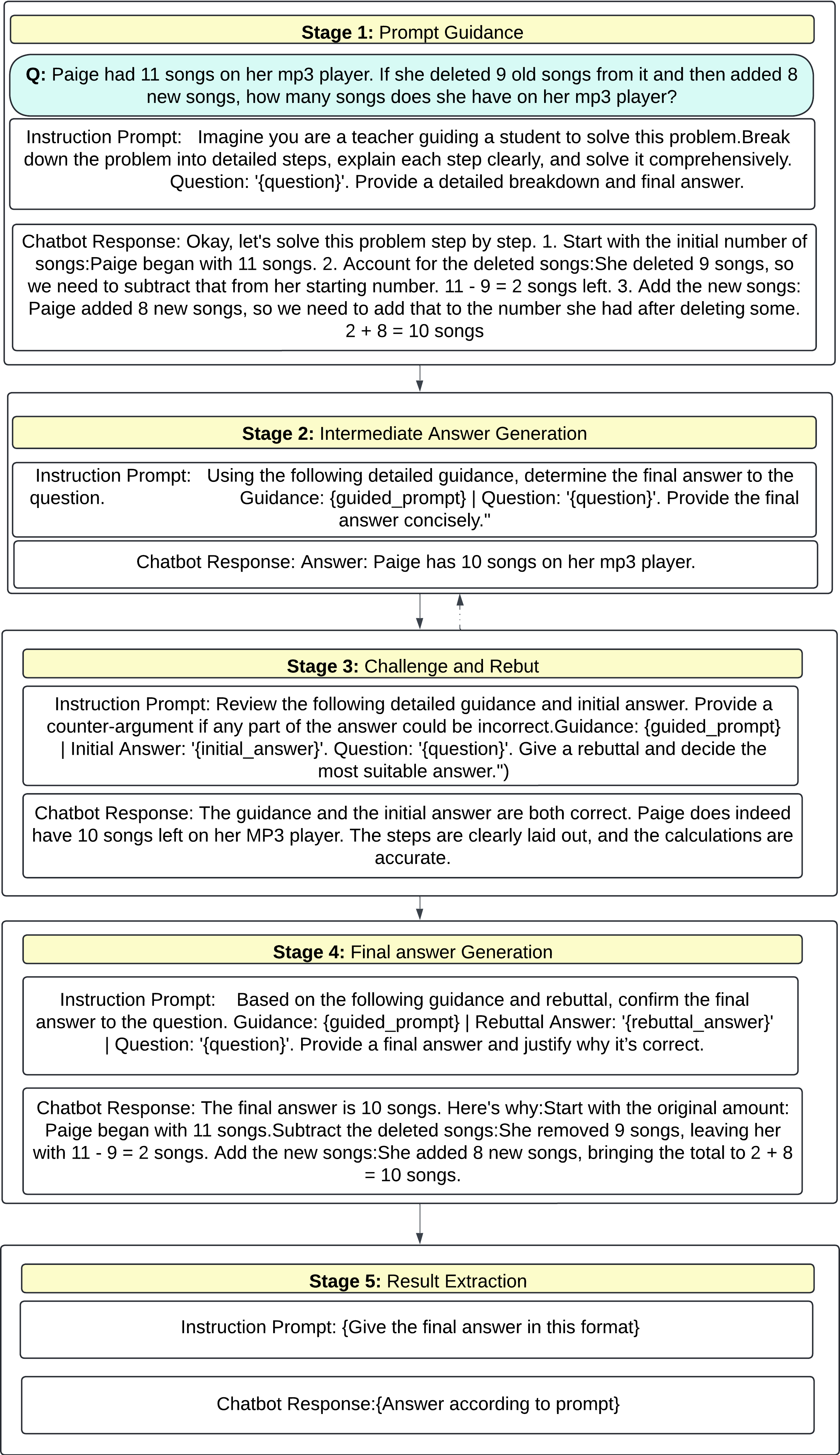

技术框架:自适应Prompting框架包含以下几个主要模块:1) 引导式Prompt生成:根据任务类型和当前推理状态,生成合适的Prompt,引导模型进行下一步推理。2) 中间验证:在推理的每个步骤之后,对中间结果进行验证,判断其是否合理。3) 自我纠正:如果中间结果不合理,则触发自我纠正机制,调整Prompt或重新进行推理。整个过程是迭代进行的,直到得到最终的答案或达到最大迭代次数。

关键创新:最重要的技术创新点在于Prompt的自适应调整和中间结果的实时验证。与传统的静态Prompting方法不同,自适应Prompting能够根据任务的特点和模型的推理过程,动态地调整Prompt的内容和结构,从而更好地引导模型进行推理。中间验证机制能够及时发现并纠正推理过程中的错误,避免错误累积。

关键设计:具体的Prompt调整策略可以根据任务类型进行设计,例如,在算术推理任务中,可以根据中间结果的数值范围调整Prompt中的数值范围。中间验证机制可以通过设定阈值或使用额外的验证模型来实现。自我纠正机制可以通过重新生成Prompt或调整推理步骤来实现。关键在于设计有效的Prompt调整策略和验证机制,以提高模型的推理准确性和效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,自适应Prompting在GSM8K和MultiArith等算术推理任务以及逻辑推理和常识任务上均取得了显著的性能提升。与静态Prompting基线相比,准确率得到了大幅提高。更重要的是,该方法使得较小的模型能够与GPT-4等大型模型实现具有竞争力的性能,同时保持了计算效率,突出了其在资源受限场景下的优势。

🎯 应用场景

该研究成果可广泛应用于需要复杂推理能力的场景,例如智能客服、金融分析、医疗诊断等。通过自适应Prompting,可以提升LLM在这些领域的应用效果,提高决策的准确性和可靠性。未来,该技术有望进一步发展,实现更智能、更高效的推理能力,推动人工智能在各个领域的应用。

📄 摘要(原文)

Pretrained large language models (LLMs) are increasingly utilized across a wide range of natural language processing (NLP) tasks due to their impressive capabilities as few-shot learners. Recent techniques, such as chain-of-thought (CoT) prompting, have significantly advanced multi-step reasoning by introducing step-by-step decomposition, achieving state-of-the-art results on complex reasoning benchmarks. However, these approaches often rely on static prompting templates that do not adapt to task complexity or errors during the reasoning process. In this work, we introduce Adaptive Prompting, a dynamic and iterative framework designed to enhance reasoning by incorporating real-time adjustments to prompt structures and validation mechanisms.Experimental results demonstrate that Adaptive Prompting significantly improves performance on diverse reasoning benchmarks, including arithmetic reasoning (GSM8K, MultiArith), logical reasoning and commonsense tasks, achieving substantial accuracy gains compared to static prompting baselines. By integrating guided prompts, intermediate validation, and self-corrective steps, our approach enables smaller models to achieve competitive performance with larger counterparts, such as GPT-4, while maintaining computational efficiency. The framework achieves this without requiring fine-tuning or task-specific training data, highlighting the untapped potential of iterative reasoning methods.