Parameter Efficient Fine-tuning via Explained Variance Adaptation

作者: Fabian Paischer, Lukas Hauzenberger, Thomas Schmied, Benedikt Alkin, Marc Peter Deisenroth, Sepp Hochreiter

分类: cs.LG, cs.AI, cs.CL, stat.ML

发布日期: 2024-10-09 (更新: 2025-10-20)

备注: Accepted at NeurIPS 2025, Shared first authorship, Code available at https://github.com/ml-jku/EVA

💡 一句话要点

提出EVA初始化方法,通过激活方差自适应实现高效参数微调

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 参数高效微调 低秩适应 LoRA 激活方差 奇异值分解

📋 核心要点

- 现有LoRA初始化方法依赖SVD,但未能充分利用梯度信号,导致微调效率受限。

- EVA通过捕捉激活方差最大的方向初始化LoRA,最大化梯度信号,加速微调过程。

- 实验表明,EVA在多种任务中收敛速度更快,性能更高,同时减少了可训练参数。

📝 摘要(中文)

本文提出了一种名为解释方差自适应(EVA)的初始化方案,用于高效微调预训练的基础模型。现有LoRA初始化方法通常依赖于梯度或权重矩阵的奇异值分解(SVD),但无法保证最大化期望梯度信号,这对于快速适应至关重要。EVA通过捕捉激活方差最大的方向来初始化LoRA,从而最大化期望梯度信号并加速微调。EVA对激活向量的小批量数据执行增量SVD,并在收敛后选择合适的右奇异向量进行初始化。此外,EVA还能根据给定的秩预算选择捕捉最多激活方差的方向,从而实现自适应秩,减少可训练参数的数量。实验表明,在语言生成、语言理解、图像分类和强化学习等多种微调任务中,EVA比现有方法收敛更快,并在每个领域的多项任务中实现了最高的平均分数,同时通过秩重新分配减少了可训练参数的数量。EVA在准确性和效率方面都优于现有的LoRA初始化方案。

🔬 方法详解

问题定义:论文旨在解决基础模型微调过程中,现有低秩适应(LoRA)初始化方法效率不高的问题。现有方法,如基于梯度或权重矩阵SVD的初始化,无法保证最大化期望梯度信号,导致微调速度慢,资源消耗大。

核心思路:论文的核心思路是利用激活方差信息来指导LoRA的初始化。具体来说,选择能够捕捉激活方差最大方向的向量来初始化LoRA,从而最大化期望梯度信号,加速微调过程。这种方法基于的假设是,激活方差大的方向包含了模型学习到的最重要的特征信息。

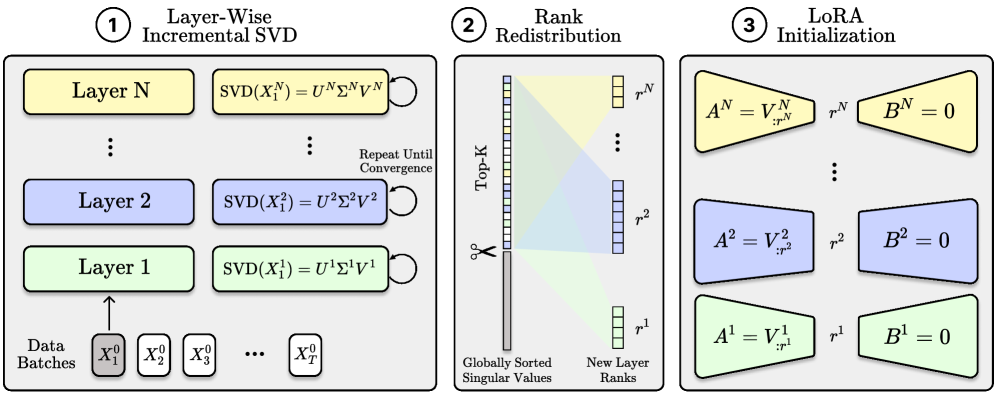

技术框架:EVA的整体流程如下:1. 收集激活向量的小批量数据。2. 对这些数据执行增量SVD。3. 监控奇异向量的收敛情况。4. 一旦收敛,选择右奇异向量用于LoRA的初始化。5. 根据给定的秩预算,自适应地调整LoRA的秩,进一步减少可训练参数的数量。

关键创新:EVA最重要的创新点在于其初始化策略,它不再依赖于梯度或权重矩阵的SVD,而是直接利用激活方差信息。与现有方法相比,EVA能够更有效地利用梯度信号,从而加速微调过程。此外,EVA还引入了自适应秩调整机制,进一步提高了参数效率。

关键设计:EVA的关键设计包括:1. 增量SVD的实现细节,例如如何高效地计算和更新奇异向量。2. 收敛判据的选择,用于确定何时停止增量SVD并选择右奇异向量。3. 自适应秩调整的策略,例如如何根据激活方差信息来确定每个LoRA层的秩。4. 如何将EVA集成到现有的LoRA框架中,使其能够与不同的基础模型和微调任务兼容。

🖼️ 关键图片

📊 实验亮点

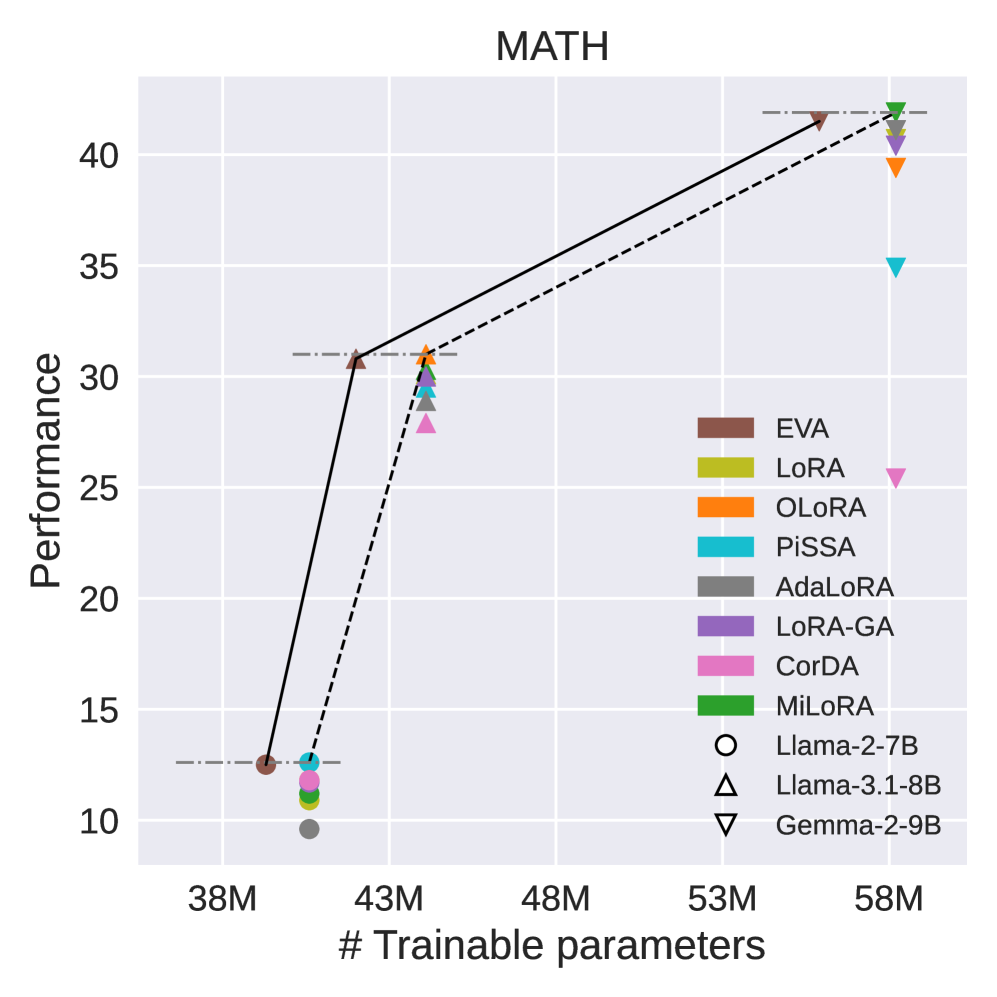

实验结果表明,EVA在多个领域的任务中均优于现有的LoRA初始化方法。例如,在语言生成任务中,EVA比现有方法收敛速度更快,BLEU得分更高。在图像分类任务中,EVA在ImageNet数据集上取得了更高的准确率,同时减少了可训练参数的数量。通过秩重新分配,EVA进一步提升了参数效率,在准确性和效率方面都优于现有的LoRA初始化方案。

🎯 应用场景

EVA可广泛应用于各种需要对预训练基础模型进行微调的场景,例如自然语言处理中的文本生成、文本分类,计算机视觉中的图像分类、目标检测,以及强化学习中的策略优化等。该方法能够显著提高微调效率,降低计算成本,加速模型部署,具有重要的实际应用价值。

📄 摘要(原文)

Foundation models (FMs) are pre-trained on large-scale datasets and then fine-tuned for a specific downstream task. The most common fine-tuning method is to update pretrained weights via low-rank adaptation (LoRA). Existing initialization strategies for LoRA often rely on singular value decompositions (SVD) of gradients or weight matrices. However, they do not provably maximize the expected gradient signal, which is critical for fast adaptation. To this end, we introduce Explained Variance Adaptation (EVA), an initialization scheme that uses the directions capturing the most activation variance, provably maximizing the expected gradient signal and accelerating fine-tuning. EVA performs incremental SVD on minibatches of activation vectors and selects the right-singular vectors for initialization once they converged. Further, by selecting the directions that capture the most activation-variance for a given rank budget, EVA accommodates adaptive ranks that reduce the number of trainable parameters. We apply EVA to a variety of fine-tuning tasks as language generation and understanding, image classification, and reinforcement learning. EVA exhibits faster convergence than competitors and achieves the highest average score across a multitude of tasks per domain while reducing the number of trainable parameters through rank redistribution. In summary, EVA establishes a new Pareto frontier compared to existing LoRA initialization schemes in both accuracy and efficiency.