fLSA: Learning Semantic Structures in Document Collections Using Foundation Models

作者: Weijia Xu, Nebojsa Jojic, Nicolas Le Roux

分类: cs.LG

发布日期: 2024-10-07 (更新: 2025-08-26)

备注: EMNLP 2025 Camera Ready

🔗 代码/项目: GITHUB

💡 一句话要点

fLSA:利用基础模型学习文档集合中的语义结构,提升文本重建与生成质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 潜在语义分析 基础模型 文档聚类 文本生成 层次化采样 语义标签 上下文学习

📋 核心要点

- 现有文本建模方法难以有效捕捉文档集合中的高层语义结构,限制了文本重建和生成质量。

- fLSA利用大型语言模型,通过迭代聚类和标记文档片段,学习文档的潜在语义结构。

- 实验表明,fLSA标签在文本重建方面优于现有方法,且能引导层次化采样生成更准确的文本。

📝 摘要(中文)

本文提出了一种基于基础模型的潜在语义分析方法fLSA,该方法通过文档级别的上下文信息迭代地聚类和标记文档片段。这些标签可用于建模给定文档的潜在结构,并用于新文本的层次化采样。在故事写作、数学和多步推理数据集上的实验表明,fLSA标签在重建原始文本方面比现有的标记方法更具信息量。此外,当用于层次化采样时,fLSA标签有助于在正确的方向上扩展输出空间,从而比直接采样和使用现有标记方法的层次化采样更频繁地获得正确的解决方案。

🔬 方法详解

问题定义:现有方法在建模文档集合的语义结构时,通常难以捕捉到高层次的抽象概念和文档间的关联性。这导致在文本重建和生成任务中,模型无法有效地理解和利用文档的潜在语义信息,从而影响最终的性能。现有标签方法的信息量不足,无法有效指导文本生成。

核心思路:fLSA的核心思路是利用大型语言模型(Foundation Models)的强大语义理解能力,通过迭代地聚类和标记文档片段,从而学习文档集合的潜在语义结构。通过文档级别的上下文信息指导标签的生成,使得标签能够更好地反映文档的整体语义。

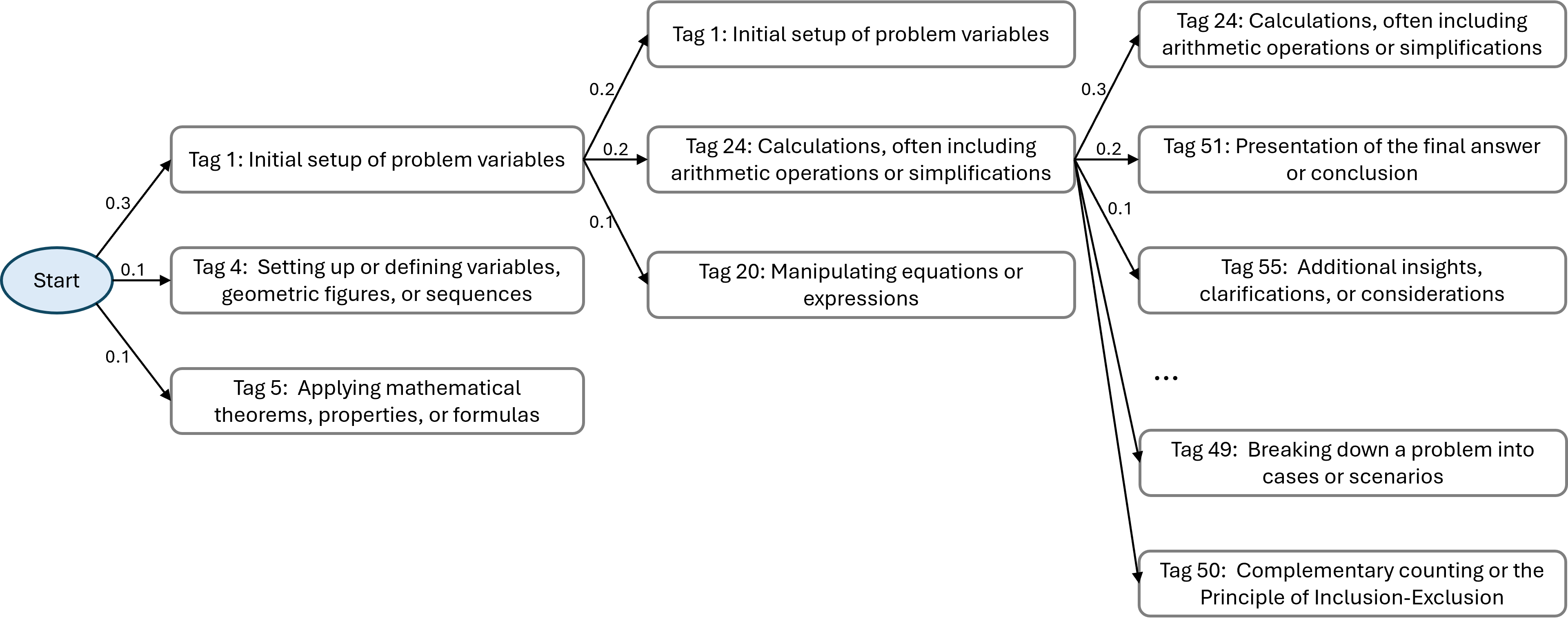

技术框架:fLSA方法包含以下主要步骤:1) 文档分割:将文档分割成片段。2) 上下文编码:利用基础模型对文档级别的上下文信息进行编码。3) 迭代聚类和标记:基于上下文编码,迭代地聚类文档片段,并利用基础模型为每个簇生成语义标签。4) 结构建模:利用生成的标签对文档的潜在结构进行建模。5) 层次化采样:利用学习到的语义结构进行层次化采样,生成新的文本。

关键创新:fLSA的关键创新在于利用基础模型进行迭代的聚类和标记,从而能够学习到更具信息量的语义标签。与传统的潜在语义分析方法相比,fLSA能够更好地捕捉文档的潜在语义结构,并将其用于指导文本生成。此外,fLSA利用文档级别的上下文信息来指导标签的生成,使得标签能够更好地反映文档的整体语义。

关键设计:fLSA的关键设计包括:1) 使用大型语言模型(如BERT、GPT)作为基础模型,以获得强大的语义理解能力。2) 设计迭代的聚类和标记算法,以逐步 refinement 语义标签。3) 使用文档级别的上下文信息来指导标签的生成。4) 设计合适的损失函数,以优化聚类和标记过程。具体的参数设置和网络结构取决于所使用的基础模型和数据集。

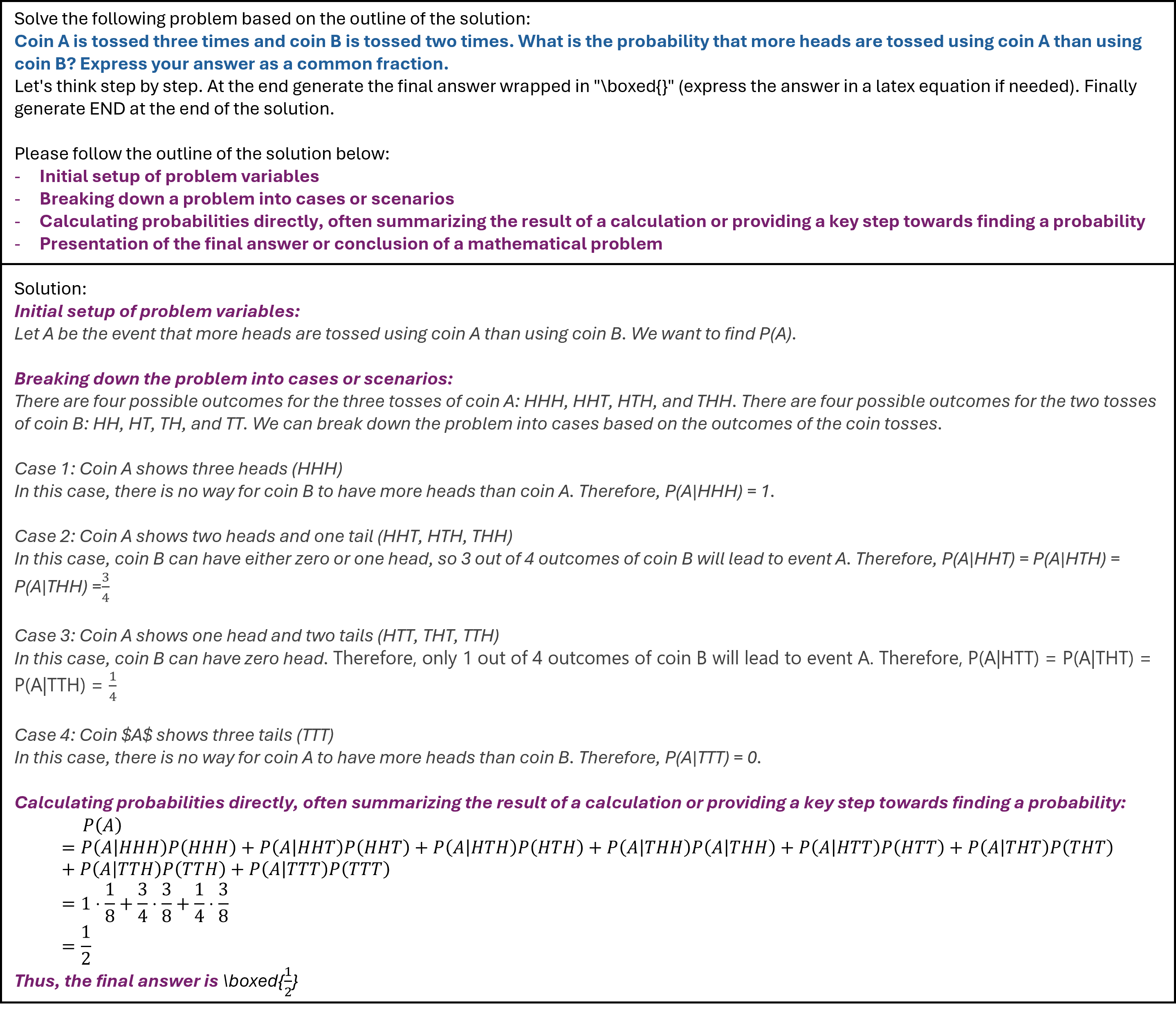

🖼️ 关键图片

📊 实验亮点

实验结果表明,fLSA在故事写作、数学和多步推理数据集上均取得了显著的性能提升。具体而言,fLSA标签在重建原始文本方面比现有方法更具信息量。在层次化采样任务中,fLSA标签能够引导模型生成更准确的文本,从而获得更高的正确率。代码已开源。

🎯 应用场景

fLSA方法可应用于多种文本生成和理解任务,例如故事创作、数学问题求解、多步推理等。该方法能够提升文本生成的质量和准确性,并可用于构建更智能的文本生成系统。此外,fLSA还可以应用于文档聚类、信息检索等领域,帮助用户更好地理解和利用文档集合中的信息。

📄 摘要(原文)

Humans can learn to solve new tasks by inducing high-level strategies from example solutions to similar problems and then adapting these strategies to solve unseen problems. Can we use large language models to induce such high-level structure from example documents or solutions? We introduce fLSA, a foundation-model-based Latent Semantic Analysis method that iteratively clusters and tags document segments based on document-level contexts. These tags can be used to model the latent structure of given documents and for hierarchical sampling of new texts. Our experiments on story writing, math, and multi-step reasoning datasets demonstrate that fLSA tags are more informative in reconstructing the original texts than existing tagging methods. Moreover, when used for hierarchical sampling, fLSA tags help expand the output space in the right directions that lead to correct solutions more often than direct sampling and hierarchical sampling with existing tagging methods. Code: https://github.com/microsoft/fLSA