SimO Loss: Anchor-Free Contrastive Loss for Fine-Grained Supervised Contrastive Learning

作者: Taha Bouhsine, Imad El Aaroussi, Atik Faysal, Wang Huaxia

分类: cs.LG, cs.AI, cs.CV

发布日期: 2024-10-07

💡 一句话要点

提出SimO损失的无锚点对比学习方法,实现细粒度监督对比学习

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 对比学习 无锚点学习 细粒度分类 监督学习 嵌入空间 正交性 相似性

📋 核心要点

- 现有对比学习方法在细粒度区分上存在不足,难以同时优化类内聚合和类间分离。

- 提出SimO损失,通过同时优化相似样本的距离和正交性,以及不同样本的距离和正交性,实现细粒度对比学习。

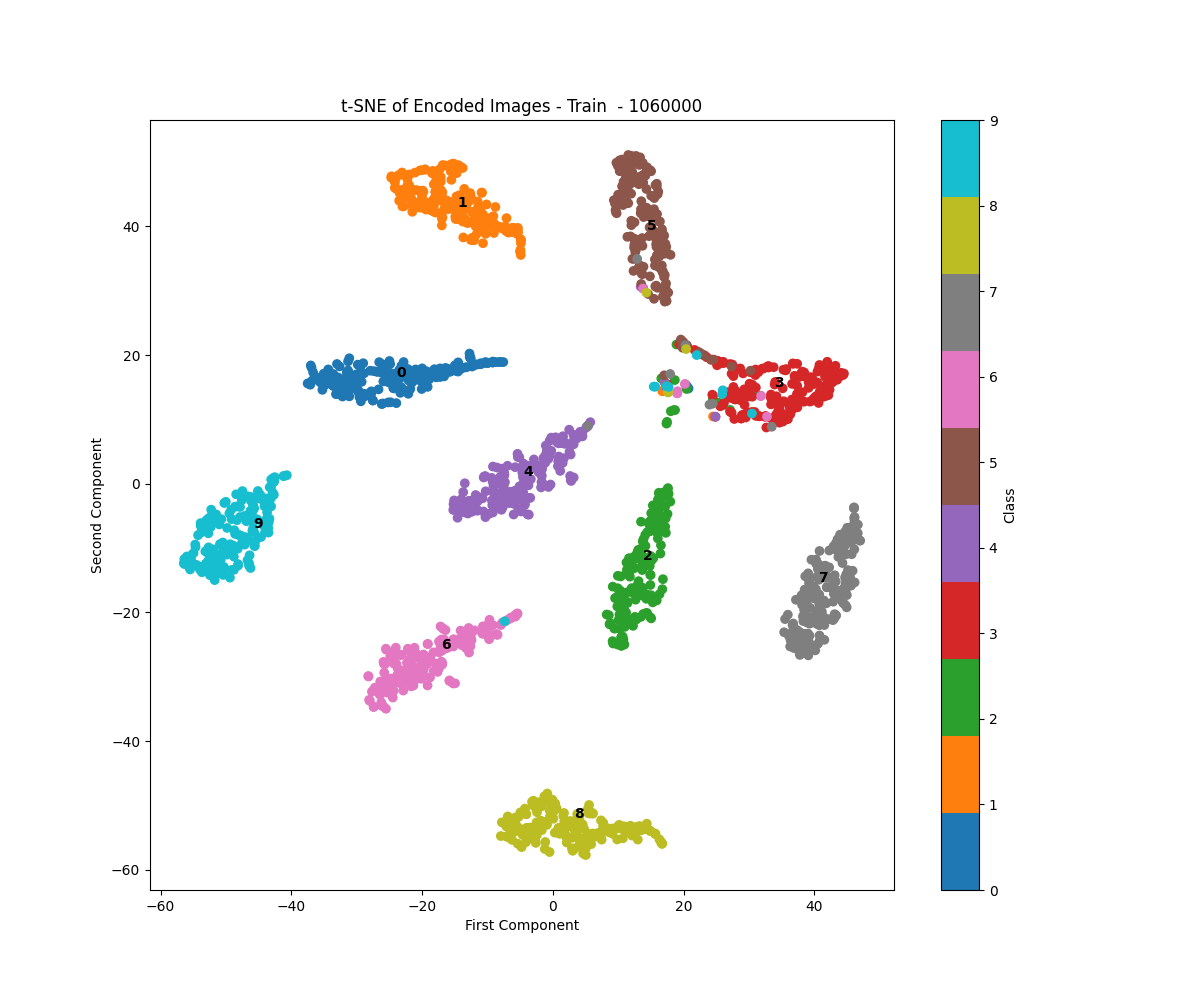

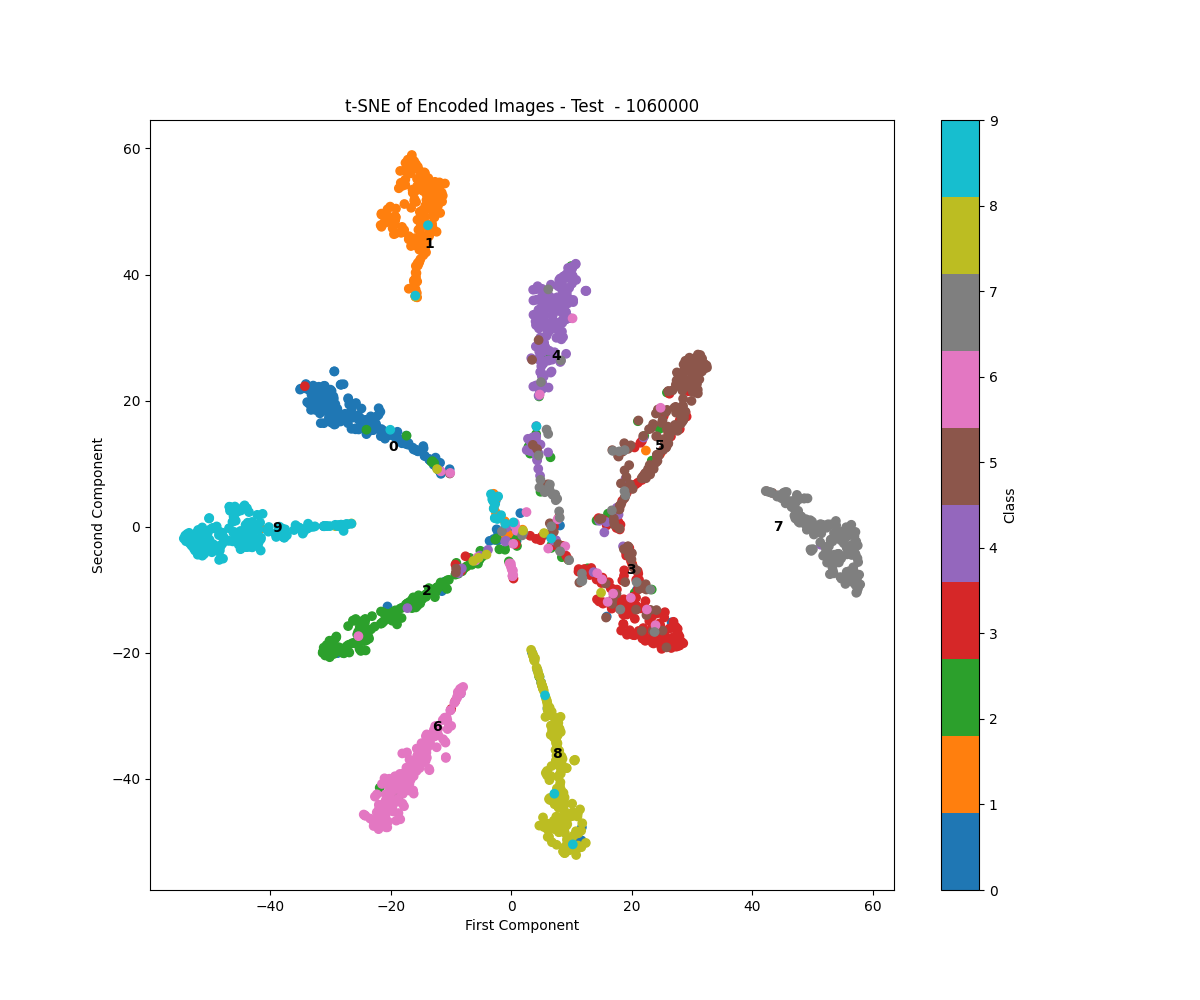

- 在CIFAR-10数据集上的实验表明,该方法能够形成清晰、正交的类邻域,提升嵌入空间的结构化程度。

📝 摘要(中文)

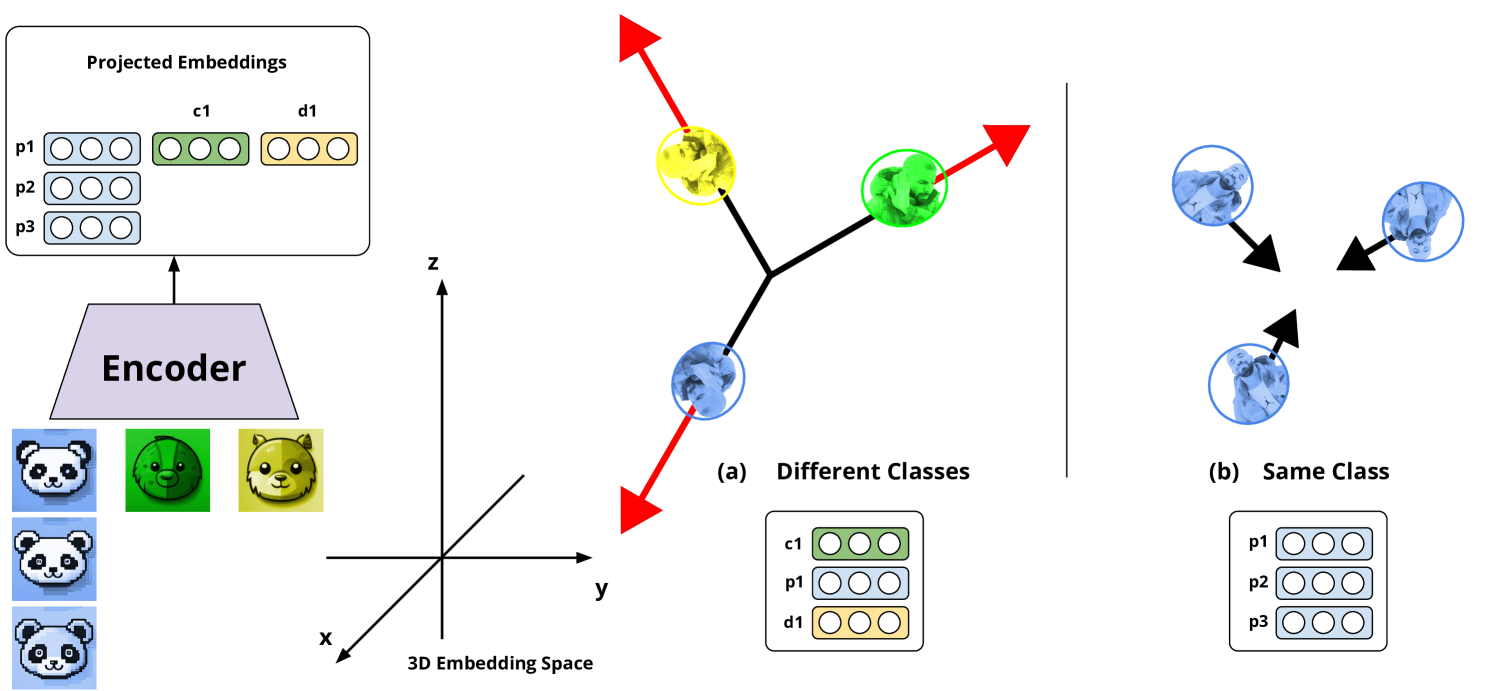

本文提出了一种新颖的无锚点对比学习(AFCL)方法,该方法利用了我们提出的相似性-正交性(SimO)损失。我们的方法最小化了一个半度量判别损失函数,该函数同时优化两个关键目标:减少相似输入的嵌入之间的距离和正交性,同时最大化不同输入的这些度量,从而促进更细粒度的对比学习。由SimO损失驱动的AFCL方法在嵌入空间中创建了一个纤维束拓扑结构,形成特定于类的、内部有凝聚力但正交的邻域。我们在CIFAR-10数据集上验证了我们方法的有效性,并提供了可视化,展示了SimO损失对嵌入空间的影响。我们的结果表明形成了不同的、正交的类邻域,展示了该方法创建良好结构化嵌入的能力,这些嵌入平衡了类分离和类内变异。这项工作为理解和利用各种机器学习任务中学习表征的几何属性开辟了新的途径。

🔬 方法详解

问题定义:现有监督对比学习方法通常依赖于锚点样本,且难以在嵌入空间中同时优化类内聚合和类间分离,尤其是在细粒度分类任务中,类内差异较大,类间相似性较高的情况下,区分能力有限。现有方法无法有效平衡类内紧凑性和类间区分性,导致学习到的特征表示泛化能力不足。

核心思路:SimO损失的核心思想是通过同时优化嵌入空间中相似样本的距离和正交性,以及不同样本的距离和正交性,从而实现细粒度的对比学习。具体来说,对于相似的样本,SimO损失鼓励它们的嵌入向量彼此靠近(距离小)且尽可能正交,以捕捉类内的多样性;对于不相似的样本,SimO损失则鼓励它们的嵌入向量彼此远离(距离大)且尽可能不正交,以实现类间的区分。

技术框架:该方法主要包含两个阶段:特征提取和对比学习。首先,使用一个神经网络(例如ResNet)提取输入样本的特征表示。然后,将这些特征表示输入到SimO损失函数中进行优化。SimO损失函数计算样本之间的相似性和正交性,并根据样本的类别标签调整损失值。整个训练过程旨在最小化SimO损失,从而学习到具有良好类内聚合和类间分离的嵌入空间。

关键创新:该方法最重要的技术创新点在于提出了SimO损失函数,它是一种无锚点的对比学习损失,能够同时优化相似样本的距离和正交性,以及不同样本的距离和正交性。与传统的对比学习方法相比,SimO损失不需要选择锚点样本,避免了锚点选择带来的偏差,并且能够更好地捕捉类内的多样性和类间的区分性。

关键设计:SimO损失函数的设计是关键。它包含两个部分:相似性损失和正交性损失。相似性损失衡量样本之间的距离,正交性损失衡量样本之间的角度。对于相似的样本,相似性损失鼓励它们彼此靠近,正交性损失鼓励它们尽可能正交。对于不相似的样本,相似性损失鼓励它们彼此远离,正交性损失鼓励它们尽可能不正交。损失函数的具体形式未知,需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

论文在CIFAR-10数据集上验证了SimO损失的有效性,通过可视化展示了SimO损失对嵌入空间的影响,结果表明该方法能够形成清晰、正交的类邻域,表明该方法能够创建良好结构化的嵌入,平衡了类分离和类内变异。具体的性能数据和对比基线未知,需要参考论文原文。

🎯 应用场景

该研究成果可应用于图像分类、目标检测、人脸识别等计算机视觉任务,尤其是在需要细粒度区分的场景下,例如动植物识别、医学图像分析等。通过学习到更具区分性的特征表示,可以提高模型的准确性和鲁棒性,并为后续的下游任务提供更好的基础。

📄 摘要(原文)

We introduce a novel anchor-free contrastive learning (AFCL) method leveraging our proposed Similarity-Orthogonality (SimO) loss. Our approach minimizes a semi-metric discriminative loss function that simultaneously optimizes two key objectives: reducing the distance and orthogonality between embeddings of similar inputs while maximizing these metrics for dissimilar inputs, facilitating more fine-grained contrastive learning. The AFCL method, powered by SimO loss, creates a fiber bundle topological structure in the embedding space, forming class-specific, internally cohesive yet orthogonal neighborhoods. We validate the efficacy of our method on the CIFAR-10 dataset, providing visualizations that demonstrate the impact of SimO loss on the embedding space. Our results illustrate the formation of distinct, orthogonal class neighborhoods, showcasing the method's ability to create well-structured embeddings that balance class separation with intra-class variability. This work opens new avenues for understanding and leveraging the geometric properties of learned representations in various machine learning tasks.