Large Language Models for Knowledge-Free Network Management: Feasibility Study and Opportunities

作者: Hoon Lee, Mintae Kim, Seunghwan Baek, Namyoon Lee, Merouane Debbah, Inkyu Lee

分类: cs.NI, cs.IT, cs.LG

发布日期: 2024-10-06

💡 一句话要点

利用大型语言模型实现知识无关的网络管理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 网络管理 知识无关优化 资源分配 GPT-3.5-Turbo

📋 核心要点

- 现有网络管理算法依赖先验知识,缺乏通用性,难以适应复杂多变的网络环境。

- 论文提出利用大型语言模型(LLM)的强大推理能力,构建知识无关的优化器,无需系统先验知识。

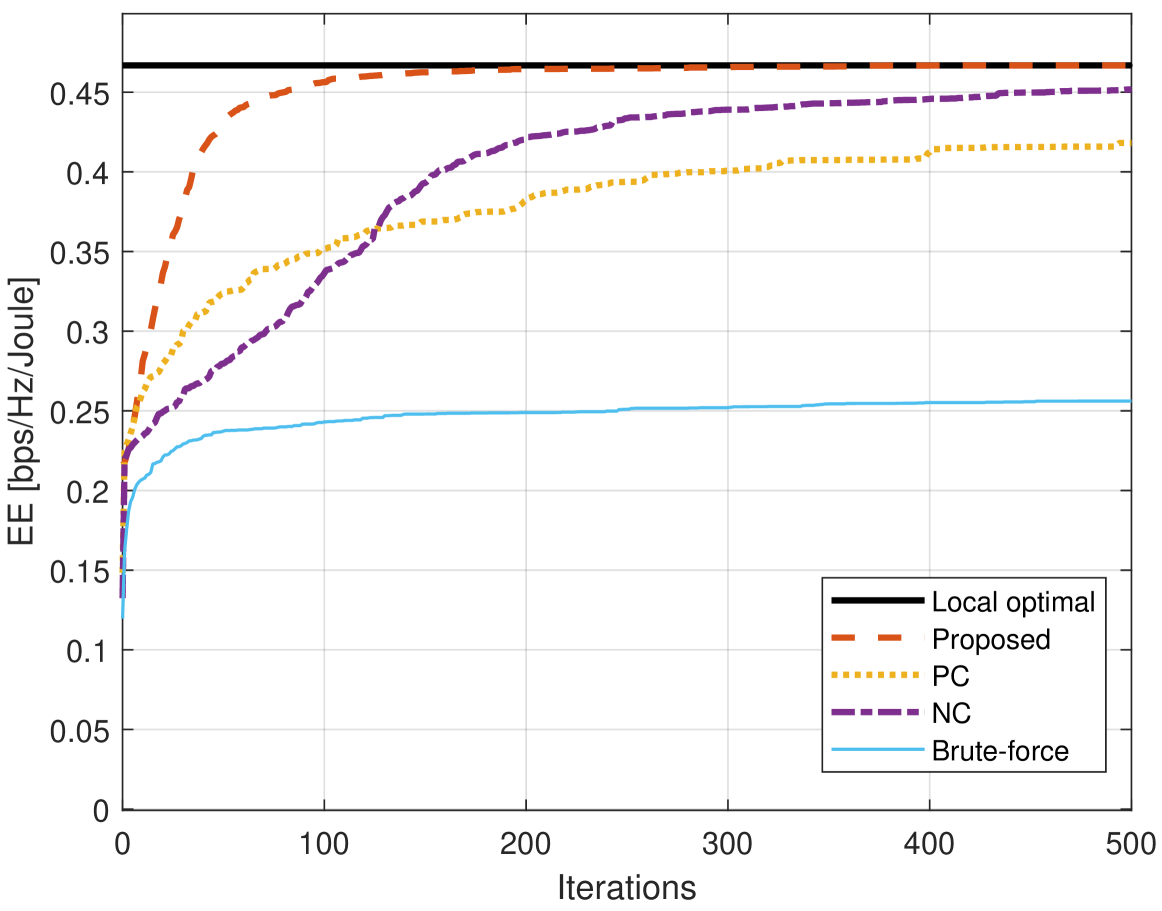

- 实验结果表明,基于GPT-3.5-Turbo的LLM优化器在资源管理问题上可达到与传统算法相当的性能。

📝 摘要(中文)

传统的网络管理算法依赖于系统模型和网络场景的先验知识。在实践中,人们期望有一个通用的优化框架,其中一个单独的优化模块可以很容易地应用于任意的网络管理任务,而无需任何系统知识。为此,需要知识无关的优化技术,其操作独立于特定场景的信息,包括目标函数、系统参数和网络设置。这种范式转变方法的主要挑战是需要一个超智能的黑盒优化器,它可以使用其内部推理能力来建立有效的决策策略。本文提出了一种新颖的知识无关的网络管理范式,它利用了被称为大型语言模型(LLM)的基础模型的力量。LLM在大量数据集上进行训练,可以理解来自包含最少系统信息的输入提示的重要上下文,从而即使对于全新的任务也能提供卓越的推理性能。预训练的LLM可以潜在地用作通用网络优化的基础模型。通过消除对先验知识的依赖,LLM可以无缝地应用于各种网络管理任务。使用GPT-3.5-Turbo对资源管理问题验证了这种方法的可行性。数值结果表明,知识无关的LLM优化器能够达到与现有基于知识的优化算法相当的性能。

🔬 方法详解

问题定义:传统网络管理算法需要预先了解系统模型和网络场景,这限制了其通用性和适应性。针对不同的网络管理任务,需要设计不同的优化算法,成本高昂且效率低下。因此,如何设计一种无需先验知识,能够适应各种网络管理任务的通用优化框架是一个关键问题。

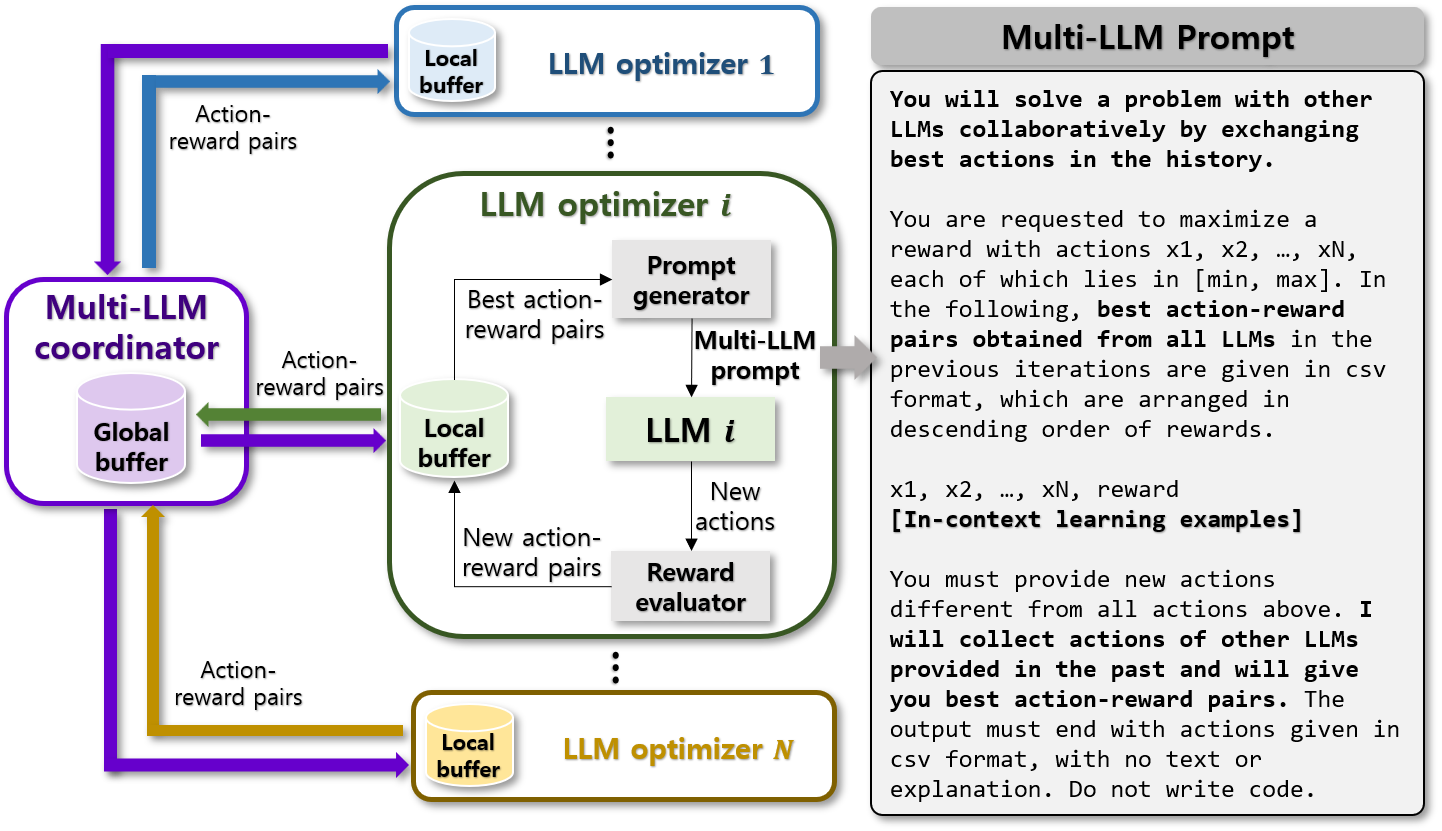

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的推理能力,将LLM作为一个黑盒优化器,通过输入包含少量系统信息的提示(prompt),让LLM自主学习并做出决策。这种方法无需预先定义目标函数、系统参数等信息,从而实现了知识无关的优化。

技术框架:该方法的技术框架主要包括以下几个步骤:1. 确定网络管理任务,例如资源分配、流量控制等。2. 设计合适的提示(prompt),将任务描述和少量系统信息输入LLM。3. LLM根据提示进行推理,生成决策方案。4. 将决策方案应用到网络系统中,并评估其性能。5. 根据性能反馈,调整提示或LLM的参数,以进一步优化决策方案。

关键创新:该方法最重要的创新点在于将大型语言模型应用于网络管理领域,并实现了知识无关的优化。与传统的基于模型或规则的优化方法不同,该方法无需预先定义系统模型或规则,而是通过LLM的自主学习和推理能力来解决问题。这大大提高了网络管理算法的通用性和适应性。

关键设计:论文使用GPT-3.5-Turbo作为LLM,并通过实验验证了其在资源管理问题上的可行性。关键设计包括:1. 提示的设计:提示需要包含足够的信息,以便LLM能够理解任务目标和约束条件。2. 性能评估指标的选择:需要选择合适的性能评估指标来衡量决策方案的优劣。3. 反馈机制的设计:需要设计有效的反馈机制,以便根据性能反馈调整提示或LLM的参数。

🖼️ 关键图片

📊 实验亮点

论文使用GPT-3.5-Turbo在资源管理问题上进行了实验验证。实验结果表明,基于LLM的知识无关优化器能够达到与现有基于知识的优化算法相当的性能。这证明了利用LLM进行网络管理的 feasibility,并为未来的研究方向提供了有力的支持。

🎯 应用场景

该研究成果可应用于各种网络管理场景,例如无线资源分配、流量工程、网络安全等。通过利用LLM的强大推理能力,可以实现更加智能、高效和自适应的网络管理,降低运维成本,提升用户体验。未来,该方法有望成为下一代网络管理的关键技术。

📄 摘要(原文)

Traditional network management algorithms have relied on prior knowledge of system models and networking scenarios. In practice, a universal optimization framework is desirable where a sole optimization module can be readily applied to arbitrary network management tasks without any knowledge of the system. To this end, knowledge-free optimization techniques are necessary whose operations are independent of scenario-specific information including objective functions, system parameters, and network setups. The major challenge of this paradigm-shifting approach is the requirement of a hyper-intelligent black-box optimizer that can establish efficient decision-making policies using its internal reasoning capabilities. This article presents a novel knowledge-free network management paradigm with the power of foundation models called large language models (LLMs). Trained on vast amounts of datasets, LLMs can understand important contexts from input prompts containing minimal system information, thereby offering remarkable inference performance even for entirely new tasks. Pretrained LLMs can be potentially leveraged as foundation models for versatile network optimization. By eliminating the dependency on prior knowledge, LLMs can be seamlessly applied for various network management tasks. The viability of this approach is demonstrated for resource management problems using GPT-3.5-Turbo. Numerical results validate that knowledge-free LLM optimizers are able to achieve comparable performance to existing knowledge-based optimization algorithms.