Multimodal Large Language Models for Inverse Molecular Design with Retrosynthetic Planning

作者: Gang Liu, Michael Sun, Wojciech Matusik, Meng Jiang, Jie Chen

分类: cs.LG, physics.chem-ph, q-bio.BM

发布日期: 2024-10-05

备注: 27 pages, 11 figures, 4 tables

💡 一句话要点

Llamole:用于逆分子设计与逆合成规划的多模态大语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 大语言模型 分子逆设计 逆合成规划 图神经网络 图扩散模型 药物发现

📋 核心要点

- 现有大语言模型在处理图结构数据时面临挑战,限制了其在分子设计等领域的应用。

- Llamole通过结合图扩散Transformer和图神经网络,实现了文本和图的交错生成,从而进行分子逆设计。

- 实验结果表明,Llamole在分子设计和逆合成规划任务上显著优于其他模型,提升效果明显。

📝 摘要(中文)

现有大语言模型(LLMs)虽然集成了图像,但将其应用于图结构仍然具有挑战性,限制了其在材料和药物设计中的应用。这种困难源于需要在文本和图之间进行连贯的自回归生成。为了解决这个问题,我们提出了Llamole,这是第一个能够进行文本和图交错生成的多模态LLM,从而实现了基于逆合成规划的分子逆设计。Llamole将基础LLM与图扩散Transformer和图神经网络集成,用于文本中的多条件分子生成和反应推断,同时LLM通过增强的分子理解,灵活地控制不同图模块之间的激活。此外,Llamole集成了A*搜索和基于LLM的代价函数,以实现高效的逆合成规划。我们创建了基准数据集,并进行了广泛的实验,以评估Llamole与上下文学习和监督微调的性能。Llamole在可控分子设计和逆合成规划的12个指标上,显著优于14个经过调整的LLM。

🔬 方法详解

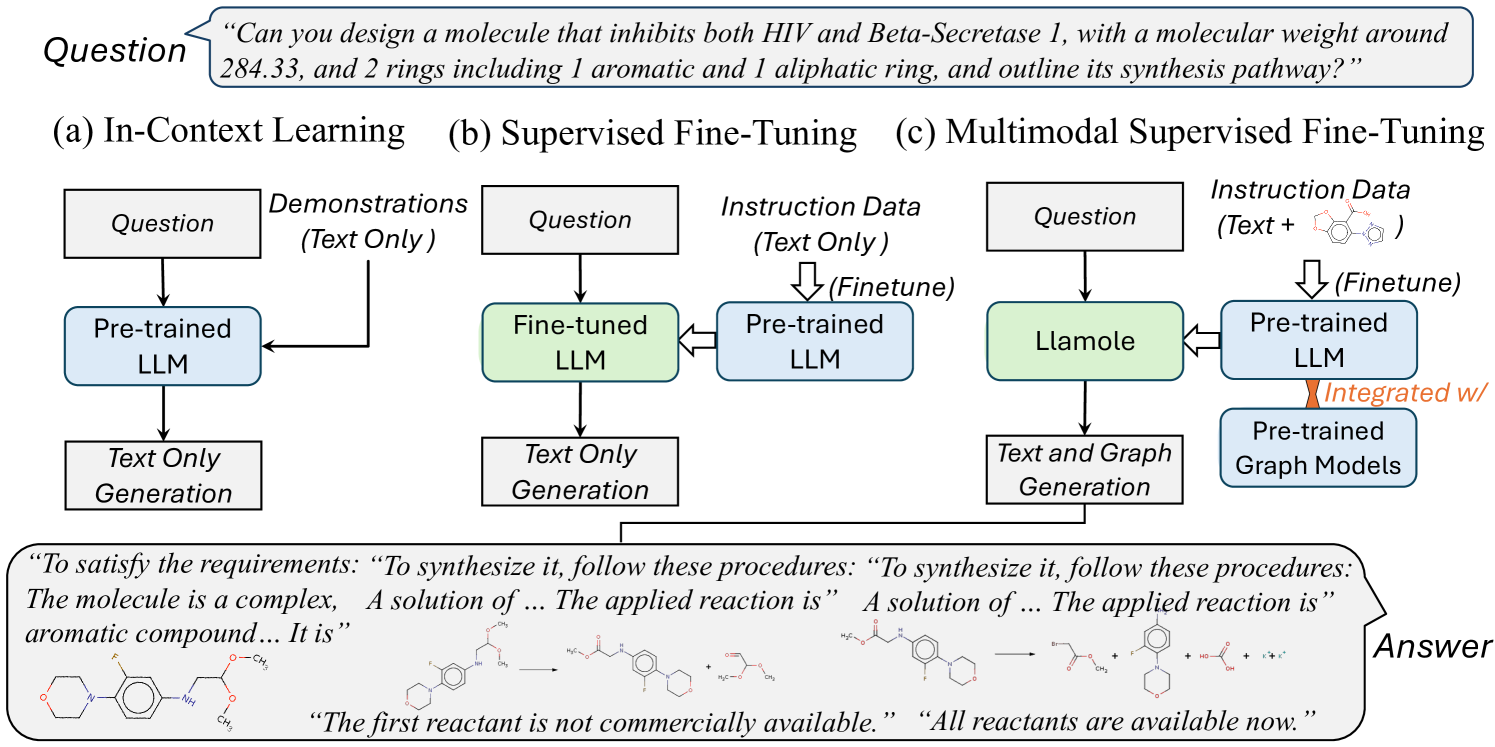

问题定义:论文旨在解决大语言模型在分子逆设计和逆合成规划中的应用难题。现有方法难以在文本和分子图之间进行连贯的自回归生成,导致无法有效利用LLM进行分子设计。

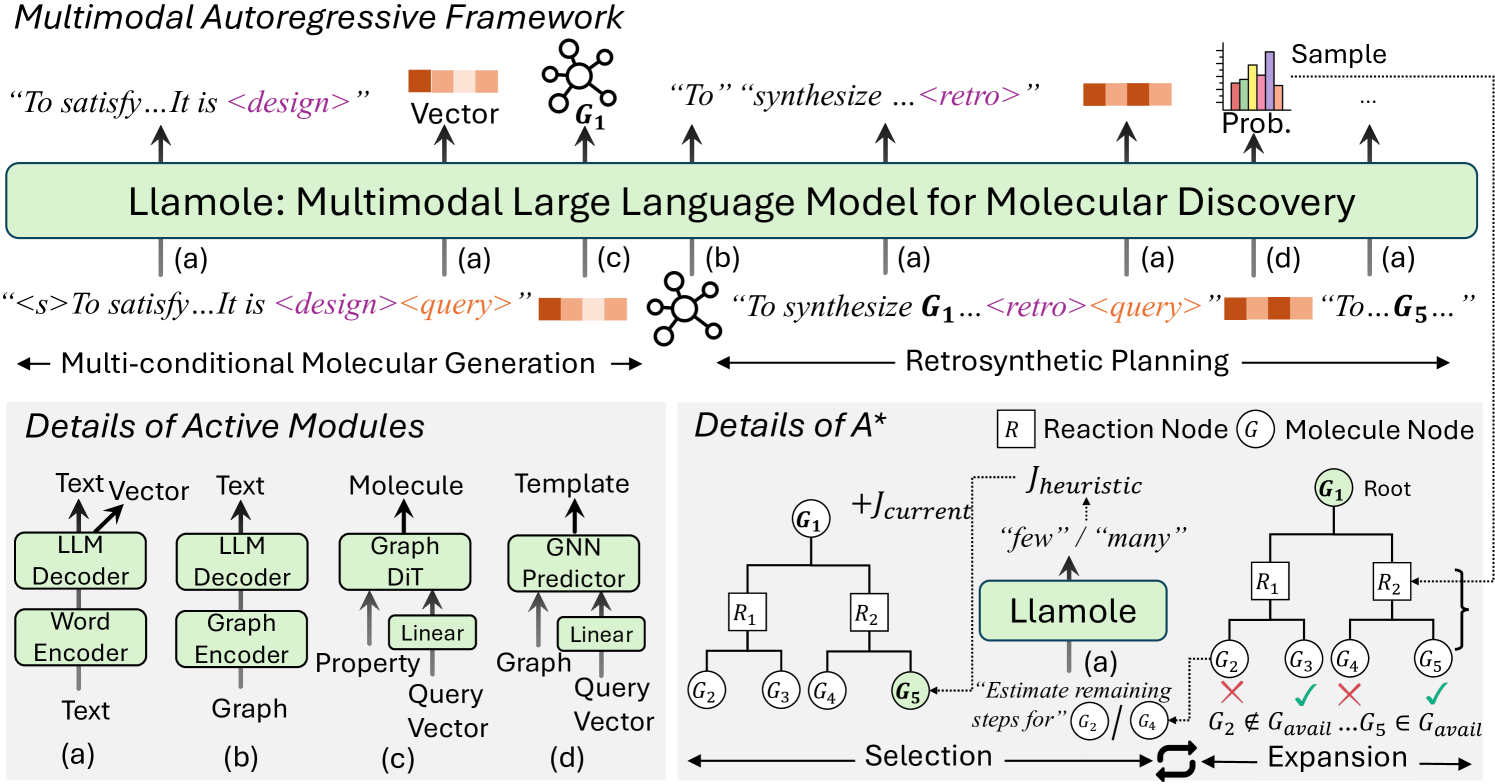

核心思路:论文的核心思路是构建一个多模态大语言模型Llamole,使其能够同时处理文本和图结构数据,实现文本和分子图的交错生成。通过这种方式,Llamole可以更好地理解分子结构和反应,从而进行更有效的分子逆设计和逆合成规划。

技术框架:Llamole的技术框架主要包括以下几个模块:1) 基础LLM:用于处理文本信息和控制整体生成流程。2) 图扩散Transformer和图神经网络:用于处理分子图数据,进行分子生成和反应推断。3) A*搜索:用于进行逆合成规划,寻找最优的合成路径。LLM通过增强的分子理解,灵活地控制不同图模块之间的激活。

关键创新:Llamole的关键创新在于其多模态架构,能够同时处理文本和图结构数据,实现文本和分子图的交错生成。这是第一个能够进行这种交错生成的大语言模型,为分子设计和逆合成规划提供了新的思路。

关键设计:Llamole的关键设计包括:1) 图扩散Transformer和图神经网络的集成,用于处理分子图数据。2) LLM对图模块的灵活控制,使其能够根据文本信息动态调整图模块的激活状态。3) A*搜索与LLM代价函数的结合,用于高效的逆合成规划。具体的参数设置、损失函数和网络结构等细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

Llamole在可控分子设计和逆合成规划的12个指标上,显著优于14个经过调整的LLM。实验结果表明,Llamole能够生成更符合要求的分子结构,并能够更准确地预测化学反应。这些结果充分证明了Llamole在分子设计领域的优越性能。

🎯 应用场景

Llamole的研究成果可以广泛应用于药物发现、材料设计等领域。通过该模型,研究人员可以更高效地设计具有特定性质的分子,加速新药和新材料的研发过程。此外,Llamole还可以用于优化化学合成路径,降低生产成本,提高生产效率。未来,该模型有望成为分子设计领域的重要工具。

📄 摘要(原文)

While large language models (LLMs) have integrated images, adapting them to graphs remains challenging, limiting their applications in materials and drug design. This difficulty stems from the need for coherent autoregressive generation across texts and graphs. To address this, we introduce Llamole, the first multimodal LLM capable of interleaved text and graph generation, enabling molecular inverse design with retrosynthetic planning. Llamole integrates a base LLM with the Graph Diffusion Transformer and Graph Neural Networks for multi-conditional molecular generation and reaction inference within texts, while the LLM, with enhanced molecular understanding, flexibly controls activation among the different graph modules. Additionally, Llamole integrates A* search with LLM-based cost functions for efficient retrosynthetic planning. We create benchmarking datasets and conduct extensive experiments to evaluate Llamole against in-context learning and supervised fine-tuning. Llamole significantly outperforms 14 adapted LLMs across 12 metrics for controllable molecular design and retrosynthetic planning.