Climate Adaptation with Reinforcement Learning: Experiments with Flooding and Transportation in Copenhagen

作者: Miguel Costa, Morten W. Petersen, Arthur Vandervoort, Martin Drews, Karyn Morrissey, Francisco C. Pereira

分类: cs.LG

发布日期: 2024-09-27 (更新: 2024-11-29)

备注: Accepted for presentation at Tackling Climate Change with Machine Learning workshop at NeurIPS 2024

期刊: Tackling Climate Change with Machine Learning workshop at NeurIPS 2024

🔗 代码/项目: GITHUB

💡 一句话要点

利用强化学习进行气候适应:哥本哈根洪水与交通运输案例研究

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 气候适应 城市洪水 交通运输 决策支持 风险管理 城市规划

📋 核心要点

- 城市面临极端降雨引发的洪水风险日益增加,现有适应策略在不确定性下难以优化部署。

- 论文提出基于强化学习的框架,优化适应措施的实施时间和地点,降低洪水的直接和间接影响。

- 实验结果表明,该方法能有效提升决策能力,优先干预特定区域,并确定最佳实施时期。

📝 摘要(中文)

由于气候变化,极端降雨事件的频率和强度预计将在许多地方增加,从而导致城市洪水。这些洪水会破坏交通基础设施并扰乱交通运输,凸显了城市适应日益增长的风险的需求。强化学习(RL)是一种强大的工具,可以发现最佳的适应策略,确定如何以及在何处有效地部署适应措施,即使在存在重大不确定性的情况下也是如此。在本研究中,我们利用强化学习来确定实施措施的最佳时间和地点,旨在减少洪水的直接和间接影响。我们的框架整合了未来降雨事件和洪水的气候变化预测,模拟了城市范围内的机动车出行,并量化了对基础设施和交通运输的直接和间接影响。初步结果表明,我们的基于强化学习的方法可以通过优先考虑特定城市地区的干预措施并确定实施的最佳时期来显着增强决策能力。我们的框架是公开可用的。

🔬 方法详解

问题定义:论文旨在解决城市如何有效地适应气候变化带来的极端降雨和洪水问题。现有方法在确定适应措施的最佳部署位置和时间方面存在不足,尤其是在考虑到气候变化预测的不确定性以及洪水对交通运输的间接影响时。传统方法往往依赖于静态的、预先设定的规则,无法根据实际情况进行动态调整和优化。

核心思路:论文的核心思路是利用强化学习(RL)来学习最优的适应策略。通过将城市洪水管理问题建模为一个马尔可夫决策过程(MDP),RL 算法可以学习在不同状态下采取何种行动(例如,在特定地点实施防洪措施)才能最大化长期回报(例如,最小化洪水造成的直接和间接损失)。这种方法允许根据气候变化预测和城市交通模型的反馈进行动态调整,从而找到更有效的适应策略。

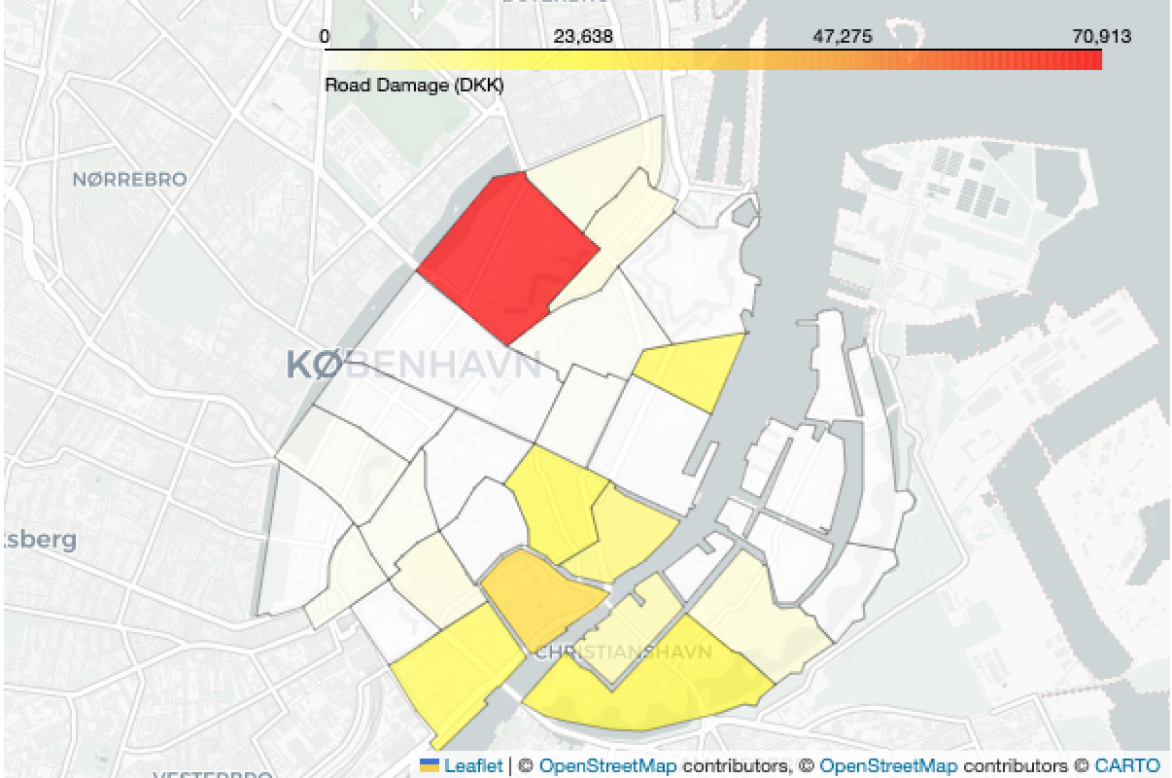

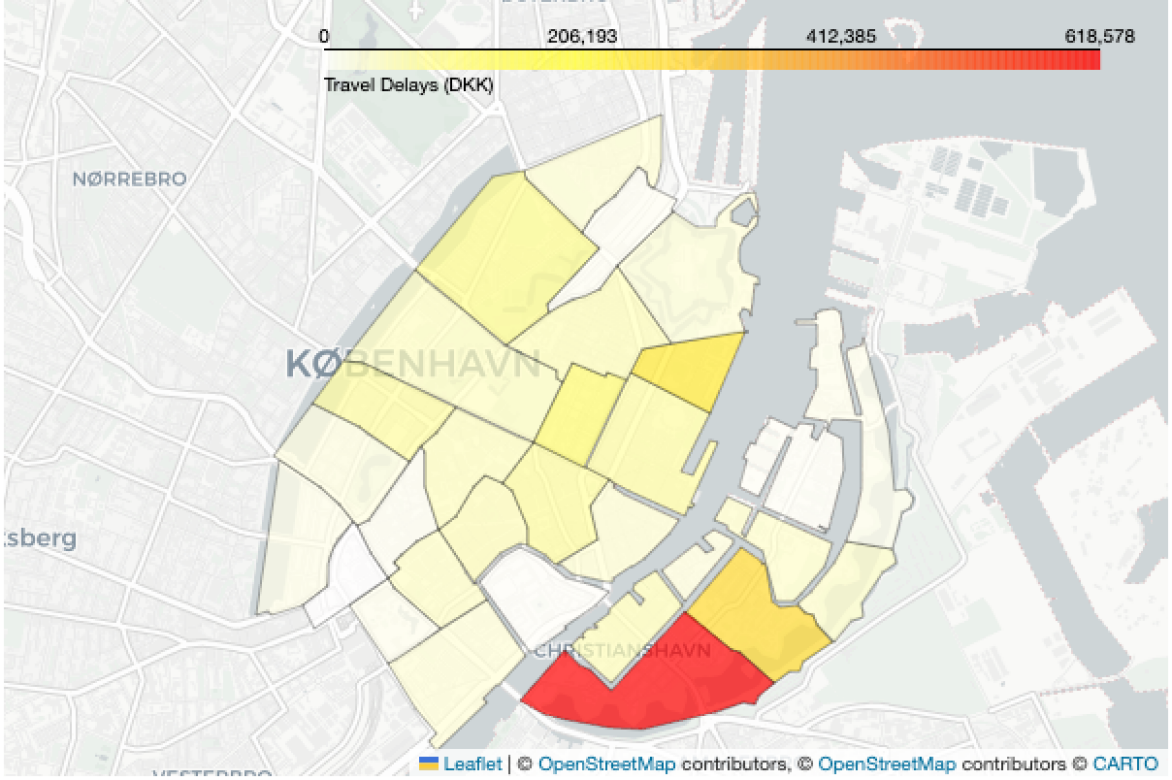

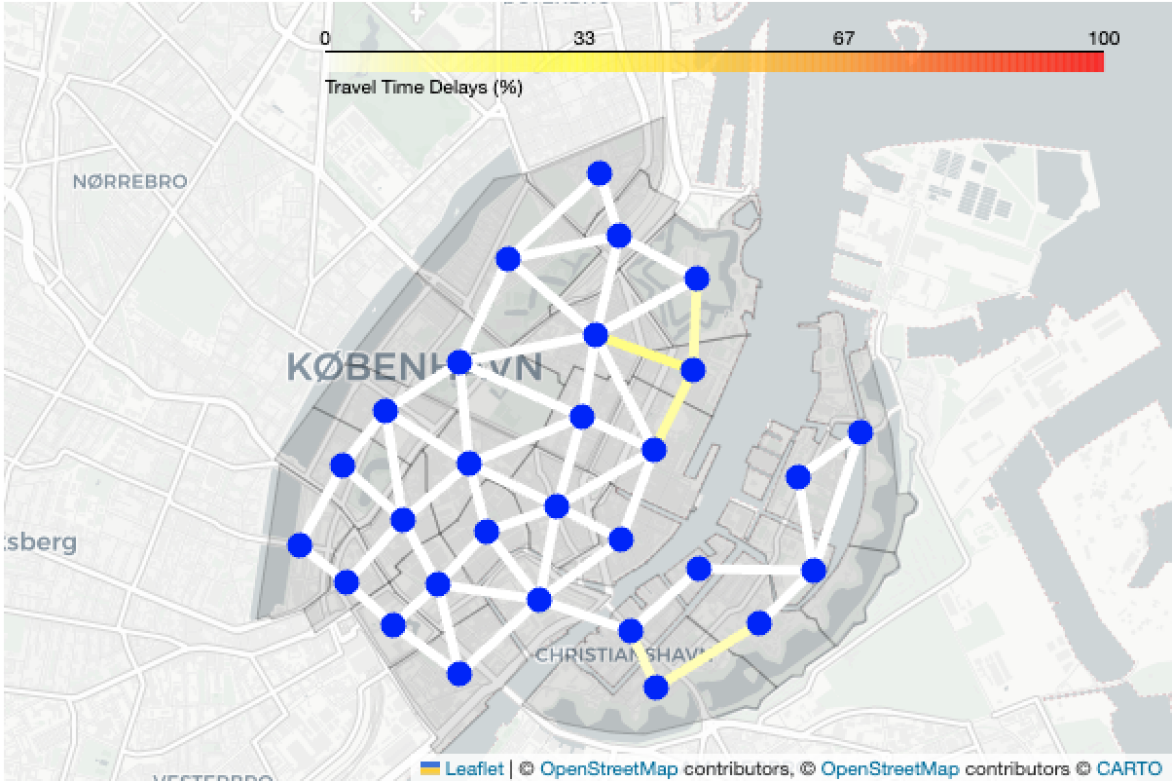

技术框架:该框架包含以下主要模块:1) 气候变化预测模块,用于生成未来降雨事件和洪水的预测数据;2) 城市交通模型,用于模拟城市范围内的机动车出行,并评估洪水对交通运输的影响;3) 强化学习代理,用于学习最优的适应策略;4) 影响评估模块,用于量化洪水对基础设施和交通运输的直接和间接影响。整个流程是:气候变化预测驱动洪水模型,洪水模型影响交通模型,交通模型和洪水模型共同产生奖励信号,强化学习代理根据奖励信号调整适应策略。

关键创新:该论文的关键创新在于将强化学习应用于城市气候适应问题,并整合了气候变化预测、城市交通模型和影响评估模块,形成了一个完整的决策支持框架。与传统的基于规则或优化的方法相比,该方法能够更好地处理不确定性,并找到更有效的适应策略。此外,该框架考虑了洪水对交通运输的间接影响,从而更全面地评估了适应措施的效益。

关键设计:论文中强化学习代理的具体设计细节未知,但可以推测可能涉及以下方面:状态空间的定义(例如,不同城市区域的洪水风险水平、交通拥堵程度等),动作空间的定义(例如,在特定地点实施防洪措施的类型和规模),奖励函数的定义(例如,洪水造成的直接和间接损失的负值),以及所使用的强化学习算法(例如,Q-learning、SARSA、Policy Gradient 等)。具体参数设置、损失函数和网络结构等细节需要在阅读源代码后才能确定。

🖼️ 关键图片

📊 实验亮点

论文的初步结果表明,基于强化学习的方法可以通过优先考虑特定城市地区的干预措施并确定实施的最佳时期来显着增强决策能力。虽然论文中没有提供具体的性能数据和对比基线,但作者强调该方法能够找到比传统方法更有效的适应策略,并减少洪水造成的直接和间接损失。框架已开源,方便复现和进一步研究。

🎯 应用场景

该研究成果可应用于城市规划、基础设施建设和气候适应策略制定等领域。通过该框架,城市管理者可以更好地了解不同适应措施的效益,并根据实际情况制定更有效的应对气候变化的策略。该研究还有助于提高城市应对极端天气事件的韧性,减少经济损失和社会影响。未来,该框架可以扩展到其他城市,并与其他类型的气候风险(例如,热浪、干旱)相结合,形成更全面的气候适应解决方案。

📄 摘要(原文)

Due to climate change the frequency and intensity of extreme rainfall events, which contribute to urban flooding, are expected to increase in many places. These floods can damage transport infrastructure and disrupt mobility, highlighting the need for cities to adapt to escalating risks. Reinforcement learning (RL) serves as a powerful tool for uncovering optimal adaptation strategies, determining how and where to deploy adaptation measures effectively, even under significant uncertainty. In this study, we leverage RL to identify the most effective timing and locations for implementing measures, aiming to reduce both direct and indirect impacts of flooding. Our framework integrates climate change projections of future rainfall events and floods, models city-wide motorized trips, and quantifies direct and indirect impacts on infrastructure and mobility. Preliminary results suggest that our RL-based approach can significantly enhance decision-making by prioritizing interventions in specific urban areas and identifying the optimal periods for their implementation. Our framework is publicly available: \url{https://github.com/MLSM-at-DTU/floods_transport_rl}.