Graph Reasoning with Large Language Models via Pseudo-code Prompting

作者: Konstantinos Skianis, Giannis Nikolentzos, Michalis Vazirgiannis

分类: cs.LG

发布日期: 2024-09-26

💡 一句话要点

提出伪代码提示方法,提升大语言模型在图推理任务上的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图推理 大语言模型 伪代码提示 知识图谱 自然语言处理

📋 核心要点

- 现有大语言模型在图推理任务中表现出初步能力,但在解决复杂图问题时仍面临挑战。

- 论文提出利用伪代码指令提示大语言模型,引导其更有效地执行图推理任务。

- 实验结果表明,使用伪代码提示能够显著提升大语言模型在图问题上的性能表现。

📝 摘要(中文)

大型语言模型(LLM)最近在自然语言处理领域的各种推理任务中取得了显著成功。LLM的这种成功也推动了它们在图相关任务中的应用。最近的研究探索了LLM是否可以解决图问题,例如计算图的连通分量数或计算两个节点之间的最短路径距离。尽管LLM具有初步的图推理能力,但它们可能仍然难以解决一些看似简单的问题。在本文中,我们研究了通过伪代码指令进行提示是否可以提高LLM在解决图问题中的性能。我们的实验表明,使用伪代码指令通常可以提高所有考虑的LLM的性能。图、伪代码提示和评估代码已公开提供。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)在图推理任务中表现不佳的问题。尽管LLM在自然语言处理领域取得了显著进展,但在处理诸如计算图的连通分量或最短路径等图相关问题时,仍然面临挑战。现有的LLM方法在处理复杂图结构和推理逻辑时存在局限性,导致性能下降。

核心思路:论文的核心思路是通过伪代码提示来增强LLM的图推理能力。伪代码提供了一种结构化的方式来描述算法步骤,从而引导LLM更准确地理解和执行图推理任务。这种方法利用了LLM在代码理解和生成方面的能力,将其应用于图推理领域。

技术框架:该方法主要包括以下几个步骤:1)针对特定的图推理任务,设计相应的伪代码指令;2)将伪代码指令与图数据一起作为LLM的输入提示;3)LLM根据提示生成推理结果;4)评估生成的推理结果的准确性。整个流程的关键在于伪代码的设计,需要清晰、简洁地描述算法逻辑。

关键创新:该论文的关键创新在于将伪代码提示引入到LLM的图推理任务中。与传统的自然语言提示相比,伪代码提供了一种更精确、更结构化的方式来指导LLM进行推理。这种方法充分利用了LLM在代码理解和生成方面的优势,从而提高了图推理的性能。

关键设计:伪代码提示的设计是该方法的核心。设计时需要考虑以下几个方面:1)伪代码的粒度:需要根据任务的复杂程度选择合适的粒度,避免过于抽象或过于繁琐;2)伪代码的表达方式:需要使用清晰、简洁的语言来描述算法步骤,避免歧义;3)伪代码与图数据的关联:需要在伪代码中明确指定如何访问和操作图数据。论文中可能包含一些伪代码示例,展示了如何针对不同的图推理任务设计伪代码提示。具体的参数设置和损失函数未知,因为论文摘要中没有提及。

🖼️ 关键图片

📊 实验亮点

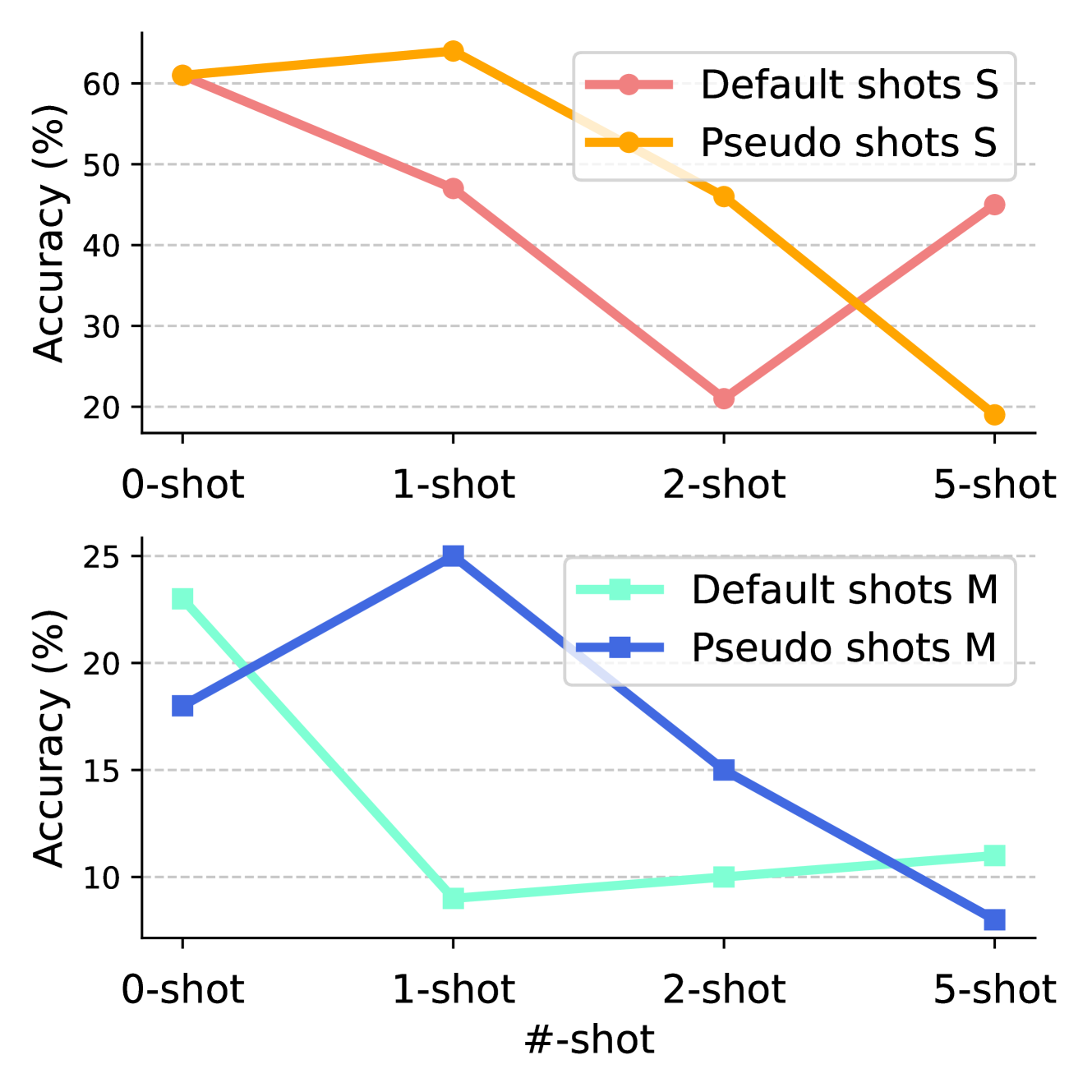

实验结果表明,使用伪代码提示能够显著提升大语言模型在图推理任务上的性能。具体的性能数据和提升幅度未知,因为论文摘要中没有提供详细的实验结果。但摘要明确指出,伪代码提示通常可以提高所有考虑的LLM的性能。

🎯 应用场景

该研究成果可应用于各种需要图推理的场景,例如社交网络分析、知识图谱推理、推荐系统、生物信息学等。通过提升大语言模型在图推理任务上的性能,可以更有效地解决这些领域中的实际问题,例如预测用户之间的关系、发现新的药物靶点等。未来,该方法有望进一步扩展到更复杂的图结构和推理任务中。

📄 摘要(原文)

Large language models (LLMs) have recently achieved remarkable success in various reasoning tasks in the field of natural language processing. This success of LLMs has also motivated their use in graph-related tasks. Among others, recent work has explored whether LLMs can solve graph problems such as counting the number of connected components of a graph or computing the shortest path distance between two nodes. Although LLMs possess preliminary graph reasoning abilities, they might still struggle to solve some seemingly simple problems. In this paper, we investigate whether prompting via pseudo-code instructions can improve the performance of LLMs in solving graph problems. Our experiments demonstrate that using pseudo-code instructions generally improves the performance of all considered LLMs. The graphs, pseudo-code prompts, and evaluation code are publicly available.