Putting Data at the Centre of Offline Multi-Agent Reinforcement Learning

作者: Claude Formanek, Louise Beyers, Callum Rhys Tilbury, Jonathan P. Shock, Arnu Pretorius

分类: cs.LG, cs.AI, cs.MA

发布日期: 2024-09-18

💡 一句话要点

聚焦数据质量的离线多智能体强化学习方法,提升算法泛化性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 离线强化学习 多智能体系统 数据集标准化 数据分析 强化学习

📋 核心要点

- 现有离线MARL研究往往忽视数据集的特性,导致算法性能与特定数据集高度耦合,缺乏通用性。

- 本文提出以数据为中心的离线MARL方法,强调数据集生成规范和数据特征分析,以提升算法的泛化能力。

- 论文贡献包括数据集生成指南、标准化数据集仓库和数据分析工具,旨在为离线MARL研究提供统一的实验基础。

📝 摘要(中文)

离线多智能体强化学习(MARL)是一个令人兴奋的研究方向,它使用静态数据集为多智能体系统寻找最优控制策略。虽然该领域本质上是数据驱动的,但目前的研究工作在追求最先进结果的同时,忽略了数据本身。本文首先通过文献调研证实了这一观点,表明大多数工作都在没有一致方法论的情况下生成自己的数据集,并且提供关于这些数据集特征的稀疏信息。然后,通过显著的例子展示了忽略数据本质的问题,说明了算法性能与所使用数据集的紧密耦合关系,因此需要在该领域建立一个通用的实验基础。作为回应,本文在改进离线MARL中的数据使用和数据意识方面迈出了一大步,主要贡献包括:(1)一个用于生成新数据集的清晰指南;(2)一个对80多个现有数据集的标准化,托管在一个公开可用的存储库中,使用一致的存储格式和易于使用的API;(3)一套分析工具,使我们能够更好地理解这些数据集,从而促进进一步的开发。

🔬 方法详解

问题定义:离线多智能体强化学习旨在利用静态数据集训练智能体策略,避免在线交互带来的高成本。然而,现有研究往往侧重于算法设计,忽略了数据集的质量和多样性,导致算法在不同数据集上的性能差异很大,缺乏鲁棒性和泛化能力。现有方法缺乏统一的数据集生成标准和分析工具,难以评估算法的真实性能。

核心思路:本文的核心思路是将数据置于离线MARL研究的中心位置,强调数据集的规范化生成、系统化管理和深入分析。通过提供清晰的数据集生成指南,构建标准化的数据集仓库,并开发数据分析工具,旨在提升研究者对数据集特性的理解,从而设计出更具泛化能力的算法。

技术框架:本文的技术框架主要包含三个部分:1) 数据集生成指南:详细描述如何构建高质量的离线MARL数据集,包括环境设置、策略选择、数据收集方法等。2) 标准化数据集仓库:收集并标准化了80多个现有的离线MARL数据集,使用统一的存储格式和API,方便研究者访问和使用。3) 数据分析工具:提供了一系列数据分析工具,用于分析数据集的统计特性、行为模式和潜在偏差,帮助研究者更好地理解数据集。

关键创新:本文最重要的技术创新在于强调了数据在离线MARL研究中的重要性,并提供了一套完整的数据管理和分析工具。与现有方法相比,本文更加关注数据集的质量和多样性,旨在解决算法在不同数据集上的泛化问题。通过提供标准化的数据集和分析工具,促进了离线MARL研究的可重复性和可比性。

关键设计:数据集生成指南包括对环境的详细描述(例如,合作博弈、竞争博弈),智能体策略的类型(例如,随机策略、专家策略),以及数据收集过程的参数设置(例如,轨迹长度、采样频率)。标准化数据集仓库使用统一的JSON格式存储数据,并提供Python API方便数据访问。数据分析工具包括统计分析(例如,状态分布、奖励分布)、行为分析(例如,策略覆盖率、智能体交互模式)和偏差分析(例如,数据集中是否存在某种偏见)。

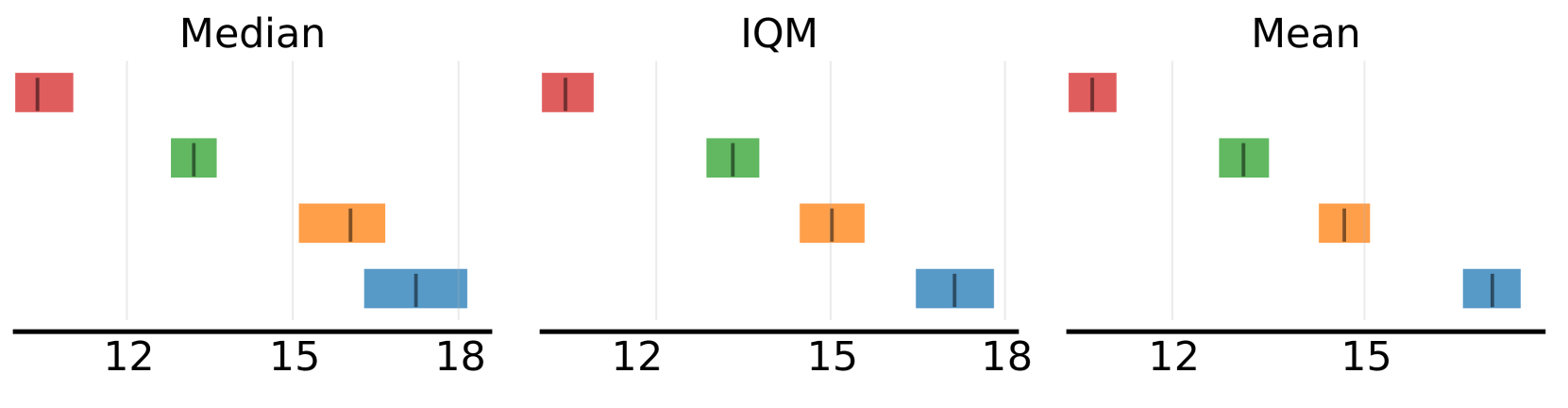

🖼️ 关键图片

📊 实验亮点

论文构建了一个包含80多个标准化数据集的公开仓库,并提供了一套数据分析工具。通过对现有数据集的分析,论文展示了算法性能与数据集特性之间的紧密关系,强调了数据质量的重要性。该研究为离线MARL领域提供了一个统一的实验平台,促进了算法的公平比较和可重复性研究。

🎯 应用场景

该研究成果可广泛应用于机器人协同、交通调度、资源分配等领域。通过利用离线数据进行策略学习,可以降低在线实验的成本和风险,加速多智能体系统的部署和应用。标准化的数据集和分析工具将促进离线MARL算法的开发和评估,推动相关领域的发展。

📄 摘要(原文)

Offline multi-agent reinforcement learning (MARL) is an exciting direction of research that uses static datasets to find optimal control policies for multi-agent systems. Though the field is by definition data-driven, efforts have thus far neglected data in their drive to achieve state-of-the-art results. We first substantiate this claim by surveying the literature, showing how the majority of works generate their own datasets without consistent methodology and provide sparse information about the characteristics of these datasets. We then show why neglecting the nature of the data is problematic, through salient examples of how tightly algorithmic performance is coupled to the dataset used, necessitating a common foundation for experiments in the field. In response, we take a big step towards improving data usage and data awareness in offline MARL, with three key contributions: (1) a clear guideline for generating novel datasets; (2) a standardisation of over 80 existing datasets, hosted in a publicly available repository, using a consistent storage format and easy-to-use API; and (3) a suite of analysis tools that allow us to understand these datasets better, aiding further development.