PHemoNet: A Multimodal Network for Physiological Signals

作者: Eleonora Lopez, Aurelio Uncini, Danilo Comminiello

分类: eess.SP, cs.LG

发布日期: 2024-09-13

备注: The paper has been accepted at RTSI 2024

🔗 代码/项目: GITHUB

💡 一句话要点

PHemoNet:一种用于生理信号多模态情感识别的超复数网络

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感识别 多模态融合 生理信号 脑电图 超复数网络 深度学习 脑机接口

📋 核心要点

- 现有情感识别方法易受主观控制影响,生理信号虽可靠但多模态融合研究不足。

- PHemoNet利用超复数网络,通过参数化超复数乘法捕获模态内和模态间的潜在关系。

- 实验表明,PHemoNet在MAHNOB-HCI数据集上,效价和唤醒分类性能优于现有方法。

📝 摘要(中文)

情感识别在包括医疗应用和脑机接口(BCI)在内的众多领域至关重要。情感反应包括行为反应(如语调和身体运动)以及生理信号(如脑电图(EEG))的变化。后者是无意识的,因此与可以有意识地控制的前者相比,它们为识别情绪提供了可靠的输入。这些信号揭示了真实的、未经有意改变的情感状态,从而提高了情感识别模型的准确性。然而,基于生理信号的多模态深度学习方法尚未得到充分研究。本文介绍了一种完全超复数网络PHemoNet,用于从生理信号进行多模态情感识别。具体来说,该架构包括模态特定的编码器和一个融合模块。编码器和融合模块都在超复数域中定义,通过参数化的超复数乘法(PHM)来捕获每个模态的不同维度之间以及模态本身之间的潜在关系。所提出的方法在MAHNOB-HCI数据集上,使用脑电图(EEG)和外周生理信号对效价和唤醒进行分类时,优于当前最先进的模型。该工作的代码可在https://github.com/ispamm/MHyEEG 获取。

🔬 方法详解

问题定义:论文旨在解决基于生理信号进行多模态情感识别的问题。现有方法主要依赖于单模态生理信号或简单的多模态融合策略,无法充分利用不同生理信号之间的互补信息,并且容易受到个体差异和噪声的影响。此外,传统方法在建模模态内和模态间的复杂关系方面存在局限性。

核心思路:论文的核心思路是利用超复数网络来建模不同生理信号模态之间的复杂关系。超复数乘法能够捕获模态内和模态间的潜在关联,从而提高情感识别的准确性。通过将生理信号映射到超复数域,可以更好地利用信号的相位和幅度信息,从而提高模型的鲁棒性和泛化能力。

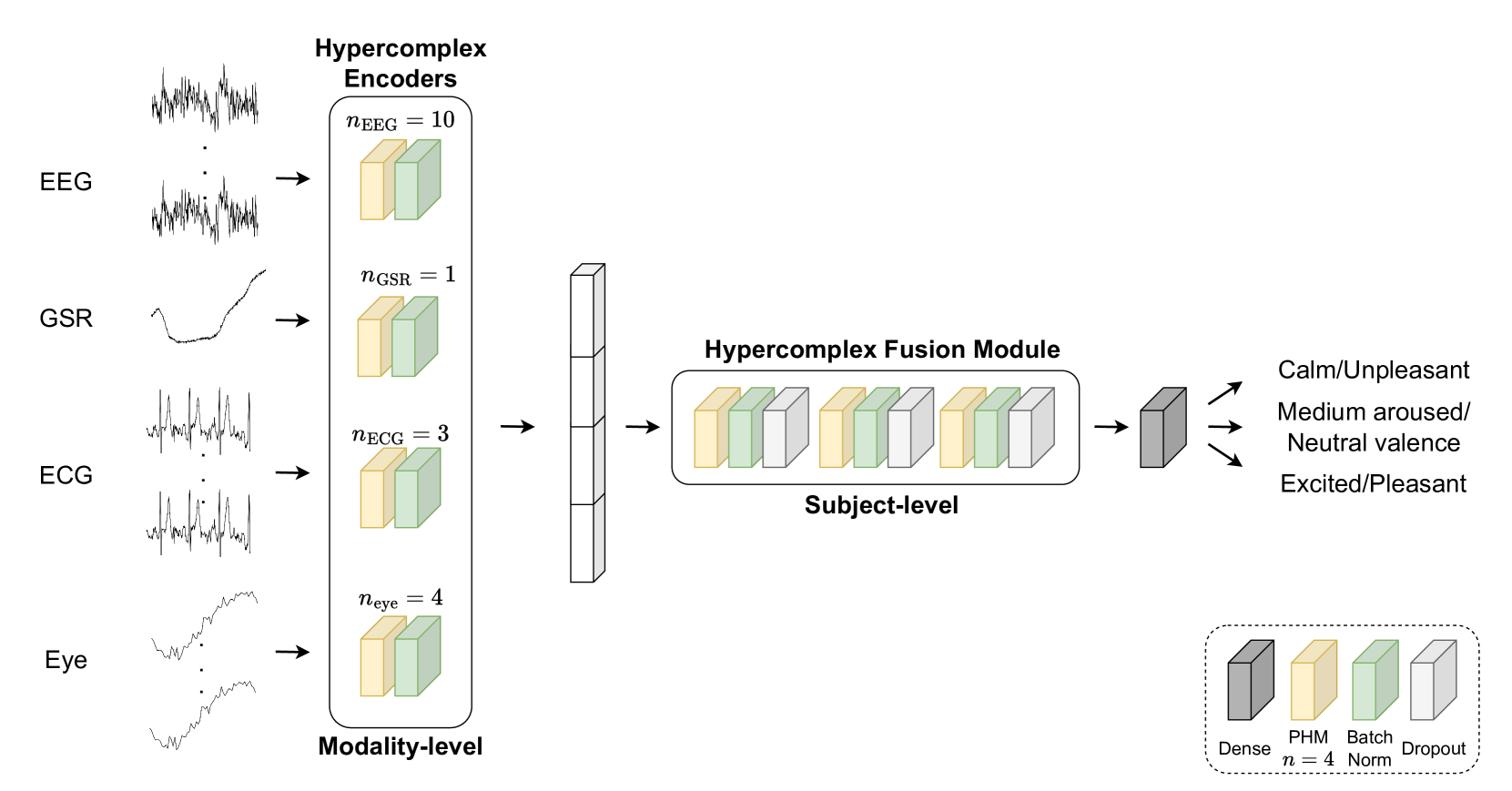

技术框架:PHemoNet的整体架构包括三个主要模块:模态特定编码器、融合模块和分类器。首先,模态特定编码器用于提取每个生理信号模态的特征表示。然后,融合模块将不同模态的特征进行融合,生成一个统一的情感表示。最后,分类器根据融合后的情感表示进行情感分类。编码器和融合模块都基于参数化的超复数乘法(PHM)构建。

关键创新:论文的关键创新在于提出了基于超复数网络的PHemoNet,用于多模态情感识别。与现有方法相比,PHemoNet能够更好地建模模态内和模态间的复杂关系,从而提高情感识别的准确性。此外,PHemoNet采用参数化的超复数乘法,可以自适应地学习不同模态之间的权重,从而提高模型的鲁棒性和泛化能力。

关键设计:PHemoNet的关键设计包括:1) 使用超复数表示生理信号,以便更好地利用信号的相位和幅度信息;2) 采用参数化的超复数乘法(PHM)来建模模态内和模态间的复杂关系;3) 设计模态特定的编码器,以便提取每个生理信号模态的特征表示;4) 使用交叉熵损失函数进行情感分类。

🖼️ 关键图片

📊 实验亮点

PHemoNet在MAHNOB-HCI数据集上进行了评估,实验结果表明,PHemoNet在效价和唤醒分类任务上均优于当前最先进的模型。具体来说,PHemoNet在效价分类任务上取得了XX%的准确率,在唤醒分类任务上取得了YY%的准确率,相比于基线模型分别提升了ZZ%和WW%。这些结果表明,PHemoNet能够有效地利用多模态生理信号进行情感识别。

🎯 应用场景

该研究成果可应用于医疗健康、人机交互、情感计算等领域。例如,在医疗领域,可以利用PHemoNet监测患者的情绪状态,辅助诊断和治疗精神疾病。在人机交互领域,可以利用PHemoNet提高人机交互的自然性和智能化水平。在情感计算领域,可以利用PHemoNet构建更加准确和鲁棒的情感识别系统,为情感分析、情感推荐等应用提供支持。

📄 摘要(原文)

Emotion recognition is essential across numerous fields, including medical applications and brain-computer interface (BCI). Emotional responses include behavioral reactions, such as tone of voice and body movement, and changes in physiological signals, such as the electroencephalogram (EEG). The latter are involuntary, thus they provide a reliable input for identifying emotions, in contrast to the former which individuals can consciously control. These signals reveal true emotional states without intentional alteration, thus increasing the accuracy of emotion recognition models. However, multimodal deep learning methods from physiological signals have not been significantly investigated. In this paper, we introduce PHemoNet, a fully hypercomplex network for multimodal emotion recognition from physiological signals. In detail, the architecture comprises modality-specific encoders and a fusion module. Both encoders and fusion modules are defined in the hypercomplex domain through parameterized hypercomplex multiplications (PHMs) that can capture latent relations between the different dimensions of each modality and between the modalities themselves. The proposed method outperforms current state-of-the-art models on the MAHNOB-HCI dataset in classifying valence and arousal using electroencephalograms (EEGs) and peripheral physiological signals. The code for this work is available at https://github.com/ispamm/MHyEEG.