Multi-Model based Federated Learning Against Model Poisoning Attack: A Deep Learning Based Model Selection for MEC Systems

作者: Somayeh Kianpisheh, Chafika Benzaid, Tarik Taleb

分类: cs.LG, cs.NI

发布日期: 2024-09-12

💡 一句话要点

提出基于多模型的联邦学习框架,增强模型投毒攻击的防御能力,并应用于MEC系统。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 联邦学习 模型投毒攻击 多模型 深度强化学习 边缘计算 DDoS攻击检测

📋 核心要点

- 联邦学习易受模型投毒攻击,攻击者上传恶意模型干扰全局模型训练,现有方法缺乏有效的防御机制。

- 论文提出多模型联邦学习框架,通过动态改变客户端模型结构和引入支持者FL协议,增强防御模型投毒攻击的能力。

- 实验结果表明,该方法在DDoS攻击检测场景下,即使在受到投毒攻击时,也能保持较高的精度,并能潜在地缩短识别时间。

📝 摘要(中文)

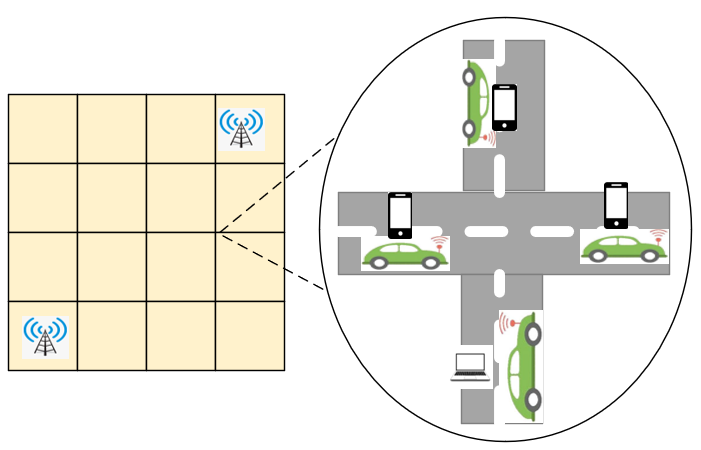

联邦学习(FL)能够在保护数据隐私的同时,利用分布式数据训练全局模型。然而,FL的单模型操作容易受到模型投毒攻击,攻击者可以上传与全局模型结构兼容的恶意模型。本文提出了一种基于多模型的FL方法,作为一种主动机制来增强缓解模型投毒攻击的机会。一个主模型由一组从模型训练得到。为了增强攻击缓解的机会,客户端模型的结构在学习周期内动态变化,并提供支持者FL协议。对于MEC系统,模型选择问题被建模为一个优化问题,以最小化损失和识别时间,同时满足鲁棒性置信度。为了适应动态网络条件,提出了一种基于深度强化学习的模型选择方法。在DDoS攻击检测场景中,结果表明,在受到投毒攻击的情况下,该方法具有与系统未受到攻击时相当的精度增益,并且具有潜在的识别时间改进。

🔬 方法详解

问题定义:论文旨在解决联邦学习中模型投毒攻击的问题。现有的联邦学习方法通常基于单一模型结构,攻击者可以通过上传精心构造的恶意模型来影响全局模型的性能,甚至使其失效。现有的防御方法往往需要对客户端数据进行额外的分析或假设,限制了其适用性。

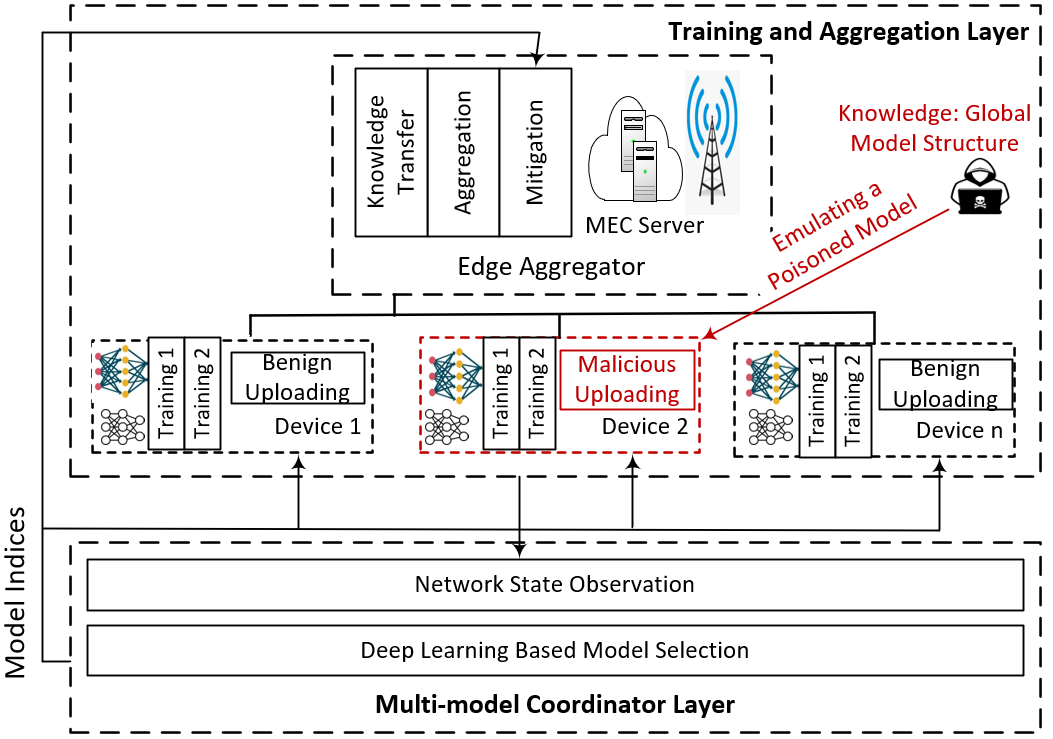

核心思路:论文的核心思路是引入多模型机制,即使用多个结构不同的客户端模型来训练全局模型。通过动态改变客户端模型的结构,增加攻击者构造有效恶意模型的难度。同时,引入支持者FL协议,允许客户端选择性地参与训练,进一步增强了系统的鲁棒性。这种设计旨在提高攻击的复杂性,使得攻击者难以同时欺骗所有模型,从而降低攻击的成功率。

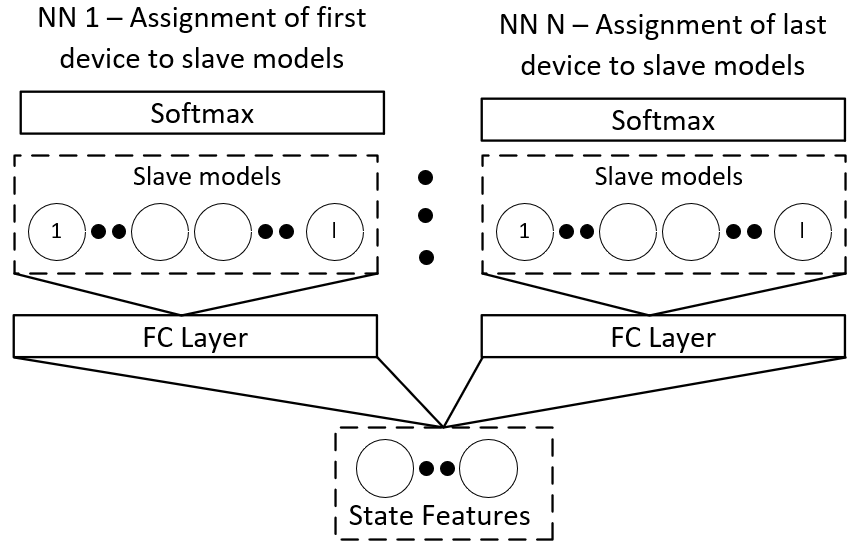

技术框架:该方法包含以下主要模块:1) 客户端模型生成模块:负责生成结构不同的客户端模型。这些模型可以在不同的学习周期内动态变化。2) 本地训练模块:客户端使用本地数据训练各自的模型。3) 模型聚合模块:服务器聚合来自客户端的模型更新,生成全局模型。4) 模型选择模块:在MEC系统中,该模块使用深度强化学习来选择合适的客户端模型,以最小化损失和识别时间,同时满足鲁棒性要求。5) 支持者FL协议:允许客户端根据自身情况选择是否参与训练,从而避免恶意客户端的持续干扰。

关键创新:该方法的主要创新点在于:1) 多模型联邦学习:通过使用多个结构不同的客户端模型,增加了攻击者构造有效恶意模型的难度。2) 动态模型结构:客户端模型的结构在学习周期内动态变化,进一步增强了防御能力。3) 基于深度强化学习的模型选择:针对MEC系统,使用深度强化学习来优化模型选择过程,以适应动态网络条件。

关键设计:论文中关键的设计包括:1) 客户端模型结构的多样性:具体采用哪些不同的模型结构,以及如何动态改变这些结构,需要根据具体的应用场景进行设计。2) 深度强化学习的模型选择策略:需要定义合适的状态空间、动作空间和奖励函数,以训练有效的模型选择策略。3) 支持者FL协议的实现细节:如何设计客户端的选择机制,以及如何处理客户端选择带来的数据偏差问题,需要仔细考虑。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在DDoS攻击检测场景下,即使在受到模型投毒攻击的情况下,该方法也能保持与未受到攻击时相当的精度增益。此外,该方法还具有潜在的识别时间改进。这些结果表明,该方法能够有效地缓解模型投毒攻击,并提高联邦学习系统的鲁棒性。

🎯 应用场景

该研究成果可应用于各种需要保护数据隐私的分布式机器学习场景,例如:智能医疗、金融风控、物联网设备管理等。特别是在边缘计算环境中,该方法可以提高模型训练的安全性,并适应动态的网络条件,具有重要的实际应用价值和发展潜力。

📄 摘要(原文)

Federated Learning (FL) enables training of a global model from distributed data, while preserving data privacy. However, the singular-model based operation of FL is open with uploading poisoned models compatible with the global model structure and can be exploited as a vulnerability to conduct model poisoning attacks. This paper proposes a multi-model based FL as a proactive mechanism to enhance the opportunity of model poisoning attack mitigation. A master model is trained by a set of slave models. To enhance the opportunity of attack mitigation, the structure of client models dynamically change within learning epochs, and the supporter FL protocol is provided. For a MEC system, the model selection problem is modeled as an optimization to minimize loss and recognition time, while meeting a robustness confidence. In adaption with dynamic network condition, a deep reinforcement learning based model selection is proposed. For a DDoS attack detection scenario, results illustrate a competitive accuracy gain under poisoning attack with the scenario that the system is without attack, and also a potential of recognition time improvement.