Towards a graph-based foundation model for network traffic analysis

作者: Louis Van Langendonck, Ismael Castell-Uroz, Pere Barlet-Ros

分类: cs.LG, cs.AI, cs.CR, cs.NI

发布日期: 2024-09-12

备注: Pre-print of Accepted Workshop paper to 3rd GNNet, co-located with CoNEXT'24

💡 一句话要点

提出基于图的流量分析基础模型,提升网络流量分析任务性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 网络流量分析 基础模型 图神经网络 自监督学习 链接预测

📋 核心要点

- 现有网络流量分析方法依赖于token化的数据包级别信息,计算成本高昂且效率较低。

- 论文提出一种基于图的流量分析基础模型,将网络流量表示为动态时空图,并通过链接预测进行自监督预训练。

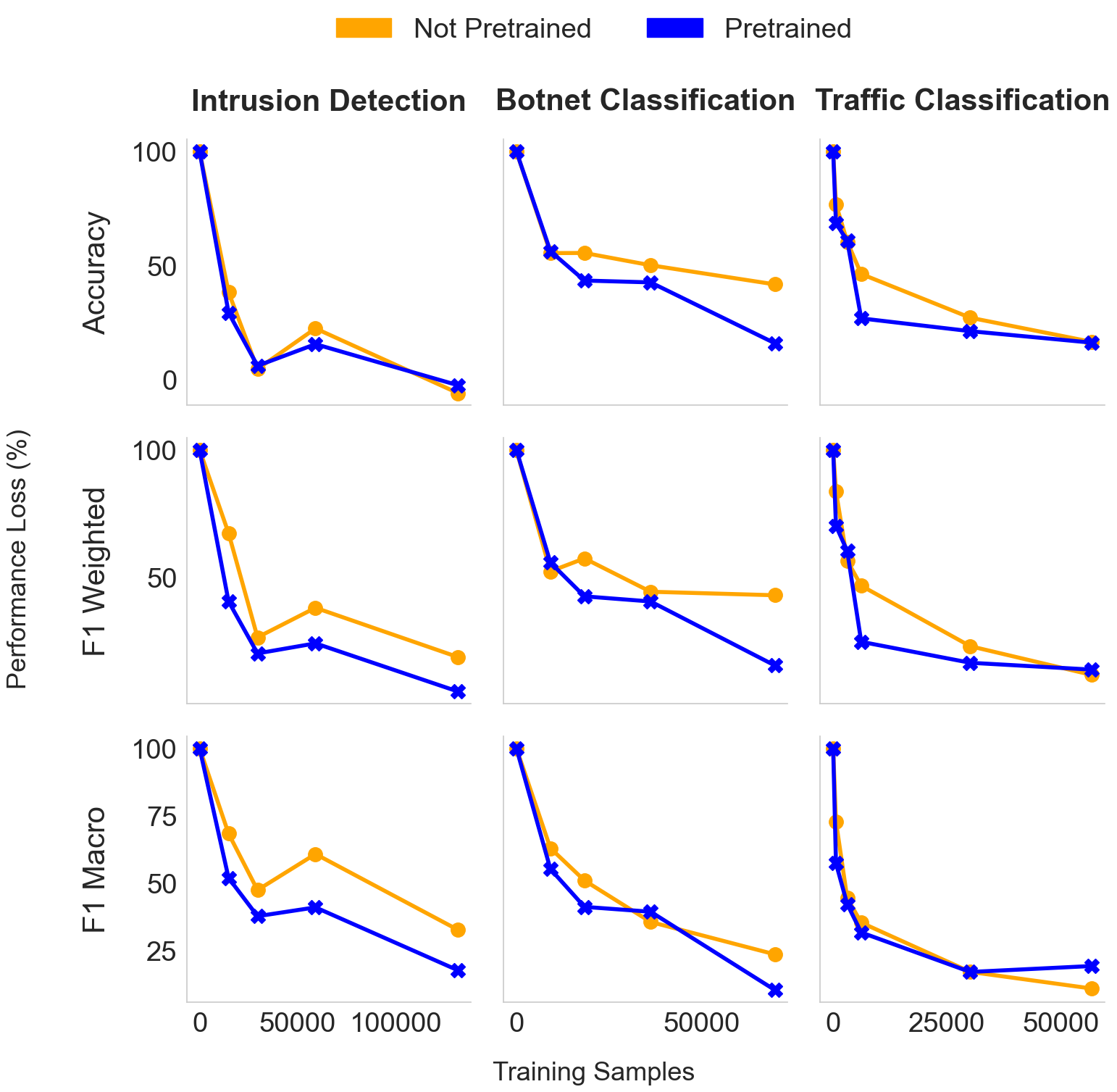

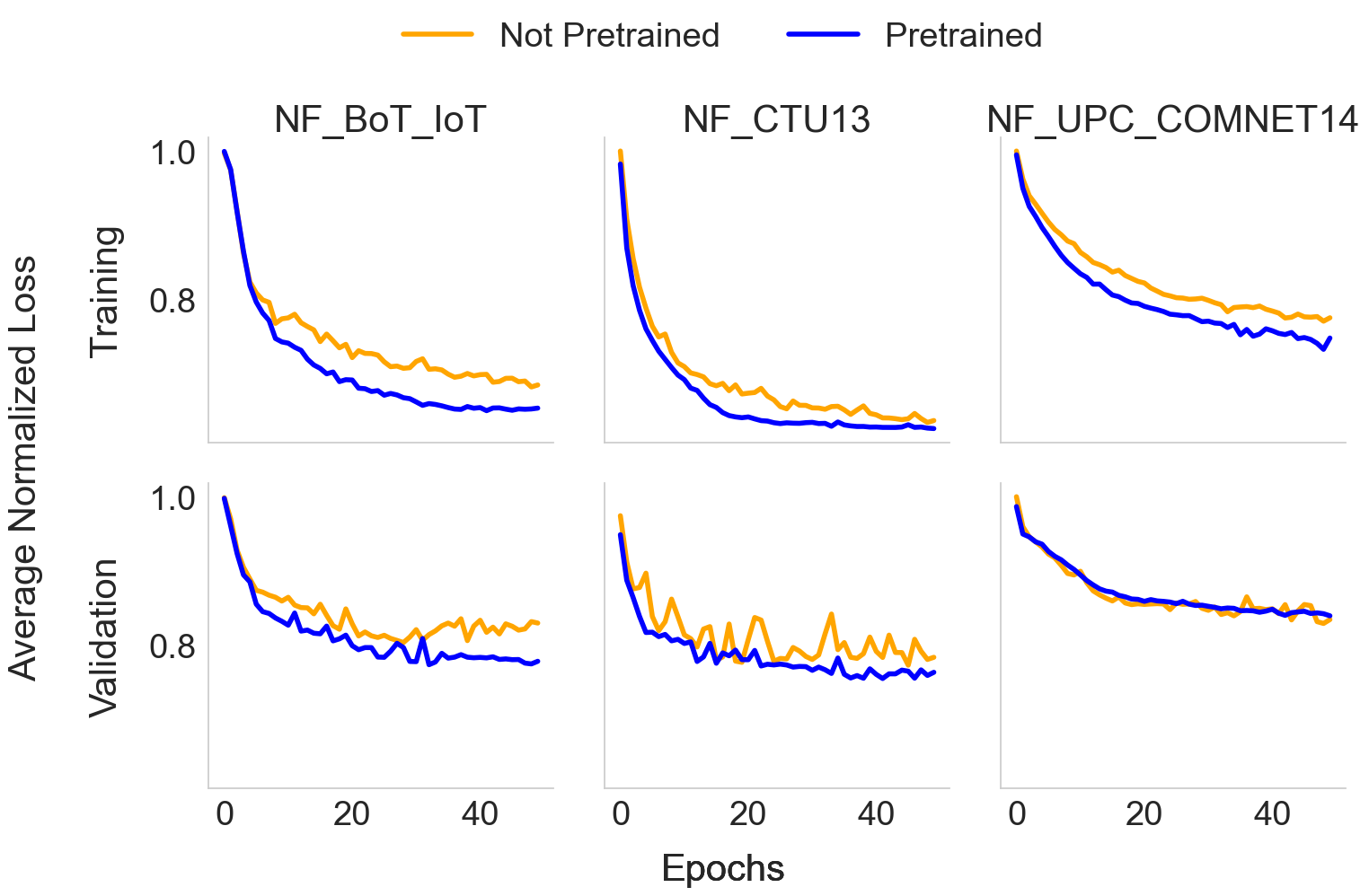

- 实验结果表明,该模型在入侵检测、流量分类和僵尸网络分类等任务上,相比从头训练的模型性能提升了6.87%。

📝 摘要(中文)

基础模型在各个领域展现出巨大潜力。本文探索了其在计算机网络流量分析中的应用,旨在使模型能够理解网络流量动态的复杂性,并通过最少的微调适应任何特定任务或网络环境。以往的方法使用token化的十六进制数据包级别数据和大型语言Transformer模型架构。我们提出了一种新的、高效的基于图的流量级别替代方案。我们的方法将网络流量表示为动态时空图,采用自监督链接预测预训练任务来捕获此网络图框架中的空间和时间动态。为了评估我们方法的有效性,我们针对三个不同的下游网络任务进行了少样本学习实验:入侵检测、流量分类和僵尸网络分类。从我们的预训练基础模型微调的模型,相比从头开始训练的模型,平均性能提高了6.87%,证明了它们在预训练期间有效学习通用网络流量动态的能力。这一成功表明,大规模版本有可能作为可操作的基础模型。

🔬 方法详解

问题定义:现有网络流量分析方法,例如基于Transformer的模型,通常直接处理token化的数据包内容,计算复杂度高,难以捕捉流量之间的关系。此外,针对特定任务训练的模型泛化能力有限,难以适应新的网络环境和攻击模式。因此,需要一种能够高效学习通用网络流量动态,并能快速适应各种下游任务的基础模型。

核心思路:论文的核心思路是将网络流量建模为动态时空图,其中节点代表网络实体(例如IP地址、端口),边代表流量连接。通过图结构,可以显式地捕捉网络实体之间的关系。然后,利用自监督学习方法,例如链接预测,让模型学习网络流量的时空动态,从而获得通用的流量表示。

技术框架:该方法主要包含以下几个阶段:1) 图构建:将网络流量数据转换为动态时空图。2) 预训练:使用自监督链接预测任务,训练图神经网络模型,使其学习网络流量的通用表示。3) 微调:在特定下游任务(例如入侵检测、流量分类)上,使用少量标注数据微调预训练模型。4) 评估:评估微调后的模型在下游任务上的性能。

关键创新:该方法的关键创新在于:1) 图表示:将网络流量建模为动态时空图,能够显式地捕捉网络实体之间的关系。2) 自监督预训练:使用链接预测任务进行自监督预训练,避免了对大量标注数据的依赖,并能够学习通用的流量表示。3) 流量级别建模:直接在流量级别上进行建模,避免了处理复杂的包级别数据,提高了效率。

关键设计:图神经网络模型采用Graph Convolutional Network (GCN) 或 Graph Attention Network (GAT)。链接预测任务采用负采样方法,损失函数为二元交叉熵损失。预训练阶段使用大规模网络流量数据集,例如CAIDA数据集。微调阶段使用少量标注数据,例如CIC-IDS2017数据集。模型参数通过Adam优化器进行优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于图的流量分析基础模型在三个下游任务(入侵检测、流量分类和僵尸网络分类)上均取得了显著的性能提升。相比从头开始训练的模型,微调后的模型平均性能提高了6.87%。这表明该模型能够有效学习通用网络流量动态,并能快速适应各种下游任务。

🎯 应用场景

该研究成果可应用于网络安全监控、流量管理和异常检测等领域。通过构建大规模网络流量基础模型,可以有效提升网络安全防御能力,实现对未知攻击的快速识别和响应。此外,该模型还可以用于优化网络资源分配,提高网络服务质量,并为未来的网络架构设计提供参考。

📄 摘要(原文)

Foundation models have shown great promise in various fields of study. A potential application of such models is in computer network traffic analysis, where these models can grasp the complexities of network traffic dynamics and adapt to any specific task or network environment with minimal fine-tuning. Previous approaches have used tokenized hex-level packet data and the model architecture of large language transformer models. We propose a new, efficient graph-based alternative at the flow-level. Our approach represents network traffic as a dynamic spatio-temporal graph, employing a self-supervised link prediction pretraining task to capture the spatial and temporal dynamics in this network graph framework. To evaluate the effectiveness of our approach, we conduct a few-shot learning experiment for three distinct downstream network tasks: intrusion detection, traffic classification, and botnet classification. Models finetuned from our pretrained base achieve an average performance increase of 6.87\% over training from scratch, demonstrating their ability to effectively learn general network traffic dynamics during pretraining. This success suggests the potential for a large-scale version to serve as an operational foundational model.