GRE^2-MDCL: Graph Representation Embedding Enhanced via Multidimensional Contrastive Learning

作者: Kaizhe Fan, Quanjun Li

分类: cs.LG, cs.AI

发布日期: 2024-09-12 (更新: 2025-03-20)

备注: I am requesting the withdrawal of my paper due to errors identified in the methodology and experimental results. Specifically, there are inaccuracies in the analysis section that may lead to misleading conclusions

💡 一句话要点

提出GRE^2-MDCL模型,通过多维对比学习增强图表示嵌入,提升节点分类性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图表示学习 图对比学习 图神经网络 多维对比学习 节点分类 无监督学习

📋 核心要点

- 现有图神经网络模型依赖大量标注数据,限制了其在实际场景中的应用,尤其是在标注数据稀缺的情况下。

- GRE^2-MDCL模型通过三重网络架构和多维对比损失,有效捕获局部和全局图结构,平衡节点级和图级表示。

- 实验结果表明,GRE^2-MDCL在Cora、Citeseer和PubMed数据集上取得了SOTA性能,并改善了聚类效果。

📝 摘要(中文)

图表示学习已成为一种强大的工具,用于在将节点映射到向量表示时保留图拓扑结构,从而实现各种下游任务,如节点分类和社区检测。然而,当前大多数图神经网络模型都面临着需要大量标记数据的挑战,这限制了它们在标记数据稀缺的实际场景中的应用。为了应对这一挑战,研究人员探索了图对比学习(GCL),它利用增强的图数据和对比学习技术。然而,现有的GCL方法通常难以有效地捕获局部和全局图结构,并平衡节点级和图级表示之间的权衡。本文提出了通过多维对比学习增强的图表示嵌入(GRE2-MDCL)。该模型引入了一种新颖的三重网络架构,以多头注意力GNN为核心。GRE2-MDCL首先使用SVD和LAGNN技术对输入图进行全局和局部增强。然后,它构建了一个多维对比损失,结合了跨网络、跨视图和邻居对比,以优化模型。在基准数据集Cora、Citeseer和PubMed上的大量实验表明,GRE2-MDCL实现了最先进的性能,平均准确率分别为82.5%、72.5%和81.6%。可视化结果进一步显示了更紧密的簇内聚合和更清晰的簇间边界,突出了我们的框架在改进基线GCL模型方面的有效性。

🔬 方法详解

问题定义:现有图神经网络模型在节点分类等任务中表现出色,但严重依赖大量标注数据。在实际应用中,图数据的标注成本高昂,导致模型泛化能力受限。现有的图对比学习方法难以同时捕捉局部和全局的图结构信息,并且在节点级别和图级别的表示之间难以取得平衡。

核心思路:GRE^2-MDCL的核心思路是通过多维对比学习,增强图表示的嵌入质量。具体来说,模型通过三重网络结构,从不同的角度学习图的表示,并利用跨网络、跨视图和邻居对比,使得模型能够同时关注局部和全局的图结构,从而提升模型的泛化能力。

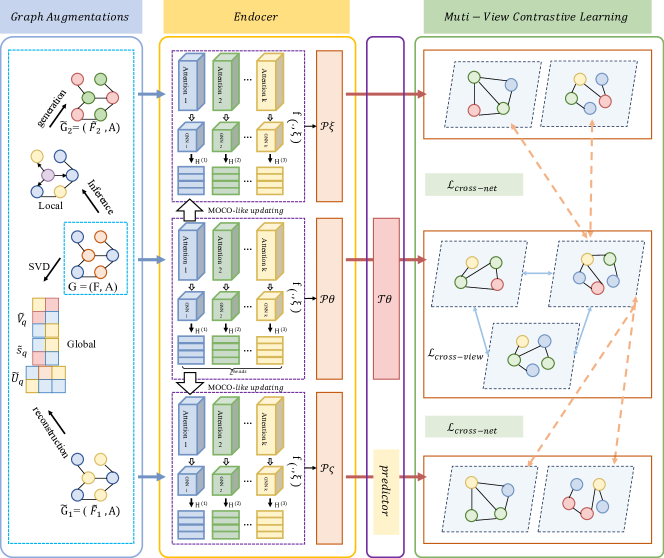

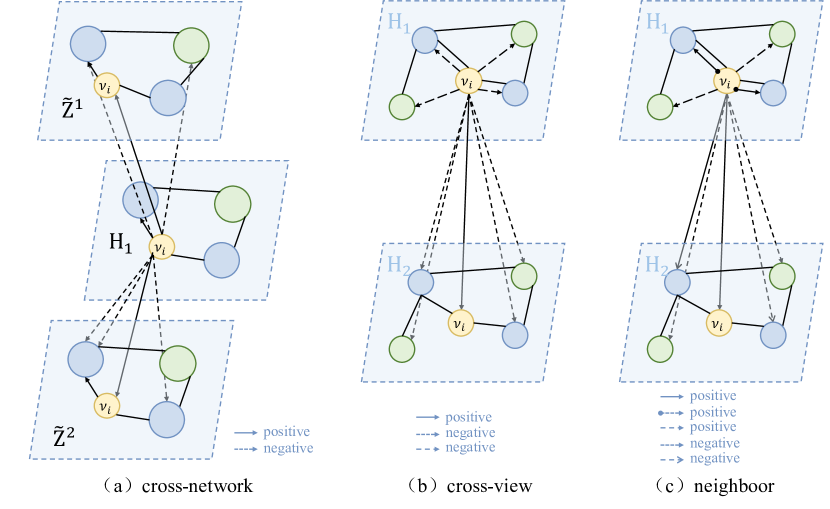

技术框架:GRE^2-MDCL模型包含以下几个主要模块:1) 图增强模块:使用SVD和LAGNN技术对输入图进行全局和局部增强,生成不同的图视图。2) 三重网络结构:包含三个并行的GNN网络,每个网络学习图的不同表示。3) 多维对比学习模块:构建跨网络、跨视图和邻居对比损失,用于优化模型。整体流程是:输入图经过图增强模块生成多个视图,然后通过三重网络结构学习表示,最后通过多维对比学习模块进行优化。

关键创新:GRE^2-MDCL的关键创新在于提出了多维对比学习策略,它不仅考虑了不同视图之间的对比,还考虑了不同网络之间的对比以及邻居节点之间的对比。这种多维度的对比学习方式能够更全面地捕捉图的结构信息,从而提升模型的表示能力。与现有方法相比,GRE^2-MDCL能够更好地平衡局部和全局图结构的学习,并有效利用未标记数据。

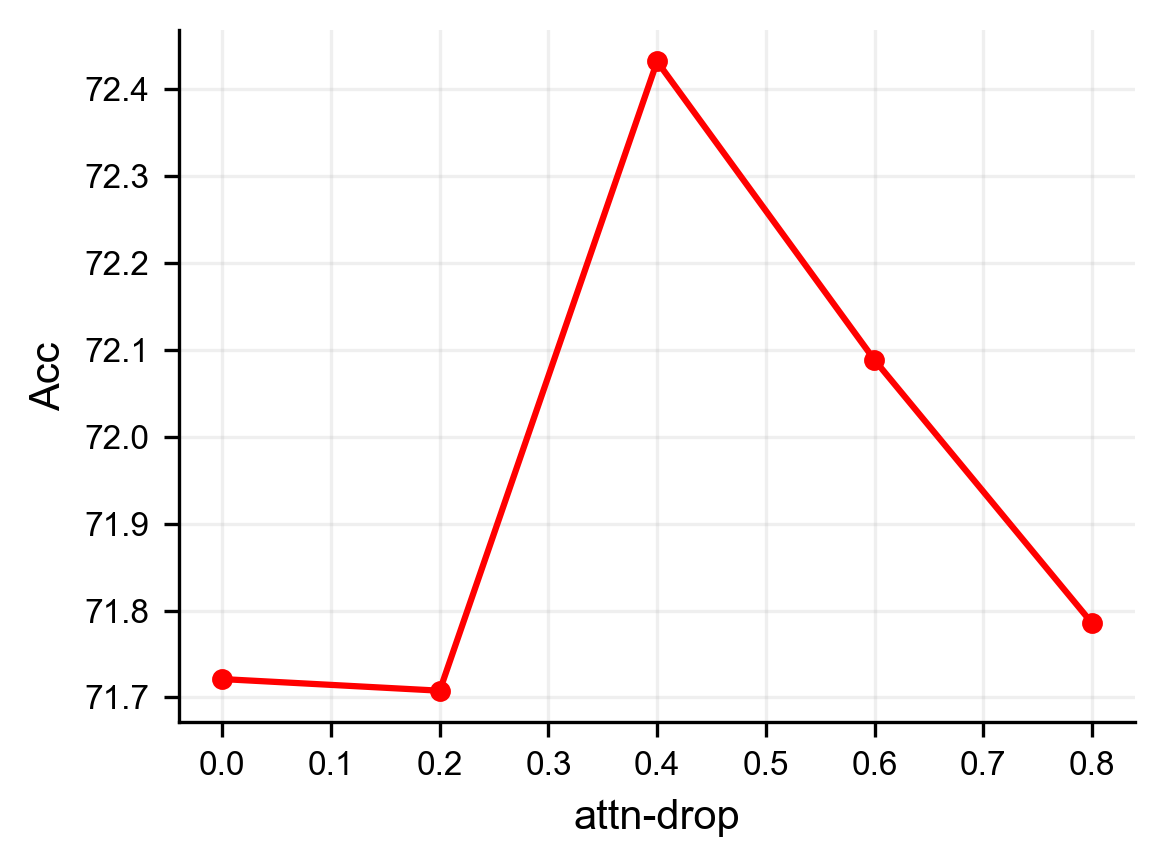

关键设计:模型使用了多头注意力GNN作为核心网络结构,以便更好地捕捉节点之间的关系。在损失函数方面,模型设计了跨网络对比损失、跨视图对比损失和邻居对比损失,并对这些损失进行加权求和。SVD和LAGNN的具体参数设置以及损失函数的权重需要根据具体数据集进行调整。

🖼️ 关键图片

📊 实验亮点

GRE^2-MDCL在Cora、Citeseer和PubMed三个基准数据集上取得了state-of-the-art的性能,平均准确率分别达到了82.5%、72.5%和81.6%。相比于基线GCL模型,GRE^2-MDCL在聚类效果上也有显著提升,可视化结果显示簇内聚合更紧密,簇间边界更清晰,验证了该模型在图表示学习方面的有效性。

🎯 应用场景

该研究成果可广泛应用于社交网络分析、生物信息学、推荐系统等领域。在社交网络中,可以用于识别社区结构、预测用户行为;在生物信息学中,可以用于蛋白质功能预测、药物发现;在推荐系统中,可以用于提升推荐的准确性和多样性。该研究的未来影响在于推动图神经网络在实际场景中的应用,尤其是在数据标注成本高昂的场景下。

📄 摘要(原文)

Graph representation learning has emerged as a powerful tool for preserving graph topology when mapping nodes to vector representations, enabling various downstream tasks such as node classification and community detection. However, most current graph neural network models face the challenge of requiring extensive labeled data, which limits their practical applicability in real-world scenarios where labeled data is scarce. To address this challenge, researchers have explored Graph Contrastive Learning (GCL), which leverages enhanced graph data and contrastive learning techniques. While promising, existing GCL methods often struggle with effectively capturing both local and global graph structures, and balancing the trade-off between nodelevel and graph-level representations. In this work, we propose Graph Representation Embedding Enhanced via Multidimensional Contrastive Learning (GRE2-MDCL). Our model introduces a novel triple network architecture with a multi-head attention GNN as the core. GRE2-MDCL first globally and locally augments the input graph using SVD and LAGNN techniques. It then constructs a multidimensional contrastive loss, incorporating cross-network, cross-view, and neighbor contrast, to optimize the model. Extensive experiments on benchmark datasets Cora, Citeseer, and PubMed demonstrate that GRE2-MDCL achieves state-of-the-art performance, with average accuracies of 82.5%, 72.5%, and 81.6% respectively. Visualizations further show tighter intra-cluster aggregation and clearer inter-cluster boundaries, highlighting the effectiveness of our framework in improving upon baseline GCL models.