LLM-based feature generation from text for interpretable machine learning

作者: Vojtěch Balek, Lukáš Sýkora, Vilém Sklenák, Tomáš Kliegr

分类: cs.LG, cs.CL

发布日期: 2024-09-11 (更新: 2025-08-27)

期刊: Machine Learning (2025) 114:241

DOI: 10.1007/s10994-025-06867-1

💡 一句话要点

提出基于LLM的文本特征生成方法,为可解释机器学习提供低维、语义化的特征表示。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM 特征生成 可解释机器学习 文本分类 科学文本 规则学习 自然语言处理

📋 核心要点

- 现有文本表示方法(如词嵌入)维度高,特征可解释性差,不适用于规则学习和可解释机器学习。

- 利用LLM从文本中提取少量、可解释的特征,降低维度,提升模型可解释性,并保持预测性能。

- 实验表明,LLM生成的特征与研究影响力相关,且在文本分类任务中性能与SciBERT相当,但特征维度更低。

📝 摘要(中文)

本文探讨了大型语言模型(LLM)是否能够通过从文本中提取少量可解释的特征来解决现有文本表示(如嵌入和词袋模型)在高维度和特征级可解释性方面的不足。我们在包含来自多个学科的数千篇科学文章的两个数据集(CORD-19和M17+)上验证了该方法,目标是研究影响力的代理指标。基于与研究影响力统计显著相关的测试评估表明,LLama 2生成的特征具有语义意义。我们随后在文本分类中使用这些生成的特征来预测CORD-19数据集的二元目标变量(代表引用率)和M17+数据集的五类有序目标变量(代表专家评分)。在LLM生成的特征上训练的机器学习模型提供了与最先进的科学文本嵌入模型SciBERT相似的预测性能。LLM仅使用了62个特征,而SciBERT嵌入使用了768个特征,并且这些特征是直接可解释的,对应于文章的方法严谨性、新颖性或语法正确性等概念。最后,我们提取了少量可解释的行动规则。在两个主题不同的数据集上使用相同的LLM特征集获得的一致且具有竞争力的结果表明,该方法具有跨领域的泛化能力。

🔬 方法详解

问题定义:现有文本表示方法,如词嵌入和词袋模型,在高维空间中表示文本,导致模型复杂且难以解释。这些方法提取的特征通常缺乏明确的语义含义,难以用于规则学习和可解释机器学习。因此,需要一种能够提取低维、可解释特征的文本表示方法。

核心思路:利用大型语言模型(LLM)的语义理解和生成能力,直接从文本中提取具有明确语义含义的特征。通过设计合适的提示词(prompt),引导LLM将文本内容概括为一系列可解释的特征,例如文章的方法严谨性、新颖性、语法正确性等。这样既降低了特征维度,又提高了模型的可解释性。

技术框架:该方法主要包含以下几个阶段:1) 数据准备:收集包含文本内容和目标变量(如引用率、专家评分)的数据集。2) 特征生成:使用LLM(如LLama 2)从文本中提取特征。通过精心设计的提示词,引导LLM生成与目标变量相关的、可解释的特征。3) 模型训练:使用生成的特征训练机器学习模型(如逻辑回归、支持向量机)来预测目标变量。4) 规则提取:从训练好的模型中提取可解释的规则,进一步提高模型的可解释性。

关键创新:该方法的核心创新在于利用LLM直接生成可解释的文本特征。与传统的文本表示方法相比,该方法无需进行复杂的特征工程,而是通过LLM的语义理解能力,自动提取与任务相关的、具有明确语义含义的特征。这大大降低了特征维度,提高了模型的可解释性,并简化了模型训练流程。

关键设计:在特征生成阶段,提示词的设计至关重要。需要根据具体的任务和数据集,设计能够引导LLM生成所需特征的提示词。例如,可以要求LLM评估文章的方法严谨性、新颖性、语法正确性等。此外,还可以通过调整LLM的生成参数(如温度、top-p)来控制生成特征的多样性和质量。在模型训练阶段,可以选择不同的机器学习模型,并根据数据集的特点进行参数调整。

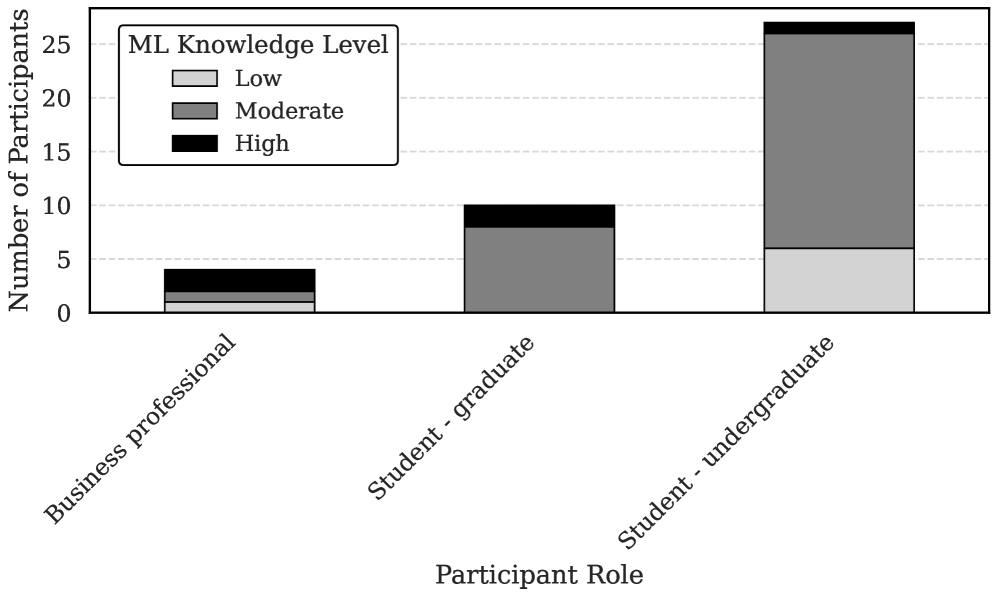

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用LLama 2生成的62个特征,在CORD-19和M17+数据集上,文本分类性能与使用SciBERT嵌入(768个特征)相当。更重要的是,LLM生成的特征具有直接的可解释性,例如文章的方法严谨性、新颖性等,这为理解模型预测提供了重要的依据。

🎯 应用场景

该研究成果可应用于多个领域,例如科研论文影响力评估、文本分类、信息检索等。通过提取可解释的文本特征,可以帮助用户更好地理解模型的预测结果,并发现文本中隐藏的模式和规律。此外,该方法还可以用于构建可解释的推荐系统和决策支持系统,提高用户对系统的信任度。

📄 摘要(原文)

Existing text representations such as embeddings and bag-of-words are not suitable for rule learning due to their high dimensionality and absent or questionable feature-level interpretability. This article explores whether large language models (LLMs) could address this by extracting a small number of interpretable features from text. We demonstrate this process on two datasets (CORD-19 and M17+) containing several thousand scientific articles from multiple disciplines and a target being a proxy for research impact. An evaluation based on testing for the statistically significant correlation with research impact has shown that LLama 2-generated features are semantically meaningful. We consequently used these generated features in text classification to predict the binary target variable representing the citation rate for the CORD-19 dataset and the ordinal 5-class target representing an expert-awarded grade in the M17+ dataset. Machine-learning models trained on the LLM-generated features provided similar predictive performance to the state-of-the-art embedding model SciBERT for scientific text. The LLM used only 62 features compared to 768 features in SciBERT embeddings, and these features were directly interpretable, corresponding to notions such as article methodological rigor, novelty, or grammatical correctness. As the final step, we extract a small number of well-interpretable action rules. Consistently competitive results obtained with the same LLM feature set across both thematically diverse datasets show that this approach generalizes across domains.