Stacked Universal Successor Feature Approximators for Safety in Reinforcement Learning

作者: Ian Cannon, Washington Garcia, Thomas Gresavage, Joseph Saurine, Ian Leong, Jared Culbertson

分类: cs.LG, cs.AI

发布日期: 2024-09-06

备注: 13 pages

💡 一句话要点

提出堆叠通用后继特征近似器(SUSFAS)以提升强化学习安全性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 安全性 通用后继特征近似 软演员-评论家 多目标优化

📋 核心要点

- 现实强化学习面临复杂目标结构,单一目标难以兼顾安全性、多维任务性能和未来可用性。

- 论文提出堆叠通用后继特征近似器(SUSFAS),结合软演员-评论家(SAC)和辅助安全控制器,提升安全性。

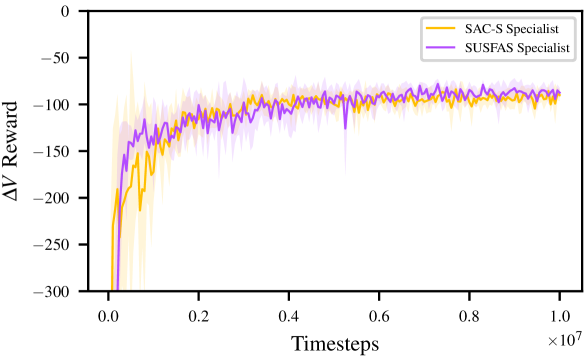

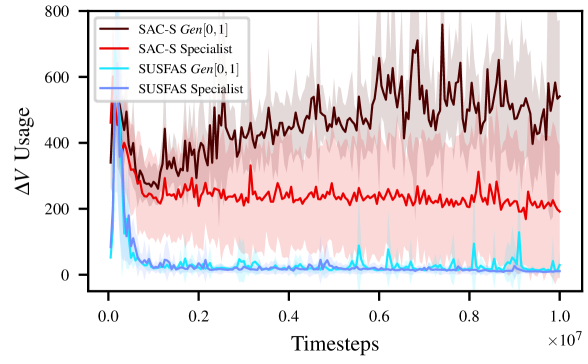

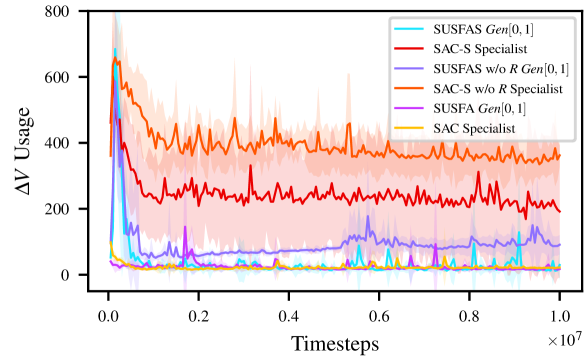

- 实验表明,SUSFAS在辅助目标上优于使用运行时保证(RTA)控制器的SAC基线。

📝 摘要(中文)

现实世界的问题通常涉及复杂的目标结构,难以简化为具有单一目标的强化学习环境。运营成本必须与多维任务性能以及最终状态对未来可用性的影响相平衡,同时确保环境和其他智能体以及强化学习智能体自身的安全。通过辅助备份控制器实现系统冗余已被证明是确保高约束违反风险的实际应用中安全性的有效方法。本文研究了通用后继特征近似(USFA)的堆叠式连续控制变体的效用,该变体适用于软演员-评论家(SAC),并与一套辅助安全控制器相结合,我们称之为用于安全的堆叠USFA(SUSFAS)。与使用运行时保证(RTA)控制器等干预辅助控制器的SAC基线相比,我们的方法提高了辅助目标的性能。

🔬 方法详解

问题定义:论文旨在解决强化学习在复杂现实环境中应用时,难以同时优化多个目标(如任务性能、运营成本、安全性)的问题。现有方法,特别是依赖单一目标函数的方法,难以有效平衡这些相互冲突的目标,并且在安全性方面存在不足。即使引入运行时保证(RTA)等辅助控制器,性能提升也有限。

核心思路:论文的核心思路是利用通用后继特征近似(USFA)来学习状态的后继特征,从而能够灵活地评估不同目标。通过堆叠多个USFA模块,并结合软演员-评论家(SAC)算法,可以同时优化多个目标,包括安全性。辅助安全控制器作为保障,在主控制器失效时介入,确保安全性。

技术框架:SUSFAS框架包含以下主要模块:1) 软演员-评论家(SAC)主控制器,负责学习主要任务策略;2) 堆叠的通用后继特征近似器(USFA),用于学习状态的后继特征,评估不同目标;3) 一组辅助安全控制器,例如运行时保证(RTA)控制器,用于在主控制器失效时介入,保障安全性。整体流程是,SAC主控制器根据当前状态选择动作,USFA评估该动作对不同目标的影响,辅助安全控制器监控主控制器的动作,并在必要时进行干预。

关键创新:论文的关键创新在于将堆叠的USFA与SAC和辅助安全控制器相结合,形成SUSFAS框架。这种方法能够更有效地学习和优化多个目标,特别是安全性,同时保持较高的任务性能。与传统的单一目标强化学习方法相比,SUSFAS能够更好地适应复杂现实环境的需求。

关键设计:论文中USFA采用连续控制变体,以适应SAC算法。堆叠的USFA模块允许学习不同层次的后继特征,从而更好地捕捉复杂的目标结构。辅助安全控制器的设计需要根据具体的应用场景进行调整,例如,RTA控制器需要定义安全状态空间和允许的动作空间。损失函数的设计需要平衡不同目标的优化,例如,可以采用加权和的方式,根据不同目标的优先级进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SUSFAS在辅助目标上的性能优于使用运行时保证(RTA)控制器的SAC基线。具体性能提升数据未知,但论文强调SUSFAS能够更有效地平衡多个目标,并在保障安全性的前提下,提升任务性能。该方法在复杂目标结构和高安全约束的强化学习问题中具有显著优势。

🎯 应用场景

该研究成果可应用于机器人、自动驾驶、工业控制等领域,尤其适用于对安全性要求极高的场景。例如,在自动驾驶中,SUSFAS可以同时优化行驶效率、乘客舒适度和安全性,避免碰撞事故的发生。在工业控制中,可以优化生产效率、能源消耗和设备安全,降低故障风险。

📄 摘要(原文)

Real-world problems often involve complex objective structures that resist distillation into reinforcement learning environments with a single objective. Operation costs must be balanced with multi-dimensional task performance and end-states' effects on future availability, all while ensuring safety for other agents in the environment and the reinforcement learning agent itself. System redundancy through secondary backup controllers has proven to be an effective method to ensure safety in real-world applications where the risk of violating constraints is extremely high. In this work, we investigate the utility of a stacked, continuous-control variation of universal successor feature approximation (USFA) adapted for soft actor-critic (SAC) and coupled with a suite of secondary safety controllers, which we call stacked USFA for safety (SUSFAS). Our method improves performance on secondary objectives compared to SAC baselines using an intervening secondary controller such as a runtime assurance (RTA) controller.