Seeking the Sufficiency and Necessity Causal Features in Multimodal Representation Learning

作者: Boyu Chen, Junjie Liu, Zhu Li, Mengyue Yang

分类: cs.LG, cs.AI

发布日期: 2024-08-29 (更新: 2024-11-26)

💡 一句话要点

提出基于必要性和充分性因果特征的多模态表征学习方法,提升预测性能和鲁棒性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 表征学习 因果特征 必要性与充分性 模态不变性 模态特异性 PNS 多模态融合

📋 核心要点

- 现有方法在多模态数据中应用PNS进行表征学习面临外生性和单调性等挑战。

- 将多模态表征分解为模态不变和模态特定组件,分别计算PNS并优化。

- 实验表明,该方法在合成数据和真实数据上均能有效提升模型性能。

📝 摘要(中文)

必要性和充分性概率(PNS)衡量一个特征集对于预测结果的必要性和充分性的可能性。它已被证明在指导单模态数据的表征学习方面是有效的,增强了预测性能和模型的鲁棒性。尽管有这些好处,但将PNS扩展到多模态设置仍未被探索。这种扩展带来了独特的挑战,因为PNS估计的条件,外生性和单调性,需要在多模态环境中重新考虑。我们通过首先将多模态表征概念化为包含模态不变和模态特定的组件来解决这些挑战。然后,我们分析如何计算每个组件的PNS,同时确保非平凡的PNS估计。基于这些分析,我们制定了易于处理的优化目标,使多模态模型能够学习高PNS表征。实验证明了我们的方法在合成和真实数据上的有效性。

🔬 方法详解

问题定义:论文旨在解决多模态表征学习中如何有效利用必要性和充分性概率(PNS)来提升模型性能和鲁棒性的问题。现有方法主要集中在单模态数据上,直接将PNS扩展到多模态数据会遇到外生性和单调性等问题,导致PNS估计不准确,无法有效指导表征学习。

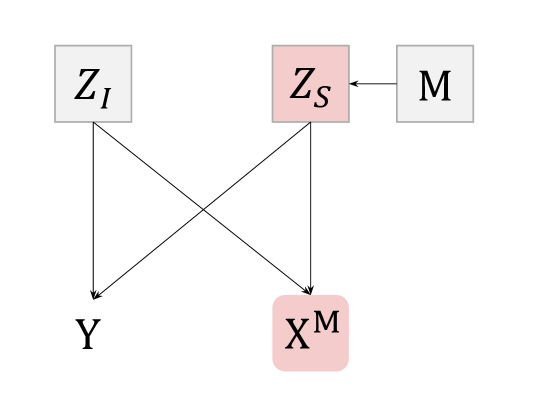

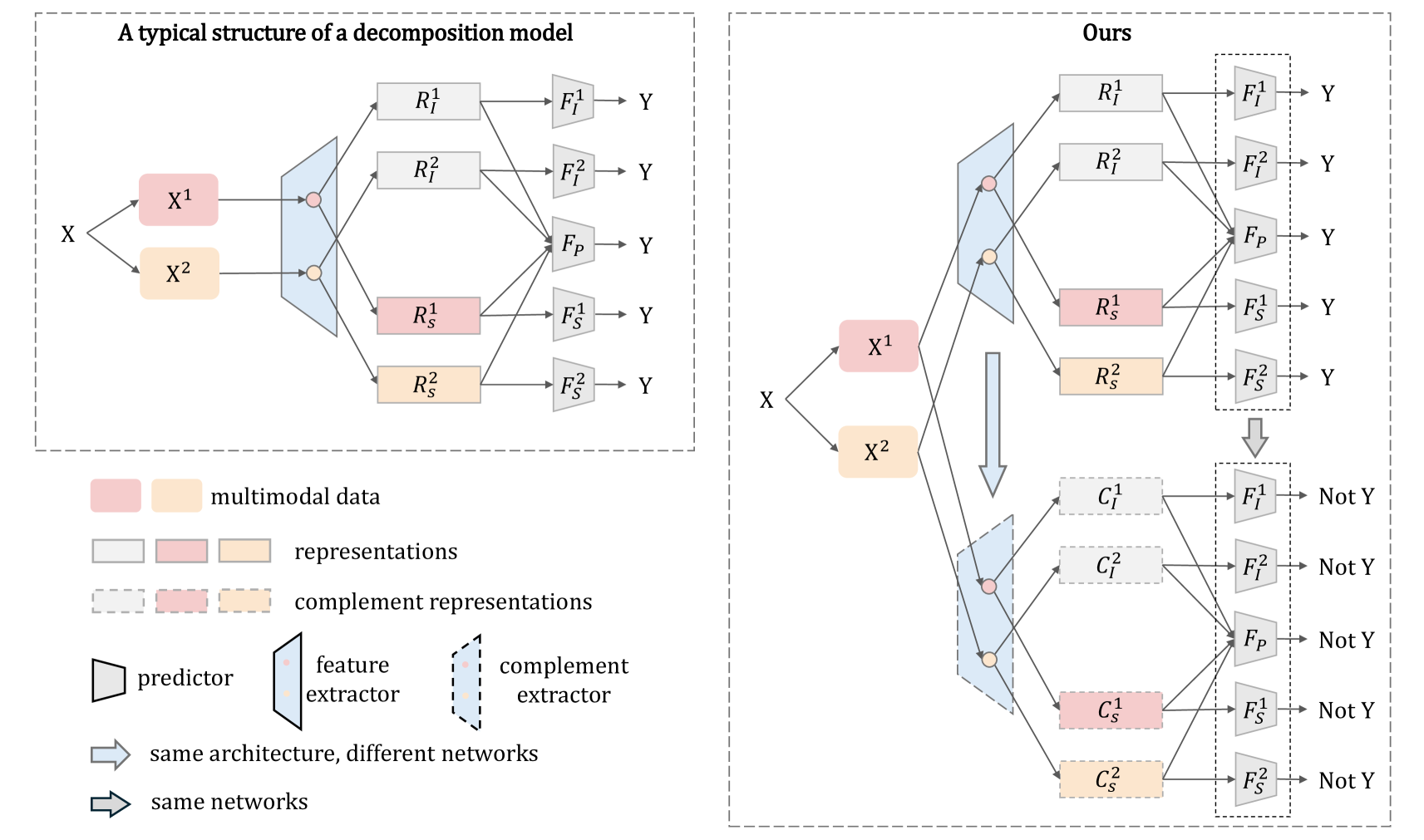

核心思路:论文的核心思路是将多模态表征分解为模态不变和模态特定两个组成部分。模态不变部分捕捉所有模态共享的信息,而模态特定部分捕捉每个模态独有的信息。然后,针对这两个部分分别计算PNS,并设计相应的优化目标,从而确保PNS估计的有效性,并指导模型学习更具因果性的表征。这种分解能够更好地处理多模态数据中的复杂关系,避免直接应用单模态PNS带来的问题。

技术框架:整体框架包含以下几个主要步骤:1) 多模态数据输入;2) 表征学习模块,将多模态数据映射到表征空间,并分解为模态不变和模态特定两部分;3) PNS计算模块,分别计算模态不变和模态特定表征的PNS;4) 优化模块,根据PNS值调整表征学习过程,使模型学习到高PNS的表征。整个框架通过迭代优化,最终得到具有良好预测性能和鲁棒性的多模态表征。

关键创新:论文最重要的创新点在于提出了针对多模态数据的PNS计算方法。与现有方法直接将单模态PNS扩展到多模态数据不同,该方法通过分解模态不变和模态特定表征,并分别计算PNS,从而解决了多模态数据中外生性和单调性难以满足的问题。这种分解和分别计算的策略,使得PNS能够更准确地反映特征与结果之间的因果关系,从而更好地指导表征学习。

关键设计:论文的关键设计包括:1) 如何将多模态表征分解为模态不变和模态特定两部分,可以使用共享编码器和独立编码器来实现;2) 如何定义和计算模态不变和模态特定表征的PNS,需要考虑不同模态之间的依赖关系;3) 如何设计优化目标,以最大化PNS,同时保证表征的质量和多样性。具体的损失函数可能包含PNS损失、重构损失和正则化项等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在合成数据集和真实数据集上均取得了显著的性能提升。与现有基线方法相比,该方法能够学习到更高质量的多模态表征,从而提升预测准确性和模型鲁棒性。具体的性能提升幅度未知,需要在论文中查找具体的实验数据。

🎯 应用场景

该研究成果可应用于各种多模态数据分析任务,例如:多模态情感识别、多模态医学诊断、多模态行为分析等。通过学习更具因果性的多模态表征,可以提升模型在这些任务上的预测准确性和鲁棒性,从而为实际应用带来更大的价值和影响。

📄 摘要(原文)

Probability of necessity and sufficiency (PNS) measures the likelihood of a feature set being both necessary and sufficient for predicting an outcome. It has proven effective in guiding representation learning for unimodal data, enhancing both predictive performance and model robustness. Despite these benefits, extending PNS to multimodal settings remains unexplored. This extension presents unique challenges, as the conditions for PNS estimation, exogeneity and monotonicity, need to be reconsidered in a multimodal context. We address these challenges by first conceptualizing multimodal representations as comprising modality-invariant and modality-specific components. We then analyze how to compute PNS for each component while ensuring non-trivial PNS estimation. Based on these analyses, we formulate tractable optimization objectives that enable multimodal models to learn high-PNS representations. Experiments demonstrate the effectiveness of our method on both synthetic and real-world data.