Learning Differentially Private Diffusion Models via Stochastic Adversarial Distillation

作者: Bochao Liu, Pengju Wang, Shiming Ge

分类: cs.LG, cs.CR, cs.CV

发布日期: 2024-08-27

备注: accepted by ECCV 2024

💡 一句话要点

提出DP-SAD,通过随机对抗蒸馏学习差分隐私扩散模型,提升生成质量。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 差分隐私 扩散模型 生成模型 对抗训练 蒸馏学习 隐私保护 数据脱敏

📋 核心要点

- 现有差分隐私生成模型在复杂数据分布建模方面存在不足,导致生成图像质量受限。

- 提出DP-SAD,利用随机对抗蒸馏方法训练私有扩散模型,提升生成质量并保护数据隐私。

- 实验结果表明,DP-SAD方法在生成质量方面表现出色,验证了其有效性。

📝 摘要(中文)

深度学习的成功依赖于大量的训练数据集,但在隐私敏感领域,数据往往受限。为了解决这一挑战,结合差分隐私的生成模型学习应运而生,旨在训练用于脱敏数据生成的私有生成模型。然而,由于数据分布建模的复杂性,现有方法生成的图像质量有限。本文基于扩散模型的成功,提出了DP-SAD,通过随机对抗蒸馏方法训练私有扩散模型。具体而言,首先训练一个扩散模型作为教师模型,然后通过蒸馏训练学生模型,通过向来自其他模型的梯度添加噪声来实现差分隐私。为了获得更好的生成质量,引入了一个判别器来区分图像是来自教师模型还是学生模型,从而形成对抗训练。大量的实验和分析清楚地证明了所提出方法的有效性。

🔬 方法详解

问题定义:论文旨在解决在隐私敏感领域,由于数据量有限,如何训练高质量的差分隐私生成模型的问题。现有方法在建模复杂数据分布时表现不佳,导致生成的图像质量不高。

核心思路:论文的核心思路是利用扩散模型强大的生成能力,并结合蒸馏和对抗训练,在保证差分隐私的前提下,提升生成图像的质量。通过教师-学生模型的蒸馏过程,将教师模型的知识迁移到学生模型,同时加入噪声以满足差分隐私的要求。对抗训练则进一步提升学生模型的生成能力。

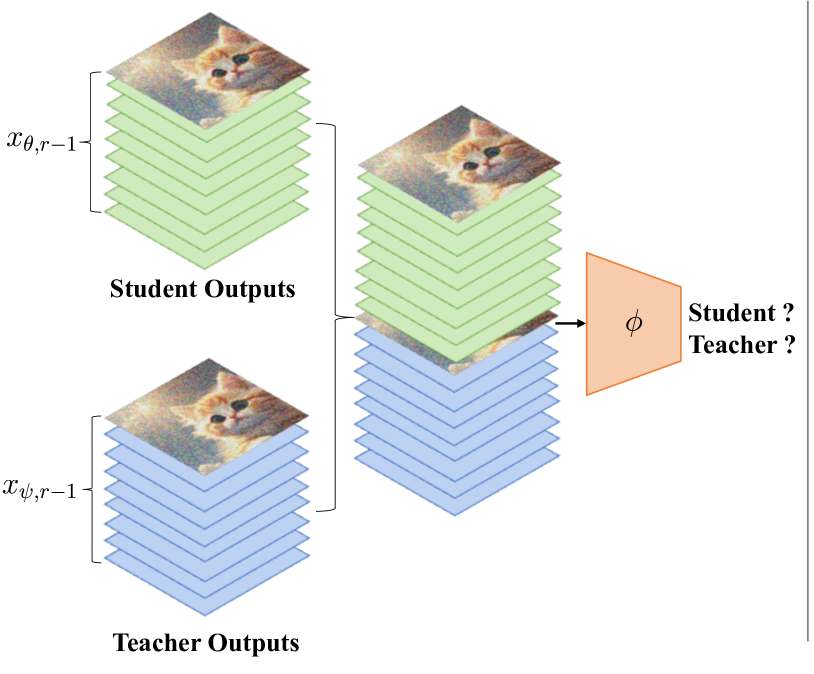

技术框架:DP-SAD的整体框架包含三个主要部分:教师扩散模型、学生扩散模型和判别器。首先,训练一个非私有的教师扩散模型。然后,利用教师模型指导学生模型的训练,通过蒸馏的方式将知识迁移到学生模型。在学生模型的训练过程中,为了满足差分隐私的要求,会向梯度中添加噪声。最后,引入一个判别器来区分生成的图像是来自教师模型还是学生模型,通过对抗训练来提升学生模型的生成质量。

关键创新:该方法的主要创新点在于将随机对抗蒸馏技术与差分隐私扩散模型相结合。通过对抗训练,可以有效地提升学生模型的生成质量,弥补了因添加噪声而导致的性能损失。此外,使用扩散模型作为生成器,能够更好地建模复杂的数据分布。

关键设计:在学生模型的训练过程中,需要仔细调整噪声的添加量,以平衡隐私保护和生成质量。损失函数包括蒸馏损失和对抗损失。蒸馏损失用于衡量学生模型与教师模型之间的差异,对抗损失用于提升学生模型的生成能力。判别器的网络结构需要根据具体的数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DP-SAD方法在生成图像质量方面显著优于现有的差分隐私生成模型。通过对抗训练,DP-SAD能够生成更加逼真、多样化的图像。具体的性能提升幅度取决于数据集和隐私预算,但总体而言,DP-SAD能够在保证差分隐私的前提下,显著提升生成图像的质量。

🎯 应用场景

该研究成果可应用于医疗健康、金融等隐私敏感领域,用于生成脱敏数据,从而支持相关领域的研究和应用。例如,可以生成合成的医疗影像数据,用于训练疾病诊断模型,而无需泄露患者的隐私信息。此外,该方法还可以用于生成其他类型的敏感数据,如用户行为数据、财务数据等。

📄 摘要(原文)

While the success of deep learning relies on large amounts of training datasets, data is often limited in privacy-sensitive domains. To address this challenge, generative model learning with differential privacy has emerged as a solution to train private generative models for desensitized data generation. However, the quality of the images generated by existing methods is limited due to the complexity of modeling data distribution. We build on the success of diffusion models and introduce DP-SAD, which trains a private diffusion model by a stochastic adversarial distillation method. Specifically, we first train a diffusion model as a teacher and then train a student by distillation, in which we achieve differential privacy by adding noise to the gradients from other models to the student. For better generation quality, we introduce a discriminator to distinguish whether an image is from the teacher or the student, which forms the adversarial training. Extensive experiments and analysis clearly demonstrate the effectiveness of our proposed method.