Hyperdimensional Computing Empowered Federated Foundation Model over Wireless Networks for Metaverse

作者: Yahao Ding, Wen Shang, Minrui Xu, Zhaohui Yang, Ye Hu, Dusit Niyato, Mohammad Shikh-Bahaei

分类: cs.LG, cs.DC

发布日期: 2024-08-26

💡 一句话要点

提出基于超维计算的联邦分裂学习框架,用于元宇宙中资源受限设备的联邦学习。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 超维计算 联邦分裂学习 元宇宙 边缘计算

📋 核心要点

- 联邦学习在元宇宙等场景中面临高通信开销和计算需求,尤其是在资源受限的边缘设备上。

- 论文提出联邦分裂学习和超维计算(FSL-HDC)框架,旨在降低通信成本、计算负载和隐私风险。

- 实验表明,FSL-HDC在MNIST数据集上达到约87.5%的准确率,收敛速度是FSL-NN的3.733倍,并对非IID数据具有鲁棒性。

📝 摘要(中文)

元宇宙作为一个新兴的融合增强现实和持久虚拟世界的集体虚拟空间,需要先进的人工智能和通信技术来支持沉浸式和交互式体验。联邦学习(FL)已成为一种有前途的技术,用于在保护数据隐私的同时协同训练AI模型。然而,FL面临着高通信开销和大量计算需求等挑战,特别是对于神经网络(NN)模型。为了解决这些问题,我们提出了一种集成的联邦分裂学习和超维计算(FSL-HDC)框架,用于新兴的基础模型。这种新方法降低了通信成本、计算负载和隐私风险,使其特别适用于元宇宙中资源受限的边缘设备,确保实时响应交互。此外,我们还引入了一种优化算法,该算法同时优化传输功率和带宽,以最小化所有用户到服务器的最大传输时间。基于MNIST数据集的仿真结果表明,FSL-HDC的准确率约为87.5%,略低于FL-HDC。然而,FSL-HDC表现出明显更快的收敛速度,约为FSL-NN的3.733倍,并表现出对非IID数据分布的鲁棒性。此外,我们提出的优化算法可以将最大传输时间减少高达64%。

🔬 方法详解

问题定义:论文旨在解决元宇宙中资源受限的边缘设备上,联邦学习由于通信开销大和计算需求高而难以应用的问题。现有方法,如传统的联邦学习和神经网络模型,在这些场景下效率低下,并且存在隐私泄露的风险。

核心思路:论文的核心思路是结合联邦分裂学习和超维计算,利用联邦分裂学习降低通信开销,利用超维计算降低计算复杂度,从而使联邦学习能够在资源受限的边缘设备上高效运行。同时,通过优化传输功率和带宽,进一步降低通信延迟。

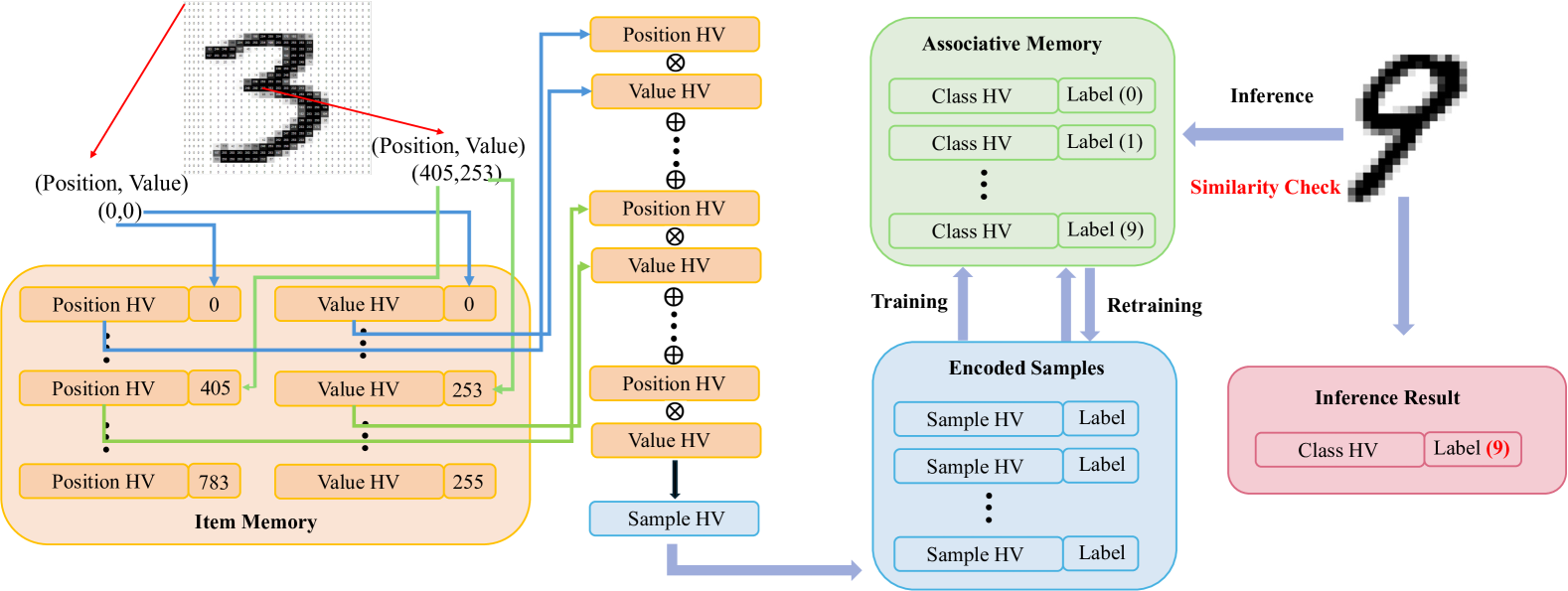

技术框架:该框架包含以下主要模块:1) 联邦分裂学习:将模型分为客户端部分和服务器部分,客户端只训练部分模型,减少计算量;2) 超维计算:使用超维向量表示数据和模型,降低计算复杂度;3) 传输优化:优化传输功率和带宽,最小化最大传输时间。客户端首先进行本地数据处理和部分模型训练,然后将中间结果(超维向量)发送到服务器,服务器完成剩余的模型训练和聚合,最后将更新后的模型参数发送回客户端。

关键创新:论文的关键创新在于将联邦分裂学习和超维计算相结合,并针对无线网络环境进行优化。联邦分裂学习降低了客户端的计算负担,超维计算降低了模型的复杂度,而传输优化则保证了通信效率。这种结合使得联邦学习能够在资源受限的边缘设备上高效运行,并具有良好的隐私保护能力。

关键设计:论文的关键设计包括:1) 超维向量的维度选择:需要根据数据集的复杂度和计算资源进行权衡;2) 联邦分裂学习的模型分割策略:需要考虑客户端和服务器的计算能力,以及模型的隐私敏感性;3) 传输功率和带宽的优化算法:需要考虑信道条件和设备功耗。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FSL-HDC在MNIST数据集上达到了约87.5%的准确率,略低于FL-HDC,但收敛速度是FSL-NN的3.733倍。此外,该方法对非IID数据具有鲁棒性,并且提出的优化算法可以将最大传输时间减少高达64%。这些结果表明,FSL-HDC在资源受限的边缘设备上具有良好的性能和效率。

🎯 应用场景

该研究成果可应用于元宇宙中的各种场景,例如虚拟现实游戏、增强现实应用、数字孪生等。通过在边缘设备上部署FSL-HDC框架,可以实现低延迟、高效率的AI服务,提升用户体验,并保护用户数据隐私。此外,该方法还可以推广到其他资源受限的联邦学习应用场景,例如物联网、移动医疗等。

📄 摘要(原文)

The Metaverse, a burgeoning collective virtual space merging augmented reality and persistent virtual worlds, necessitates advanced artificial intelligence (AI) and communication technologies to support immersive and interactive experiences. Federated learning (FL) has emerged as a promising technique for collaboratively training AI models while preserving data privacy. However, FL faces challenges such as high communication overhead and substantial computational demands, particularly for neural network (NN) models. To address these issues, we propose an integrated federated split learning and hyperdimensional computing (FSL-HDC) framework for emerging foundation models. This novel approach reduces communication costs, computation load, and privacy risks, making it particularly suitable for resource-constrained edge devices in the Metaverse, ensuring real-time responsive interactions. Additionally, we introduce an optimization algorithm that concurrently optimizes transmission power and bandwidth to minimize the maximum transmission time among all users to the server. The simulation results based on the MNIST dataset indicate that FSL-HDC achieves an accuracy rate of approximately 87.5%, which is slightly lower than that of FL-HDC. However, FSL-HDC exhibits a significantly faster convergence speed, approximately 3.733x that of FSL-NN, and demonstrates robustness to non-IID data distributions. Moreover, our proposed optimization algorithm can reduce the maximum transmission time by up to 64% compared with the baseline.