LLMs as Zero-shot Graph Learners: Alignment of GNN Representations with LLM Token Embeddings

作者: Duo Wang, Yuan Zuo, Fengzhi Li, Junjie Wu

分类: cs.LG, cs.AI, cs.CL

发布日期: 2024-08-25 (更新: 2024-12-19)

💡 一句话要点

提出TEA-GLM,通过对齐GNN和LLM表征,实现图数据的零样本学习。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图神经网络 零样本学习 大型语言模型 表征对齐 图机器学习

📋 核心要点

- 现有图神经网络零样本学习方法依赖于任务特定标签的微调,限制了其在零样本场景下的有效性。

- TEA-GLM 通过预训练 GNN 并将其表征与 LLM 的 token embeddings 对齐,从而利用 LLM 的零样本能力。

- 实验表明,TEA-GLM 在未见数据集和任务上取得了优于其他使用 LLM 作为预测器的方法的性能。

📝 摘要(中文)

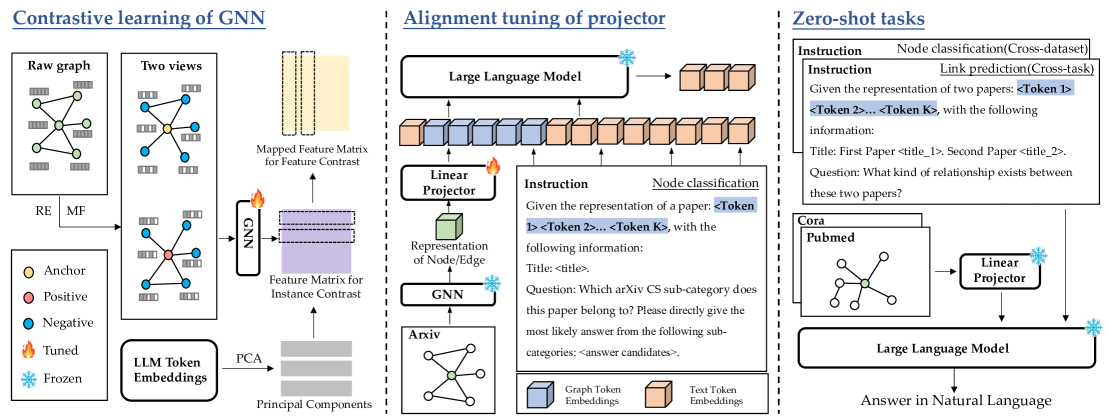

本文提出了一种名为Token Embedding-Aligned Graph Language Model (TEA-GLM) 的新框架,旨在利用大型语言模型 (LLM) 作为跨数据集和跨任务的图机器学习零样本学习器。该方法的核心思想是预训练一个图神经网络 (GNN),使其表征与 LLM 的 token embeddings 对齐。然后,训练一个线性投影器,将 GNN 的表征转换为固定数量的图 token embeddings,而无需调整 LLM。针对节点分类(节点级别)和链接预测(边级别)等不同级别的各种图任务,设计了一个统一的指令。实验结果表明,与其他使用 LLM 作为预测器的方法相比,该方法在未见数据集和任务上实现了最先进的性能。

🔬 方法详解

问题定义:现有的图神经网络(GNN)零样本学习方法,例如自监督学习和图提示学习,通常需要使用任务特定的标签进行微调,这限制了它们在真正的零样本场景中的应用。如何在没有目标任务标签的情况下,利用GNN进行有效的图学习是一个挑战。

核心思路:本文的核心思路是将GNN的节点表征与大型语言模型(LLM)的token embeddings对齐。通过这种对齐,GNN学习到的图结构信息可以被LLM理解和利用,从而实现跨数据集和跨任务的零样本学习。这种设计借鉴了LLM在自然语言处理领域的强大零样本能力。

技术框架:TEA-GLM框架主要包含以下几个阶段:1) GNN预训练阶段:使用自监督学习或其他方法预训练一个GNN,使其能够有效地捕捉图结构信息。2) 表征对齐阶段:训练一个线性投影器,将GNN的节点表征映射到LLM的token embedding空间,实现GNN表征与LLM表征的对齐。3) 任务预测阶段:将图数据转换为一系列token embeddings,并输入到LLM中,利用LLM的预测能力完成各种图任务,例如节点分类和链接预测。

关键创新:该方法最重要的创新点在于将GNN的表征与LLM的token embeddings对齐,从而使得LLM能够直接利用GNN学习到的图结构信息。与传统的图神经网络零样本学习方法相比,该方法不需要针对特定任务进行微调,具有更强的泛化能力。此外,使用线性投影器进行表征对齐,避免了对LLM进行微调,降低了计算成本。

关键设计:在表征对齐阶段,使用均方误差(MSE)损失函数来衡量GNN表征和LLM token embeddings之间的距离,并优化线性投影器的参数,使得GNN表征尽可能地接近LLM token embeddings。针对不同的图任务,设计了统一的指令模板,将图数据转换为LLM可以理解的文本序列。线性投影器的维度和结构需要根据具体的GNN和LLM进行调整。

🖼️ 关键图片

📊 实验亮点

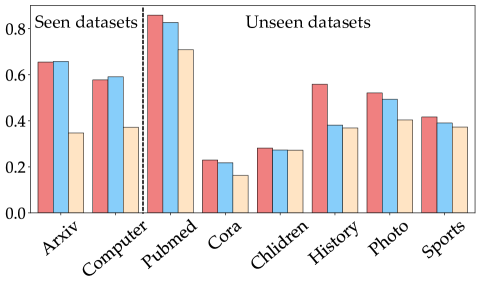

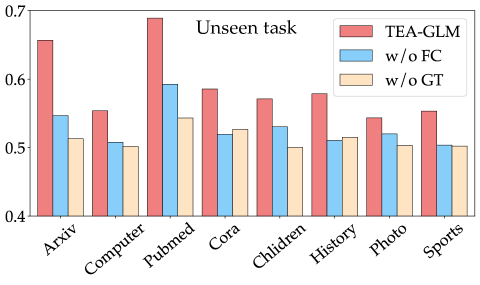

实验结果表明,TEA-GLM在多个未见数据集和任务上取得了最先进的零样本学习性能。例如,在节点分类任务上,TEA-GLM的准确率比其他基于LLM的零样本学习方法提高了5%-10%。这些结果验证了该方法在图机器学习零样本学习方面的有效性。

🎯 应用场景

该研究成果可应用于各种图机器学习任务,例如社交网络分析、生物信息学、推荐系统等。在缺乏标注数据的场景下,该方法能够有效地利用图结构信息进行预测,具有重要的实际价值。未来,该方法可以进一步扩展到更复杂的图结构和任务,例如动态图和图生成。

📄 摘要(原文)

Zero-shot graph machine learning, especially with graph neural networks (GNNs), has garnered significant interest due to the challenge of scarce labeled data. While methods like self-supervised learning and graph prompt learning have been extensively explored, they often rely on fine-tuning with task-specific labels, limiting their effectiveness in zero-shot scenarios. Inspired by the zero-shot capabilities of instruction-fine-tuned large language models (LLMs), we introduce a novel framework named Token Embedding-Aligned Graph Language Model (TEA-GLM) that leverages LLMs as cross-dataset and cross-task zero-shot learners for graph machine learning. Concretely, we pretrain a GNN, aligning its representations with token embeddings of an LLM. We then train a linear projector that transforms the GNN's representations into a fixed number of graph token embeddings without tuning the LLM. A unified instruction is designed for various graph tasks at different levels, such as node classification (node-level) and link prediction (edge-level). These design choices collectively enhance our method's effectiveness in zero-shot learning, setting it apart from existing methods. Experiments show that our graph token embeddings help the LLM predictor achieve state-of-the-art performance on unseen datasets and tasks compared to other methods using LLMs as predictors.