Integrating Multi-Modal Input Token Mixer Into Mamba-Based Decision Models: Decision MetaMamba

作者: Wall Kim

分类: cs.LG, cs.AI

发布日期: 2024-08-20 (更新: 2025-01-09)

备注: We have decided to withdraw this manuscript as we believe that the work requires significant improvements and further research to ensure its quality and impact. We are currently pursuing a more comprehensive approach to address the limitations of the current submission and plan to resubmit an improved version in the future

💡 一句话要点

提出Decision MetaMamba,通过多模态输入Token Mixer提升Mamba在离线强化学习中的决策能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 离线强化学习 Mamba 状态空间模型 决策模型 多模态输入 Token Mixer 序列建模

📋 核心要点

- 基于Mamba的决策模型在离线强化学习中表现不佳,可能源于选择性扫描阶段的信息损失。

- Decision MetaMamba (DMM)通过在Mamba的输入层引入token mixer,显式处理状态、动作和回报的多模态输入。

- 实验表明,DMM在减少参数量的同时提升了性能,线性token mixer也取得了类似效果,突显了信息保留的重要性。

📝 摘要(中文)

本文提出Decision MetaMamba (DMM),旨在提升基于Mamba的决策模型在离线强化学习中的性能。尽管Mamba在序列建模任务中表现出色,但直接应用于离线强化学习时,其性能并未超越增强的Decision Transformer变体。作者假设这是由于选择性扫描阶段的信息损失所致。DMM通过在Mamba的输入层增加一个token mixer来解决这个问题,该mixer显式地考虑了离线强化学习输入的多模态特性,包括状态、动作和回报。实验结果表明,DMM在显著减少参数数量的同时,性能得到了提升。值得注意的是,简单的线性token mixer也取得了类似的性能提升,这表明保留来自邻近时间步的信息比token mixer的具体设计更为重要。这种对Mamba输入层的新颖修改,有别于Transformer中常用的基于时间戳的编码方法,通过提高Mamba在离线强化学习中的性能,为Mamba在未来强化学习研究中的更广泛应用开辟了新的途径,尤其是在内存效率和快速推理方面。

🔬 方法详解

问题定义:现有基于Mamba的决策模型在离线强化学习任务中,性能未能超越增强的Decision Transformer变体。主要痛点在于Mamba的选择性扫描机制可能导致关键信息丢失,尤其是在处理包含状态、动作和回报的多模态输入时。

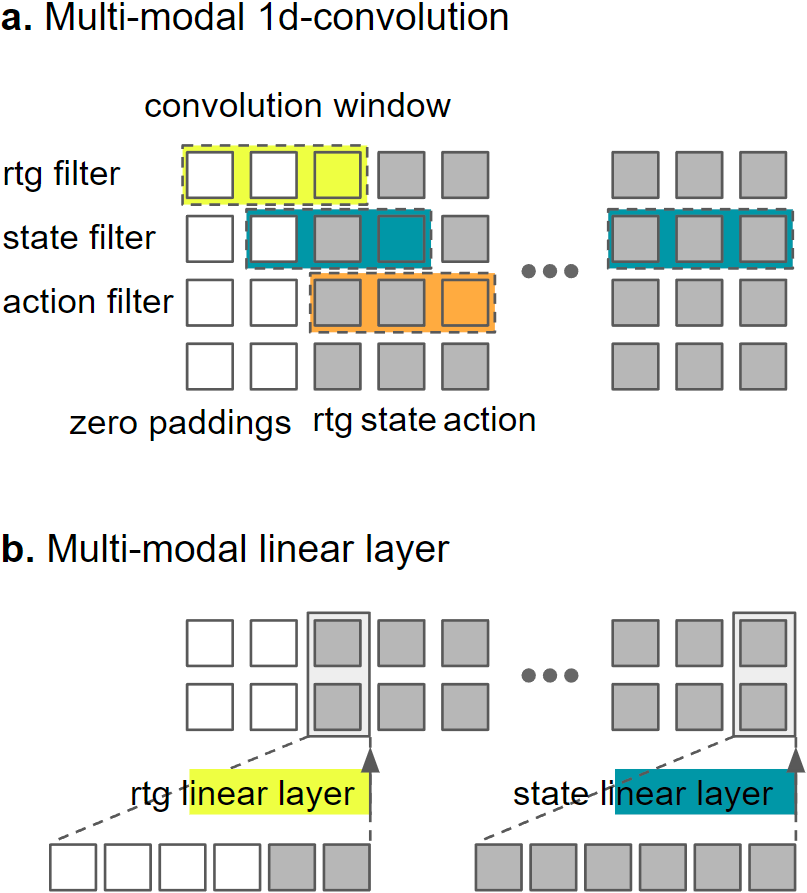

核心思路:论文的核心思路是在Mamba模型的输入层引入一个token mixer,用于显式地融合来自不同模态(状态、动作、回报)的信息。这样做的目的是为了在信息进入Mamba的核心状态空间模型之前,尽可能地保留和整合这些信息,从而避免在选择性扫描过程中丢失关键信息。

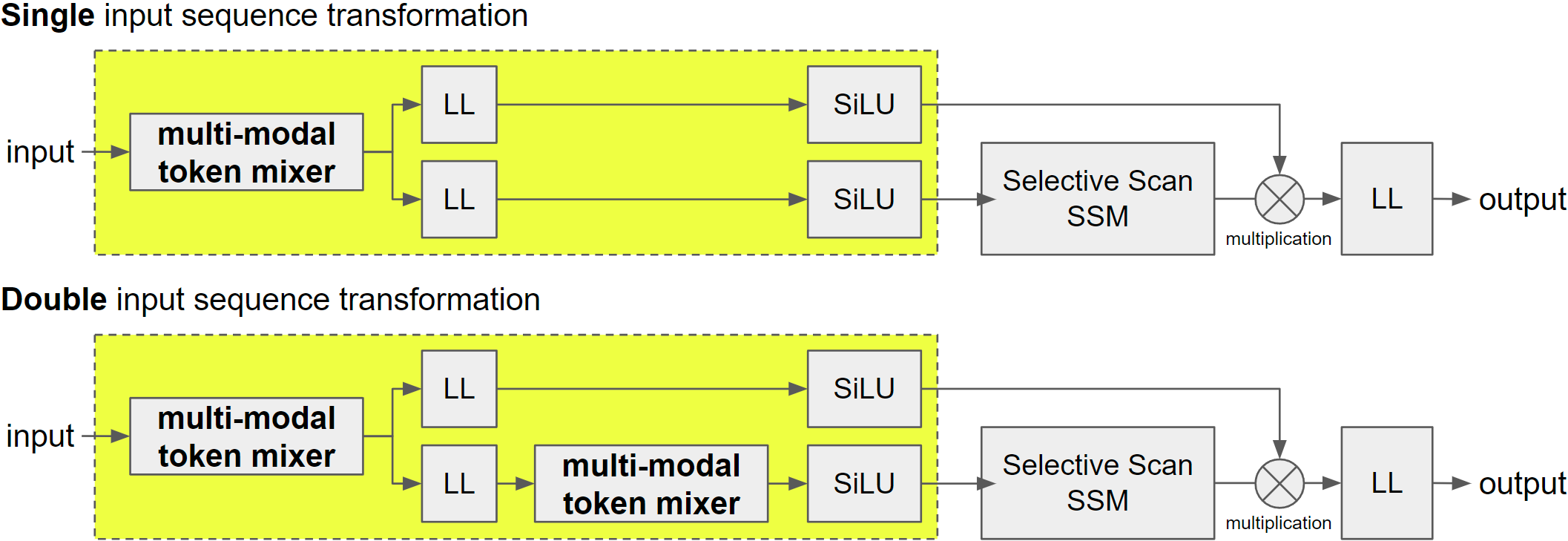

技术框架:Decision MetaMamba (DMM) 的整体架构是在标准的Mamba模型基础上,修改了其输入层。具体来说,原始的Mamba模型直接接收经过线性嵌入的输入序列。DMM则在输入层增加了一个token mixer模块,该模块接收线性嵌入后的状态、动作和回报序列,并对其进行混合和处理,然后再将处理后的序列输入到Mamba的核心模块中。

关键创新:最重要的技术创新点在于将token mixer引入到Mamba模型的输入层,以显式地处理多模态输入。这与传统的Transformer模型中基于时间戳的编码方式不同,也与直接将Mamba应用于决策任务的方法不同。DMM通过token mixer来保留和整合来自不同模态的信息,从而提升了模型的性能。

关键设计:论文中一个关键的设计是token mixer的选择。实验表明,即使使用简单的线性token mixer也能取得显著的性能提升,这表明保留来自邻近时间步的信息比token mixer的具体设计更为重要。这意味着DMM的关键在于对多模态输入的显式处理,而不是复杂的token mixing机制。

🖼️ 关键图片

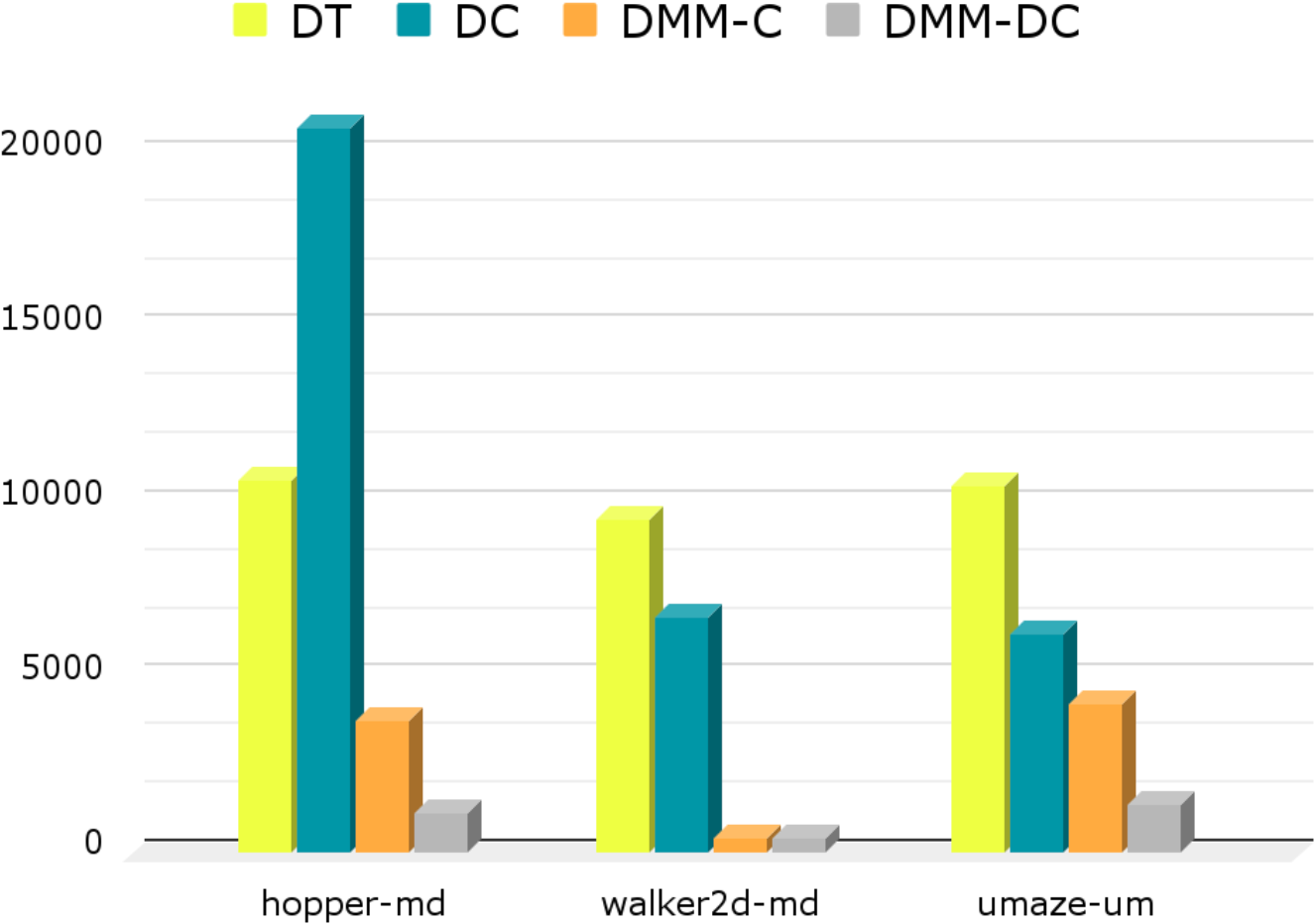

📊 实验亮点

Decision MetaMamba在离线强化学习任务中取得了显著的性能提升,同时显著减少了参数数量。实验结果表明,DMM能够超越现有的基于Transformer的决策模型,并且简单的线性token mixer也能取得类似的性能提升,这突显了多模态输入处理的重要性。具体的性能数据和对比基线在论文中进行了详细的展示。

🎯 应用场景

Decision MetaMamba在离线强化学习领域具有广泛的应用前景,例如机器人控制、自动驾驶、推荐系统和金融交易等。通过提高Mamba在这些任务中的性能,可以实现更高效、更安全的决策制定。此外,DMM的内存效率和快速推理能力使其非常适合部署在资源受限的设备上,例如移动机器人和嵌入式系统。

📄 摘要(原文)

Sequence modeling with State Space models (SSMs) has demonstrated performance surpassing that of Transformers in various tasks, raising expectations for their potential to outperform the Decision Transformer and its enhanced variants in offline reinforcement learning (RL). However, decision models based on Mamba, a state-of-the-art SSM, failed to achieve superior performance compared to these enhanced Decision Transformers. We hypothesize that this limitation arises from information loss during the selective scanning phase. To address this, we propose the Decision MetaMamba (DMM), which augments Mamba with a token mixer in its input layer. This mixer explicitly accounts for the multimodal nature of offline RL inputs, comprising state, action, and return-to-go. The DMM demonstrates improved performance while significantly reducing parameter count compared to prior models. Notably, similar performance gains were achieved using a simple linear token mixer, emphasizing the importance of preserving information from proximate time steps rather than the specific design of the token mixer itself. This novel modification to Mamba's input layer represents a departure from conventional timestamp-based encoding approaches used in Transformers. By enhancing performance of Mamba in offline RL, characterized by memory efficiency and fast inference, this work opens new avenues for its broader application in future RL research.