Model Merging in LLMs, MLLMs, and Beyond: Methods, Theories, Applications and Opportunities

作者: Enneng Yang, Li Shen, Guibing Guo, Xingwei Wang, Xiaochun Cao, Jie Zhang, Dacheng Tao

分类: cs.LG, cs.AI, cs.CL, cs.CV

发布日期: 2024-08-14 (更新: 2025-12-31)

🔗 代码/项目: GITHUB

💡 一句话要点

综述模型合并技术:系统性回顾方法、理论、应用及未来方向

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 模型合并 大型语言模型 多模态学习 持续学习 多任务学习 少样本学习 知识整合 模型优化

📋 核心要点

- 现有模型合并技术缺乏系统性的综述,难以帮助研究者快速了解和应用。

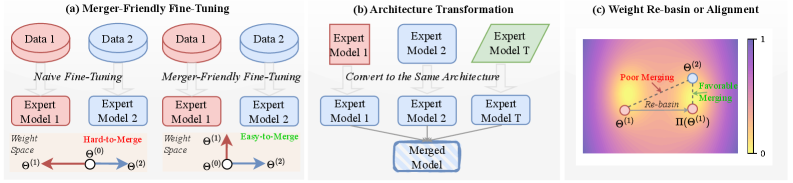

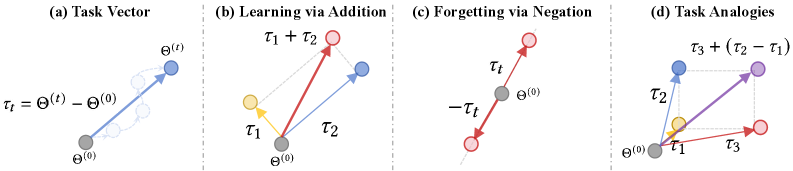

- 论文提出一种新的模型合并方法分类体系,并深入探讨了各种模型合并技术。

- 论文分析了模型合并在多个领域的应用,并指出了该领域未来研究方向和挑战。

📝 摘要(中文)

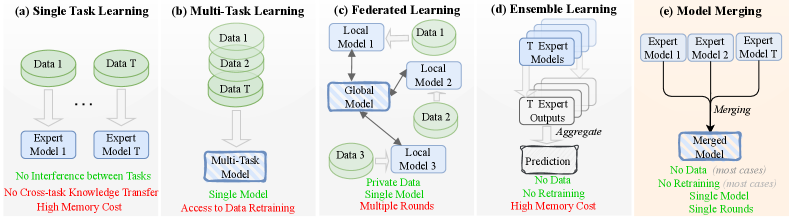

模型合并是机器学习领域一种高效的赋能技术,它不需要收集原始训练数据,也不需要昂贵的计算资源。随着模型合并在各个领域变得越来越普遍,全面理解现有的模型合并技术至关重要。然而,在文献中,对于这些技术的系统和彻底的回顾存在显著的空白。本综述全面概述了模型合并的方法和理论,它们在各种领域和环境中的应用,以及未来的研究方向。具体来说,我们首先提出了一种新的分类方法,详尽地讨论了现有的模型合并方法。其次,我们讨论了模型合并技术在大型语言模型、多模态大型语言模型以及十多个机器学习子领域(包括持续学习、多任务学习、少样本学习等)中的应用。最后,我们强调了模型合并仍然存在的挑战,并讨论了未来的研究方向。关于模型合并的论文的综合列表可在https://github.com/EnnengYang/Awesome-Model-Merging-Methods-Theories-Applications上找到。

🔬 方法详解

问题定义:模型合并旨在将多个预训练模型的能力整合到一个单一模型中,而无需重新训练或访问原始训练数据。现有方法在效率、效果和适用性方面存在局限性,例如,某些方法可能需要大量的计算资源,或者只能应用于特定类型的模型或任务。此外,缺乏对模型合并技术的系统性理解和分类,使得研究人员难以选择合适的方法并进行改进。

核心思路:本综述的核心思路是对现有的模型合并方法进行全面的梳理和分类,并分析其在不同领域的应用。通过建立一个清晰的分类体系,研究人员可以更容易地理解各种方法的优缺点,并根据具体任务选择最合适的方法。此外,该综述还探讨了模型合并的理论基础,并指出了未来研究方向。

技术框架:该综述首先提出了一个新的模型合并方法分类体系,该体系涵盖了现有的各种方法。然后,该综述讨论了模型合并技术在大型语言模型、多模态大型语言模型以及十多个机器学习子领域中的应用。最后,该综述总结了模型合并仍然存在的挑战,并提出了未来的研究方向。

关键创新:该综述的关键创新在于提出了一个新的模型合并方法分类体系,该体系能够全面地涵盖现有的各种方法,并帮助研究人员更好地理解和应用这些方法。此外,该综述还对模型合并的理论基础进行了深入的探讨,并指出了未来研究方向。

关键设计:该综述的关键设计在于其分类体系的构建,该体系基于模型合并方法的原理和特点,将其分为不同的类别,并对每个类别的方法进行了详细的描述和分析。此外,该综述还对每个应用领域进行了深入的分析,并总结了模型合并在该领域的应用情况和挑战。

🖼️ 关键图片

📊 实验亮点

该综述整理了大量关于模型合并的论文,并对其进行了分类和分析。通过对这些论文的总结,该综述为研究人员提供了一个全面的模型合并技术概览,并指出了该领域未来的研究方向。该综述还提供了一个GitHub仓库,其中包含了关于模型合并的论文列表。

🎯 应用场景

模型合并技术可广泛应用于各种机器学习任务,例如持续学习、多任务学习、少样本学习等。通过将多个模型的知识整合到一个单一模型中,可以提高模型的性能和泛化能力,并降低计算成本。该技术在资源受限的场景下尤其有价值,例如边缘计算和移动设备。

📄 摘要(原文)

Model merging is an efficient empowerment technique in the machine learning community that does not require the collection of raw training data and does not require expensive computation. As model merging becomes increasingly prevalent across various fields, it is crucial to understand the available model merging techniques comprehensively. However, there is a significant gap in the literature regarding a systematic and thorough review of these techniques. This survey provides a comprehensive overview of model merging methods and theories, their applications in various domains and settings, and future research directions. Specifically, we first propose a new taxonomic approach that exhaustively discusses existing model merging methods. Secondly, we discuss the application of model merging techniques in large language models, multimodal large language models, and more than ten machine learning subfields, including continual learning, multi-task learning, few-shot learning, etc. Finally, we highlight the remaining challenges of model merging and discuss future research directions. A comprehensive list of papers about model merging is available at https://github.com/EnnengYang/Awesome-Model-Merging-Methods-Theories-Applications.