ChemVLM: Exploring the Power of Multimodal Large Language Models in Chemistry Area

作者: Junxian Li, Di Zhang, Xunzhi Wang, Zeying Hao, Jingdi Lei, Qian Tan, Cai Zhou, Wei Liu, Yaotian Yang, Xinrui Xiong, Weiyun Wang, Zhe Chen, Wenhai Wang, Wei Li, Shufei Zhang, Mao Su, Wanli Ouyang, Yuqiang Li, Dongzhan Zhou

分类: cs.LG, cs.CV

发布日期: 2024-08-14 (更新: 2025-10-26)

备注: 11 pages, updated version

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

提出ChemVLM:化学领域的多模态大型语言模型,提升化学信息理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 化学信息学 多模态学习 大型语言模型 化学OCR 化学推理 分子理解 视觉信息处理

📋 核心要点

- 现有化学大型语言模型无法有效处理视觉化学信息,限制了其在许多化学任务中的应用。

- ChemVLM通过在双语多模态数据集上训练,提升了模型对文本和视觉化学信息的理解能力。

- ChemVLM在化学OCR、多模态化学推理和分子理解任务上表现出与现有模型相比具有竞争力的性能。

📝 摘要(中文)

大型语言模型(LLMs)已经取得了显著的成功,并被应用于包括化学在内的各个科学领域。然而,许多化学任务需要处理视觉信息,而现有的化学LLMs无法成功处理这些信息。这使得对能够整合化学领域多模态信息的模型的需求日益增长。在本文中,我们介绍了ChemVLM,一个专门为化学应用设计的开源化学多模态大型语言模型。ChemVLM在一个精心策划的双语多模态数据集上进行训练,该数据集增强了其理解文本和视觉化学信息的能力,包括分子结构、反应和化学考试问题。我们开发了三个数据集用于全面评估,分别针对化学光学字符识别(OCR)、多模态化学推理(MMCR)和多模态分子理解任务。我们在各种任务上将ChemVLM与一系列开源和专有的多模态大型语言模型进行了基准测试。实验结果表明,ChemVLM在所有评估任务中都取得了具有竞争力的性能。

🔬 方法详解

问题定义:论文旨在解决现有化学领域大型语言模型无法有效处理视觉信息的问题。现有的化学LLM主要关注文本信息的处理,对于包含分子结构、反应图等视觉信息的化学任务表现不佳,这限制了它们在实际化学研究和应用中的潜力。

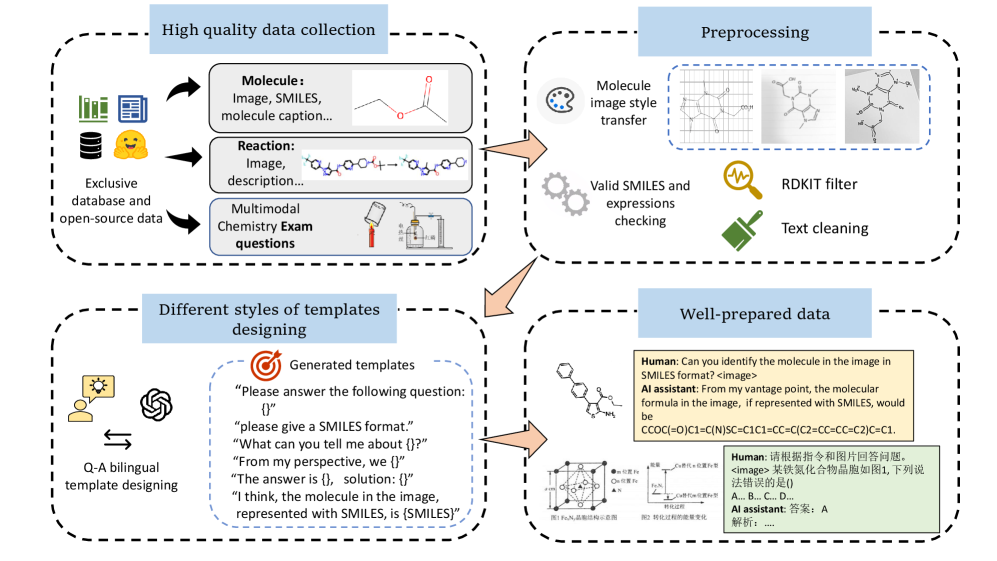

核心思路:论文的核心思路是构建一个能够同时理解和处理文本和视觉信息的化学多模态大型语言模型。通过在包含文本和图像信息的化学数据集上进行训练,使模型能够学习到文本和视觉信息之间的关联,从而提升其在化学任务中的表现。

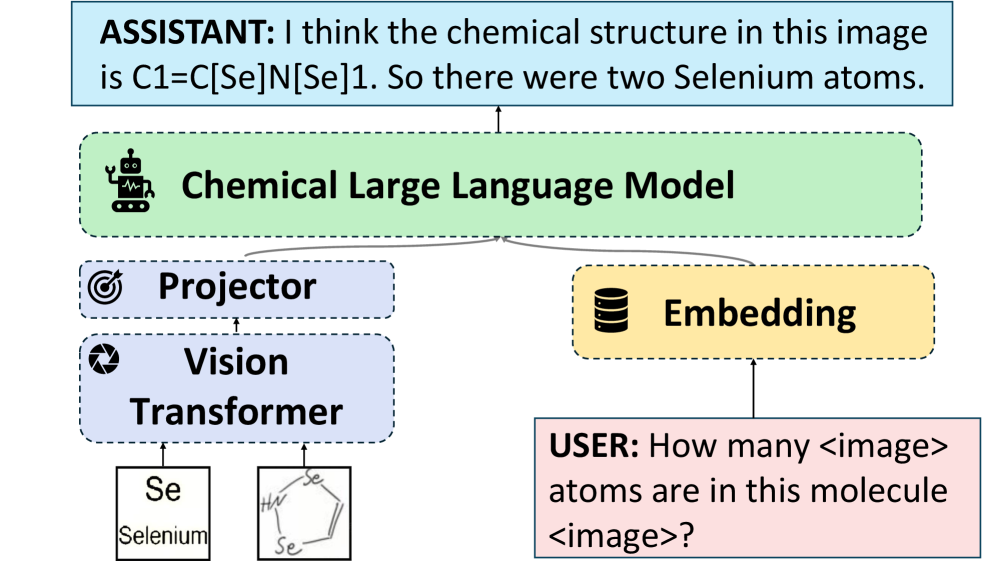

技术框架:ChemVLM的整体框架基于大型语言模型,并加入了视觉信息处理模块。具体流程包括:首先,使用视觉编码器提取图像特征;然后,将提取的图像特征与文本信息进行融合;最后,将融合后的信息输入到大型语言模型中进行处理,完成相应的化学任务。

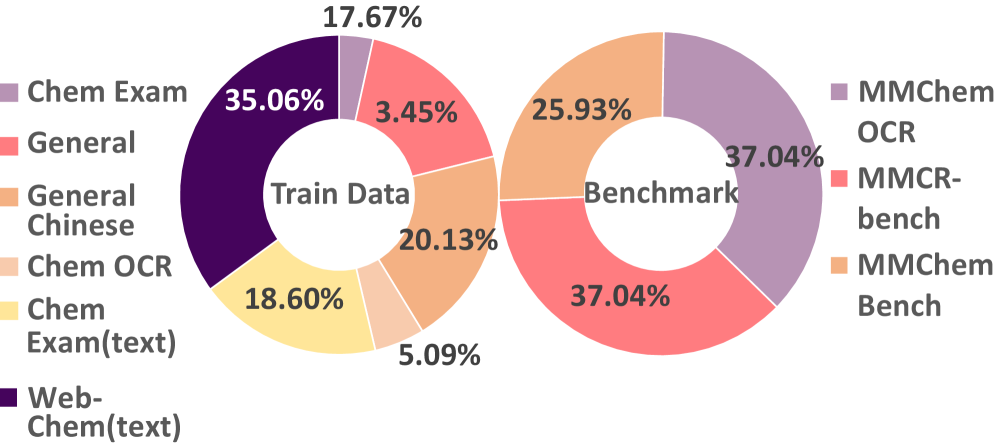

关键创新:ChemVLM的关键创新在于其针对化学领域的多模态数据训练和评估。论文构建了专门用于训练和评估化学多模态模型的双语数据集,并设计了化学OCR、多模态化学推理和分子理解等任务,从而能够更全面地评估模型在化学领域的表现。

关键设计:ChemVLM使用了26B参数的大型语言模型作为基础模型。在训练过程中,采用了多种策略来提升模型的性能,例如数据增强、知识蒸馏等。此外,论文还针对不同的化学任务设计了特定的损失函数,以优化模型的训练效果。

🖼️ 关键图片

📊 实验亮点

ChemVLM在化学OCR、多模态化学推理和分子理解三个任务上进行了评估,并与一系列开源和专有的多模态大型语言模型进行了比较。实验结果表明,ChemVLM在所有评估任务中都取得了具有竞争力的性能,证明了其在化学领域多模态信息处理方面的有效性。具体性能数据和对比基线信息可在论文原文中找到。

🎯 应用场景

ChemVLM在化学研究、教育和工业领域具有广泛的应用前景。它可以用于自动识别化学文献中的分子结构和反应,辅助化学家进行研究;可以用于创建更智能的化学教育工具,帮助学生更好地理解化学概念;还可以用于优化化学工艺流程,提高生产效率。未来,ChemVLM有望成为化学领域的重要工具。

📄 摘要(原文)

Large Language Models (LLMs) have achieved remarkable success and have been applied across various scientific fields, including chemistry. However, many chemical tasks require the processing of visual information, which cannot be successfully handled by existing chemical LLMs. This brings a growing need for models capable of integrating multimodal information in the chemical domain. In this paper, we introduce \textbf{ChemVLM}, an open-source chemical multimodal large language model specifically designed for chemical applications. ChemVLM is trained on a carefully curated bilingual multimodal dataset that enhances its ability to understand both textual and visual chemical information, including molecular structures, reactions, and chemistry examination questions. We develop three datasets for comprehensive evaluation, tailored to Chemical Optical Character Recognition (OCR), Multimodal Chemical Reasoning (MMCR), and Multimodal Molecule Understanding tasks. We benchmark ChemVLM against a range of open-source and proprietary multimodal large language models on various tasks. Experimental results demonstrate that ChemVLM achieves competitive performance across all evaluated tasks. Our model can be found at https://huggingface.co/AI4Chem/ChemVLM-26B.