Targeted Deep Learning System Boundary Testing

作者: Oliver Weißl, Amr Abdellatif, Xingcheng Chen, Giorgi Merabishvili, Vincenzo Riccio, Severin Kacianka, Andrea Stocco

分类: cs.SE, cs.LG

发布日期: 2024-08-12 (更新: 2025-11-27)

备注: Accepted for publication by ACM Transactions on Software Engineering and Methodology (TOSEM)

DOI: 10.1145/3771557

💡 一句话要点

Mimicry:针对深度学习系统的细粒度、目标明确的边界测试方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 深度学习 边界测试 黑盒测试 生成对抗网络 风格GAN

📋 核心要点

- 现有深度学习系统边界测试方法依赖随机扰动,难以生成受控输入变化,无法有效探索系统边界。

- Mimicry利用风格GAN解耦输入表示,通过控制内容和风格的混合,逼近深度学习系统的决策边界。

- 实验表明,Mimicry能生成更接近决策边界且语义有效的测试用例,揭示新的功能性错误,优于现有方法。

📝 摘要(中文)

评估深度学习(DL)系统的行为边界对于理解其在各种未见输入上的可靠性至关重要。由于难以生成受控的输入变化,现有的解决方案依赖于非目标随机扰动、基于模型或潜在空间的扰动,存在不足。本文介绍了一种新颖的黑盒测试生成器Mimicry,用于对深度学习系统边界进行细粒度的、目标明确的探索。Mimicry通过利用深度学习输出的概率性质来识别有希望的探索方向,从而执行边界测试。它使用基于风格的GAN将输入表示解耦为内容和风格组件,从而实现受控的特征混合以逼近决策边界。我们评估了Mimicry在为五个广泛使用的、复杂度递增的深度学习图像分类系统生成边界输入方面的有效性,并将其与两种基线方法进行了比较。结果表明,Mimicry始终如一地识别出更接近决策边界的输入。它生成语义上有意义的边界测试用例,揭示了新的功能性(错误)行为,而基线方法主要产生损坏或无效的输入。由于其增强的对潜在空间操作的控制,Mimicry随着数据集复杂性的增加仍然有效,保持了有竞争力的多样性和更高的有效率,这得到了人工评估者的证实。

🔬 方法详解

问题定义:论文旨在解决深度学习系统边界测试中,现有方法无法有效生成目标明确、语义有效的边界测试用例的问题。现有方法主要依赖于随机扰动或基于模型/潜在空间的扰动,难以控制输入的变化,导致生成的测试用例要么是无效的噪声,要么无法有效逼近决策边界,从而难以发现系统潜在的错误行为。

核心思路:论文的核心思路是利用生成对抗网络(GAN),特别是风格GAN,将输入图像的表示解耦为内容和风格两个部分。通过控制风格向量的变化,可以生成在语义上保持一致,但在风格上发生细微变化的图像,从而逼近深度学习系统的决策边界。利用深度学习输出的概率信息,可以指导风格向量的搜索方向,提高边界测试的效率。

技术框架:Mimicry的整体框架包含以下几个主要模块:1) 风格GAN模块:用于学习输入图像的潜在空间表示,并将图像解耦为内容和风格向量。2) 边界搜索模块:利用深度学习模型的输出概率,确定有希望的风格向量搜索方向。3) 输入生成模块:根据搜索到的风格向量,生成新的输入图像,用于测试深度学习系统。4) 有效性评估模块:通过人工评估或自动指标,评估生成的测试用例的有效性和多样性。

关键创新:Mimicry的关键创新在于:1) 目标明确的边界测试:通过利用深度学习模型的输出概率,可以针对性地生成接近决策边界的测试用例。2) 基于风格GAN的输入控制:通过解耦内容和风格,可以生成语义上有效且风格上细微变化的测试用例。3) 黑盒测试方法:Mimicry不需要访问深度学习模型的内部结构,可以应用于各种深度学习系统。

关键设计:Mimicry的关键设计包括:1) 风格GAN的选择:选择能够有效解耦内容和风格的风格GAN架构,例如StyleGAN或StyleGAN2。2) 边界搜索策略:设计有效的边界搜索策略,例如基于梯度下降或进化算法,以找到能够最大程度改变模型输出概率的风格向量。3) 有效性评估指标:设计能够有效评估生成测试用例有效性和多样性的指标,例如基于人工评估或基于模型预测一致性的指标。

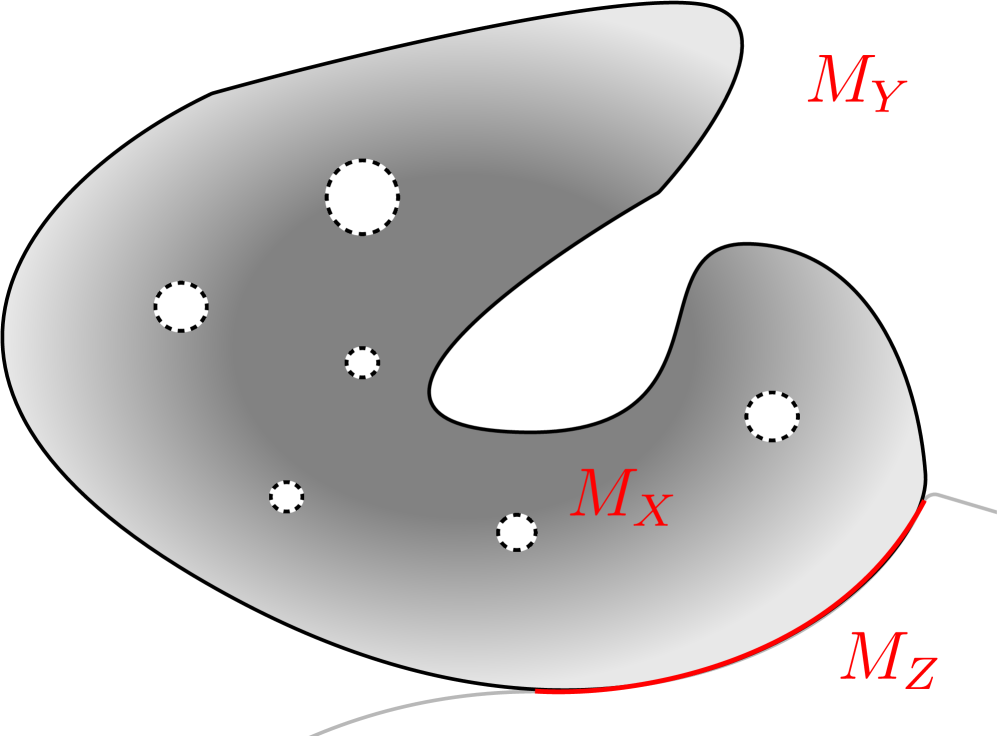

🖼️ 关键图片

📊 实验亮点

实验结果表明,Mimicry在五个图像分类系统上均优于基线方法,能够生成更接近决策边界的输入。与基线方法相比,Mimicry生成的测试用例具有更高的有效性和多样性,能够揭示新的功能性错误。人工评估结果显示,Mimicry生成的测试用例的有效率显著高于基线方法。

🎯 应用场景

Mimicry可应用于各种深度学习系统的可靠性评估和安全性测试,例如自动驾驶、医疗诊断、人脸识别等。通过发现深度学习系统在边界情况下的错误行为,可以提高系统的鲁棒性和安全性,减少潜在的风险。该方法还有助于理解深度学习模型的决策过程,为模型改进提供依据。

📄 摘要(原文)

Evaluating the behavioral boundaries of deep learning (DL) systems is crucial for understanding their reliability across diverse, unseen inputs. Existing solutions fall short as they rely on untargeted random, model- or latent-based perturbations, due to difficulties in generating controlled input variations. In this work, we introduce Mimicry, a novel black-box test generator for fine-grained, targeted exploration of DL system boundaries. Mimicry performs boundary testing by leveraging the probabilistic nature of DL outputs to identify promising directions for exploration. It uses style-based GANs to disentangle input representations into content and style components, enabling controlled feature mixing to approximate the decision boundary. We evaluated Mimicry's effectiveness in generating boundary inputs for five widely used DL image classification systems of increasing complexity, comparing it to two baseline approaches. Our results show that Mimicry consistently identifies inputs closer to the decision boundary. It generates semantically meaningful boundary test cases that reveal new functional (mis)behaviors, while the baselines produce mainly corrupted or invalid inputs. Thanks to its enhanced control over latent space manipulations, Mimicry remains effective as dataset complexity increases, maintaining competitive diversity and higher validity rates, confirmed by human assessors.