PowerPM: Foundation Model for Power Systems

作者: Shihao Tu, Yupeng Zhang, Jing Zhang, Zhendong Fu, Yin Zhang, Yang Yang

分类: cs.LG, cs.AI

发布日期: 2024-08-07 (更新: 2024-10-03)

备注: 23 pages, 5 figures, 8 tables

💡 一句话要点

提出PowerPM电力系统基础模型,解决电力时间序列数据通用表示学习难题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 电力系统 时间序列 基础模型 自监督学习 对比学习 Transformer 图神经网络

📋 核心要点

- 现有方法难以学习电力时间序列数据的通用表示,因为数据具有复杂的分层结构和时序依赖性,且易受外生变量影响。

- PowerPM模型通过时间编码器和分层编码器,分别捕获时间依赖性和层次结构相关性,从而学习ETS数据的通用表示。

- 实验表明,PowerPM在私有数据集上实现了SOTA性能,并在迁移到公共数据集时保持优越性,展示了其泛化能力。

📝 摘要(中文)

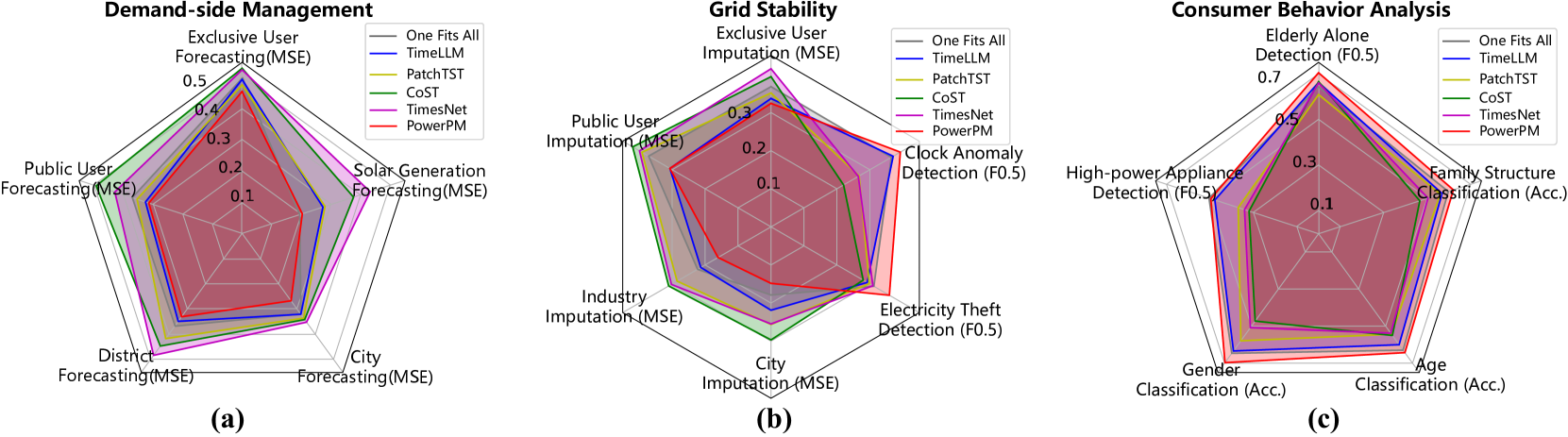

电力时间序列(ETS)数据的大量涌现为电力系统中的各种应用提供了充足的机会,包括需求侧管理、电网稳定性和消费者行为分析。深度学习模型通过有效地捕捉序列依赖性,推动了ETS建模的发展。然而,由于ETS数据固有的复杂分层结构,为各种应用学习ETS数据的通用表示仍然具有挑战性。此外,ETS数据表现出复杂的时序依赖性,并且容易受到外生变量的影响。而且,不同的实例表现出不同的用电行为。在本文中,我们提出了一个基础模型PowerPM来建模ETS数据,为电力系统提供一个大规模的、现成的模型。PowerPM由一个时间编码器和一个分层编码器组成。时间编码器捕获ETS数据中的时间依赖性,同时考虑外生变量。分层编码器对层次结构之间的相关性进行建模。此外,PowerPM利用了一种新颖的自监督预训练框架,该框架由掩码ETS建模和双视图对比学习组成,这使得PowerPM能够捕获ETS窗口内的时间依赖性,并感知ETS窗口之间的差异,从而提供两种不同的视角来学习通用表示。我们的实验涉及五个真实世界的场景数据集,包括私有和公共数据。通过在海量ETS数据上进行预训练,PowerPM在私有数据集中的各种下游任务上实现了SOTA性能。令人印象深刻的是,当转移到公共数据集时,PowerPM保持了其优越性,展示了其在各种任务和领域中的卓越泛化能力。此外,消融研究和少样本实验为我们模型的有效性提供了额外的证据。

🔬 方法详解

问题定义:电力时间序列数据建模面临挑战,现有方法难以捕捉数据复杂的时序依赖性、分层结构以及外生变量的影响,导致模型泛化能力不足,无法有效应用于各种下游任务。因此,需要一种能够学习ETS数据通用表示的模型,以适应不同的应用场景。

核心思路:PowerPM的核心思路是利用自监督学习,通过掩码ETS建模和双视图对比学习,学习ETS数据的通用表示。时间编码器捕捉时间依赖性,分层编码器建模层次结构相关性,从而全面理解ETS数据。

技术框架:PowerPM包含两个主要模块:时间编码器和分层编码器。时间编码器负责捕捉ETS数据中的时间依赖性,并考虑外生变量的影响。分层编码器则用于建模ETS数据中不同层次结构之间的相关性。整个框架通过自监督预训练的方式进行训练,包括掩码ETS建模和双视图对比学习。

关键创新:PowerPM的关键创新在于其自监督预训练框架,该框架结合了掩码ETS建模和双视图对比学习。掩码ETS建模通过重建被掩盖的时间序列数据,学习时间依赖性。双视图对比学习则通过对比不同ETS窗口的表示,学习数据之间的差异性,从而提高模型的泛化能力。

关键设计:PowerPM采用了Transformer作为时间编码器的基础架构,以有效捕捉长程时间依赖性。分层编码器则采用了图神经网络,以建模不同层次结构之间的关系。损失函数包括掩码重建损失和对比学习损失,用于指导模型的训练。具体参数设置和网络结构的选择,需要根据具体数据集和任务进行调整。

🖼️ 关键图片

📊 实验亮点

PowerPM在五个真实世界数据集上进行了评估,包括私有和公共数据。在私有数据集上,PowerPM在各种下游任务上实现了SOTA性能。更重要的是,当迁移到公共数据集时,PowerPM仍然保持了其优越性,证明了其卓越的泛化能力。消融实验和少样本实验进一步验证了模型的有效性。

🎯 应用场景

PowerPM作为电力系统基础模型,可广泛应用于需求侧管理、电网稳定性分析、消费者行为分析等领域。通过预训练的通用表示,可以快速适应新的下游任务,降低模型开发成本,加速电力系统智能化进程。未来,PowerPM有望成为电力行业AI应用的重要基础设施。

📄 摘要(原文)

The emergence of abundant electricity time series (ETS) data provides ample opportunities for various applications in the power systems, including demand-side management, grid stability, and consumer behavior analysis. Deep learning models have advanced ETS modeling by effectively capturing sequence dependence. Nevertheless, learning a generic representation of ETS data for various applications remains challenging due to the inherently complex hierarchical structure of ETS data. Moreover, ETS data exhibits intricate temporal dependencies and is suscepti ble to the influence of exogenous variables. Furthermore, different instances exhibit diverse electricity consumption behavior. In this paper, we propose a foundation model PowerPM to model ETS data, providing a large-scale, off-the-shelf model for power systems. PowerPM consists of a temporal encoder and a hierarchical encoder. The temporal encoder captures both temporal dependencies in ETS data, considering exogenous variables. The hierarchical encoder models the correlation between hierarchy. Furthermore, PowerPM leverages a novel self-supervised pretraining framework consisting of masked ETS modeling and dual-view contrastive learning, which enable PowerPM to capture temporal dependency within ETS windows and aware the discrepancy across ETS windows, providing two different perspectives to learn generic representation. Our experiments involve five real world scenario datasets, comprising private and public data. Through pre-training on massive ETS data, PowerPM achieves SOTA performance on diverse downstream tasks within the private dataset. Impressively, when transferred to the public datasets, PowerPM maintains its superiority, showcasing its remarkable generalization ability across various tasks and domains. Moreover, ablation studies, few-shot experiments provide additional evidence of the effectiveness of our model.