Knowledge Probing for Graph Representation Learning

作者: Mingyu Zhao, Xingyu Huang, Ziyu Lyu, Yanlin Wang, Lixin Cui, Lu Bai

分类: cs.LG, cs.AI

发布日期: 2024-08-07

💡 一句话要点

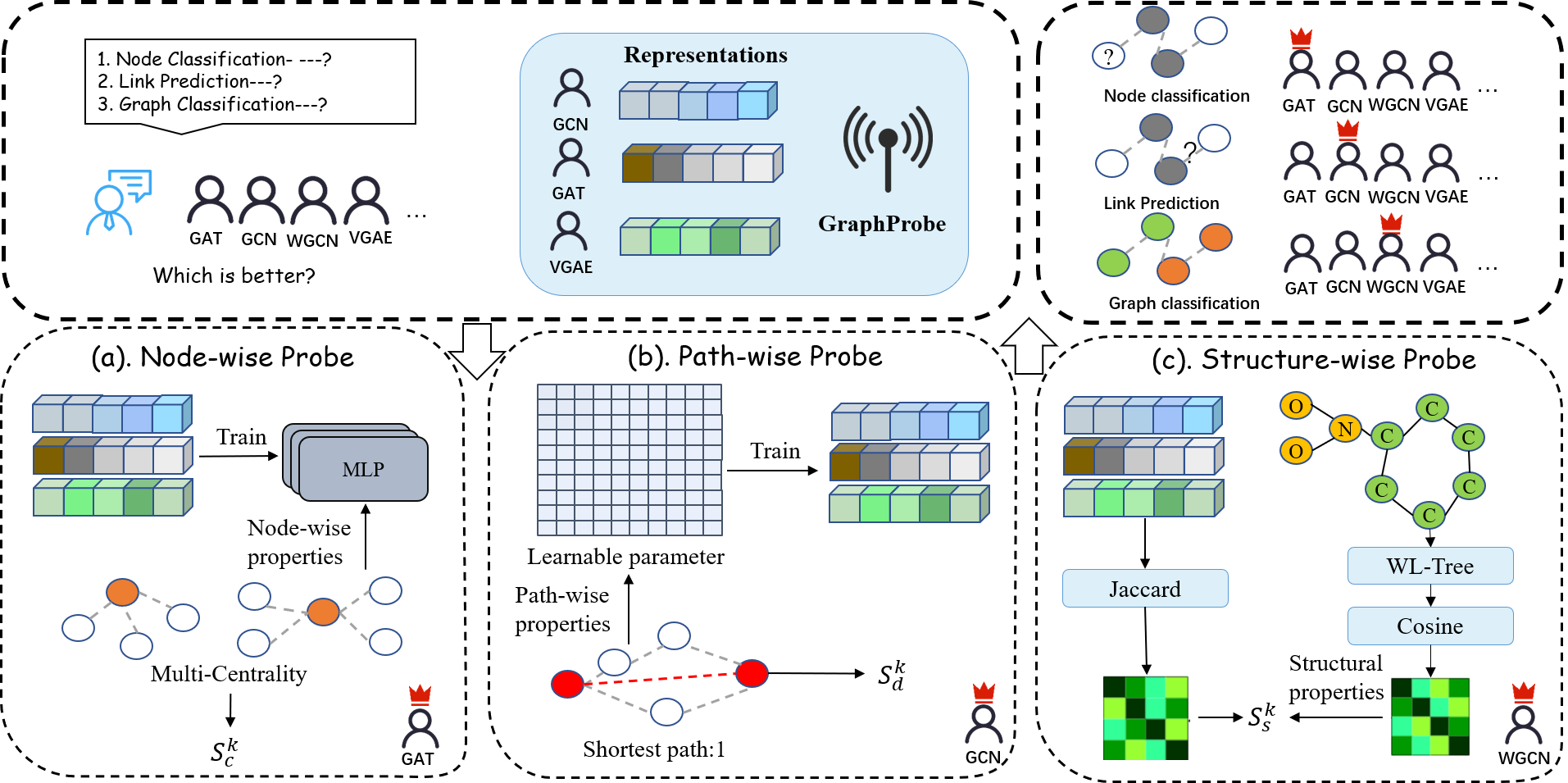

提出GraphProbe图探针框架,用于评估图表示学习方法对图知识的编码能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图表示学习 图神经网络 知识探针 模型评估 图属性 节点分类 链接预测

📋 核心要点

- 现有图表示学习方法缺乏对编码知识的系统性评估,难以了解模型真正学到了什么。

- GraphProbe通过设计节点、路径和结构三个层面的探针,系统性地评估图表示学习方法对不同图知识的编码能力。

- 实验表明,GraphProbe能够有效评估图表示学习的能力,并发现GCN和WeightedGCN在不同任务中表现相对较好。

📝 摘要(中文)

图学习方法已被广泛应用于各个领域。然而,图表示学习在多大程度上编码了固有的图属性,例如图邻近性、图结构信息等,以供下游任务使用,仍然缺乏深入研究。本文提出了一个新颖的图探针框架(GraphProbe),旨在研究和解释图学习方法是否在图表示学习中编码了不同层次的知识。基于图的内在属性,我们设计了三个探针,分别从节点层面、路径层面和结构层面系统地研究图表示学习过程。我们构建了一个全面的评估基准,包含九种具有代表性的图学习方法,涵盖基于随机游走的方法、基本图神经网络和自监督图方法,并在六个基准数据集上对它们进行探测,用于节点分类、链接预测和图分类。实验评估验证了GraphProbe可以评估图表示学习的能力。结果表明:GCN和WeightedGCN方法是相对通用的方法,在不同任务上取得了更好的结果。

🔬 方法详解

问题定义:现有图表示学习方法在下游任务中表现良好,但缺乏对其编码的图知识的深入理解。具体来说,我们不清楚这些方法是否以及如何在表示中捕捉到图的邻近性、结构信息等关键属性。这使得我们难以选择合适的模型,也限制了我们对模型行为的解释。

核心思路:本文的核心思路是设计一系列探针任务,这些任务能够检验图表示是否编码了特定的图属性。通过观察模型在这些探针任务上的表现,我们可以推断出模型学习到了哪些图知识。这种方法类似于自然语言处理中的 probing 任务,用于理解语言模型的内部表示。

技术框架:GraphProbe框架包含三个主要的探针模块: 1. 节点层面探针:评估节点表示是否能够反映节点之间的邻近性。 2. 路径层面探针:评估节点表示是否能够反映节点之间的路径信息。 3. 结构层面探针:评估节点表示是否能够反映图的结构信息,例如节点的重要性。

每个探针模块都包含一个或多个具体的探针任务,例如节点分类、链接预测等。通过在这些探针任务上训练和评估图表示,我们可以得到关于图表示编码能力的定量指标。

关键创新:GraphProbe的关键创新在于其系统性的探针设计,涵盖了图的多个重要属性。与以往的研究相比,GraphProbe提供了一个更全面、更深入的图表示学习评估框架。此外,GraphProbe的设计具有通用性,可以应用于各种图学习方法。

关键设计:GraphProbe的关键设计包括: 1. 探针任务的选择:选择能够反映特定图属性的探针任务,例如使用节点分类任务来评估节点表示是否编码了节点之间的邻近性。 2. 评估指标的选择:选择合适的评估指标来衡量模型在探针任务上的表现,例如使用准确率、F1 值等。 3. 基线方法的选择:选择具有代表性的图学习方法作为基线,以便进行比较和分析。 4. 数据集的选择:选择具有代表性的图数据集,以便评估模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,不同的图学习方法在不同的探针任务上表现出不同的性能。例如,GCN和WeightedGCN方法在多个任务上表现出较好的性能,表明它们能够较好地编码图的邻近性和结构信息。此外,实验还发现,一些自监督图学习方法在某些探针任务上表现不佳,表明它们可能存在一定的局限性。

🎯 应用场景

GraphProbe可用于指导图表示学习模型的选择和设计。通过了解不同模型对图知识的编码能力,研究人员可以选择更适合特定任务的模型,并设计出能够更好地捕捉图属性的新模型。此外,GraphProbe还可以用于分析图表示学习模型的局限性,并指导模型改进。

📄 摘要(原文)

Graph learning methods have been extensively applied in diverse application areas. However, what kind of inherent graph properties e.g. graph proximity, graph structural information has been encoded into graph representation learning for downstream tasks is still under-explored. In this paper, we propose a novel graph probing framework (GraphProbe) to investigate and interpret whether the family of graph learning methods has encoded different levels of knowledge in graph representation learning. Based on the intrinsic properties of graphs, we design three probes to systematically investigate the graph representation learning process from different perspectives, respectively the node-wise level, the path-wise level, and the structural level. We construct a thorough evaluation benchmark with nine representative graph learning methods from random walk based approaches, basic graph neural networks and self-supervised graph methods, and probe them on six benchmark datasets for node classification, link prediction and graph classification. The experimental evaluation verify that GraphProbe can estimate the capability of graph representation learning. Remaking results have been concluded: GCN and WeightedGCN methods are relatively versatile methods achieving better results with respect to different tasks.