RL-ADN: A High-Performance Deep Reinforcement Learning Environment for Optimal Energy Storage Systems Dispatch in Active Distribution Networks

作者: Shengren Hou, Shuyi Gao, Weijie Xia, Edgar Mauricio Salazar Duque, Peter Palensky, Pedro P. Vergara

分类: cs.LG, eess.SY

发布日期: 2024-08-07 (更新: 2024-08-08)

💡 一句话要点

RL-ADN:用于主动配电网中储能系统优化调度的强化学习环境

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 储能系统 主动配电网 优化调度 数据增强

📋 核心要点

- 现有配电网储能调度方法难以兼顾灵活性和计算效率,限制了其在大规模网络中的应用。

- RL-ADN通过灵活的建模、GMC数据增强和Laurent潮流求解器,提升DRL智能体的性能和训练效率。

- 实验表明,RL-ADN显著提高了DRL算法在ESS调度任务中的适应性,并实现了十倍的计算效率提升。

📝 摘要(中文)

本文介绍RL-ADN,一个创新的开源库,专为解决主动配电网中储能系统(ESS)的优化调度问题而设计。RL-ADN在建模配电网和ESS方面提供了无与伦比的灵活性,可满足广泛的研究目标。RL-ADN的一个突出特点是其基于高斯混合模型和Copula(GMC)函数的数据增强模块,提高了DRL智能体的性能上限。此外,RL-ADN还集成了Laurent潮流求解器,显著降低了训练期间潮流计算的计算负担,同时不牺牲精度。RL-ADN的有效性已在不同规模的配电网中得到证明,表明DRL算法在ESS调度任务中的适应性得到了显著提高。这种增强得益于训练场景多样性的增加。此外,RL-ADN在训练期间实现了十倍的计算效率提升,使其非常适合大规模网络应用。该库为基于DRL的配电网ESS调度设定了新的基准,并有望显著推进DRL在配电网运行中的应用。RL-ADN可在以下网址获取:https://github.com/ShengrenHou/RL-ADN 和 https://github.com/distributionnetworksTUDelft/RL-ADN。

🔬 方法详解

问题定义:论文旨在解决主动配电网中储能系统(ESS)的优化调度问题。现有方法通常面临建模复杂性、计算负担以及泛化能力不足等挑战,难以适应大规模和动态变化的配电网环境。传统的优化方法可能需要大量的计算资源,而简单的规则策略则难以达到最优性能。

核心思路:论文的核心思路是利用深度强化学习(DRL)的强大学习能力,通过与配电网环境的交互,学习到最优的ESS调度策略。为了提高DRL的性能和效率,论文提出了RL-ADN库,该库集成了灵活的建模能力、数据增强技术和高效的潮流计算方法。

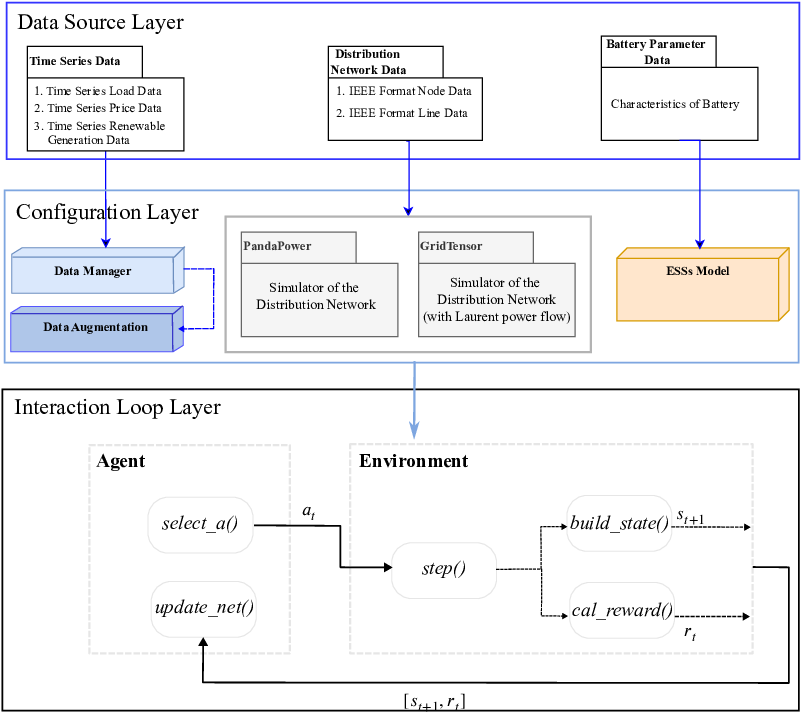

技术框架:RL-ADN库的整体框架包括以下几个主要模块:1) 配电网环境建模模块,提供灵活的配电网和ESS建模能力;2) DRL智能体训练模块,支持各种DRL算法的训练;3) 数据增强模块,基于高斯混合模型和Copula(GMC)函数生成多样化的训练数据;4) Laurent潮流求解器,用于高效准确地计算潮流。训练流程通常包括:环境初始化、智能体与环境交互、数据收集、智能体更新和策略评估。

关键创新:论文的关键创新在于以下几个方面:1) 提出了RL-ADN库,为配电网ESS调度提供了一个统一的DRL平台;2) 引入了基于GMC函数的数据增强模块,提高了DRL智能体的泛化能力;3) 集成了Laurent潮流求解器,显著降低了潮流计算的计算负担。

关键设计:GMC数据增强模块通过学习历史数据的分布,生成新的、具有代表性的训练样本,从而提高DRL智能体的鲁棒性。Laurent潮流求解器是一种高效的潮流计算方法,它通过将潮流方程线性化,大大降低了计算复杂度。在DRL智能体方面,可以选择各种常见的DRL算法,如DQN、DDPG、PPO等,并根据具体问题进行参数调整和网络结构设计。损失函数通常包括奖励函数和正则化项,用于指导智能体的学习。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RL-ADN能够显著提高DRL算法在ESS调度任务中的性能。具体而言,基于GMC的数据增强模块能够提高DRL智能体的适应性,使其在不同规模的配电网中都能取得良好的效果。此外,RL-ADN还实现了十倍的计算效率提升,使其非常适合大规模网络应用。这些结果表明,RL-ADN为基于DRL的配电网ESS调度设定了新的基准。

🎯 应用场景

该研究成果可应用于智能电网、微电网等领域,实现储能系统的优化调度,提高电网的稳定性和经济性。通过RL-ADN库,研究人员和工程师可以更方便地开发和测试基于DRL的ESS调度算法,加速智能电网技术的推广和应用。未来,该技术有望在更大规模、更复杂的配电网中发挥重要作用。

📄 摘要(原文)

Deep Reinforcement Learning (DRL) presents a promising avenue for optimizing Energy Storage Systems (ESSs) dispatch in distribution networks. This paper introduces RL-ADN, an innovative open-source library specifically designed for solving the optimal ESSs dispatch in active distribution networks. RL-ADN offers unparalleled flexibility in modeling distribution networks, and ESSs, accommodating a wide range of research goals. A standout feature of RL-ADN is its data augmentation module, based on Gaussian Mixture Model and Copula (GMC) functions, which elevates the performance ceiling of DRL agents. Additionally, RL-ADN incorporates the Laurent power flow solver, significantly reducing the computational burden of power flow calculations during training without sacrificing accuracy. The effectiveness of RL-ADN is demonstrated using in different sizes of distribution networks, showing marked performance improvements in the adaptability of DRL algorithms for ESS dispatch tasks. This enhancement is particularly beneficial from the increased diversity of training scenarios. Furthermore, RL-ADN achieves a tenfold increase in computational efficiency during training, making it highly suitable for large-scale network applications. The library sets a new benchmark in DRL-based ESSs dispatch in distribution networks and it is poised to advance DRL applications in distribution network operations significantly. RL-ADN is available at: https://github.com/ShengrenHou/RL-ADN and https://github.com/distributionnetworksTUDelft/RL-ADN.