Can LLMs Serve As Time Series Anomaly Detectors?

作者: Manqing Dong, Hao Huang, Longbing Cao

分类: cs.LG, cs.AI

发布日期: 2024-08-06

💡 一句话要点

探索LLM作为时间序列异常检测器的潜力,通过提示工程和微调提升性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列异常检测 大型语言模型 提示工程 指令微调 上下文学习

📋 核心要点

- 现有时间序列异常检测方法在解释性和泛化性方面存在不足,难以适应复杂多变的应用场景。

- 论文探索利用LLM的理解和推理能力,通过提示工程和指令微调,使其能够检测并解释时间序列异常。

- 实验表明,经过提示工程的GPT-4和指令微调的LLaMA3在时间序列异常检测任务上取得了有竞争力的结果。

📝 摘要(中文)

本文研究了大型语言模型(LLMs),特别是GPT-4和LLaMA3,在时间序列异常检测和解释方面的能力。研究表明,LLMs不能直接用于时间序列异常检测。然而,通过设计诸如上下文学习和思维链提示等提示策略,GPT-4能够检测时间序列异常,其结果与基线方法具有竞争力。此外,本文提出了一种合成数据集,用于自动生成带有相应解释的时间序列异常。通过在此数据集上进行指令微调,LLaMA3在时间序列异常检测任务中表现出改进的性能。总之,我们的探索表明LLMs作为时间序列异常检测器具有广阔的潜力。

🔬 方法详解

问题定义:论文旨在解决时间序列异常检测问题,现有方法通常缺乏对异常的解释能力,且难以适应不同类型的时间序列数据。传统方法依赖于统计模型或机器学习模型,需要人工特征工程,泛化能力有限。

核心思路:论文的核心思路是利用大型语言模型(LLMs)的强大语言理解和生成能力,将时间序列异常检测问题转化为一个文本理解和生成任务。通过合适的提示工程(Prompt Engineering)和指令微调(Instruction Fine-tuning),引导LLM识别并解释时间序列中的异常。

技术框架:整体框架包含三个主要阶段:1) 探索LLM直接应用于时间序列异常检测的能力;2) 设计提示策略,如上下文学习和思维链提示,以提高LLM的检测性能;3) 构建合成数据集,用于指令微调LLM,进一步提升其在时间序列异常检测任务中的表现。

关键创新:论文的关键创新在于探索了LLM在时间序列异常检测领域的应用潜力,并提出了相应的提示工程和指令微调方法。通过将时间序列数据转化为文本描述,利用LLM的语言理解能力进行异常检测和解释,避免了传统方法中复杂的人工特征工程。

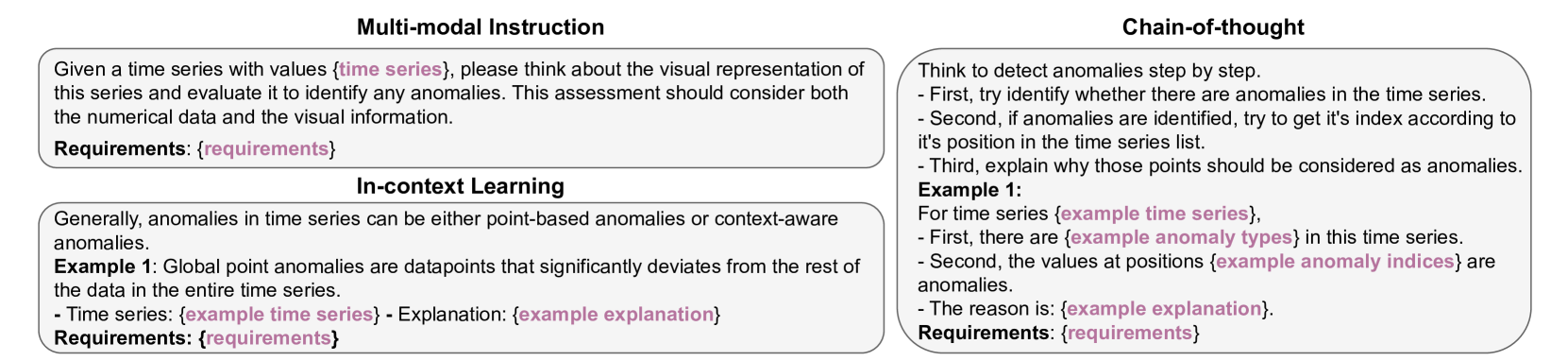

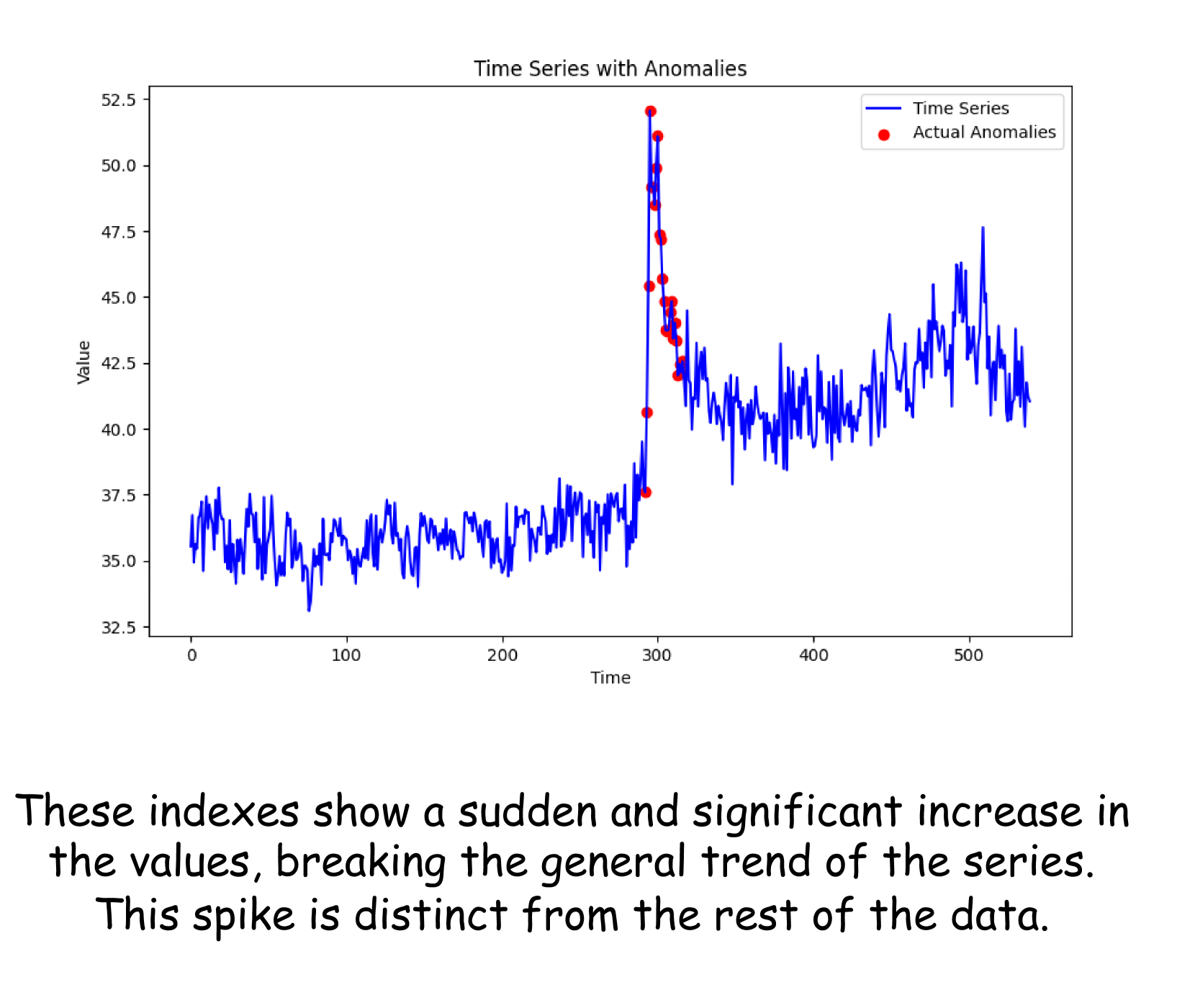

关键设计:论文设计了多种提示策略,包括上下文学习(In-Context Learning)和思维链提示(Chain-of-Thought Prompting),以引导LLM进行异常检测。此外,论文还构建了一个合成数据集,包含时间序列数据、异常标签和对应的解释文本,用于指令微调LLaMA3模型。具体参数设置和损失函数等细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过提示工程,GPT-4在时间序列异常检测任务中取得了与基线方法具有竞争力的结果。此外,通过在合成数据集上进行指令微调,LLaMA3的性能得到了显著提升,证明了LLM在时间序列异常检测领域的潜力。

🎯 应用场景

该研究成果可应用于金融风控、工业生产监控、网络安全检测等领域。通过利用LLM进行时间序列异常检测,可以更快速、准确地发现潜在风险,并提供可解释的异常分析报告,辅助决策者进行风险评估和应对。

📄 摘要(原文)

An emerging topic in large language models (LLMs) is their application to time series forecasting, characterizing mainstream and patternable characteristics of time series. A relevant but rarely explored and more challenging question is whether LLMs can detect and explain time series anomalies, a critical task across various real-world applications. In this paper, we investigate the capabilities of LLMs, specifically GPT-4 and LLaMA3, in detecting and explaining anomalies in time series. Our studies reveal that: 1) LLMs cannot be directly used for time series anomaly detection. 2) By designing prompt strategies such as in-context learning and chain-of-thought prompting, GPT-4 can detect time series anomalies with results competitive to baseline methods. 3) We propose a synthesized dataset to automatically generate time series anomalies with corresponding explanations. By applying instruction fine-tuning on this dataset, LLaMA3 demonstrates improved performance in time series anomaly detection tasks. In summary, our exploration shows the promising potential of LLMs as time series anomaly detectors.