A probabilistic framework for learning non-intrusive corrections to long-time climate simulations from short-time training data

作者: Benedikt Barthel Sorensen, Leonardo Zepeda-Núñez, Ignacio Lopez-Gomez, Zhong Yi Wan, Rob Carver, Fei Sha, Themistoklis Sapsis

分类: cs.LG, math.DS, physics.ao-ph, physics.flu-dyn

发布日期: 2024-08-02 (更新: 2024-11-22)

💡 一句话要点

提出一种概率框架,利用短时训练数据校正长时间气候模拟中的误差。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 气候模拟 混沌系统 神经网络校正 概率模型 长时间预测

📋 核心要点

- 混沌系统模拟面临计算量大的挑战,尤其是在长期风险评估中,例如气候变化引起的极端天气风险量化。

- 该论文提出了一种基于神经网络的非侵入式校正框架,利用少量高保真数据引导的欠分辨率模拟进行训练。

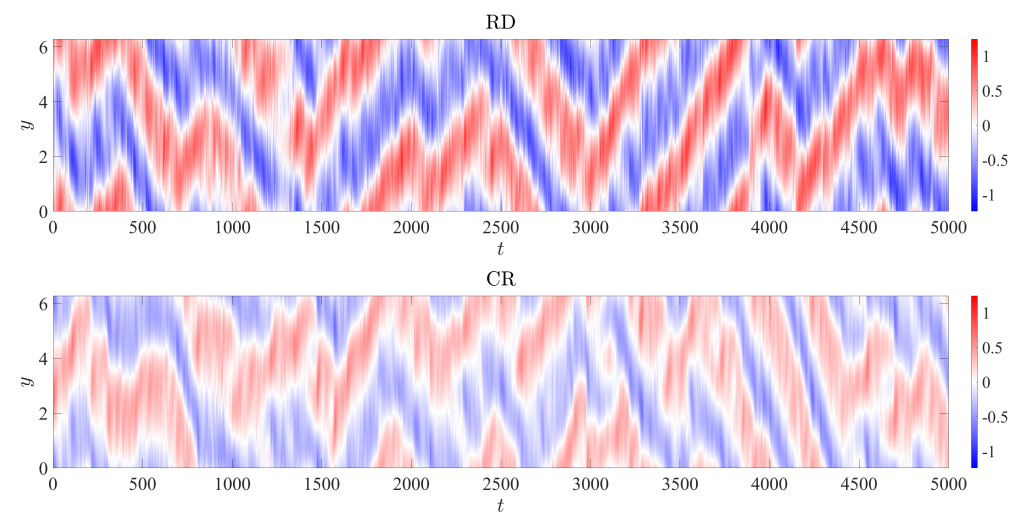

- 实验表明,该框架能够准确预测准地转流的各向异性统计量,其时间跨度远超训练数据的时间范围。

📝 摘要(中文)

本文提出了一种通用策略,用于训练神经网络模型,以非侵入方式校正混沌系统欠分辨率的长时间模拟。该方法基于训练一个后处理校正算子,该算子作用于被高保真参考数据引导的欠分辨率模拟。这使得我们能够直接学习底层系统的动力学,从而可以使用非常少的训练数据,即使这些数据的统计数据远未收敛。此外,通过使用概率网络架构,我们能够利用由于有限的训练数据带来的不确定性,进一步提高外推能力。我们将我们的框架应用于准地转流的严重欠分辨率模拟,并证明了它能够准确预测各向异性统计量,其时间跨度比训练中看到的数据长30倍以上。

🔬 方法详解

问题定义:准确模拟混沌系统(如湍流)需要极高的时空分辨率,这在计算上是不可行的,尤其是在需要长时间模拟的场景下,例如气候变化研究。现有的数据驱动模型受限于高质量模拟数据的稀缺性,导致模型难以捕捉罕见极端事件的概率。

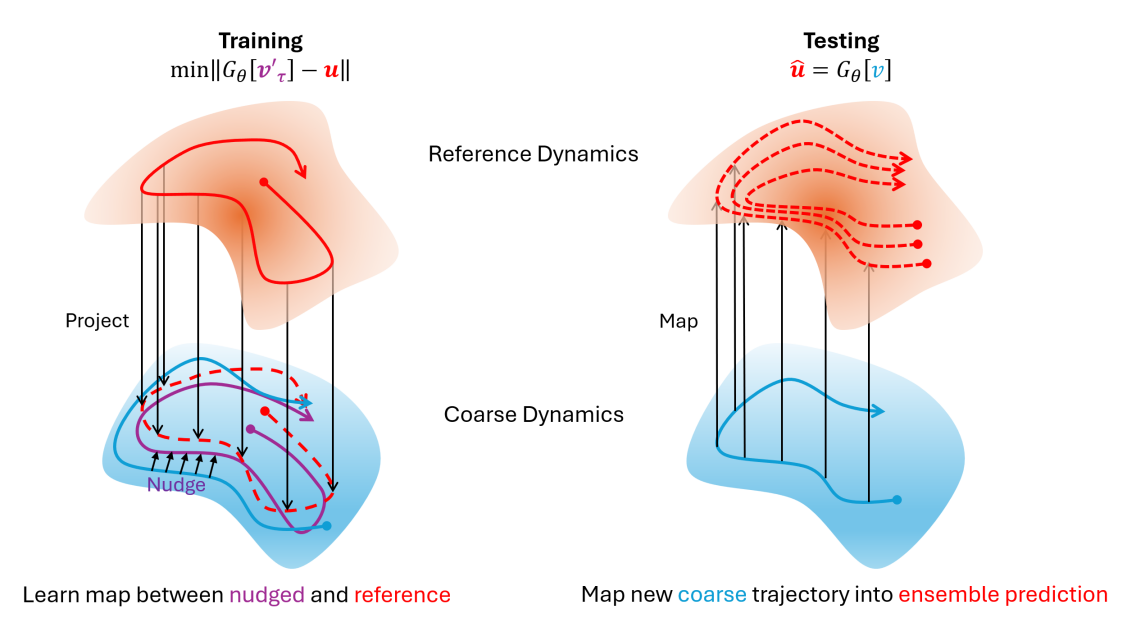

核心思路:该论文的核心思路是训练一个神经网络模型,作为后处理校正算子,对欠分辨率的长时间模拟结果进行校正。通过将欠分辨率模拟结果向高保真参考数据引导(nudging),模型能够学习到底层系统的动力学,从而减少对大量训练数据的需求。

技术框架:该框架包含以下几个主要步骤:1) 生成欠分辨率的长时间模拟数据;2) 利用少量高保真数据对欠分辨率模拟进行引导;3) 训练神经网络模型,学习从欠分辨率模拟到高保真参考数据的映射关系,即校正算子;4) 将训练好的校正算子应用于新的欠分辨率模拟,得到校正后的结果。该框架的关键在于使用概率神经网络,以量化模型的不确定性,并提高外推能力。

关键创新:该论文的关键创新在于提出了一种非侵入式的校正方法,能够利用少量高保真数据,对长时间的欠分辨率模拟结果进行校正。与传统的直接建模方法相比,该方法能够更好地捕捉底层系统的动力学,并具有更强的外推能力。此外,使用概率神经网络能够量化模型的不确定性,进一步提高预测的准确性。

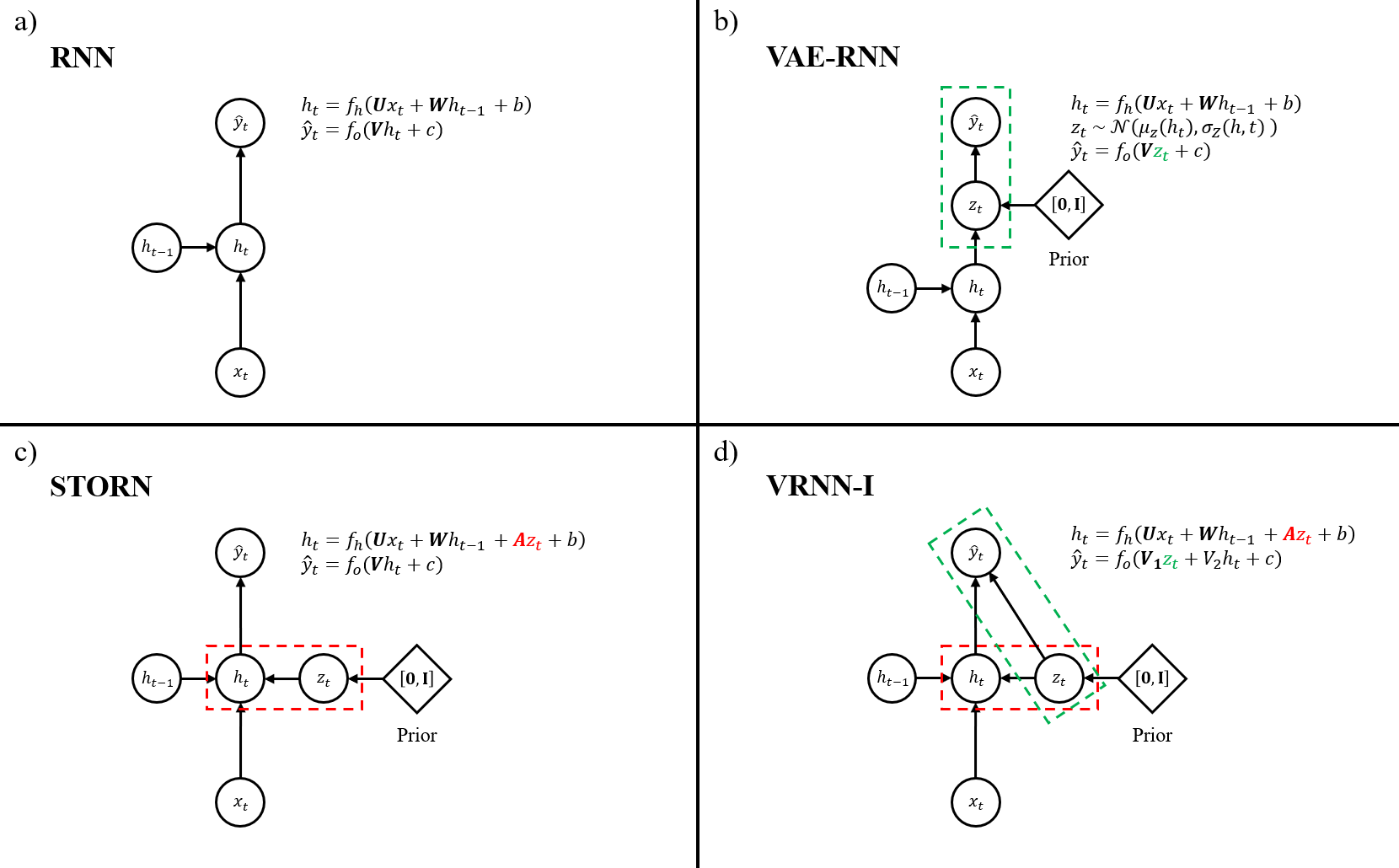

关键设计:该论文使用了概率神经网络,例如变分自编码器(VAE)或生成对抗网络(GAN),来建模校正算子的不确定性。损失函数的设计需要考虑校正后的模拟结果与高保真参考数据之间的差异,以及模型的不确定性。具体的网络结构和参数设置取决于具体的应用场景和数据集。

🖼️ 关键图片

📊 实验亮点

该论文将提出的框架应用于准地转流的严重欠分辨率模拟,实验结果表明,该方法能够准确预测各向异性统计量,其时间跨度比训练中看到的数据长30倍以上。这表明该方法具有很强的外推能力,能够有效地利用少量数据进行长时间的预测。

🎯 应用场景

该研究成果可应用于气候模拟、流体动力学、天气预报等领域,尤其是在需要长时间模拟和高精度预测的场景下。通过利用少量高保真数据校正欠分辨率模拟,可以显著降低计算成本,并提高预测的准确性,从而为风险评估和决策提供更可靠的依据。

📄 摘要(原文)

Chaotic systems, such as turbulent flows, are ubiquitous in science and engineering. However, their study remains a challenge due to the large range scales, and the strong interaction with other, often not fully understood, physics. As a consequence, the spatiotemporal resolution required for accurate simulation of these systems is typically computationally infeasible, particularly for applications of long-term risk assessment, such as the quantification of extreme weather risk due to climate change. While data-driven modeling offers some promise of alleviating these obstacles, the scarcity of high-quality simulations results in limited available data to train such models, which is often compounded by the lack of stability for long-horizon simulations. As such, the computational, algorithmic, and data restrictions generally imply that the probability of rare extreme events is not accurately captured. In this work we present a general strategy for training neural network models to non-intrusively correct under-resolved long-time simulations of chaotic systems. The approach is based on training a post-processing correction operator on under-resolved simulations nudged towards a high-fidelity reference. This enables us to learn the dynamics of the underlying system directly, which allows us to use very little training data, even when the statistics thereof are far from converged. Additionally, through the use of probabilistic network architectures we are able to leverage the uncertainty due to the limited training data to further improve extrapolation capabilities. We apply our framework to severely under-resolved simulations of quasi-geostrophic flow and demonstrate its ability to accurately predict the anisotropic statistics over time horizons more than 30 times longer than the data seen in training.