Big Cooperative Learning

作者: Yulai Cong

分类: cs.LG, cs.AI

发布日期: 2024-07-31

🔗 代码/项目: GITHUB

💡 一句话要点

提出“大合作学习”框架,统一解释并改进大型模型训练范式。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大合作学习 基础模型 对抗训练 生成对抗网络 模型训练

📋 核心要点

- 现有基础模型训练目标分散,缺乏统一的理论框架解释其成功原因和内在联系。

- 提出“大合作学习”框架,将基础模型训练视为多个任务合作逼近数据本质的过程。

- 通过模拟验证框架有效性,并基于此提出BigLearn-GAN,展示其在生成任务中的潜力。

📝 摘要(中文)

合作在人类智能的演进中起着关键作用;此外,它也是由基础模型驱动的近期人工智能革命性进步的基础。具体而言,我们揭示了基础模型的训练可以被解释为一种大型合作学习(简称大学习),其中大量的学习个体/任务通过利用通用模型,从数据预测的各种角度“合作”来接近数据的独特本质。因此,所提出的大学习在一个一致的框架内统一了基础模型的大多数训练目标,同时暴露了它们的潜在假设。我们设计了定制的模拟来演示大学习的原理,并在此基础上为基础模型的成功提供了学习视角的理由,并产生有趣的副产品。此外,我们揭示了大学习是升级传统机器学习范式的新维度,对于赋予相关应用新的活力具有价值;作为一个说明性的例子,我们提出了BigLearn-GAN,这是一种具有通用数据采样能力的新型对抗训练基础模型。代码可在https://github.com/YulaiCong/BigCooperativeLearning获得。

🔬 方法详解

问题定义:论文旨在解决对大型基础模型训练目标理解不统一的问题。现有方法通常将不同的训练目标视为独立的优化问题,缺乏一个统一的视角来解释它们的内在联系以及成功的原因。这使得我们难以理解不同训练目标之间的相互作用,以及如何有效地组合它们来提升模型性能。

核心思路:论文的核心思路是将基础模型的训练过程视为一个“大合作学习”的过程。在这个过程中,大量的学习个体(例如,不同的数据样本、不同的任务)通过共享一个通用模型,从不同的角度对数据进行预测,从而“合作”地逼近数据的本质。这种合作学习的视角能够统一解释不同的训练目标,并揭示它们之间的内在联系。

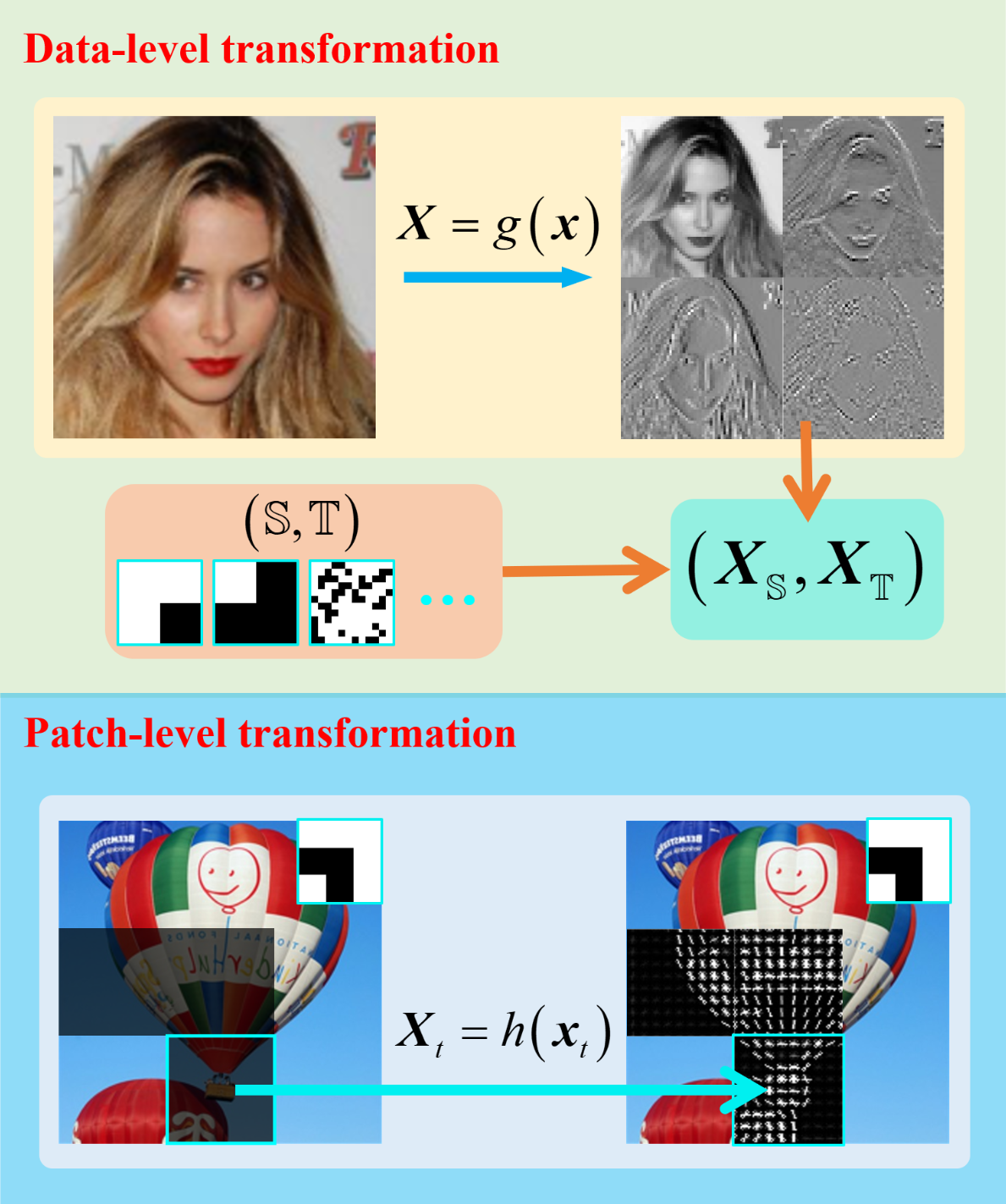

技术框架:论文提出的“大合作学习”框架主要包含以下几个关键组成部分:1) 大量的学习个体/任务,每个个体/任务都试图从不同的角度预测数据;2) 一个通用的模型,所有个体/任务共享该模型,并通过合作学习来提升模型的性能;3) 一个合作机制,用于协调不同个体/任务之间的学习过程,例如,通过共享梯度、交换信息等。论文通过具体的数学公式来描述这个框架,并证明它可以统一解释现有的许多基础模型训练目标。

关键创新:论文最重要的技术创新点在于提出了“大合作学习”这一概念,并将其应用于解释和改进基础模型的训练过程。与现有方法不同,该论文不再将不同的训练目标视为独立的优化问题,而是将它们视为一个合作学习的过程,从而能够更好地理解它们的内在联系,并设计更有效的训练方法。此外,论文还提出了BigLearn-GAN,这是一个基于“大合作学习”框架的新型对抗训练基础模型。

关键设计:论文在模拟实验中,设计了特定的损失函数来模拟不同个体/任务之间的合作学习过程。例如,可以使用交叉熵损失函数来衡量模型预测的准确性,并使用正则化项来鼓励不同个体/任务之间的合作。在BigLearn-GAN中,论文采用了对抗训练的思想,将生成器和判别器视为两个合作学习的个体,通过对抗训练来提升生成器的生成能力。

🖼️ 关键图片

📊 实验亮点

论文通过定制的模拟实验验证了“大合作学习”框架的有效性。实验结果表明,基于该框架训练的模型能够更好地逼近数据的本质,并取得更好的性能。此外,论文提出的BigLearn-GAN在数据采样方面表现出强大的能力,证明了“大合作学习”在生成任务中的潜力。具体性能数据和对比基线信息未知。

🎯 应用场景

该研究成果可应用于各种需要大规模数据训练的机器学习任务,尤其是在自然语言处理、计算机视觉等领域。通过“大合作学习”框架,可以更好地理解和优化基础模型的训练过程,提升模型的泛化能力和鲁棒性。此外,BigLearn-GAN的提出为生成对抗网络提供了一种新的训练范式,有望在图像生成、文本生成等领域取得更好的效果。

📄 摘要(原文)

Cooperation plays a pivotal role in the evolution of human intelligence; moreover, it also underlies the recent revolutionary advancement of artificial intelligence (AI) that is driven by foundation models. Specifically, we reveal that the training of foundation models can be interpreted as a form of big cooperative learning (\textit{abbr.} big learning), where massive learning individuals/tasks \emph{cooperate} to approach the unique essence of data from diverse perspectives of data prediction, leveraging a universal model. The presented big learning therefore unifies most training objectives of foundation models within a consistent framework, where their underlying assumptions are exposed simultaneously. We design tailored simulations to demonstrate the principle of big learning, based on which we provide learning-perspective justifications for the successes of foundation models, with interesting side-products. Furthermore, we reveal that big learning is a new dimension for upgrading conventional machine learning paradigms, valuable for endowing reinvigorations to associated applications; as an illustrative example, we propose the BigLearn-GAN, which is a novel adversarially-trained foundation model with versatile data sampling capabilities. Code is available at \texttt{https://github.com/YulaiCong/BigCooperativeLearning}.