HyperMM : Robust Multimodal Learning with Varying-sized Inputs

作者: Hava Chaptoukaev, Vincenzo Marcianó, Francesco Galati, Maria A. Zuluaga

分类: cs.LG

发布日期: 2024-07-30

💡 一句话要点

HyperMM:一种鲁棒的、处理变长输入的多模态学习框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 模态缺失 超网络 置换不变神经网络 特征提取 阿尔茨海默病检测 乳腺癌分类

📋 核心要点

- 现有方法在多模态学习中,通常假设模态完整,忽略了临床数据中常见的模态缺失问题,导致模型鲁棒性不足。

- HyperMM提出一种端到端的框架,利用条件超网络学习通用特征提取器,并使用置换不变神经网络处理变长特征输入。

- 实验表明,HyperMM在阿尔茨海默病检测和乳腺癌分类任务中,对高缺失率数据表现出鲁棒性,并能处理变长数据集。

📝 摘要(中文)

多模态学习(MML)结合了来自多个模态的互补信息,在诊断多种病理方面显示出显著优势。然而,多模态模型对于模态缺失的鲁棒性常常被忽视。大多数工作假设输入数据的模态完整性,但在临床实践中,模态不完整的情况很常见。现有的解决方案依赖于在应用监督学习模型之前进行模态插补。然而,这些策略复杂、计算成本高昂,并且可能严重影响后续的预测模型。因此,在医疗保健等敏感应用中应谨慎使用。我们提出了HyperMM,一个为处理变长输入而设计的端到端框架。具体来说,我们专注于在缺少图像模态的情况下进行有监督的MML,而无需在训练前进行插补。我们引入了一种新颖的策略,使用条件超网络训练通用特征提取器,并提出了一种置换不变神经网络,它可以处理不同维度的输入来处理提取的特征,这是一个两阶段的与任务无关的框架。我们通过实验证明了我们的方法在两项任务中的优势:阿尔茨海默病检测和乳腺癌分类。我们证明了我们的策略对高缺失率的数据具有鲁棒性,并且其灵活性使其能够处理超出缺失模态场景的各种大小的数据集。

🔬 方法详解

问题定义:论文旨在解决多模态学习中,当输入数据存在模态缺失时,模型性能下降的问题。现有方法通常采用模态插补策略,但这些策略计算成本高,且可能影响后续预测模型的准确性。因此,需要一种无需插补,且能处理变长输入的多模态学习方法。

核心思路:论文的核心思路是设计一个通用的特征提取器,该提取器能够适应不同模态的缺失情况,并提取出具有代表性的特征。同时,设计一个能够处理变长特征输入的分类器,从而实现端到端的多模态学习。这种设计避免了模态插补的需要,提高了模型的效率和鲁棒性。

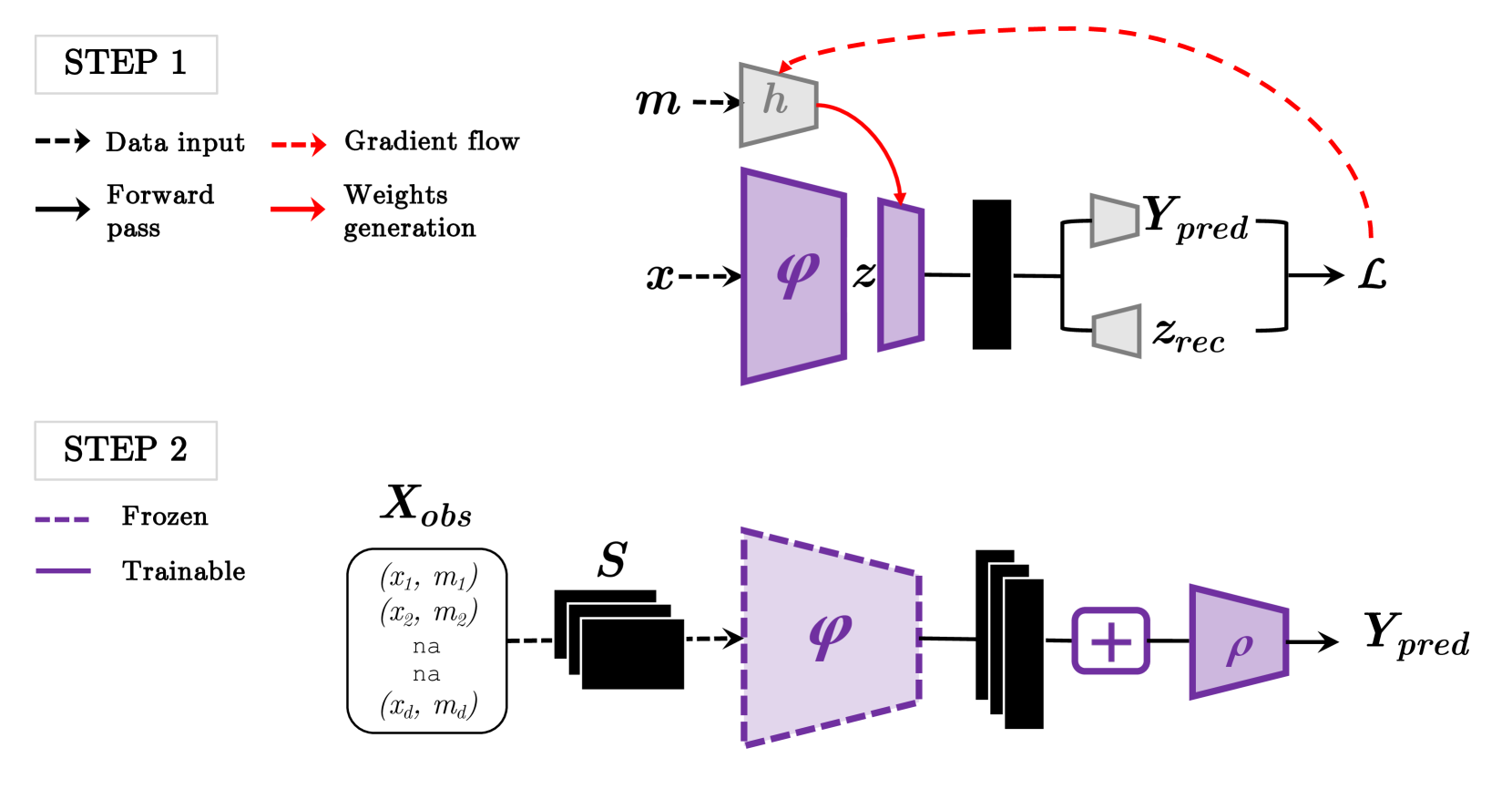

技术框架:HyperMM框架包含两个主要阶段:1) 使用条件超网络训练通用特征提取器;2) 使用置换不变神经网络处理提取的特征并进行分类。第一阶段,超网络根据输入的模态组合生成特征提取器的权重,从而使特征提取器能够适应不同的模态缺失情况。第二阶段,置换不变神经网络将提取的特征作为输入,并输出分类结果。整个框架是端到端的,无需手动进行特征工程或模态插补。

关键创新:论文的关键创新在于提出了一种基于条件超网络的通用特征提取器和一种置换不变神经网络。条件超网络能够根据输入的模态组合动态生成特征提取器的权重,从而使特征提取器能够适应不同的模态缺失情况。置换不变神经网络能够处理变长特征输入,从而避免了对输入数据进行插补或裁剪的需要。

关键设计:条件超网络的设计是关键。超网络以模态组合作为条件输入,生成特征提取器的权重。损失函数的设计需要考虑不同模态组合下的特征提取效果。置换不变神经网络可以使用例如Deep Sets或类似的结构来实现。具体的网络结构和参数设置需要根据具体的任务和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HyperMM在阿尔茨海默病检测和乳腺癌分类任务中,即使在模态缺失率很高的情况下,也能保持较高的预测准确率。与传统的模态插补方法相比,HyperMM在计算效率和预测准确率方面都具有优势。具体的数据提升幅度需要在论文中查找。

🎯 应用场景

HyperMM框架适用于医疗诊断、生物信息学等领域,尤其是在临床数据存在缺失或异构的情况下。例如,可以用于结合基因组数据、影像数据和临床数据进行疾病预测,提高诊断的准确性和效率。该方法还可以应用于其他多模态数据分析任务,例如情感识别、行为分析等。

📄 摘要(原文)

Combining multiple modalities carrying complementary information through multimodal learning (MML) has shown considerable benefits for diagnosing multiple pathologies. However, the robustness of multimodal models to missing modalities is often overlooked. Most works assume modality completeness in the input data, while in clinical practice, it is common to have incomplete modalities. Existing solutions that address this issue rely on modality imputation strategies before using supervised learning models. These strategies, however, are complex, computationally costly and can strongly impact subsequent prediction models. Hence, they should be used with parsimony in sensitive applications such as healthcare. We propose HyperMM, an end-to-end framework designed for learning with varying-sized inputs. Specifically, we focus on the task of supervised MML with missing imaging modalities without using imputation before training. We introduce a novel strategy for training a universal feature extractor using a conditional hypernetwork, and propose a permutation-invariant neural network that can handle inputs of varying dimensions to process the extracted features, in a two-phase task-agnostic framework. We experimentally demonstrate the advantages of our method in two tasks: Alzheimer's disease detection and breast cancer classification. We demonstrate that our strategy is robust to high rates of missing data and that its flexibility allows it to handle varying-sized datasets beyond the scenario of missing modalities.