Polynomial Regression as a Task for Understanding In-context Learning Through Finetuning and Alignment

作者: Max Wilcoxson, Morten Svendgård, Ria Doshi, Dylan Davis, Reya Vir, Anant Sahai

分类: cs.LG, cs.CL

发布日期: 2024-07-27

备注: ICML Workshop on In-Context Learning

💡 一句话要点

提出多项式回归作为理解Transformer模型上下文学习的新任务

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 上下文学习 Transformer模型 多项式回归 提示工程 模型对齐

📋 核心要点

- 现有简单函数类(如线性回归)不足以研究大型语言模型中的提示和对齐现象。

- 论文提出使用单变量多项式回归作为新的函数类,用于研究Transformer模型的上下文学习能力。

- 该方法允许研究人员可视化和理解模型内部的提示和对齐机制,从而更深入地理解上下文学习。

📝 摘要(中文)

为了更好地理解基于Transformer架构的大型语言模型中的上下文学习,简单的函数类问题被提出作为玩具问题。然而,先前提出的简单函数类,如线性回归或多层感知机,缺乏探索提示和模型对齐所需的结构。因此,我们提出单变量多项式回归作为一个函数类,它足够丰富,可以研究提示和对齐,同时允许我们清晰地可视化和理解正在发生的事情。

🔬 方法详解

问题定义:现有研究使用线性回归或多层感知机等简单函数类来理解Transformer模型的上下文学习能力,但这些函数类过于简单,无法有效探索提示工程和模型对齐等复杂现象。因此,需要一种更具结构性的函数类,既能保持可解释性,又能模拟更复杂的学习过程。

核心思路:论文的核心思路是利用单变量多项式回归作为研究上下文学习的代理任务。多项式回归具有足够的复杂度,可以模拟非线性关系,同时其参数具有明确的物理意义,便于可视化和分析。通过观察模型如何学习多项式系数,可以深入理解其上下文学习机制。

技术框架:该研究的技术框架主要包括以下几个步骤:1. 生成多项式回归数据集;2. 使用Transformer模型(如GPT系列)进行训练,使其能够进行上下文学习,即根据给定的输入-输出示例预测新的输出;3. 分析模型的内部表示,例如注意力权重和隐藏层激活,以理解其如何利用上下文信息进行预测;4. 通过改变提示方式和模型结构,研究这些因素对上下文学习的影响。

关键创新:关键创新在于将多项式回归引入作为研究上下文学习的代理任务。与以往的线性回归等方法相比,多项式回归更具代表性,能够更好地模拟真实世界中的复杂函数关系。此外,多项式系数的可解释性使得研究人员能够更直观地理解模型的学习过程。

关键设计:关键设计包括:1. 多项式的阶数选择:需要选择适当的阶数,既能保证模型的表达能力,又能避免过拟合;2. 数据集的生成方式:需要生成具有代表性的数据集,覆盖不同的输入范围和输出值;3. 损失函数的设计:可以使用均方误差等标准损失函数,也可以根据具体任务进行定制;4. 模型结构的调整:可以尝试不同的Transformer模型结构,例如不同的层数、注意力头数等,以研究其对上下文学习的影响。

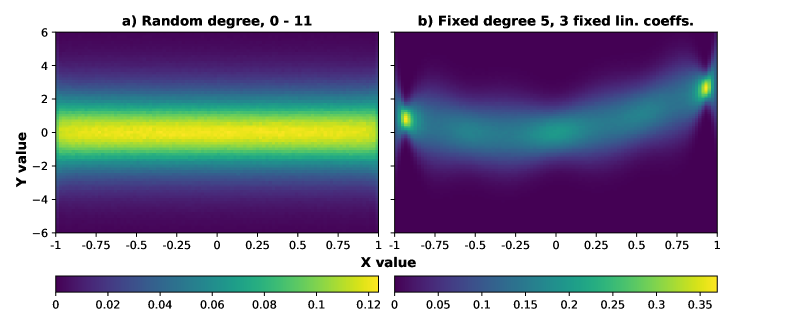

🖼️ 关键图片

📊 实验亮点

论文提出了使用多项式回归作为理解上下文学习的新方法,并初步展示了其在可视化和理解模型内部机制方面的潜力。虽然论文没有提供具体的性能数据,但其核心贡献在于提供了一个新的研究框架,为后续研究奠定了基础。未来的工作可以进一步探索不同多项式阶数、数据集规模和模型结构对上下文学习的影响。

🎯 应用场景

该研究成果可应用于理解和改进大型语言模型的上下文学习能力,例如优化提示工程、提高模型泛化能力和鲁棒性。此外,该方法还可以推广到其他类型的函数类,从而更全面地理解模型的学习机制。未来,该研究有望推动人工智能领域的发展,使模型能够更好地适应复杂多变的任务环境。

📄 摘要(原文)

Simple function classes have emerged as toy problems to better understand in-context-learning in transformer-based architectures used for large language models. But previously proposed simple function classes like linear regression or multi-layer-perceptrons lack the structure required to explore things like prompting and alignment within models capable of in-context-learning. We propose univariate polynomial regression as a function class that is just rich enough to study prompting and alignment, while allowing us to visualize and understand what is going on clearly.