Stay Tuned: An Empirical Study of the Impact of Hyperparameters on LLM Tuning in Real-World Applications

作者: Alon Halfon, Shai Gretz, Ofir Arviv, Artem Spector, Orith Toledo-Ronen, Yoav Katz, Liat Ein-Dor, Michal Shmueli-Scheuer, Noam Slonim

分类: cs.LG, cs.AI, cs.CL

发布日期: 2024-07-25 (更新: 2024-08-07)

💡 一句话要点

针对LLM微调,提出Coverage-based Search方法,为实际应用提供超参数配置建议。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 微调 超参数优化 Coverage-based Search Llama-3-8B Mistral-7B LoRa 实际应用

📋 核心要点

- 现有LLM微调中,超参数选择耗时耗力,缺乏针对实际应用场景的有效指导。

- 提出Coverage-based Search (CBS)方法,通过离线网格搜索对超参数配置进行排序,提供鲁棒性建议。

- 实验表明,Llama-3-8B和LoRA通常更优,且少量推荐的超参数配置即可获得良好效果。

📝 摘要(中文)

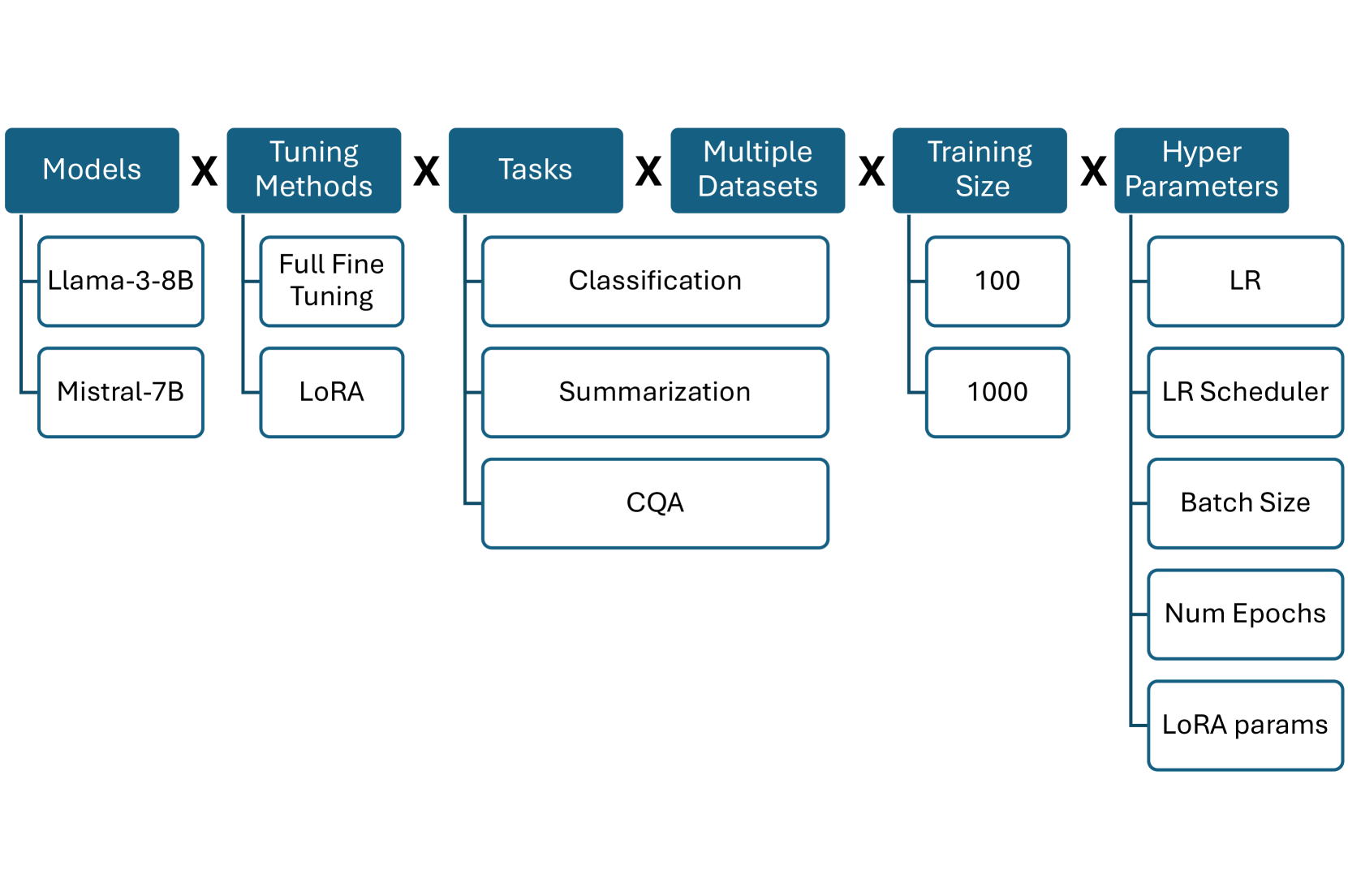

微调大型语言模型(LLMs)是提高其在下游任务上性能的有效方法。然而,选择合适的微调超参数(HPs)设置是一个劳动密集型且计算成本高的过程。本文针对实际用例,为从业者提供更好的起点,推荐了超参数配置,考虑了两种SOTA LLM和两种常用的微调方法。我们描述了基于覆盖率的搜索(CBS),这是一种基于离线广泛网格搜索对HP配置进行排序的过程,使得排名靠前的配置共同为各种数据集和领域提供实用的鲁棒性建议。我们的实验重点是Llama-3-8B和Mistral-7B,以及完全微调和LoRa,总共进行了超过10,000次微调实验。我们的结果表明,一般来说,如果可能,应该优先选择Llama-3-8B和LoRA。此外,我们表明,对于这两种模型和微调方法,仅探索少量由我们的分析推荐的HP配置,就可以在实践中提供出色的结果,使这项工作成为从业者的宝贵资源。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)微调过程中超参数(HPs)选择困难的问题。现有方法通常需要大量的实验和计算资源来搜索最佳超参数组合,这对于实际应用来说成本过高,效率低下。从业者缺乏一个好的起点,难以快速找到合适的超参数配置。

核心思路:论文的核心思路是通过离线进行大规模的超参数网格搜索,然后利用Coverage-based Search (CBS) 方法对搜索结果进行排序,从而为不同的数据集和领域提供一组鲁棒且实用的超参数配置建议。CBS的目标是找到一组超参数配置,这些配置在不同的数据集上都能表现良好,从而减少了在线搜索的需要。

技术框架:整体流程包括以下几个阶段:1) 选择LLM和微调方法(如Llama-3-8B, Mistral-7B, Full Fine-tuning, LoRa);2) 构建超参数的搜索空间;3) 进行大规模的离线网格搜索,评估不同超参数配置的性能;4) 使用CBS方法对超参数配置进行排序,选择排名靠前的配置作为推荐;5) 在实际应用中验证推荐配置的有效性。

关键创新:论文的关键创新在于提出了Coverage-based Search (CBS) 方法。CBS不同于传统的超参数优化方法,它不是寻找在特定数据集上表现最佳的超参数配置,而是寻找一组在多个数据集上都能提供良好性能的配置,从而提高了超参数配置的鲁棒性和泛化能力。这种方法更适合实际应用,因为在实际应用中,数据集的分布往往是未知的。

关键设计:CBS方法的核心在于如何定义和计算超参数配置的“覆盖率”。具体来说,论文可能定义了一个性能阈值,然后计算每个超参数配置在多少个数据集上能够达到这个性能阈值。覆盖率高的超参数配置意味着它在更多的数据集上表现良好,因此更具有鲁棒性。此外,论文还可能考虑了不同超参数之间的相关性,以及它们对模型性能的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Llama-3-8B和LoRA通常是更好的选择。通过CBS方法推荐的少量超参数配置,即可在实践中获得出色的性能。该研究进行了超过10,000次微调实验,验证了CBS方法的有效性和鲁棒性,为LLM微调提供了有价值的参考。

🎯 应用场景

该研究成果可广泛应用于各种需要微调LLM的自然语言处理任务,例如文本分类、情感分析、问答系统、文本生成等。它降低了LLM微调的门槛,使得从业者能够更高效地利用LLM解决实际问题,加速LLM在各行业的落地应用。

📄 摘要(原文)

Fine-tuning Large Language Models (LLMs) is an effective method to enhance their performance on downstream tasks. However, choosing the appropriate setting of tuning hyperparameters (HPs) is a labor-intensive and computationally expensive process. Here, we provide recommended HP configurations for practical use-cases that represent a better starting point for practitioners, when considering two SOTA LLMs and two commonly used tuning methods. We describe Coverage-based Search (CBS), a process for ranking HP configurations based on an offline extensive grid search, such that the top ranked configurations collectively provide a practical robust recommendation for a wide range of datasets and domains. We focus our experiments on Llama-3-8B and Mistral-7B, as well as full fine-tuning and LoRa, conducting a total of > 10,000 tuning experiments. Our results suggest that, in general, Llama-3-8B and LoRA should be preferred, when possible. Moreover, we show that for both models and tuning methods, exploring only a few HP configurations, as recommended by our analysis, can provide excellent results in practice, making this work a valuable resource for practitioners.