Multi-Agent Deep Reinforcement Learning for Resilience Optimization in 5G RAN

作者: Soumeya Kaada, Dinh-Hieu Tran, Nguyen Van Huynh, Marie-Line Alberi Morel, Sofiene Jelassi, Gerardo Rubino

分类: cs.LG, cs.NI

发布日期: 2024-07-25

💡 一句话要点

提出基于多智能体深度强化学习的5G RAN弹性优化方案

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 5G RAN 网络弹性 资源分配 天线倾角优化

📋 核心要点

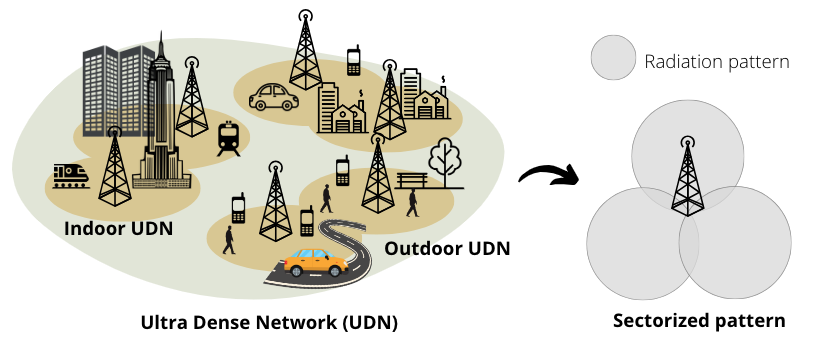

- 现有弹性管理技术难以扩展到大型密集网络部署,主要依赖于局部优化,无法应对日益增长的网络复杂性和用户多样性。

- 提出一种基于多智能体深度强化学习的全局优化方案,通过动态调整天线倾角和发射功率,提升网络在中断下的服务质量。

- 仿真结果表明,该方案显著提高了用户吞吐量方面的服务可用性,并实现了较高的覆盖可用性,验证了方案的有效性。

📝 摘要(中文)

本文研究了5G无线接入网络(RAN)中的弹性优化问题,弹性是指网络抵抗、适应并从中断中快速恢复的能力,从而持续为用户提供可接受的服务水平。针对未来无线网络日益增长的复杂性、用户移动性和多样性带来的挑战,本文提出了一种基于多智能体深度强化学习的解决方案,用于全局优化密集多小区网络的弹性。该方案能够动态调整小区天线的倾角和重新配置发射功率,以缓解中断,提高覆盖率和服务可用性。通过构建多目标优化问题,同时满足弹性约束并最大化网络区域内的服务质量,从而最大限度地减少中断对相邻小区的影响。仿真结果表明,该方案能够将用户吞吐量方面的平均服务可用性提高50-60%,并在最佳情况下达到99%的覆盖可用性。

🔬 方法详解

问题定义:论文旨在解决密集5G无线接入网络(RAN)中,由于网络复杂性、用户移动性和多样性增加,传统局部优化方法难以有效管理网络弹性,导致服务中断和覆盖不足的问题。现有方法无法全局优化网络资源,难以快速适应和恢复,影响用户体验。

核心思路:论文的核心思路是利用多智能体深度强化学习(MADRL),将每个小区视为一个智能体,通过智能体之间的协作,学习全局最优的资源分配策略。每个智能体根据局部观测信息,调整天线倾角和发射功率,以最大化网络整体的弹性和服务质量。这种分布式决策方式能够更好地适应动态变化的网络环境。

技术框架:整体框架包含以下几个主要模块:1) 环境建模:构建一个模拟密集多小区网络的仿真环境,包括用户分布、信道模型、干扰模型等。2) 智能体设计:为每个小区设计一个智能体,智能体可以观测到局部网络状态,并执行动作(调整天线倾角和发射功率)。3) 奖励函数设计:设计一个多目标奖励函数,同时考虑服务可用性、覆盖率和对相邻小区的影响。4) 训练过程:使用MADRL算法训练智能体,使其学习到最优的资源分配策略。

关键创新:最重要的技术创新点在于将多智能体深度强化学习应用于5G RAN的弹性优化。与传统的集中式优化方法相比,MADRL具有更好的可扩展性和适应性,能够处理大规模、动态变化的网络环境。此外,论文还设计了一个多目标奖励函数,能够同时优化多个性能指标。

关键设计:论文中,智能体采用深度Q网络(DQN)作为策略网络。状态空间包括小区负载、用户吞吐量、干扰水平等信息。动作空间包括天线倾角的调整量和发射功率的调整量。奖励函数综合考虑了服务可用性、覆盖率和对相邻小区的影响,并设置了相应的权重。训练过程中,采用经验回放和目标网络等技术来提高训练的稳定性和收敛速度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的基于多智能体深度强化学习的弹性优化方案,能够显著提高5G RAN的服务可用性和覆盖率。具体而言,在用户吞吐量方面的平均服务可用性提高了50-60%,并在最佳情况下达到了99%的覆盖可用性。这些结果表明,该方案能够有效地缓解中断,提高网络弹性。

🎯 应用场景

该研究成果可应用于未来的5G和6G无线网络,提升网络在各种干扰和故障情况下的鲁棒性和服务质量。通过动态调整网络参数,可以有效应对突发流量、设备故障等问题,保障关键业务的连续性,提高用户体验。此外,该方法还可以扩展到其他网络优化问题,如负载均衡、干扰管理等。

📄 摘要(原文)

Resilience is defined as the ability of a network to resist, adapt, and quickly recover from disruptions, and to continue to maintain an acceptable level of services from users' perspective. With the advent of future radio networks, including advanced 5G and upcoming 6G, critical services become integral to future networks, requiring uninterrupted service delivery for end users. Unfortunately, with the growing network complexity, user mobility and diversity, it becomes challenging to scale current resilience management techniques that rely on local optimizations to large dense network deployments. This paper aims to address this problem by globally optimizing the resilience of a dense multi-cell network based on multi-agent deep reinforcement learning. Specifically, our proposed solution can dynamically tilt cell antennas and reconfigure transmit power to mitigate outages and increase both coverage and service availability. A multi-objective optimization problem is formulated to simultaneously satisfy resiliency constraints while maximizing the service quality in the network area in order to minimize the impact of outages on neighbouring cells. Extensive simulations then demonstrate that with our proposed solution, the average service availability in terms of user throughput can be increased by up to 50-60% on average, while reaching a coverage availability of 99% in best cases.