A Large Encoder-Decoder Family of Foundation Models For Chemical Language

作者: Eduardo Soares, Victor Shirasuna, Emilio Vital Brazil, Renato Cerqueira, Dmitry Zubarev, Kristin Schmidt

分类: cs.LG, cs.AI, physics.chem-ph

发布日期: 2024-07-24

备注: 14 pages, 3 figures, 14 tables

DOI: 10.1038/s42004-025-01585-0

💡 一句话要点

提出基于大规模Encoder-Decoder的化学语言基础模型,提升化学性质预测性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 化学语言模型 Encoder-Decoder 预训练 SMILES 量子性质预测

📋 核心要点

- 化学语言模型在大规模无标注数据上的预训练,是化学信息学的一项突破,但现有模型在复杂任务上仍有提升空间。

- 本文提出了一种大规模Encoder-Decoder结构的化学语言基础模型,通过在海量SMILES数据上进行预训练,学习化学语言的上下文表示。

- 实验结果表明,该模型在多种基准数据集上取得了最先进的性能,并且具有良好的少样本学习能力和可分离的潜在空间。

📝 摘要(中文)

本文提出了一系列用于化学语言的大规模Encoder-Decoder基础模型,该模型通过在包含来自PubChem的9100万SMILES样本(相当于40亿分子token)的精选数据集上进行预训练。该基础模型支持多种复杂任务,包括量子性质预测,并提供两种主要变体(289M和8x289M),具有灵活性。在多个基准数据集上的实验验证了所提出的模型在不同任务中提供最先进结果的能力。此外,本文还初步评估了嵌入空间的组合性,作为推理任务的先决条件,并证明了与最先进的少样本学习方法相比,生成的潜在空间是可分离的。

🔬 方法详解

问题定义:现有化学语言模型在处理复杂化学任务,如量子性质预测时,仍面临挑战。这些模型通常需要大量的标注数据进行微调,限制了其在数据稀缺场景下的应用。此外,现有模型的嵌入空间可能缺乏足够的组合性,影响其推理能力。

核心思路:本文的核心思路是利用大规模的Encoder-Decoder结构和海量的无标注SMILES数据进行预训练,从而学习到更丰富的化学语言表示。Encoder-Decoder结构能够更好地捕捉分子结构中的长程依赖关系,提高模型对复杂化学性质的预测能力。

技术框架:该模型采用标准的Encoder-Decoder架构。Encoder负责将SMILES字符串编码成潜在向量表示,Decoder则负责根据该向量生成目标输出,例如预测的化学性质。预训练阶段采用自监督学习的方式,例如Masked Language Modeling (MLM) 或 Sequence-to-Sequence的重建任务。模型提供两种变体,参数量分别为289M和8x289M,以适应不同的计算资源和任务需求。

关键创新:本文的关键创新在于构建了一个大规模的Encoder-Decoder化学语言基础模型,并利用海量的SMILES数据进行预训练。与传统的基于Encoder的模型相比,Encoder-Decoder结构更适合处理序列到序列的任务,例如分子生成和性质预测。此外,本文还关注了嵌入空间的组合性,并提出了相应的评估方法。

关键设计:模型使用Transformer作为Encoder和Decoder的基本单元。预训练阶段采用Masked Language Modeling (MLM) 或 Sequence-to-Sequence的重建任务。损失函数采用交叉熵损失。为了提高训练效率,采用了数据并行和模型并行的策略。具体的参数设置(如Transformer的层数、隐藏层大小、注意力头数等)根据模型的大小(289M和8x289M)进行调整。

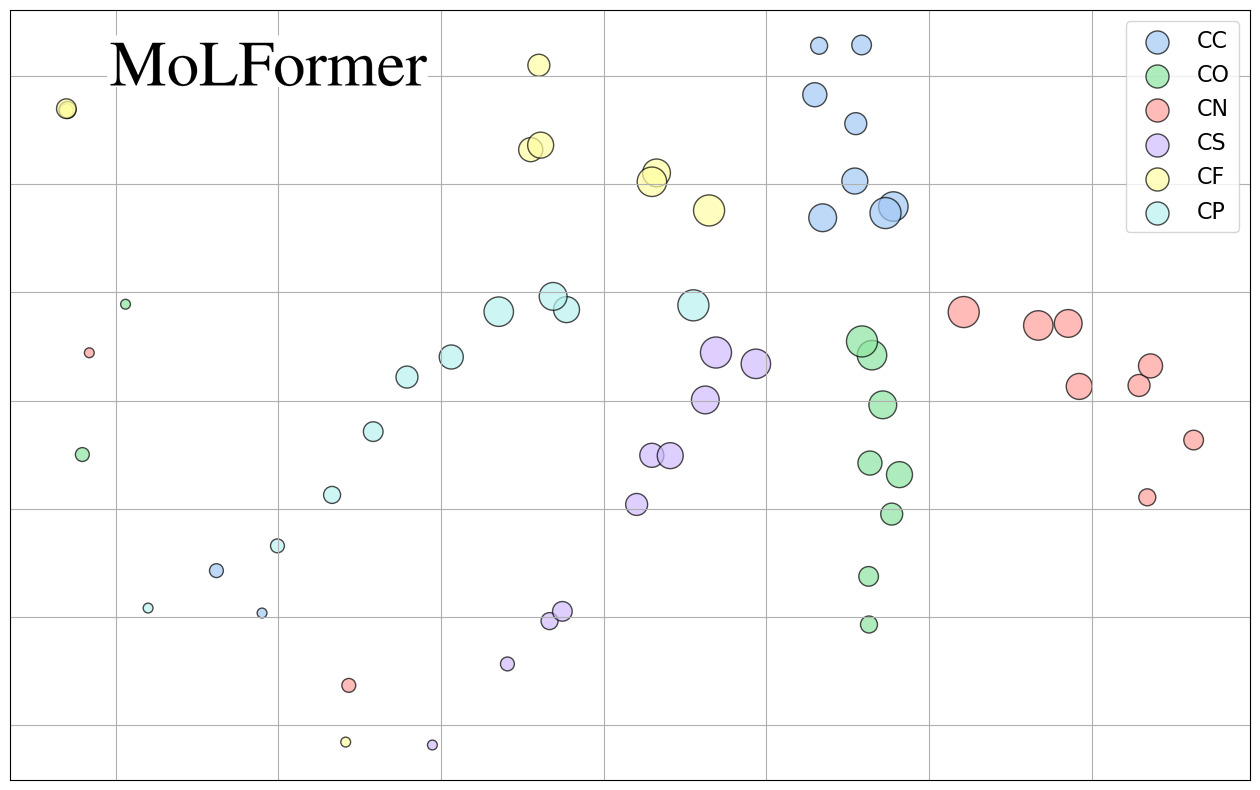

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模型在多个基准数据集上取得了最先进的性能。例如,在量子性质预测任务中,该模型相比现有方法取得了显著的提升。此外,本文还证明了该模型具有良好的少样本学习能力和可分离的潜在空间,这意味着该模型可以更好地泛化到新的任务和数据集上。

🎯 应用场景

该研究成果可广泛应用于药物发现、材料科学等领域。通过预训练的化学语言模型,可以加速新分子的设计和优化,降低实验成本。例如,可以利用该模型预测分子的生物活性、毒性等性质,从而筛选出具有潜在药用价值的候选分子。此外,该模型还可以用于生成具有特定性质的新分子,为新材料的开发提供思路。

📄 摘要(原文)

Large-scale pre-training methodologies for chemical language models represent a breakthrough in cheminformatics. These methods excel in tasks such as property prediction and molecule generation by learning contextualized representations of input tokens through self-supervised learning on large unlabeled corpora. Typically, this involves pre-training on unlabeled data followed by fine-tuning on specific tasks, reducing dependence on annotated datasets and broadening chemical language representation understanding. This paper introduces a large encoder-decoder chemical foundation models pre-trained on a curated dataset of 91 million SMILES samples sourced from PubChem, which is equivalent to 4 billion of molecular tokens. The proposed foundation model supports different complex tasks, including quantum property prediction, and offer flexibility with two main variants (289M and $8\times289M$). Our experiments across multiple benchmark datasets validate the capacity of the proposed model in providing state-of-the-art results for different tasks. We also provide a preliminary assessment of the compositionality of the embedding space as a prerequisite for the reasoning tasks. We demonstrate that the produced latent space is separable compared to the state-of-the-art with few-shot learning capabilities.