Designing Algorithms Empowered by Language Models: An Analytical Framework, Case Studies, and Insights

作者: Yanxi Chen, Yaliang Li, Bolin Ding, Jingren Zhou

分类: cs.LG, cs.AI, cs.CL

发布日期: 2024-07-20 (更新: 2025-10-12)

备注: TMLR camera-ready version

💡 一句话要点

提出LLM算法分析框架,优化LLM驱动的复杂AI系统设计

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 算法设计 分析框架 任务分解 提示工程 智能体 AI系统

📋 核心要点

- 现有LLM算法设计依赖大量试错,缺乏系统性的分析和优化方法。

- 论文提出分析框架,量化任务分解、提示设计等因素对LLM算法性能的影响。

- 通过案例研究和实验验证,框架能够指导LLM算法设计并提升性能。

📝 摘要(中文)

本文提出了一个用于设计和分析基于大型语言模型(LLM)的算法的分析框架。这类算法将一个或多个LLM调用作为子程序,并严重依赖LLM的能力。虽然这些算法,从带有提示工程的基本LLM调用到复杂的LLM驱动的智能体工作流和复合AI系统,已经在经验上取得了显著的成功,但它们的设计和优化通常需要大量的试错和逐个案例分析。我们提出的框架旨在缓解这些问题,提供一种正式和系统的方法来分析LLM算法的准确性和效率如何受到关键设计选择的影响,例如任务分解的模式和粒度,或每个LLM调用的提示。通过涵盖各种算法模式(包括并行/分层/递归任务分解和通用有向无环图)的广泛案例研究,我们展示了所提出的框架的实际应用,并得出了跨场景的有趣见解,并伴随着合成设置中的系统经验验证。

🔬 方法详解

问题定义:论文旨在解决LLM驱动算法设计和优化过程中缺乏系统性分析框架的问题。现有方法主要依赖于大量的实验和经验,难以预测不同设计选择(如任务分解方式、提示工程)对算法性能的影响,导致效率低下和优化困难。

核心思路:论文的核心思路是构建一个形式化的分析框架,将LLM算法的性能(准确率、效率等)与其设计参数(任务分解模式、提示策略等)联系起来。通过该框架,可以定量分析不同设计选择对算法性能的影响,从而指导算法设计和优化。

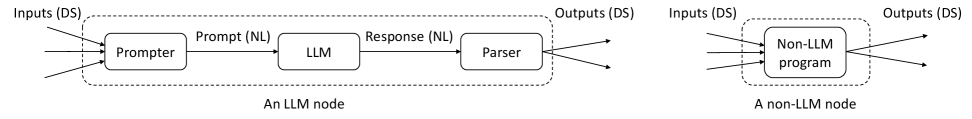

技术框架:该框架主要包含以下几个部分:1) 定义LLM算法的结构,包括任务分解模式(并行、分层、递归等)和LLM调用序列;2) 建立性能模型,将算法的性能指标(如准确率、效率)表示为设计参数的函数;3) 分析框架,利用性能模型分析不同设计选择对算法性能的影响,并提供优化建议。该框架支持多种算法模式,包括并行/分层/递归任务分解和通用有向无环图。

关键创新:该论文的关键创新在于提出了一个形式化的分析框架,能够定量分析LLM算法的设计参数与性能之间的关系。与现有方法相比,该框架提供了一种系统性的方法来指导LLM算法的设计和优化,减少了试错成本,提高了算法性能。

关键设计:框架的关键设计包括:1) 任务分解模式的建模,需要考虑任务之间的依赖关系和并行性;2) 提示工程的建模,需要考虑提示的长度、内容和结构对LLM输出的影响;3) 性能模型的构建,需要选择合适的数学模型来描述设计参数与性能指标之间的关系。论文通过案例研究和实验验证了框架的有效性,并提供了一些通用的设计原则。

🖼️ 关键图片

📊 实验亮点

论文通过在合成数据集上的实验验证了所提出框架的有效性。实验结果表明,该框架能够准确预测不同设计选择对LLM算法性能的影响,并提供有效的优化建议。例如,在特定任务中,采用分层任务分解比并行任务分解能够获得更高的准确率,而优化提示可以显著提高LLM的效率。

🎯 应用场景

该研究成果可应用于各种基于LLM的智能系统设计,例如智能客服、自动化报告生成、代码生成等。通过该框架,开发者可以更高效地设计和优化LLM算法,提升系统性能,降低开发成本。未来,该框架可以扩展到更复杂的LLM应用场景,例如多智能体协作、人机交互等。

📄 摘要(原文)

This work presents an analytical framework for the design and analysis of LLM-based algorithms, i.e., algorithms that contain one or multiple calls of large language models (LLMs) as sub-routines and critically rely on the capabilities of LLMs. While such algorithms, ranging from basic LLM calls with prompt engineering to complicated LLM-powered agentic workflows and compound AI systems, have achieved remarkable empirical success, their design and optimization oftentimes require extensive trial-and-errors and case-by-case analysis. Our proposed framework serves as an attempt to mitigate such headaches, offering a formal and systematic approach for analyzing how the accuracy and efficiency of an LLM-based algorithm will be impacted by critical design choices, such as the pattern and granularity of task decomposition, or the prompt for each LLM call. Through a wide range of case studies covering diverse algorithm patterns (including parallel/hierarchical/recursive task decomposition and generic directed acyclic graphs), we demonstrate the proposed framework in action and derive interesting insights that generalize across scenarios, accompanied by systematic empirical validation in synthetic settings.