Privacy-preserving gradient-based fair federated learning

作者: Janis Adamek, Moritz Schulze Darup

分类: cs.LG, cs.CR, eess.SY

发布日期: 2024-07-18

💡 一句话要点

提出一种基于同态加密的、保护隐私的梯度公平联邦学习方案

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction)

关键词: 联邦学习 隐私保护 公平性 同态加密 局部梯度

📋 核心要点

- 现有联邦学习方案存在隐私泄露风险,且难以保证参与者之间的公平性,尤其是在数据贡献不均衡的情况下。

- 该论文提出一种基于同态加密的联邦学习方案,仅使用局部梯度,旨在实现公平性和隐私保护。

- 该方案提高了可用性,为联邦学习在控制领域的应用提供了可能性,但具体实验结果未知。

📝 摘要(中文)

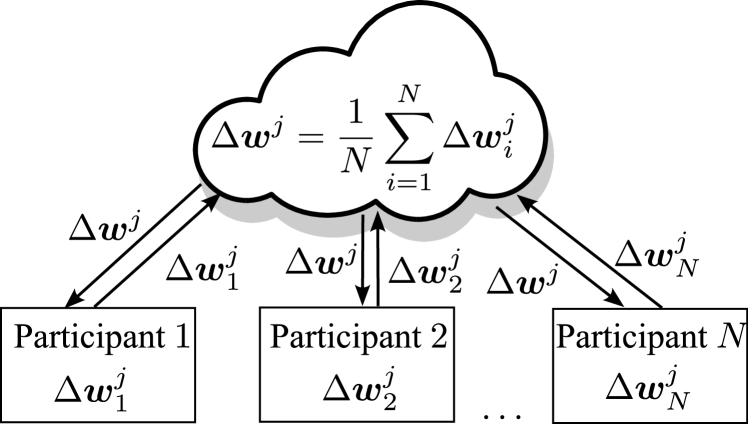

联邦学习(FL)方案允许多个参与者协作训练神经网络,而无需直接共享底层数据。然而,在早期的方案中,所有参与者最终都获得相同的模型。此外,聚合通常由第三方执行,第三方获得组合梯度或权重,这可能会泄露模型信息。这些缺点强调了对公平和保护隐私的FL方案的需求。协作公平性要求模型质量取决于个体数据贡献。隐私性要求保护任何外包给第三方的数据。目前已经存在一些旨在实现公平或保护隐私的FL方法,甚至有一些工作同时解决了这两个特征。在本文中,我们基于这些开创性的工作,提出了一种新的、公平且保护隐私的FL方案。我们的方法主要依赖于同态加密,其突出之处在于仅使用局部梯度。与最先进的方法相比,这提高了可用性,从而为控制领域的应用打开了大门。

🔬 方法详解

问题定义:现有的联邦学习方案在保护隐私和实现公平性方面存在挑战。传统的联邦学习方法,例如FedAvg,所有参与者最终获得相同的模型,无法根据个体数据贡献进行差异化建模,导致贡献大的参与者可能觉得不公平。此外,中心化的梯度或权重聚合过程可能泄露参与者的数据隐私。

核心思路:该论文的核心思路是利用同态加密技术,在保证数据隐私的前提下,实现基于局部梯度的公平联邦学习。通过同态加密,参与者可以在加密后的梯度上进行计算,而无需解密,从而保护了梯度信息。同时,设计合适的机制来衡量和补偿每个参与者的贡献,以实现公平性。

技术框架:该方案主要包含以下几个阶段:1)参与者在本地计算梯度;2)使用同态加密对局部梯度进行加密;3)将加密后的梯度发送给聚合服务器;4)聚合服务器在加密域上进行梯度聚合;5)聚合服务器将聚合后的加密梯度发送给参与者;6)参与者解密聚合后的梯度,并更新本地模型。整个过程的关键在于同态加密的使用,以及如何设计公平性度量和补偿机制。

关键创新:该论文的关键创新在于提出了一种仅使用局部梯度的、公平且保护隐私的联邦学习方案。与现有方法相比,该方案避免了直接共享全局梯度或权重,从而降低了隐私泄露的风险。此外,该方案更加注重个体数据贡献,通过某种机制来保证协作的公平性。

关键设计:论文的关键设计细节未知,但可以推测可能包括:1)选择合适的同态加密方案,例如Paillier加密或BGV加密;2)设计一种公平性度量指标,例如基于Shapley值的贡献度量;3)设计一种补偿机制,例如根据贡献度调整学习率或模型权重;4)优化通信效率,例如使用梯度压缩技术。

🖼️ 关键图片

📊 实验亮点

由于论文摘要中没有提供具体的实验结果,因此无法总结实验亮点。但该方案声称提高了可用性,并为联邦学习在控制领域的应用打开了大门。未来的研究可以关注该方案在实际场景中的性能表现,以及与其他隐私保护和公平性联邦学习方案的对比。

🎯 应用场景

该研究成果可应用于对数据隐私和公平性有较高要求的领域,例如医疗健康、金融风控、智能制造等。在这些领域,不同参与者的数据具有异构性,且数据隐私至关重要。该方案可以促进跨机构的数据协作,提升模型性能,同时保障数据安全和公平性,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

Federated learning (FL) schemes allow multiple participants to collaboratively train neural networks without the need to directly share the underlying data.However, in early schemes, all participants eventually obtain the same model. Moreover, the aggregation is typically carried out by a third party, who obtains combined gradients or weights, which may reveal the model. These downsides underscore the demand for fair and privacy-preserving FL schemes. Here, collaborative fairness asks for individual model quality depending on the individual data contribution. Privacy is demanded with respect to any kind of data outsourced to the third party. Now, there already exist some approaches aiming for either fair or privacy-preserving FL and a few works even address both features. In our paper, we build upon these seminal works and present a novel, fair and privacy-preserving FL scheme. Our approach, which mainly relies on homomorphic encryption, stands out for exclusively using local gradients. This increases the usability in comparison to state-of-the-art approaches and thereby opens the door to applications in control.