Subequivariant Reinforcement Learning in 3D Multi-Entity Physical Environments

作者: Runfa Chen, Ling Wang, Yu Du, Tianrui Xue, Fuchun Sun, Jianwei Zhang, Wenbing Huang

分类: cs.LG, cs.AI, cs.RO

发布日期: 2024-07-17

备注: ICML 2024

💡 一句话要点

提出Subequivariant分层神经网络,解决3D多实体物理环境中强化学习的维度灾难问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 Subequivariant神经网络 局部参考系 任务分配 3D物理环境

📋 核心要点

- 多实体系统策略学习面临维度灾难,全局状态空间随实体数量呈指数增长,现有方法难以有效处理。

- 论文提出Subequivariant分层神经网络(SHNN),通过局部参考系和subequivariant消息传递压缩表示冗余。

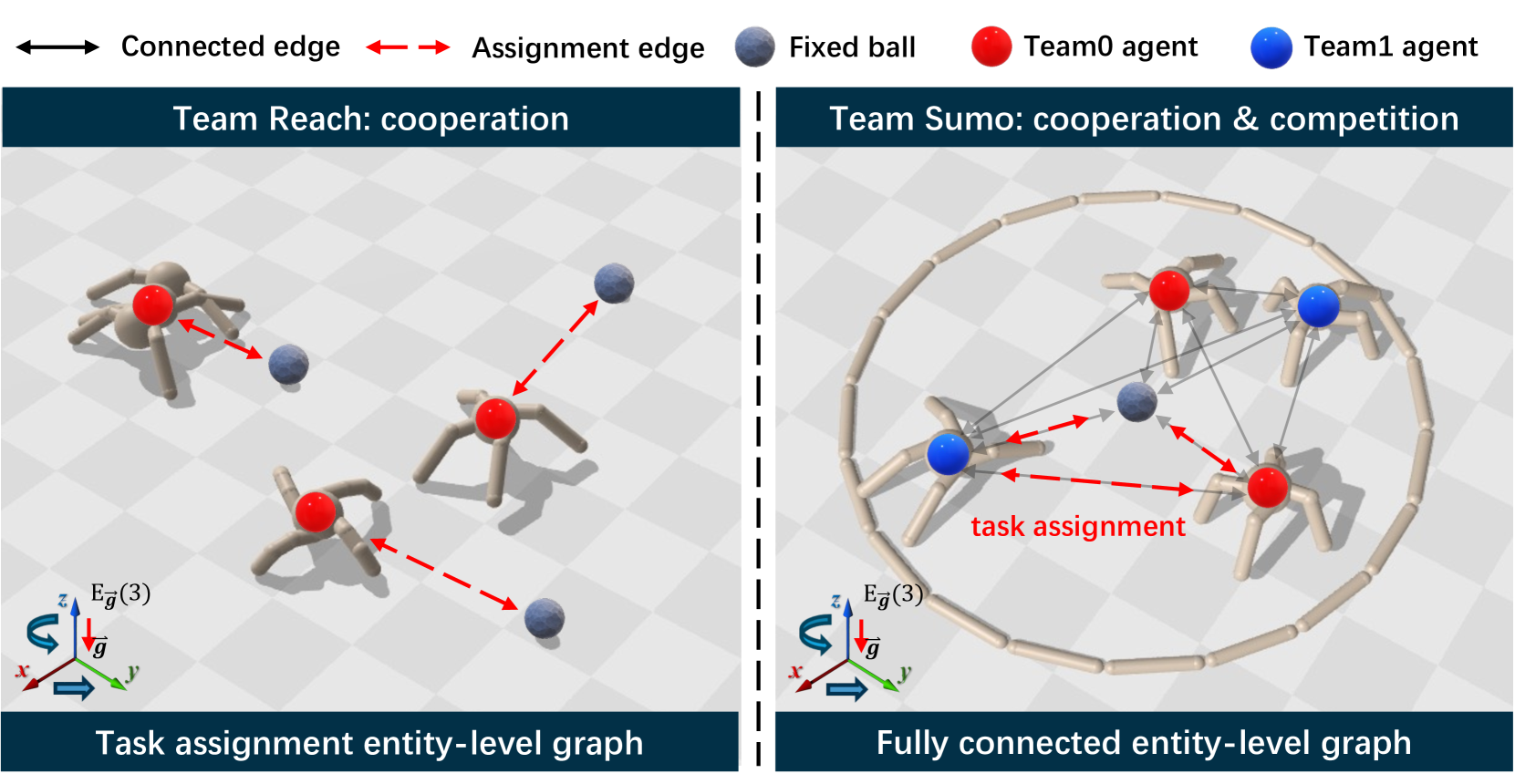

- 论文构建了多实体基准(MEBEN),实验表明SHNN在MEBEN上显著优于现有方法,验证了任务分配和subequivariance的有效性。

📝 摘要(中文)

针对3D环境中多实体系统策略学习的复杂性,论文提出Subequivariant分层神经网络(SHNN)以降低维度灾难。SHNN通过任务分配将全局空间动态解耦为局部实体级图,并利用局部实体级图上的subequivariant消息传递来设计局部参考系,显著压缩了表示冗余,尤其是在受重力影响的环境中。此外,为了克服现有基准在捕捉欧几里德对称性下多实体系统微妙之处的局限性,论文提出了多实体基准(MEBEN),这是一个专门用于探索各种多实体强化学习环境的新套件。大量实验表明,与现有方法相比,SHNN在提出的基准上取得了显著进展。全面的消融实验验证了任务分配和subequivariance的必要性。

🔬 方法详解

问题定义:论文旨在解决3D多实体物理环境中强化学习策略学习的维度灾难问题。随着实体数量增加,全局状态空间呈指数增长,导致传统强化学习方法难以有效探索和学习。现有方法难以充分利用多实体系统中的对称性和局部性,造成表示冗余和泛化能力不足。

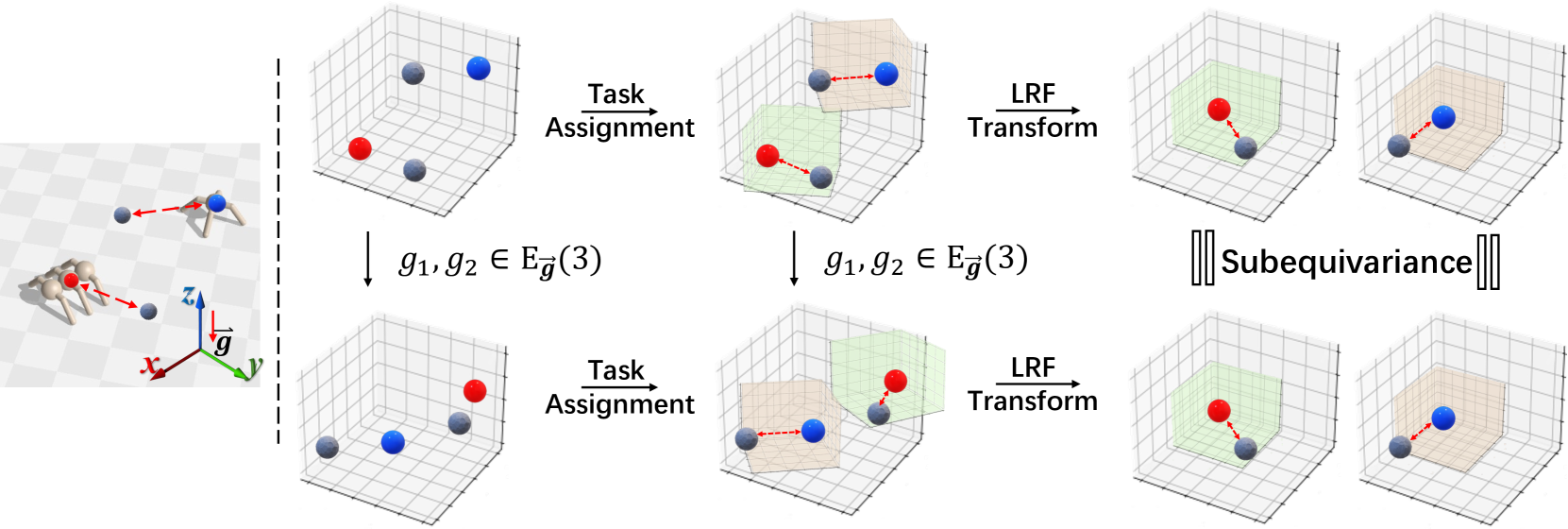

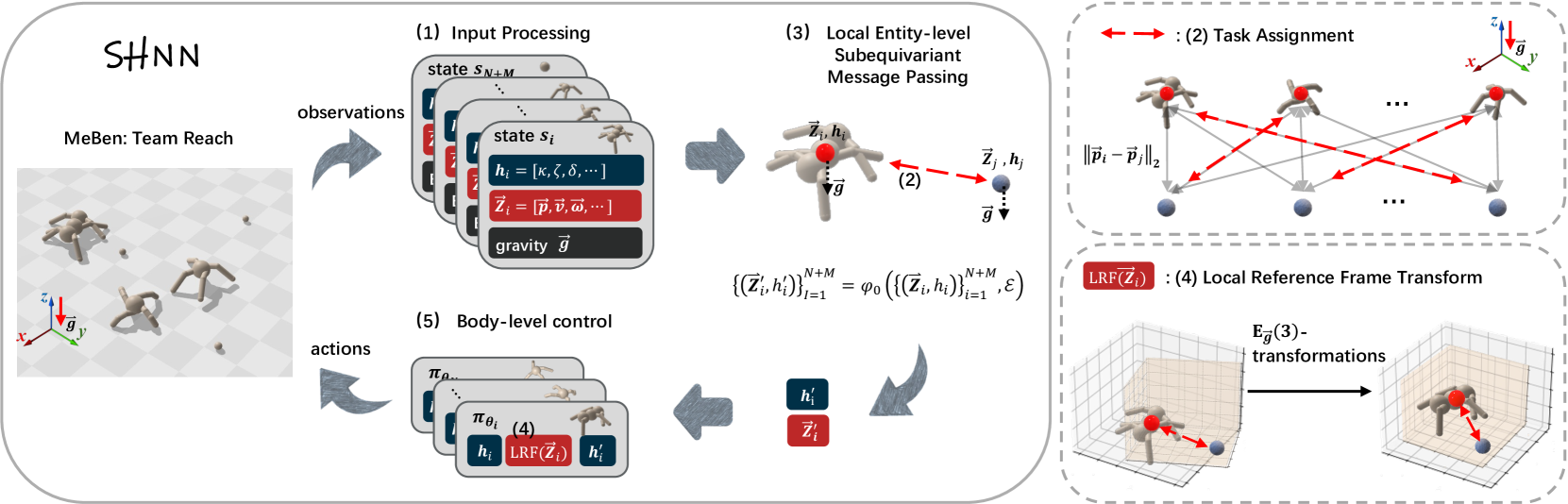

核心思路:论文的核心思路是将全局状态空间解耦为多个局部实体级别的图,并在这些局部图上进行subequivariant消息传递。通过为每个实体建立局部参考系,可以有效地利用环境的对称性,减少表示冗余,并提高策略的泛化能力。任务分配机制进一步优化了局部图的构建,使得每个实体能够专注于与其相关的任务。

技术框架:SHNN的整体框架包含以下几个主要模块:1) 任务分配模块:将全局任务分解为多个局部任务,并分配给不同的实体。2) 局部图构建模块:基于任务分配结果,为每个实体构建局部图,图中包含该实体及其邻居的信息。3) Subequivariant消息传递模块:在局部图上进行消息传递,利用subequivariant操作保持表示的对称性。4) 策略学习模块:基于局部图的表示学习策略。

关键创新:论文的关键创新在于提出了subequivariant消息传递机制,该机制能够在局部图上保持表示的对称性,从而有效地利用环境的几何结构。此外,论文还提出了任务分配机制,该机制能够动态地将全局任务分解为多个局部任务,并分配给不同的实体,从而提高策略的学习效率。MEBEN基准的提出也为多实体强化学习的研究提供了新的平台。

关键设计:任务分配模块使用Gumbel-Softmax技巧进行可微的任务分配。Subequivariant消息传递模块使用Clebsch-Gordan系数来构建subequivariant线性层。损失函数包括强化学习损失(例如,PPO损失)以及辅助损失,例如任务分配的熵损失,以鼓励探索。网络结构采用分层设计,允许不同层次的抽象表示。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SHNN在MEBEN基准上显著优于现有方法,例如在某些任务上性能提升超过50%。消融实验验证了任务分配和subequivariance的必要性,表明它们对SHNN的性能至关重要。可视化结果显示,SHNN能够学习到有效的局部参考系,从而更好地理解环境的几何结构。

🎯 应用场景

该研究成果可应用于多智能体协作机器人、自动驾驶、群体控制等领域。例如,在多机器人协同搬运任务中,SHNN可以学习到高效的策略,使多个机器人能够协同完成复杂的搬运任务。在自动驾驶领域,SHNN可以用于学习车辆之间的协同驾驶策略,提高交通效率和安全性。该研究的未来影响在于推动多智能体系统在复杂物理环境中的应用。

📄 摘要(原文)

Learning policies for multi-entity systems in 3D environments is far more complicated against single-entity scenarios, due to the exponential expansion of the global state space as the number of entities increases. One potential solution of alleviating the exponential complexity is dividing the global space into independent local views that are invariant to transformations including translations and rotations. To this end, this paper proposes Subequivariant Hierarchical Neural Networks (SHNN) to facilitate multi-entity policy learning. In particular, SHNN first dynamically decouples the global space into local entity-level graphs via task assignment. Second, it leverages subequivariant message passing over the local entity-level graphs to devise local reference frames, remarkably compressing the representation redundancy, particularly in gravity-affected environments. Furthermore, to overcome the limitations of existing benchmarks in capturing the subtleties of multi-entity systems under the Euclidean symmetry, we propose the Multi-entity Benchmark (MEBEN), a new suite of environments tailored for exploring a wide range of multi-entity reinforcement learning. Extensive experiments demonstrate significant advancements of SHNN on the proposed benchmarks compared to existing methods. Comprehensive ablations are conducted to verify the indispensability of task assignment and subequivariance.