Learning a Mini-batch Graph Transformer via Two-stage Interaction Augmentation

作者: Wenda Li, Kaixuan Chen, Shunyu Liu, Tongya Zheng, Wenjie Huang, Mingli Song

分类: cs.LG

发布日期: 2024-07-13

备注: 8 pages, 4 figures, Accept by ECAI2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出LGMformer,通过两阶段交互增强的Mini-batch图Transformer,提升半监督节点预测性能。

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction)

关键词: 图神经网络 Mini-batch图Transformer 节点分类 交互增强 局部-全局学习

📋 核心要点

- 现有Mini-batch图Transformer方法在处理局部信息时,存在邻居信息丢失或压缩的问题,限制了模型性能。

- LGMformer通过两阶段交互增强策略,首先利用NTIformer学习局部邻居交互模式,然后通过交叉注意力融入全局图信息。

- 实验结果表明,LGMformer在节点分类任务上取得了显著的性能提升,验证了所提出方法的有效性。

📝 摘要(中文)

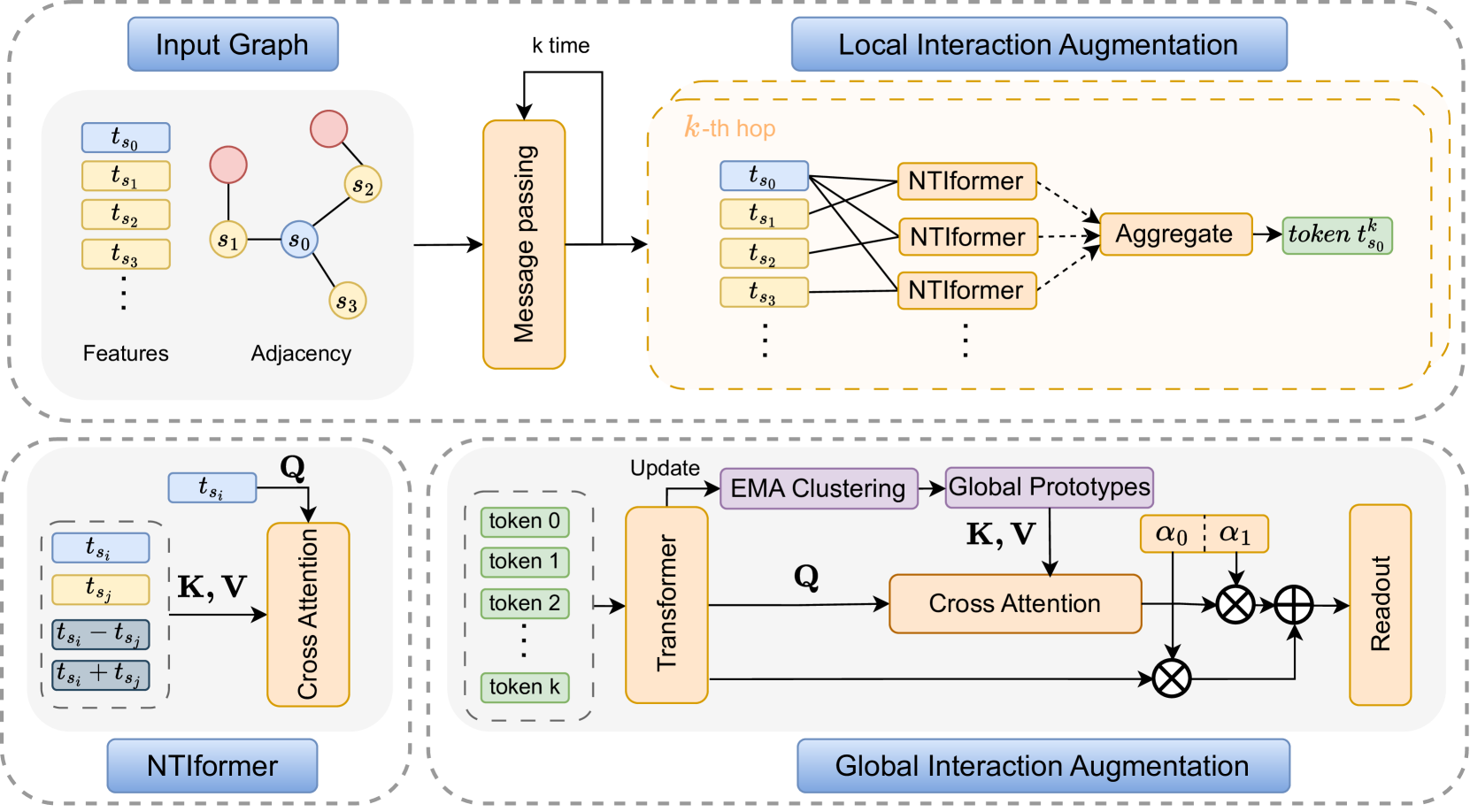

Mini-batch图Transformer (MGT) 作为一种新兴的图学习模型,在半监督节点预测任务中展现出显著优势,提高了计算效率和模型鲁棒性。然而,现有的局部信息处理方法要么依赖采样,要么依赖简单的聚合,分别导致关键邻居信息的丢失和压缩。此外,每个mini-batch中有限的节点数量限制了模型捕获图的全局特征的能力。本文提出LGMformer,一种新颖的MGT模型,采用两阶段增强交互策略,从局部到全局视角过渡,以解决上述瓶颈。局部交互增强 (LIA) 提出了一种邻居-目标交互Transformer (NTIformer),以获得对邻居和目标节点之间协同交互模式的深刻理解,从而产生局部有效的token列表,作为MGT的输入。相比之下,全局交互增强 (GIA) 采用交叉注意力机制将整个图原型纳入目标节点表示中,从而补偿全局图信息,确保更全面的感知。为此,LGMformer实现了MGT范式下节点表示的增强。在十个基准数据集上进行的节点分类实验结果证明了该方法的有效性。

🔬 方法详解

问题定义:论文旨在解决Mini-batch图Transformer (MGT) 在半监督节点预测任务中,由于局部信息处理不充分和全局信息缺失而导致的性能瓶颈。现有方法要么通过采样导致邻居信息丢失,要么通过简单聚合压缩信息,并且受限于mini-batch大小,难以捕获全局图特征。

核心思路:论文的核心思路是通过两阶段的交互增强策略,从局部到全局逐步提升节点表示的质量。首先,通过邻居-目标交互Transformer (NTIformer) 充分挖掘局部邻居与目标节点之间的交互模式;然后,利用交叉注意力机制将全局图原型信息融入到节点表示中,弥补全局信息的缺失。

技术框架:LGMformer的整体框架包含两个主要阶段:局部交互增强 (LIA) 和全局交互增强 (GIA)。在LIA阶段,NTIformer作为核心模块,负责学习邻居节点与目标节点之间的交互关系,生成局部token列表。在GIA阶段,通过交叉注意力机制,将全局图原型信息融入到目标节点的表示中。最终,增强后的节点表示被用于节点分类任务。

关键创新:LGMformer的关键创新在于其两阶段交互增强策略。NTIformer能够更有效地捕捉局部邻居节点与目标节点之间的复杂交互模式,避免了传统方法中信息丢失或压缩的问题。GIA通过引入全局图原型信息,弥补了mini-batch训练中全局信息缺失的不足,使得模型能够更全面地理解图结构。

关键设计:NTIformer的具体结构未知,但推测使用了Transformer架构,重点在于设计有效的注意力机制来捕捉邻居节点与目标节点之间的关系。GIA阶段的交叉注意力机制需要选择合适的全局图原型表示方法,例如聚类中心或图嵌入向量。损失函数方面,可能采用交叉熵损失函数进行节点分类任务的训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LGMformer在十个基准数据集上均取得了优于现有方法的性能。具体的性能提升数据未知,但摘要中强调了该方法在节点分类任务上的有效性。与传统的Mini-batch图Transformer相比,LGMformer能够更有效地利用局部和全局信息,从而提升节点表示的质量和分类准确率。

🎯 应用场景

LGMformer具有广泛的应用前景,例如社交网络分析、推荐系统、生物信息学等领域。在社交网络中,可以用于识别虚假账号或预测用户兴趣。在推荐系统中,可以用于提升推荐的准确性和个性化程度。在生物信息学中,可以用于预测蛋白质功能或药物靶点。

📄 摘要(原文)

Mini-batch Graph Transformer (MGT), as an emerging graph learning model, has demonstrated significant advantages in semi-supervised node prediction tasks with improved computational efficiency and enhanced model robustness. However, existing methods for processing local information either rely on sampling or simple aggregation, which respectively result in the loss and squashing of critical neighbor information.Moreover, the limited number of nodes in each mini-batch restricts the model's capacity to capture the global characteristic of the graph. In this paper, we propose LGMformer, a novel MGT model that employs a two-stage augmented interaction strategy, transitioning from local to global perspectives, to address the aforementioned bottlenecks.The local interaction augmentation (LIA) presents a neighbor-target interaction Transformer (NTIformer) to acquire an insightful understanding of the co-interaction patterns between neighbors and the target node, resulting in a locally effective token list that serves as input for the MGT. In contrast, global interaction augmentation (GIA) adopts a cross-attention mechanism to incorporate entire graph prototypes into the target node epresentation, thereby compensating for the global graph information to ensure a more comprehensive perception. To this end, LGMformer achieves the enhancement of node representations under the MGT paradigm.Experimental results related to node classification on the ten benchmark datasets demonstrate the effectiveness of the proposed method. Our code is available at https://github.com/l-wd/LGMformer.