Enhancing Performance and User Engagement in Everyday Stress Monitoring: A Context-Aware Active Reinforcement Learning Approach

作者: Seyed Amir Hossein Aqajari, Ziyu Wang, Ali Tazarv, Sina Labbaf, Salar Jafarlou, Brenda Nguyen, Nikil Dutt, Marco Levorato, Amir M. Rahmani

分类: cs.LG

发布日期: 2024-07-11

💡 一句话要点

提出上下文感知主动强化学习,提升日常压力监测性能与用户体验

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 压力监测 主动强化学习 上下文感知 生态瞬时评估 智能穿戴 个性化健康 PPG数据

📋 核心要点

- 传统压力监测方法依赖大量数据,且EMA方式存在用户负担和数据效率问题。

- 论文提出上下文感知主动强化学习,动态优化EMA发送时机,平衡监测效率与用户体验。

- 实验结果表明,该方法在压力检测效率、模型准确率和个性化方面均有显著提升。

📝 摘要(中文)

在快节奏的现代社会,准确监测压力水平至关重要。基于传感器的压力监测系统通常需要大量数据来训练有效模型。然而,个性化和交互式场景需要个体特定的模型。生态瞬时评估(EMA)等传统方法评估压力,但难以高效收集数据而不给用户带来负担。挑战在于及时发送EMA,尤其是在压力期间,需要平衡监测效率和用户便利性。本文提出了一种新颖的上下文感知主动强化学习(RL)算法,用于增强使用智能手表的光电容积脉搏波(PPG)数据和智能手机的上下文数据进行压力检测。我们的方法动态选择部署EMA的最佳时间,利用用户的即时上下文来最大化标签准确性并最小化侵入性。最初,该研究在离线环境中执行,以改进标签收集过程,旨在提高准确性,同时减少用户负担。后来,我们集成了一个实时标签收集机制,过渡到在线方法。这种转变使压力检测效率提高了11%。结合上下文数据使模型准确率提高了4%。个性化研究表明,AUC-ROC分数提高了10%,表明更好地区分了压力水平。这项研究标志着朝着个性化、上下文驱动的实时压力监测方法迈出了重要一步。

🔬 方法详解

问题定义:论文旨在解决日常压力监测中,如何高效、准确地收集个体化的压力数据,同时降低用户负担的问题。现有方法,如频繁的EMA问卷调查,虽然能获取压力标签,但会给用户带来不便,导致数据质量下降甚至用户抵触。传统机器学习方法需要大量标注数据,难以适应个体差异,且忽略了用户所处的上下文环境对压力状态的影响。

核心思路:论文的核心思路是利用主动强化学习(RL)算法,根据用户的实时上下文信息,动态地选择最佳的EMA发送时机。通过奖励机制,鼓励算法在用户压力较高且方便回答时发送EMA,从而最大化标签的准确性和减少对用户的干扰。这种方法将数据收集过程视为一个优化问题,旨在平衡数据质量和用户体验。

技术框架:整体框架包含以下几个主要模块:1) 传感器数据采集模块:从智能手表(PPG数据)和智能手机(上下文数据,如位置、活动状态)收集数据。2) 特征提取模块:从原始传感器数据中提取与压力相关的特征。3) 上下文感知模块:分析用户的上下文信息,例如时间、地点、活动状态等。4) 主动强化学习Agent:根据当前状态(包括传感器数据和上下文信息),决定是否发送EMA。5) 奖励函数:根据用户对EMA的反馈(例如,是否及时回答、回答质量),给予Agent奖励或惩罚。6) 模型训练与更新模块:利用收集到的数据和奖励信号,不断优化RL Agent的策略。

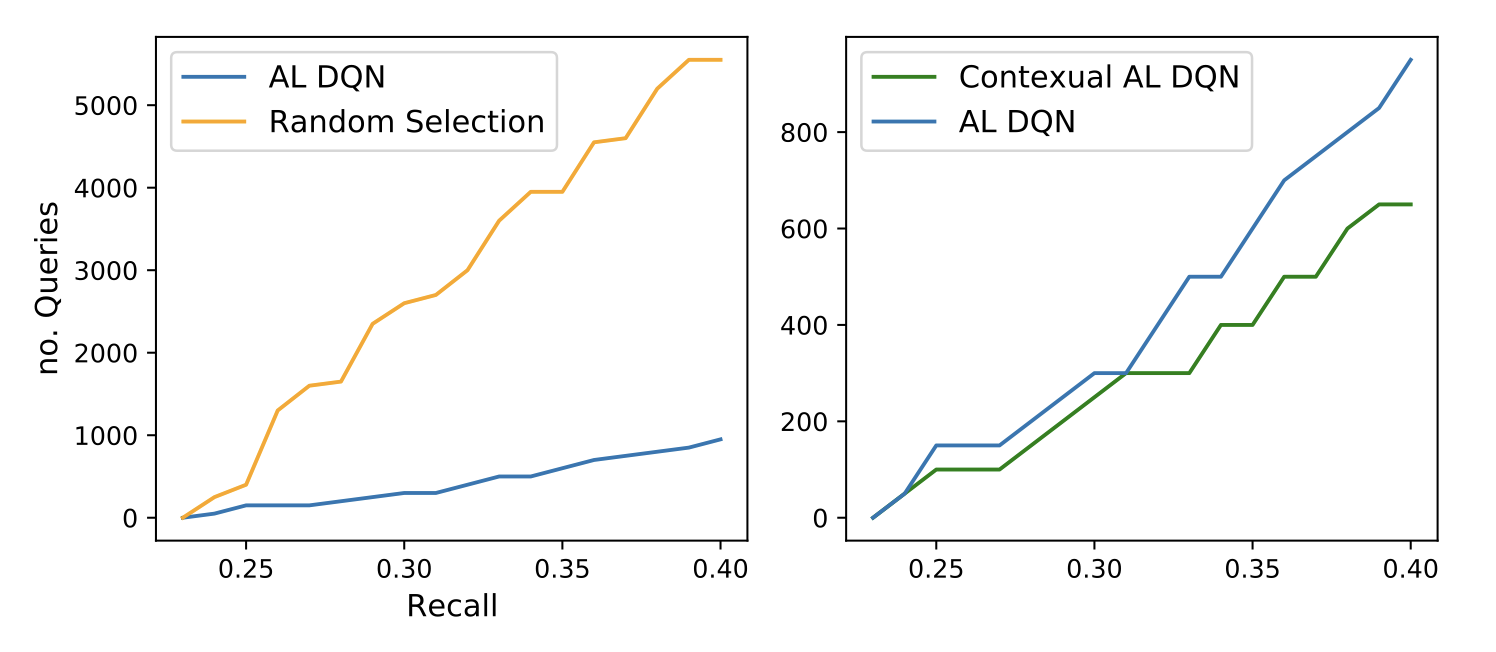

关键创新:论文的关键创新在于将上下文信息融入到主动强化学习框架中,实现了上下文感知的EMA触发。传统的主动学习方法通常只考虑数据的不确定性,而忽略了用户所处的环境。通过结合上下文信息,该方法能够更准确地判断用户是否处于压力状态,以及是否方便回答EMA,从而提高了数据收集的效率和准确性。

关键设计:奖励函数的设计是关键。论文可能采用了以下设计:及时回答EMA给予正向奖励,延迟或拒绝回答给予负向奖励;根据用户回答的质量(例如,是否认真填写)调整奖励大小;在高压力状态下成功收集到标签给予更高的奖励。此外,RL Agent可能采用了深度Q网络(DQN)或其他深度强化学习算法,以处理高维状态空间和复杂的决策过程。具体的网络结构和参数设置未知。

🖼️ 关键图片

📊 实验亮点

研究结果表明,该方法在压力检测效率方面提升了11%,结合上下文数据使模型准确率提高了4%。个性化研究表明,AUC-ROC分数提高了10%,表明更好地压力水平区分能力。这些数据表明,该方法在提升压力监测性能和用户体验方面具有显著优势。

🎯 应用场景

该研究成果可应用于个性化健康管理、智能穿戴设备、心理健康咨询等领域。通过实时监测和评估用户的压力水平,可以提供及时的干预和支持,帮助用户更好地管理压力,改善生活质量。未来,该技术有望集成到各种智能设备和应用中,实现普惠的心理健康服务。

📄 摘要(原文)

In today's fast-paced world, accurately monitoring stress levels is crucial. Sensor-based stress monitoring systems often need large datasets for training effective models. However, individual-specific models are necessary for personalized and interactive scenarios. Traditional methods like Ecological Momentary Assessments (EMAs) assess stress but struggle with efficient data collection without burdening users. The challenge is to timely send EMAs, especially during stress, balancing monitoring efficiency and user convenience. This paper introduces a novel context-aware active reinforcement learning (RL) algorithm for enhanced stress detection using Photoplethysmography (PPG) data from smartwatches and contextual data from smartphones. Our approach dynamically selects optimal times for deploying EMAs, utilizing the user's immediate context to maximize label accuracy and minimize intrusiveness. Initially, the study was executed in an offline environment to refine the label collection process, aiming to increase accuracy while reducing user burden. Later, we integrated a real-time label collection mechanism, transitioning to an online methodology. This shift resulted in an 11% improvement in stress detection efficiency. Incorporating contextual data improved model accuracy by 4%. Personalization studies indicated a 10% enhancement in AUC-ROC scores, demonstrating better stress level differentiation. This research marks a significant move towards personalized, context-driven real-time stress monitoring methods.