A Critical Review of Causal Reasoning Benchmarks for Large Language Models

作者: Linying Yang, Vik Shirvaikar, Oscar Clivio, Fabian Falck

分类: cs.LG, cs.CL

发布日期: 2024-07-10

备注: AAAI 2024 Workshop on ''Are Large Language Models Simply Causal Parrots?''

💡 一句话要点

对大型语言模型因果推理基准的批判性综述

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 因果推理 基准评估 干预推理 反事实推理 知识检索 LLM

📋 核心要点

- 现有LLM因果推理基准可能通过检索领域知识解决,未能有效评估模型真正的因果推理能力。

- 论文通过分析现有基准,提出了一组评估因果推理能力的标准,强调干预和反事实推理的重要性。

- 该综述旨在为未来设计更有效的因果推理基准和评估LLM的因果理解能力提供指导。

📝 摘要(中文)

大量基准旨在评估大型语言模型(LLM)在因果推理方面的能力。然而,其中许多基准可能可以通过检索领域知识来解决,这让人质疑它们是否达到了目的。本文对LLM因果关系基准进行了全面的概述,重点介绍了最近的基准如何通过结合干预或反事实推理来更彻底地定义因果推理。我们推导出了一组有用的基准或基准集应该努力满足的标准。希望这项工作能为评估LLM中因果理解的通用框架以及新基准的设计铺平道路。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)因果推理基准存在缺陷,许多基准可以通过简单的知识检索来解决,无法真正评估LLM的因果推理能力。这使得我们难以准确评估LLM是否具备真正的因果理解能力,并阻碍了LLM在需要因果推理的实际应用中的发展。

核心思路:论文的核心思路是对现有的LLM因果推理基准进行全面的批判性分析,并提出一套更严格的评估标准。这些标准强调基准应该包含干预性推理(interventional reasoning)和反事实推理(counterfactual reasoning),以确保模型不能仅仅通过检索知识来解决问题,而是需要进行真正的因果推理。

技术框架:论文采用综述的形式,没有提出新的模型或算法。其技术框架主要体现在对现有基准的分类和分析上。论文首先对现有的LLM因果推理基准进行了收集和整理,然后根据其特点和缺陷进行了分类。接着,论文提出了评估因果推理基准的标准,包括是否包含干预性推理、反事实推理等。最后,论文基于这些标准对现有基准进行了评估,并提出了改进建议。

关键创新:论文的关键创新在于提出了评估LLM因果推理基准的标准。这些标准为未来设计更有效的因果推理基准提供了指导,并有助于更准确地评估LLM的因果理解能力。通过强调干预性推理和反事实推理的重要性,论文推动了LLM因果推理研究的发展。

关键设计:论文没有涉及具体的参数设置、损失函数或网络结构等技术细节。其关键设计体现在对评估标准的定义上。这些标准包括:1) 基准是否包含干预性推理;2) 基准是否包含反事实推理;3) 基准是否容易通过知识检索解决;4) 基准是否具有足够的难度和区分度。

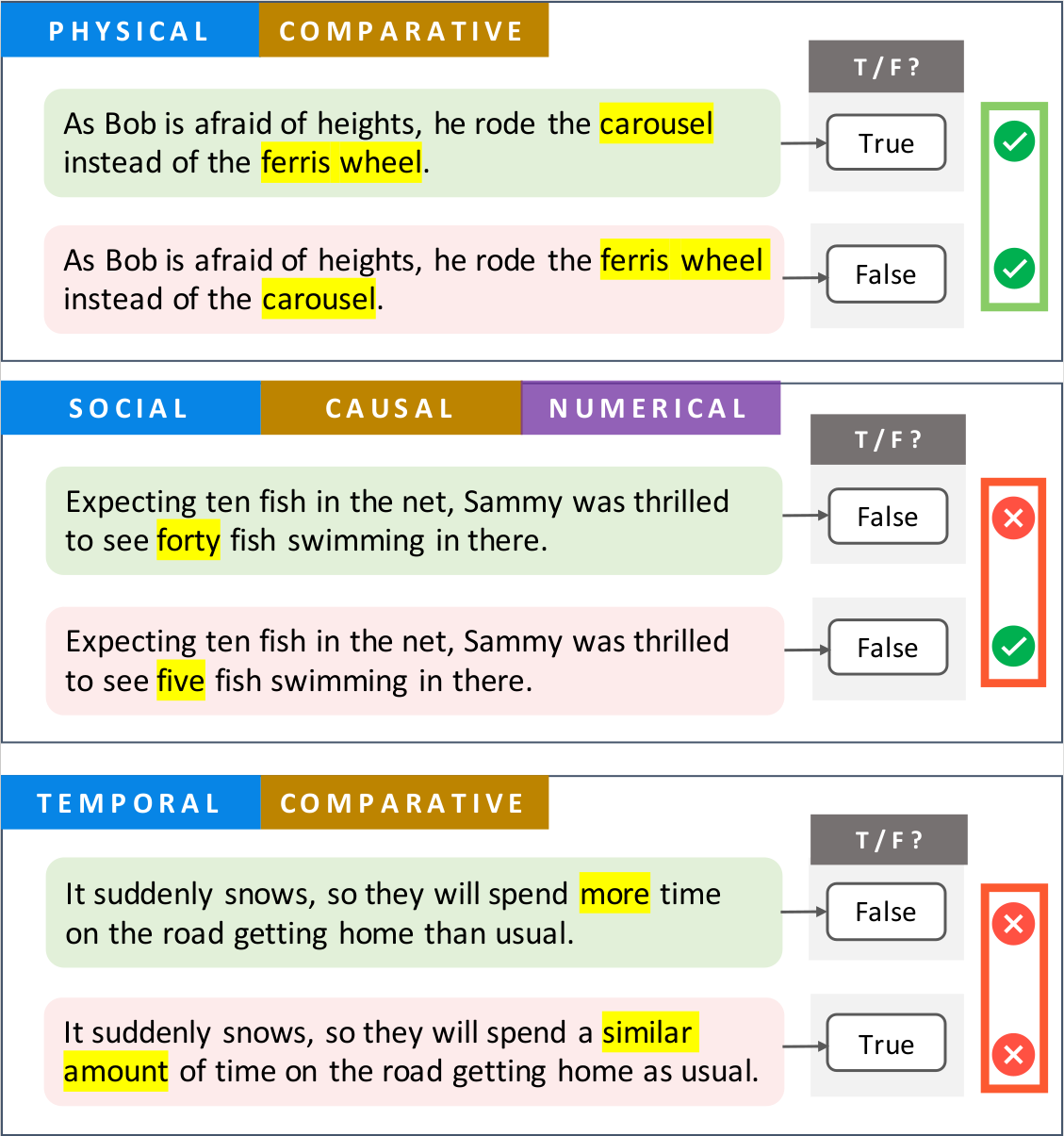

🖼️ 关键图片

📊 实验亮点

论文通过对现有基准的批判性分析,揭示了当前LLM因果推理评估的局限性。提出的评估标准为未来基准设计提供了明确的方向,强调了干预和反事实推理的重要性,为更有效地评估LLM的因果理解能力奠定了基础。

🎯 应用场景

该研究成果可应用于指导未来LLM因果推理基准的设计,提升LLM在医疗诊断、政策制定、风险评估等领域的应用能力。通过更准确地评估和提升LLM的因果推理能力,可以使其在复杂决策场景中发挥更大的作用。

📄 摘要(原文)

Numerous benchmarks aim to evaluate the capabilities of Large Language Models (LLMs) for causal inference and reasoning. However, many of them can likely be solved through the retrieval of domain knowledge, questioning whether they achieve their purpose. In this review, we present a comprehensive overview of LLM benchmarks for causality. We highlight how recent benchmarks move towards a more thorough definition of causal reasoning by incorporating interventional or counterfactual reasoning. We derive a set of criteria that a useful benchmark or set of benchmarks should aim to satisfy. We hope this work will pave the way towards a general framework for the assessment of causal understanding in LLMs and the design of novel benchmarks.