Toto: Time Series Optimized Transformer for Observability

作者: Ben Cohen, Emaad Khwaja, Kan Wang, Charles Masson, Elise Ramé, Youssef Doubli, Othmane Abou-Amal

分类: cs.LG, cs.AI

发布日期: 2024-07-10 (更新: 2024-07-11)

💡 一句话要点

Datadog发布Toto:面向可观测性的时序优化Transformer基础模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 Transformer 可观测性 基础模型 零样本学习

📋 核心要点

- 现有时间序列预测模型在可观测性指标上的表现不足,难以满足实际需求。

- Toto通过在海量可观测性数据上预训练Transformer模型,学习通用时序特征。

- 实验表明,Toto在可观测性数据和通用时序预测任务上均取得了领先的零样本性能。

📝 摘要(中文)

本技术报告介绍了由Datadog开发的时序优化Transformer for Observability (Toto),这是一种用于时间序列预测的先进基础模型。除了在电力和天气等领域的通用时间序列基准测试中推进技术水平之外,该模型还是第一个专门针对可观测性指标进行调整的通用时间序列预测基础模型。Toto在包含一万亿个时间序列数据点的数据集上进行训练,这是目前所有已发布的时间序列基础模型中最大的数据集。除了公开可用的时间序列数据集外,用于训练Toto的数据中有75%来自Datadog平台的完全匿名数值指标数据点。实验表明,Toto在可观测性数据上优于现有的时间序列基础模型。同时,它在通用预测任务中表现出色,在多个开放基准数据集上实现了最先进的零样本性能。

🔬 方法详解

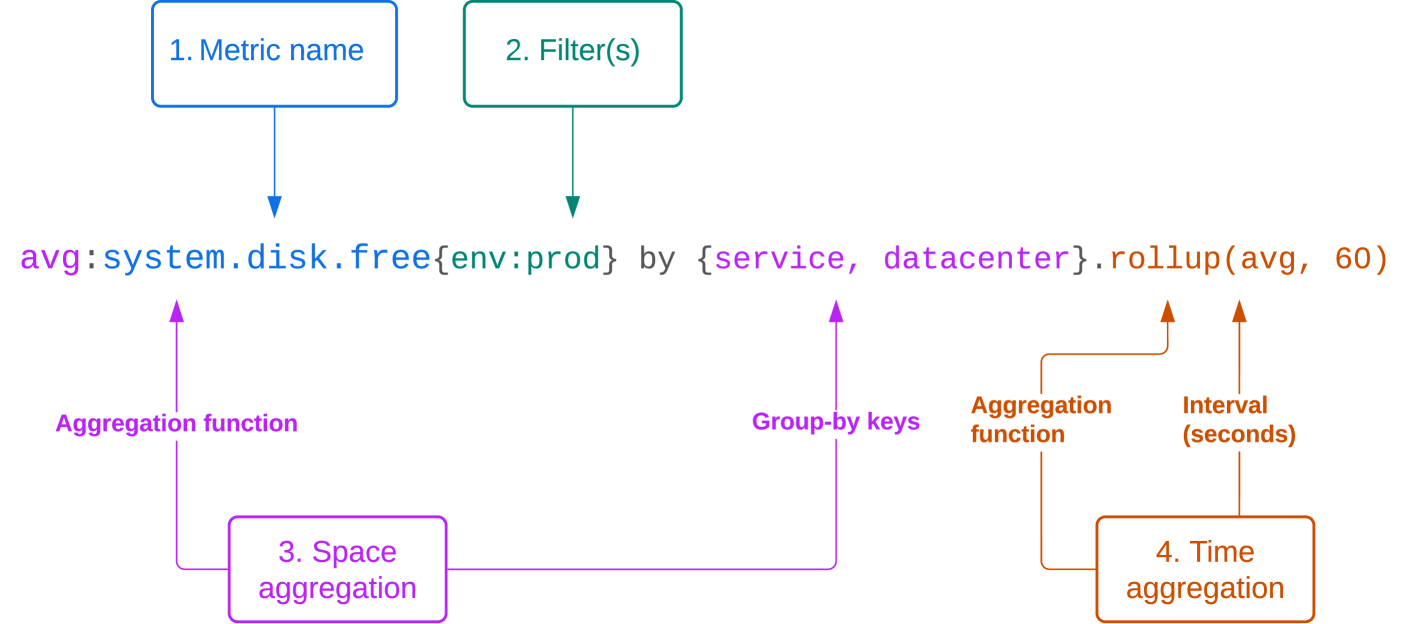

问题定义:论文旨在解决时间序列预测问题,特别关注可观测性指标的预测。现有时间序列预测模型,尤其是通用模型,在处理特定领域(如可观测性)的数据时,往往表现不佳,无法充分利用领域知识。此外,缺乏大规模的、专门针对可观测性指标训练的基础模型。

核心思路:论文的核心思路是利用Transformer架构的强大建模能力,结合大规模的可观测性数据进行预训练,从而学习到通用的时序特征表示。通过这种方式,模型可以更好地泛化到不同的可观测性指标和预测任务中,实现零样本或少样本学习。

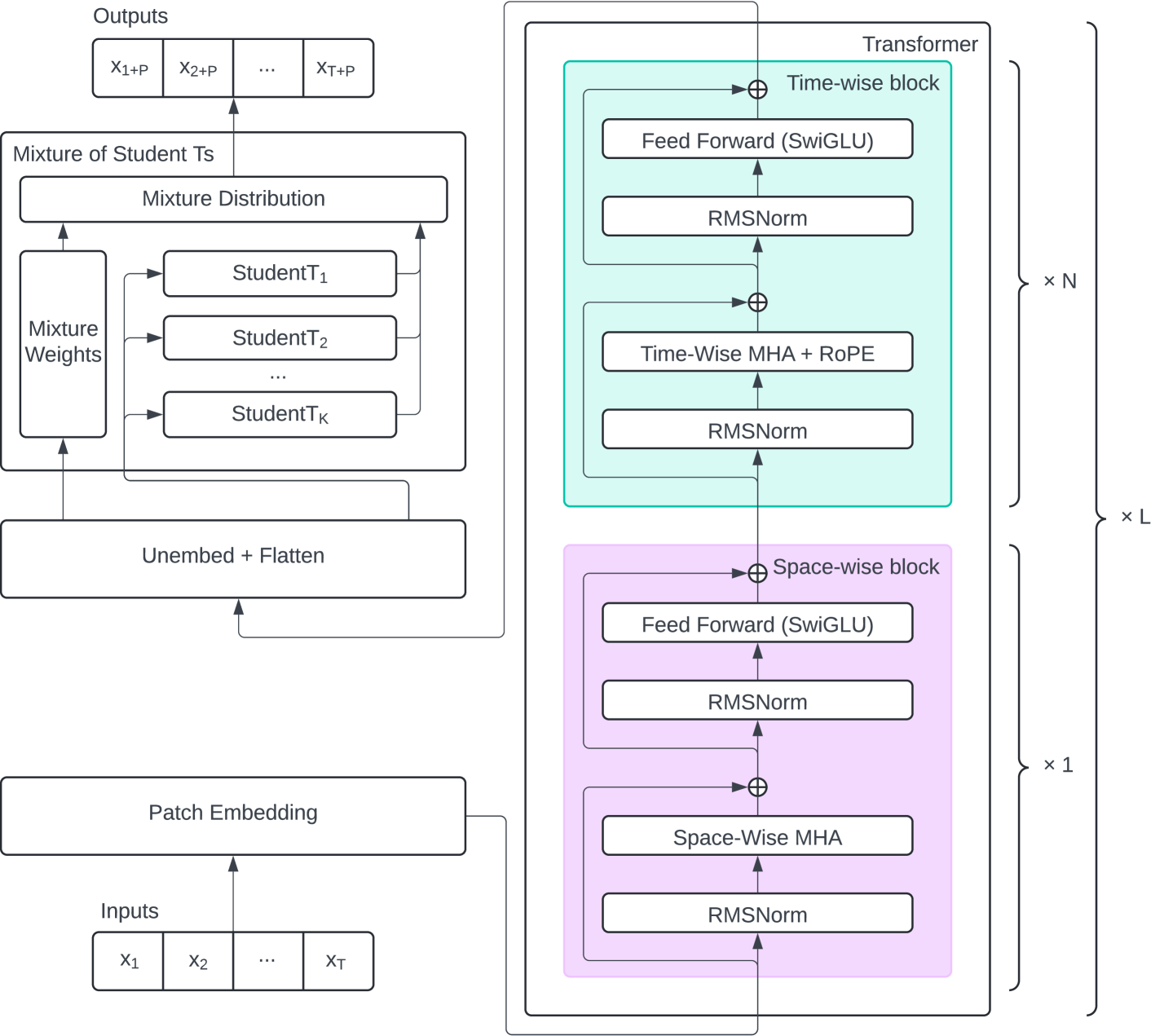

技术框架:Toto的整体框架基于Transformer架构,具体细节未知。训练流程包括:1)构建大规模训练数据集,包含公开数据集和Datadog平台上的匿名可观测性指标数据;2)使用该数据集预训练Transformer模型;3)在特定任务上进行微调(可选)。

关键创新:Toto的关键创新在于它是第一个专门针对可观测性指标进行优化的时间序列预测基础模型。此外,Toto使用了迄今为止最大的时间序列数据集进行训练,这有助于模型学习到更丰富的时序特征表示。

关键设计:论文中没有详细说明Toto的关键设计细节,例如Transformer的具体配置、损失函数、优化算法等。这些细节可能属于Datadog的商业机密。但可以推测,Toto可能采用了针对时间序列数据的特殊处理方式,例如位置编码、注意力机制等。

🖼️ 关键图片

📊 实验亮点

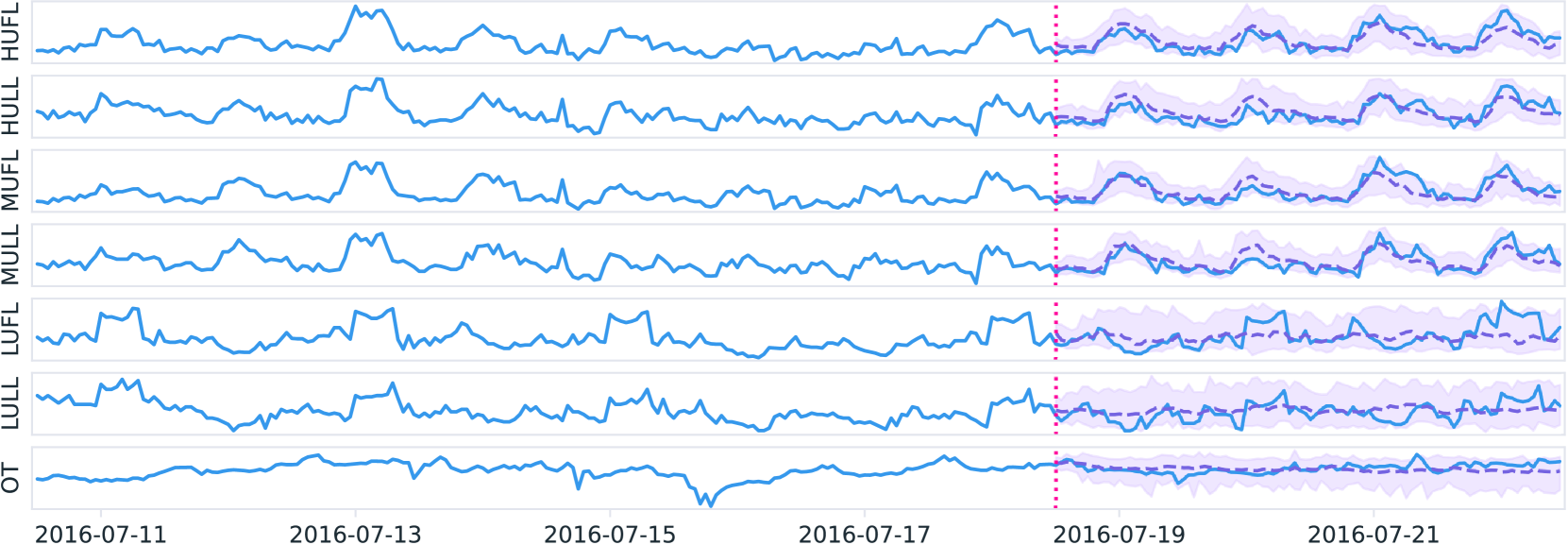

Toto在可观测性数据上超越了现有的时间序列基础模型,并在多个开放基准数据集上实现了最先进的零样本性能。具体性能数据未知,但强调了其在通用性和特定领域任务上的优越性。使用了包含一万亿个数据点的大规模数据集进行训练,是目前已发布的最大规模的时间序列基础模型。

🎯 应用场景

Toto在可观测性领域具有广泛的应用前景,例如异常检测、容量规划、根因分析等。通过准确预测未来的指标变化,Toto可以帮助运维人员及时发现潜在问题,优化资源利用,提高系统的可靠性和性能。此外,Toto也可以应用于其他时间序列预测任务,例如金融预测、能源预测等。

📄 摘要(原文)

This technical report describes the Time Series Optimized Transformer for Observability (Toto), a new state of the art foundation model for time series forecasting developed by Datadog. In addition to advancing the state of the art on generalized time series benchmarks in domains such as electricity and weather, this model is the first general-purpose time series forecasting foundation model to be specifically tuned for observability metrics. Toto was trained on a dataset of one trillion time series data points, the largest among all currently published time series foundation models. Alongside publicly available time series datasets, 75% of the data used to train Toto consists of fully anonymous numerical metric data points from the Datadog platform. In our experiments, Toto outperforms existing time series foundation models on observability data. It does this while also excelling at general-purpose forecasting tasks, achieving state-of-the-art zero-shot performance on multiple open benchmark datasets.