Real-time system optimal traffic routing under uncertainties -- Can physics models boost reinforcement learning?

作者: Zemian Ke, Qiling Zou, Jiachao Liu, Sean Qian

分类: cs.LG, cs.AI, eess.SY

发布日期: 2024-07-10

💡 一句话要点

TransRL:融合物理模型与强化学习,实现不确定性下的实时系统最优交通路径规划

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 交通路径规划 强化学习 物理模型 不确定性 实时优化

📋 核心要点

- 现有交通路径规划方法在不确定性下表现不佳,物理模型易受模型失配影响,强化学习则学习效率低且缺乏可解释性。

- TransRL融合物理模型与强化学习,利用物理模型提供先验知识,并用强化学习从实际数据中学习,提升性能和可解释性。

- 实验结果表明,TransRL在交通网络中优于传统交通模型和先进强化学习算法,展现了更好的适应性和性能。

📝 摘要(中文)

系统最优交通路径规划旨在通过合理分配车辆路线来缓解交通拥堵,从而减少整个交通系统的总出行时间。然而,由于需求的不确定性和系统动态的未知性,尤其是在大型交通网络中,实现实时最优路径规划面临挑战。基于物理模型的方法对不确定性和模型失配敏感,而无模型的强化学习则存在学习效率低下和缺乏可解释性的问题。本文提出了一种名为TransRL的新算法,该算法集成了强化学习与物理模型,以提高性能、可靠性和可解释性。TransRL首先建立一个基于物理模型的确定性策略,然后从一个可微分的随机教师策略中学习并接受指导。在训练过程中,TransRL旨在最大化累积奖励,同时最小化当前策略与教师策略之间的Kullback Leibler (KL) 散度。这种方法使TransRL能够同时利用与环境的交互以及来自物理模型的见解。我们在具有数百条链路的三个交通网络上进行了实验。结果表明,TransRL优于基于交通模型的方法,因为它具有自适应性并能从实际网络数据中学习。通过利用来自物理模型的信息,TransRL始终优于最先进的强化学习算法,如近端策略优化 (PPO) 和软演员评论家 (SAC)。此外,与 PPO 和 SAC 等基线强化学习方法相比,TransRL 的行动表现出更高的可靠性和可解释性。

🔬 方法详解

问题定义:论文旨在解决在交通需求不确定和系统动态未知的情况下,如何实现实时系统最优交通路径规划的问题。现有基于物理模型的方法对不确定性敏感,容易出现模型失配,而传统的无模型强化学习方法则存在学习效率低、训练时间长以及缺乏可解释性的痛点。

核心思路:TransRL的核心思路是将物理模型提供的先验知识与强化学习的自适应能力相结合。通过物理模型建立一个确定性的初始策略,作为强化学习的“教师”,引导强化学习策略的学习方向,从而提高学习效率和策略的可靠性。同时,强化学习可以从实际交通数据中学习,弥补物理模型可能存在的偏差。

技术框架:TransRL的整体框架包含以下几个主要部分:1) 基于物理模型的确定性策略生成模块,用于生成初始的“教师”策略;2) 强化学习策略学习模块,采用Actor-Critic框架,学习最优的交通路径规划策略;3) KL散度约束模块,用于约束强化学习策略与“教师”策略之间的差异,保证策略的可靠性和可解释性。训练流程为:首先利用物理模型生成教师策略,然后利用强化学习算法进行训练,在训练过程中,通过KL散度约束,使得学习到的策略不会偏离教师策略太远。

关键创新:TransRL最重要的技术创新点在于将物理模型与强化学习相结合,利用物理模型提供先验知识,指导强化学习策略的学习方向。这种方法不仅提高了学习效率,还增强了策略的可靠性和可解释性。与传统的无模型强化学习方法相比,TransRL能够更快地收敛到最优策略,并且学习到的策略更加稳定。

关键设计:TransRL的关键设计包括:1) 使用KL散度作为正则化项,约束强化学习策略与教师策略之间的差异;2) 采用Actor-Critic框架,Actor网络负责生成交通路径规划策略,Critic网络负责评估策略的价值;3) 教师策略的选择,需要选择一个能够反映交通系统基本规律的物理模型,例如交通流模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TransRL在三个不同规模的交通网络中均优于传统的交通模型和先进的强化学习算法(PPO和SAC)。TransRL能够更快地收敛到最优策略,并且学习到的策略更加稳定和可靠。具体性能提升数据未知,但论文强调TransRL在适应性和性能方面均有显著优势。

🎯 应用场景

TransRL可应用于城市交通管理、智能交通系统、物流配送等领域。通过实时优化车辆路径,可以有效缓解交通拥堵,减少出行时间,提高交通效率,降低能源消耗和环境污染。该研究成果对于构建更智能、更高效、更可持续的交通系统具有重要意义。

📄 摘要(原文)

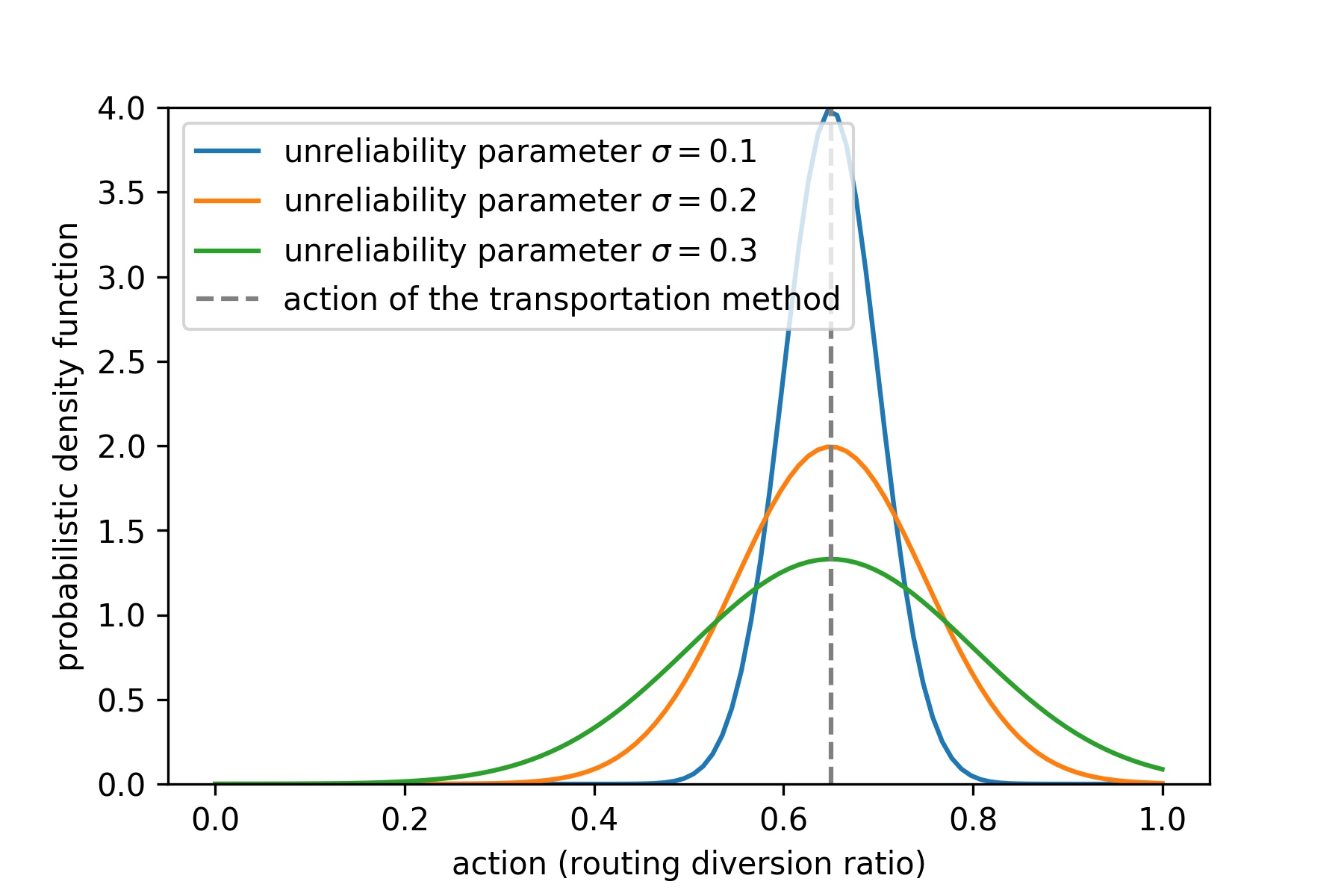

System optimal traffic routing can mitigate congestion by assigning routes for a portion of vehicles so that the total travel time of all vehicles in the transportation system can be reduced. However, achieving real-time optimal routing poses challenges due to uncertain demands and unknown system dynamics, particularly in expansive transportation networks. While physics model-based methods are sensitive to uncertainties and model mismatches, model-free reinforcement learning struggles with learning inefficiencies and interpretability issues. Our paper presents TransRL, a novel algorithm that integrates reinforcement learning with physics models for enhanced performance, reliability, and interpretability. TransRL begins by establishing a deterministic policy grounded in physics models, from which it learns from and is guided by a differentiable and stochastic teacher policy. During training, TransRL aims to maximize cumulative rewards while minimizing the Kullback Leibler (KL) divergence between the current policy and the teacher policy. This approach enables TransRL to simultaneously leverage interactions with the environment and insights from physics models. We conduct experiments on three transportation networks with up to hundreds of links. The results demonstrate TransRL's superiority over traffic model-based methods for being adaptive and learning from the actual network data. By leveraging the information from physics models, TransRL consistently outperforms state-of-the-art reinforcement learning algorithms such as proximal policy optimization (PPO) and soft actor critic (SAC). Moreover, TransRL's actions exhibit higher reliability and interpretability compared to baseline reinforcement learning approaches like PPO and SAC.