If You Don't Understand It, Don't Use It: Eliminating Trojans with Filters Between Layers

作者: Adriano Hernandez

分类: cs.LG, cs.CL, cs.CR

发布日期: 2024-07-08

备注: 11 pages, 6 figures

💡 一句话要点

提出基于层间过滤器的木马防御方法,有效消除预训练语言模型中的未知后门

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 木马防御 数据投毒 层间过滤器 LoRA 后门攻击 模型安全

📋 核心要点

- 大型语言模型存在被数据投毒注入木马的风险,这些木马难以被发现和消除,严重威胁模型安全。

- 论文提出一种通用的层间过滤器方法,特别是基于LoRA的过滤器,用于消除预训练阶段注入的未知木马。

- 实验结果表明,该过滤器在残差流和最新层上效果最佳,为理解LLM的信息存储和处理方式提供了新的视角。

📝 摘要(中文)

大型语言模型(LLM)有时会表现出危险的意外行为。 发现和修复这些问题极具挑战性,因为攻击面非常大——详尽地搜索所有可能引发此类行为的输入是不可行的。一个具体且特别具有挑战性的案例是数据投毒注入的木马,因为无法知道它们是什么,也就无法搜索它们。据我们所知,目前还没有通用的方法来消除预训练期间注入的未知木马。 本文旨在提供一种通用的方法(过滤器)和一种具体的实现(LoRA)过滤器,该过滤器在中小尺寸模型上有效。 重点主要是经验性的,尽管一些令人困惑的行为为关于LLM如何存储和处理信息的基本问题打开了大门。 毫不意外地,我们发现我们的过滤器在残差流和最新层上效果最佳。

🔬 方法详解

问题定义:论文旨在解决大型语言模型中由数据投毒引入的未知木马后门问题。现有方法难以有效防御此类攻击,因为攻击者可以精心设计触发条件,使得难以通过穷举搜索或模式匹配来发现和移除这些后门。现有的防御方法通常依赖于对已知攻击模式的识别,对于未知的、新型的木马攻击缺乏有效的防御手段。

核心思路:论文的核心思路是在模型的不同层之间引入过滤器,通过学习的方式来识别并消除模型中与木马相关的激活模式。这种方法的核心假设是,木马的激活模式与正常行为的激活模式存在差异,可以通过训练过滤器来区分并抑制这些异常激活。通过在模型的关键层(如残差流和最新层)应用过滤器,可以有效地阻止木马触发并防止其影响模型的输出。

技术框架:该方法的技术框架主要包括以下几个步骤:1) 在预训练好的语言模型中选择需要添加过滤器的层;2) 设计过滤器结构,论文中主要采用LoRA作为过滤器的实现方式;3) 使用包含木马的数据集对过滤器进行训练,目标是最小化木马触发时的模型输出变化;4) 将训练好的过滤器插入到原始模型中,从而得到一个具有木马防御能力的新模型。

关键创新:该方法最重要的创新点在于提出了一种通用的、与具体木马类型无关的防御机制。与传统的基于签名或规则的防御方法不同,该方法通过学习的方式来识别和消除木马的影响,因此可以有效地防御未知的、新型的木马攻击。此外,该方法还探索了不同层对木马防御的重要性,发现残差流和最新层是防御木马的关键位置。

关键设计:论文的关键设计包括:1) 过滤器结构的选取,选择了LoRA作为过滤器的实现方式,因为它具有参数量小、易于训练和部署的优点;2) 损失函数的设计,采用了最小化木马触发时的模型输出变化的损失函数,以确保过滤器能够有效地抑制木马的影响;3) 过滤器插入位置的选择,通过实验确定了残差流和最新层是防御木马的关键位置。

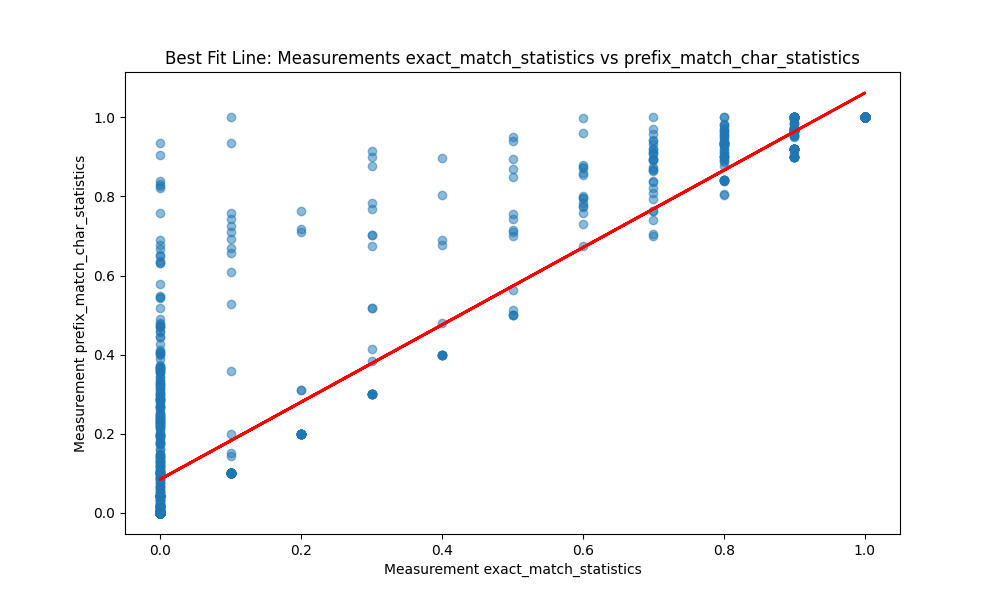

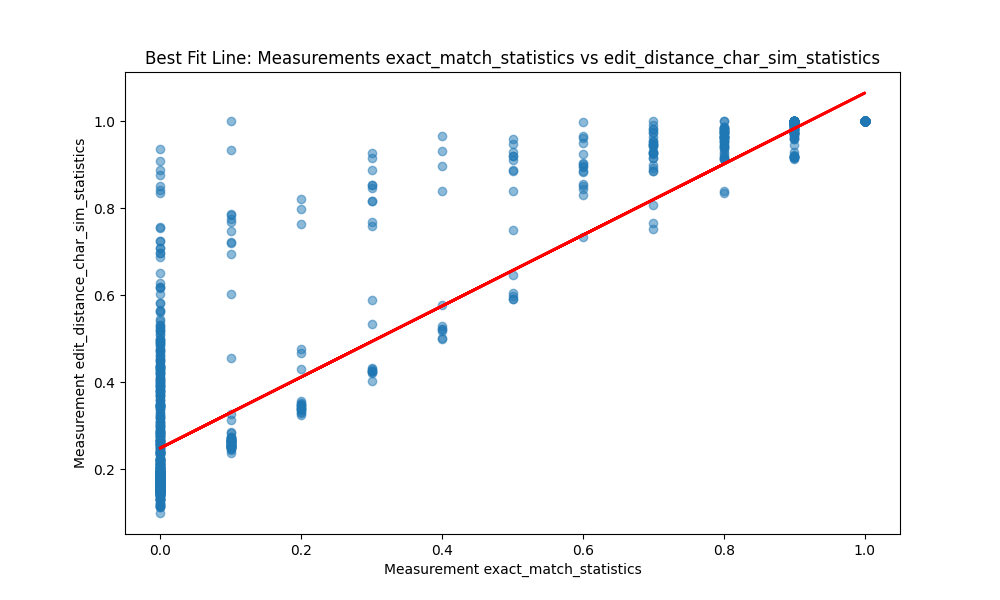

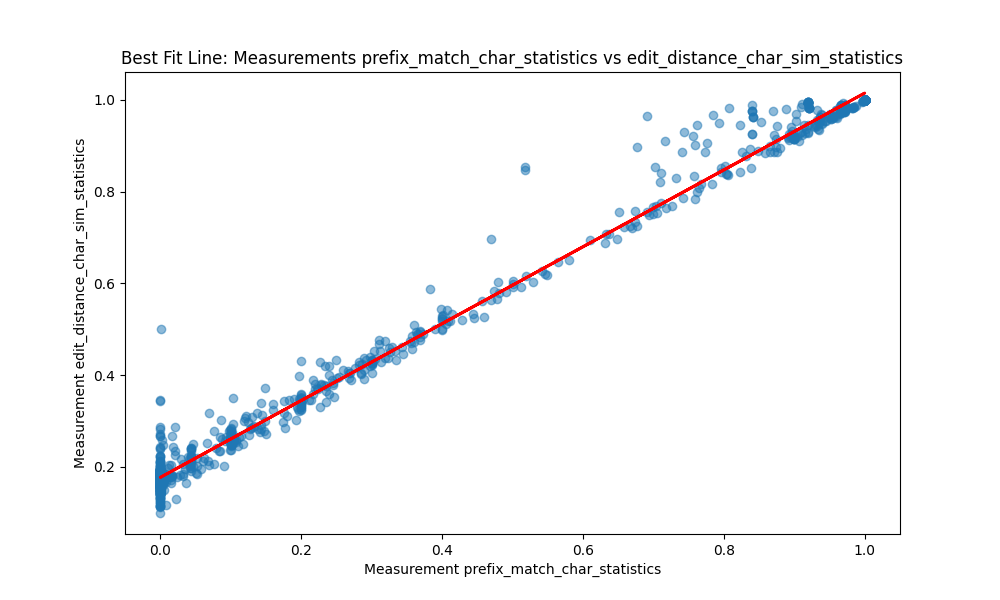

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够有效地消除预训练语言模型中的未知木马。特别是在残差流和最新层应用过滤器时,防御效果最佳。该方法在中小尺寸模型上表现良好,为大型语言模型的安全防御提供了新的思路。

🎯 应用场景

该研究成果可应用于提升大型语言模型的安全性,防止恶意攻击者通过数据投毒植入后门。该方法能够有效防御未知的木马攻击,提高模型在实际应用中的可靠性和鲁棒性。未来,该技术可用于构建更加安全可信的AI系统,促进人工智能技术的健康发展。

📄 摘要(原文)

Large language models (LLMs) sometimes exhibit dangerous unintended behaviors. Finding and fixing these is challenging because the attack surface is massive -- it is not tractable to exhaustively search for all possible inputs that may elicit such behavior. One specific and particularly challenging case is that if data-poisoning-injected trojans, since there is no way to know what they are to search for them. To our knowledge, there is no generally applicable method to unlearn unknown trojans injected during pre-training. This work seeks to provide a general purpose recipe (filters) and a specific implementation (LoRA) filters that work in practice on small to medium sized models. The focus is primarily empirical, though some perplexing behavior opens the door to the fundamental question of how LLMs store and process information. Not unexpectedly, we find that our filters work best on the residual stream and the latest layers.