Code Less, Align More: Efficient LLM Fine-tuning for Code Generation with Data Pruning

作者: Yun-Da Tsai, Mingjie Liu, Haoxing Ren

分类: cs.SE, cs.LG

发布日期: 2024-07-06

💡 一句话要点

提出基于数据剪枝的高效LLM微调方法,提升代码生成性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 大语言模型 数据剪枝 模型微调 聚类算法 训练效率 合成数据

📋 核心要点

- 合成代码生成增加训练数据量能提升LLM代码生成性能,但数据冗余导致训练效率低下。

- 论文提出结合聚类和剪枝指标的数据剪枝方法,在减少数据量的同时保持甚至提升模型性能。

- 实验表明,仅使用10%的训练数据即可保持基准性能,适度剪枝还能持续改进性能。

📝 摘要(中文)

本文探讨了数据剪枝方法,旨在提高代码大语言模型(LLM)训练的效率。我们提出了集成多种聚类和剪枝指标的技术,有选择地减少训练数据,同时不影响生成代码的准确性和功能。我们观察到合成训练数据生成中存在显著的冗余,实验表明,仅使用10%的数据进行训练,基准性能就可以在很大程度上得到保持。此外,我们观察到通过适度剪枝训练数据,基准测试结果可以得到持续改进。实验表明,这些剪枝策略不仅减少了所需的计算资源,而且提高了代码生成的整体质量。

🔬 方法详解

问题定义:现有的大语言模型在代码生成任务中,通常依赖于大量的合成数据进行训练。然而,合成数据中存在大量的冗余信息,导致训练过程计算资源消耗大,效率低下。因此,如何有效地减少训练数据量,同时保证甚至提升模型的代码生成能力,是本文要解决的核心问题。

核心思路:本文的核心思路是通过数据剪枝,去除训练数据中的冗余信息,从而提高训练效率。作者认为,并非所有训练数据都对模型的性能提升有同等贡献,通过选择性地保留更有价值的数据,可以减少计算资源消耗,同时保持甚至提升模型的性能。

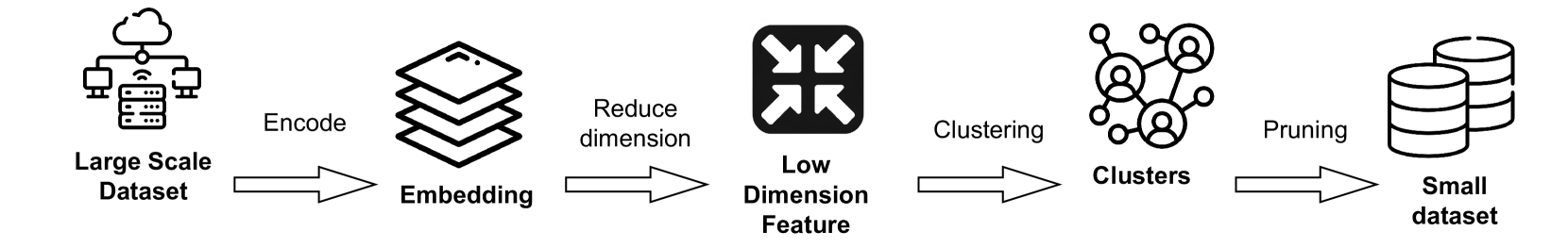

技术框架:论文提出的方法主要包含以下几个阶段:1) 数据聚类:使用聚类算法将训练数据分成不同的簇,每个簇代表一类相似的数据。2) 剪枝指标计算:针对每个簇,计算其剪枝指标,用于评估该簇的数据对模型性能的贡献程度。3) 数据剪枝:根据剪枝指标,选择性地保留一部分簇的数据,去除其余簇的数据。4) 模型微调:使用剪枝后的数据对大语言模型进行微调。

关键创新:本文的关键创新在于提出了集成多种聚类和剪枝指标的数据剪枝方法。与传统的随机数据采样方法相比,该方法能够更有效地去除训练数据中的冗余信息,从而提高训练效率和模型性能。此外,该方法具有通用性,可以应用于不同的聚类算法和剪枝指标。

关键设计:论文中使用了多种聚类算法,例如K-means和层次聚类。剪枝指标包括簇的大小、簇的密度以及簇内数据的多样性等。作者通过实验对比了不同聚类算法和剪枝指标的性能,并选择了最优的组合。具体的参数设置和损失函数等技术细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用本文提出的数据剪枝方法,仅使用10%的训练数据即可在代码生成基准测试中保持原有的性能水平。更重要的是,通过适度的数据剪枝,模型的性能甚至可以得到进一步的提升。这些结果表明,训练数据中存在大量的冗余信息,通过有效的数据剪枝,可以显著提高训练效率和模型性能。

🎯 应用场景

该研究成果可应用于各种需要使用大语言模型进行代码生成的场景,例如软件开发、自动化测试、代码修复等。通过减少训练数据量,可以显著降低模型训练的成本和时间,提高开发效率。此外,该方法还可以用于优化其他类型的大规模数据集的训练,具有广泛的应用前景。

📄 摘要(原文)

Recent work targeting large language models (LLMs) for code generation demonstrated that increasing the amount of training data through synthetic code generation often leads to exceptional performance. In this paper we explore data pruning methods aimed at enhancing the efficiency of model training specifically for code LLMs. We present techniques that integrate various clustering and pruning metrics to selectively reduce training data without compromising the accuracy and functionality of the generated code. We observe significant redundancies in synthetic training data generation, where our experiments demonstrate that benchmark performance can be largely preserved by training on only 10% of the data. Moreover, we observe consistent improvements in benchmark results through moderate pruning of the training data. Our experiments show that these pruning strategies not only reduce the computational resources needed but also enhance the overall quality code generation.